【深度学习】perceptron(感知机)

个人学习笔记,有兴趣的朋友可参考。

1.感知机的描述

感知机(perceptron)由美国学者Frank Rosenblatt在1957年提出来的。是作为神经网络(深度学习)的起源的算法、

学习感知机的构造也就是学习通向神经网络和深度学习的一种重要思想

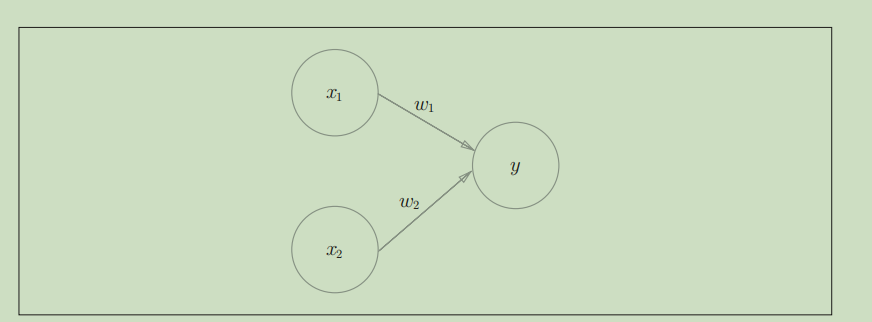

感知机接收多个输入信号,输出一个信号。如下图:

其中:

- x1、x2是输入信号,y是输出信号

- w1、w2是权重

- 图中的○,代表一个个“神经元”

- 通过一个固定的权重算法(w1x1、w2x2),当超过θ这个阈值,输出1,代表“神经元被激活”。否则为0,代表未激活、

公式如下:

\begin{cases}

0,(w1x1+w2x2<= θ)\\

1,(w1x1+w2x2> θ)

\end{cases}

\]

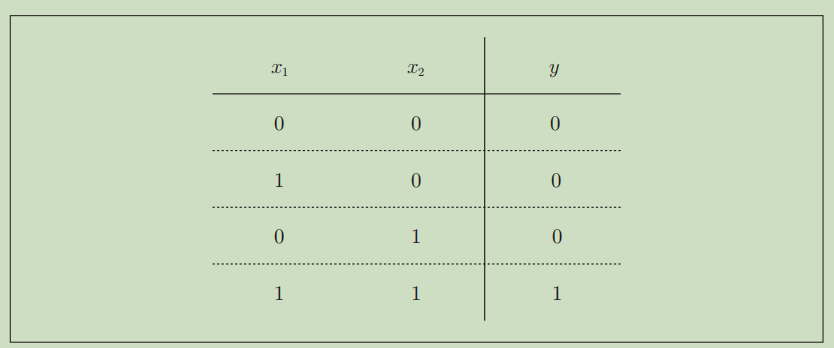

2.感知机解决简单逻辑电路,与门的问题。

与门的真值表如下:

就是两个输入都为1的情况下,输出才为1。

代码如下:

def AND(x1,x2):

w1,w2,theta =0.5,0.5,0.6

tmp =x1*w1 +x2*w2

if tmp <= theta:

return 0

elif tmp >theta:

return 1

print(AND(0,0))

print(AND(1,0))

print(AND(0,1))

print(AND(1,1))

演示效果如下:

(zsdpy1) zsd@zsd-virtual-machine:~/ZAI$ python section04.py

0

0

0

1

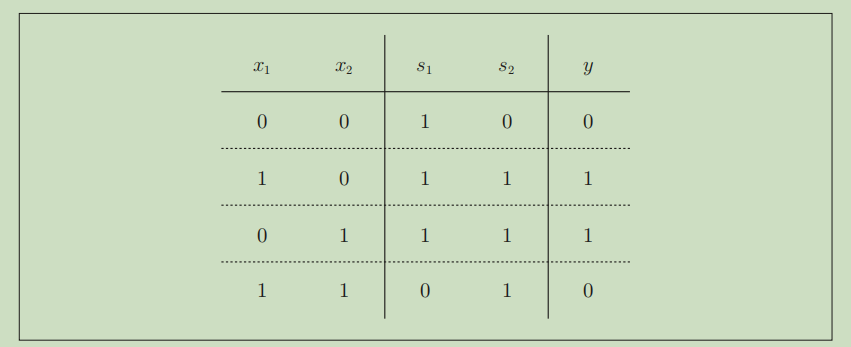

2.多层感应机,解决异或门

异或门的真值表

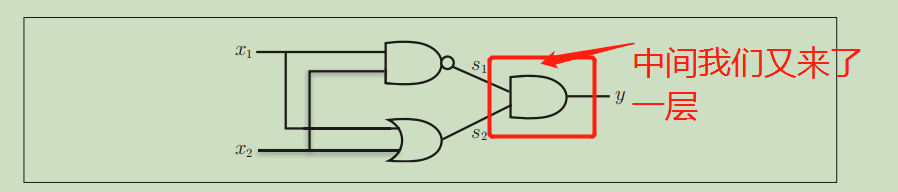

可以看到,异或门用一层没有办法解决。所以我们可以再来一个"叠加层"、通过多层的结构。来达到异或门的效果。

如下图:

代码的实现,可能需要把与门,非门,与非门的函数都实现一遍。通过它们的组合完成异或门(大学时期学的逻辑电路终于派上了一点点用场了)

代码如下:

import numpy as np

def AND(x1,x2):

w1,w2,theta =0.5,0.5,0.6

tmp =x1*w1 +x2*w2

if tmp <= theta:

return 0

elif tmp >theta:

return 1

def OR(x1, x2):

x = np.array([x1, x2])

w = np.array([0.5, 0.5])

b = -0.2

tmp = np.sum(w*x) + b

if tmp <= 0:

return 0

else:

return 1

def NAND(x1, x2):

x = np.array([x1, x2])

w = np.array([-0.5, -0.5])

b = 0.7

tmp = np.sum(w*x) + b

if tmp <= 0:

return 0

else:

return 1

def XOR(x1, x2):

s1 = NAND(x1, x2)

s2 = OR(x1, x2)

y = AND(s1, s2)

return y

if __name__ == '__main__':

for xs in [(0, 0), (1, 0), (0, 1), (1, 1)]:

y = XOR(xs[0], xs[1])

print(str(xs) + " -> " + str(y))

演示效果如下:

(zsdpy1) zsd@zsd-virtual-machine:~/ZAI$ python section05.py

(0, 0) -> 0

(1, 0) -> 1

(0, 1) -> 1

(1, 1) -> 0

【深度学习】perceptron(感知机)的更多相关文章

- 动手学深度学习11- 多层感知机pytorch简洁实现

多层感知机的简洁实现 定义模型 读取数据并训练数据 损失函数 定义优化算法 小结 多层感知机的简洁实现 import torch from torch import nn from torch.nn ...

- (转)神经网络和深度学习简史(第一部分):从感知机到BP算法

深度|神经网络和深度学习简史(第一部分):从感知机到BP算法 2016-01-23 机器之心 来自Andrey Kurenkov 作者:Andrey Kurenkov 机器之心编译出品 参与:chen ...

- 利用Theano理解深度学习——Multilayer Perceptron

一.多层感知机MLP 1.MLP概述 对于含有单个隐含层的多层感知机(single-hidden-layer Multi-Layer Perceptron, MLP),可以将其看成是一个特殊的Logi ...

- 动手学深度学习9-多层感知机pytorch

多层感知机 隐藏层 激活函数 小结 多层感知机 之前已经介绍过了线性回归和softmax回归在内的单层神经网络,然后深度学习主要学习多层模型,后续将以多层感知机(multilayer percetro ...

- Tensorflow 2.0 深度学习实战 —— 详细介绍损失函数、优化器、激活函数、多层感知机的实现原理

前言 AI 人工智能包含了机器学习与深度学习,在前几篇文章曾经介绍过机器学习的基础知识,包括了监督学习和无监督学习,有兴趣的朋友可以阅读< Python 机器学习实战 >.而深度学习开始只 ...

- 深度学习基础-基于Numpy的感知机Perception构建和训练

1. 感知机模型 感知机Perception是一个线性的分类器,其只适用于线性可分的数据. f(x) = sign(w.x + b) 其试图在所有线性可分超平面构成的假设空间中找 ...

- 从感知机到 SVM,再到深度学习(三)

这篇博文详细分析了前馈神经网络的内容,它对应的函数,优化过程等等. 在上一篇博文中已经完整讲述了 SVM 的思想和原理.讲到了想用一个高度非线性的曲线作为拟合曲线.比如这个曲线可以是: ...

- Deep Learning(深度学习)学习笔记整理

申明:本文非笔者原创,原文转载自:http://www.sigvc.org/bbs/thread-2187-1-3.html 4.2.初级(浅层)特征表示 既然像素级的特征表示方法没有作用,那怎样的表 ...

- paper 53 :深度学习(转载)

转载来源:http://blog.csdn.net/fengbingchun/article/details/50087005 这篇文章主要是为了对深度学习(DeepLearning)有个初步了解,算 ...

随机推荐

- Autowired和Resource区别

@Autowired和@Resource熟悉吧?是不是经常复制粘贴顺手就来,两者都是用来给成员变量自动装载,可是它俩到底有啥区别呢? 1.@Autowired与@Resource都可以用来装配bean ...

- Elasticsearch系列---深入全文搜索

概要 本篇介绍怎样在全文字段中搜索到最相关的文档,包含手动控制搜索的精准度,搜索条件权重控制. 手动控制搜索的精准度 搜索的两个重要维度:相关性(Relevance)和分析(Analysis). 相关 ...

- 对象深拷贝deepCopy

function type(obj){ return Object.prototype.toString.call(obj).slice(8,-1); } function deepCopy(targ ...

- Spring 事务传播机制和数据库的事务隔离级别

Propagation(事务传播属性) 类别 传播类型 说明 支持当前事务 REQUIRED 如果当前没有事务,就新建一个事务.@Transaction的默认选择 支持当前事务 SUPPORTS 就以 ...

- 使用timeit测试Python函数的性能

timeit是Python标准库内置的小工具,可以快速测试小段代码的性能. 认识timeit timeit 函数: timeit.timeit(stmt, setup,timer, number) 参 ...

- node--静态服务器

1.同步读取文件 const data = fs.readFileSync('./model/mime.json'); // 这里是添加了可以正常链接其他格式文件的服务器 const http = ...

- 基于Vue的机器学习平台前端

项目演示地址:http://vidanao.com/ml>注意1:前端兼容性不太好,360浏览器比较兼容; >注意2:此vidanao.com也是我的个人博文主页,但目前还没部署 源码地址 ...

- step(iter)、epoch、batch size之间的关系

转自:https://blog.csdn.net/wcy23580/article/details/90082221

- JavaScript对象(二)

Part One:对象的三个特性 原型(prototype) 类(class) 可扩展性(extensible attribute) 1,b.isPrototypeOf(o) //判断b是不是o的 ...

- 基于springcloud搭建项目-Ribbon篇(三)

这篇文章主要是介绍一下ribbon的用法,我们都知道ribbon是负载均衡,但是却不知道他是怎么样的负载均衡,怎么用,能干嘛? ● 其实,简单的说,Spring Cloud Ribbon是基于Netf ...