spark学习之Lambda架构日志分析流水线

单机运行

一、环境准备

Flume 1.6.0

Hadoop 2.6.0

Spark 1.6.0

Java version 1.8.0_73

Kafka 2.11-0.9.0.1

zookeeper 3.4.6

二、配置

spark和hadoop配置见()

kafka和zookeeper使用默认配置

1、kafka配置

启动

bin/kafka-server-start.sh config/server.properties

创建一个test的topic

bin/kafka-topics.sh --create --zookeeper vm: --replication-factor --partitions --topic test

2、flume配置文件,新建一个dh.conf文件,配置如下

其中发送的内容为apache-tomcat-8.0.32的访问日志

#define c1

agent1.channels.c1.type = memory

agent1.channels.c1.capacity =

agent1.channels.c1.transactionCapacity =

#define c1 end #define c2

agent1.channels.c2.type = memory

agent1.channels.c2.capacity =

agent1.channels.c2.transactionCapacity =

#define c2 end #define source monitor a file

agent1.sources.avro-s.type = exec

agent1.sources.avro-s.command = tail -f -n+ /usr/local/hong/apache-tomcat-8.0./logs/localhost_access_log.--.txt

agent1.sources.avro-s.channels = c1 c2

agent1.sources.avro-s.threads = # send to hadoop

agent1.sinks.log-hdfs.channel = c1

agent1.sinks.log-hdfs.type = hdfs

agent1.sinks.log-hdfs.hdfs.path = hdfs://vm:9000/flume

agent1.sinks.log-hdfs.hdfs.writeFormat = Text

agent1.sinks.log-hdfs.hdfs.fileType = DataStream

agent1.sinks.log-hdfs.hdfs.rollInterval =

agent1.sinks.log-hdfs.hdfs.rollSize =

agent1.sinks.log-hdfs.hdfs.rollCount =

agent1.sinks.log-hdfs.hdfs.batchSize =

agent1.sinks.log-hdfs.hdfs.txnEventMax =

agent1.sinks.log-hdfs.hdfs.callTimeout =

agent1.sinks.log-hdfs.hdfs.appendTimeout = #send to kafaka

agent1.sinks.log-sink2.type = org.apache.flume.sink.kafka.KafkaSink

agent1.sinks.log-sink2.topic = test

agent1.sinks.log-sink2.brokerList = vm:

agent1.sinks.log-sink2.requiredAcks =

agent1.sinks.log-sink2.batchSize =

agent1.sinks.log-sink2.channel = c2 # Finally, now that we've defined all of our components, tell

# agent1 which ones we want to activate.

agent1.channels = c1 c2

agent1.sources = avro-s

agent1.sinks = log-hdfs log-sink2

三、测试flume发送

1、启动hdfs

./start-dfs.sh

2、启动zookeeper

./zkServer.sh start

3、kafka的见上面

4、启动flume

flume-ng agent -c conf -f dh.conf -n agent1 -Dflume.root.logger=INFO,console

四、测试效果

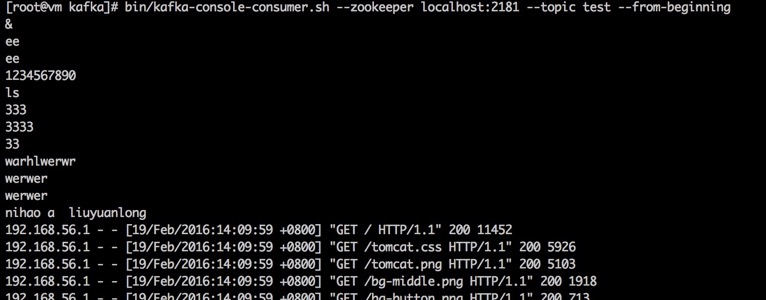

运行kafka的consumer查看

bin/kafka-console-consumer.sh --zookeeper localhost: --topic test --from-beginning

可以看到如下内容说明kafka和flume的配置成功

访问hdfs查看如果/flume可以下载文件进行查看验证hdfs发送是否成功

spark学习之Lambda架构日志分析流水线的更多相关文章

- spark SQL学习(综合案例-日志分析)

日志分析 scala> import org.apache.spark.sql.types._ scala> import org.apache.spark.sql.Row scala&g ...

- Hadoop学习笔记—20.网站日志分析项目案例(一)项目介绍

网站日志分析项目案例(一)项目介绍:当前页面 网站日志分析项目案例(二)数据清洗:http://www.cnblogs.com/edisonchou/p/4458219.html 网站日志分析项目案例 ...

- Hadoop学习笔记—20.网站日志分析项目案例(三)统计分析

网站日志分析项目案例(一)项目介绍:http://www.cnblogs.com/edisonchou/p/4449082.html 网站日志分析项目案例(二)数据清洗:http://www.cnbl ...

- Hadoop学习笔记—20.网站日志分析项目案例

1.1 项目来源 本次要实践的数据日志来源于国内某技术学习论坛,该论坛由某培训机构主办,汇聚了众多技术学习者,每天都有人发帖.回帖,如图1所示. 图1 项目来源网站-技术学习论坛 本次实践的目的就在于 ...

- Hadoop学习笔记—20.网站日志分析项目案例(二)数据清洗

网站日志分析项目案例(一)项目介绍:http://www.cnblogs.com/edisonchou/p/4449082.html 网站日志分析项目案例(二)数据清洗:当前页面 网站日志分析项目案例 ...

- 【Spark】通过Spark实现点击流日志分析

文章目录 数据大致内容及格式 统计PV(PageViews) 统计UV(Unique Visitor) 求取TopN 数据大致内容及格式 194.237.142.21 - - [18/Sep/2013 ...

- Spark学习之Spark调优与调试(7)

Spark学习之Spark调优与调试(7) 1. 对Spark进行调优与调试通常需要修改Spark应用运行时配置的选项. 当创建一个SparkContext时就会创建一个SparkConf实例. 2. ...

- 架构之ELK日志分析系统

ELK多种架构及优劣 既然要谈ELK在大数据运维系统中的应用,那么ELK架构就不得不谈.本章节引出四种笔者曾经用过的ELK架构,并讨论各种架构所适合的场景和优劣供大家参考. 先大致介绍ELK组件.EL ...

- 苏宁基于Spark Streaming的实时日志分析系统实践 Spark Streaming 在数据平台日志解析功能的应用

https://mp.weixin.qq.com/s/KPTM02-ICt72_7ZdRZIHBA 苏宁基于Spark Streaming的实时日志分析系统实践 原创: AI+落地实践 AI前线 20 ...

随机推荐

- Failed to configure a DataSource 'url' attribute问题解决

才写了一行代码又报错了.. *************************** APPLICATION FAILED TO START *************************** De ...

- php 中 使用foreach为数组增加键值对

php 中的 foreach 在php中,使用foreach来遍历数组的频率很高,并且其性能要高于 list() 和 each() 结合来遍历数组: 当遍历二位数组的第一层数组,并要给第二位数组增加一 ...

- springboot项目的maven的pom.xml文件第一行报错 Unknown Error

springboot项目的maven的pom.xml文件第一行报错 Unknown Error https://blog.csdn.net/mini_jike/article/details/9239 ...

- koa 实现下载文件

文件下载需要使用到koa-send这个插件,该插件是一个静态文件服务的中间件,它可以用来实现文件下载的功能. 1.下载页面 static/download.html <!DOCTYPE html ...

- html5验证自适应

// 移动端跳转 var OS = function() { var a = navigator.userAgent, b = /(?:Android)/.test(a), d = /(?:Firef ...

- mysql的启动问题

用cmd启动MySQL (net start mysql )时出现(发生系统错误 5. 拒绝访问)这样的错误是因为cmd 权限太低了需要提高cmd权限才行(即使管理员权限) 如下图cmd所示: ...

- RoP

RoPS特征提取 RoPS为Rotational Projection Statistics的简写,即旋转投影统计特征.RoPS特征具有对点云旋转和平移(即姿态变化)的不变性,具备很强的鉴别力以及对噪 ...

- element-ui el-upload http-request自定义上传方法

html <el-form-item class="upload-bg register-bg" prop="ad_url"> <div cl ...

- vue-cli 构建的项目 webpack 如何配置不 build 出 .map 文件?

build命令后占体积最大的竟然是.map文件,webpack如何设置不让编译出.map文件呢?

- SpringMVC整合SpringFox实践总结

项目中使用的swagger框架在生成api文档时存在一些问题: 1. 控制器下方法无法点击展开 2.api内容结构混乱 基于上述原因,重新整合重构了一下api文档生成的代码.在此将重整过程记录下来,方 ...