对数损失函数(Logarithmic Loss Function)的原理和 Python 实现

原理

对数损失, 即对数似然损失(Log-likelihood Loss), 也称逻辑斯谛回归损失(Logistic Loss)或交叉熵损失(cross-entropy Loss), 是在概率估计上定义的.它常用于(multi-nominal, 多项)逻辑斯谛回归和神经网络,以及一些期望极大算法的变体. 可用于评估分类器的概率输出.

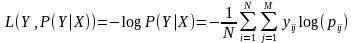

对数损失通过惩罚错误的分类,实现对分类器的准确度(Accuracy)的量化. 最小化对数损失基本等价于最大化分类器的准确度.为了计算对数损失, 分类器必须提供对输入的所属的每个类别的概率值, 不只是最可能的类别. 对数损失函数的计算公式如下:

其中, Y 为输出变量, X为输入变量, L 为损失函数. N为输入样本量, M为可能的类别数, yij 是一个二值指标, 表示类别 j 是否是输入实例 xi 的真实类别. pij 为模型或分类器预测输入实例 xi 属于类别 j 的概率.

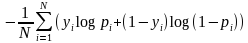

如果只有两类 {0, 1}, 则对数损失函数的公式简化为

这时, yi 为输入实例 xi 的真实类别, pi 为预测输入实例 xi 属于类别 1 的概率. 对所有样本的对数损失表示对每个样本的对数损失的平均值, 对于完美的分类器, 对数损失为 0 .

Python 实现

采用自定义 logloss 函数和 scikit-learn 库中 sklearn.metrics.log_loss 函数两种方式实现对数损失, 如下所示:

#!/usr/bin/env python

# -*- coding: utf8 -*-

#author: klchang

#date: 2018.6.23 # y_true: list, the true labels of input instances

# y_pred: list, the probability when the predicted label of input instances equals to 1

def logloss(y_true, y_pred, eps=1e-15):

import numpy as np # Prepare numpy array data

y_true = np.array(y_true)

y_pred = np.array(y_pred)

assert (len(y_true) and len(y_true) == len(y_pred)) # Clip y_pred between eps and 1-eps

p = np.clip(y_pred, eps, 1-eps)

loss = np.sum(- y_true * np.log(p) - (1 - y_true) * np.log(1-p)) return loss / len(y_true) def unitest():

y_true = [0, 0, 1, 1]

y_pred = [0.1, 0.2, 0.7, 0.99] print ("Use self-defined logloss() in binary classification, the result is {}".format(logloss(y_true, y_pred))) from sklearn.metrics import log_loss

print ("Use log_loss() in scikit-learn, the result is {} ".format(log_loss(y_true, y_pred))) if __name__ == '__main__':

unitest()

注: 在实现时, 加入参数 eps, 避免因预测概率输出为 0 或 1 而导致的计算错误的情况; 对数损失函数的输入参数 y_pred 为当预测实例属于类 1 时的概率; 对数损失采用自然对数计算结果.

参考资料

1. Log Loss. http://wiki.fast.ai/index.php/Log_Loss

2. Making Sense of Logarithmic Loss. https://www.r-bloggers.com/making-sense-of-logarithmic-loss/

3. What is an intuitive explanation for the log loss function. https://www.quora.com/What-is-an-intuitive-explanation-for-the-log-loss-function

4. log-loss in scikit-learn documentation. http://scikit-learn.org/stable/modules/model_evaluation.html#log-loss

5. sklearn documentation-sklearn.metrics.log_loss. http://scikit-learn.org/stable/modules/generated/sklearn.metrics.log_loss.html#sklearn.metrics.log_loss

6. 李航. 统计学习方法. 北京: 清华大学出版社. 2012

对数损失函数(Logarithmic Loss Function)的原理和 Python 实现的更多相关文章

- 【深度学习】一文读懂机器学习常用损失函数(Loss Function)

最近太忙已经好久没有写博客了,今天整理分享一篇关于损失函数的文章吧,以前对损失函数的理解不够深入,没有真正理解每个损失函数的特点以及应用范围,如果文中有任何错误,请各位朋友指教,谢谢~ 损失函数(lo ...

- 单链表反转的原理和python代码实现

链表是一种基础的数据结构,也是算法学习的重中之重.其中单链表反转是一个经常会被考察到的知识点. 单链表反转是将一个给定顺序的单链表通过算法转为逆序排列,尽管听起来很简单,但要通过算法实现也并不是非常容 ...

- 惩罚因子(penalty term)与损失函数(loss function)

penalty term 和 loss function 看起来很相似,但其实二者完全不同. 惩罚因子: penalty term的作用是把受限优化问题转化为非受限优化问题. 比如我们要优化: min ...

- 代理损失函数(surrogate loss function)

Surrogate loss function,中文可以译为代理损失函数.当原本的loss function不便计算的时候,我们就会考虑使用surrogate loss function. 在二元分类 ...

- Tensorflow 损失函数(loss function)及自定义损失函数(三)

版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明. 本文链接:https://blog.csdn.net/limiyudianzi/article ...

- 损失函数(Loss Function)

转载请注明出自BYRans博客:http://www.cnblogs.com/BYRans/ 线性回归中提到最小二乘损失函数及其相关知识.对于这一部分知识不清楚的同学可以参考上一篇文章<线性回归 ...

- woe_iv原理和python代码建模

python信用评分卡(附代码,博主录制) https://study.163.com/course/introduction.htm?courseId=1005214003&utm_camp ...

- k-means原理和python代码实现

k-means:是无监督的分类算法 k代表要分的类数,即要将数据聚为k类; means是均值,代表着聚类中心的迭代策略. k-means算法思想: (1)随机选取k个聚类中心(一般在样本集中选取,也可 ...

- 线性插值法的原理和python代码实现

假设我们已知坐标 (x0, y0) 与 (x1, y1),要得到 [x0, x1] 区间内某一位置 x 在直线上的值.根据图中所示,我们得到 由于 x 值已知,所以可以从公式得到 y 的值 已知 y ...

随机推荐

- 《LeetBook》leetcode题解(7): Reverse Integer[E]——处理溢出的技巧

我现在在做一个叫<leetbook>的开源书项目,把解题思路都同步更新到github上了,需要的同学可以去看看 书的地址:https://hk029.gitbooks.io/leetboo ...

- nuxt.js引入客户端脚本和第三方库出现window/document/ navigator未定义问题

官方文档中已经给出解决方案: 实际操作也比较简单,比如我之前在项目中引入的wangeditor,这个插件里包含了navigator内容 解决:现在nuxt.config.js的webpack扩展配置中 ...

- tomcat监控工具probe

probe官网:http://www.lambdaprobe.org/ 但是已经链接至github了:https://github.com/psi-probe/psi-probe 下载psi-prob ...

- JavaScript设计模式-5.接口

<!DOCTYPE html> <html> <head> <meta charset="UTF-8"> <title> ...

- Innosetup中在安装界面左下角添加超链接

在程序的安装界面左下角加上超链接,如下图: 1. 新建一个标签,这里使用的控件是TNewStaticText ,完整的方法是 //该方法传入两个参数: //1. ParentForm:将这个URLLa ...

- 基于RedHat6.5的Greenplum环境配置

安装Greenplum的时候遇到了很多坑,在此记录下 欢迎园友补充问题,共同研究解决! 安装说明 1.环境说明 操作系统:Red hat 6.5 64 位 2.配置规范 2.1基本说明 greenpl ...

- C#泛型设计的一个小陷阱.

距离上次发表博客已经有几年了. 对于没能坚持更新博客,实在是感觉到甚是惭愧. 闲言少叙, 直接切入主题. 背景 最近一直在对于公司一个网络通信服务程序使用.net core 进行重构.重构的目的有两个 ...

- $emit子组件传出多个参数,如何在父组件中在接收所有参数的同时添加自定义参数

很多时候用$emit携带参数传出事件,并且又需要在父组件中使用自定义参数时,这时我们就无法接受到子组件传出的参数了. 找到了两种方法可以同时添加自定义参数的方法. 方法一:子组件传出单个参数时 ...

- vue面试题总汇

active-class是哪个组件的属性? vue-router模块的router-link组件. 嵌套路由怎么定义? 在实际项目中我们会碰到多层嵌套的组件组合而成,但是我们如何实现嵌套路由呢?因此我 ...

- Vue组件库

滴滴cube-ui https://didi.github.io/cube-ui/#/zh-CN/docs/quick-start 有赞开源Vant(适合做商城) https://tech.youza ...