Flume对接Kafka

一.简单实现

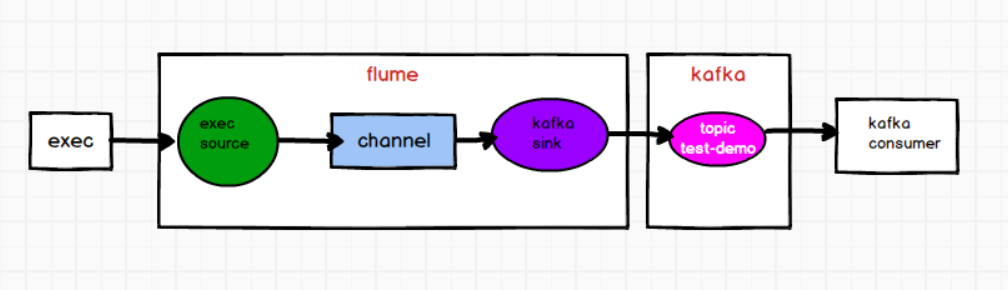

需求:根据 flume 监控 exec 文件的追加数据,写入 kafka 的 test-demo 分区,然后启用 kafka-consumer 消费 test-demo 分区数据。

需求分析

1)flume的配置文件

在hadoop102上创建flume的配置文件

# define

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# source

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /opt/module/testdata/3.txt

# sink

a1.sinks.k1.type = org.apache.flume.sink.kafka.KafkaSink

#kafka的broker主机和端口

a1.sinks.k1.kafka.bootstrap.servers = hadoop102:9092,hadoop103:9092,hadoop104:9092

#kafka sink发送数据的topic

a1.sinks.k1.kafka.topic = test-demo

a1.sinks.k1.kafka.flumeBatchSize = 20

a1.sinks.k1.kafka.producer.acks = 1

a1.sinks.k1.kafka.producer.linger.ms = 1

# channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# bind

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

2)启动 zk、kafka集群

3)创建 test-demo 主题

bin/kafka-topics.sh --create --bootstrap-server hadoop102:9092 --topic test-demo --partitions 2 --replication-factor 2

4)启动 kafka consumer 去消费 test-demo 主题

bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic test-demo

aaa

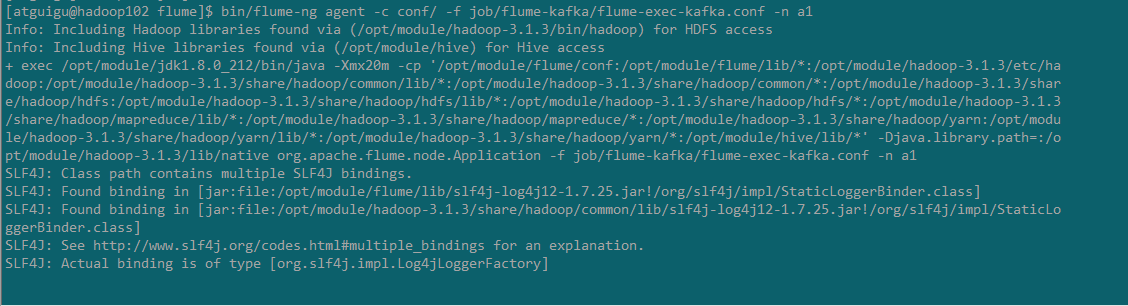

5)启动 flume,并且往 3.txt 中追加数据

bin/flume-ng agent -c conf/ -f job/flume-kafka/flume-exec-kafka.conf -n a1

echo hello >> /opt/module/testdata/3.txt

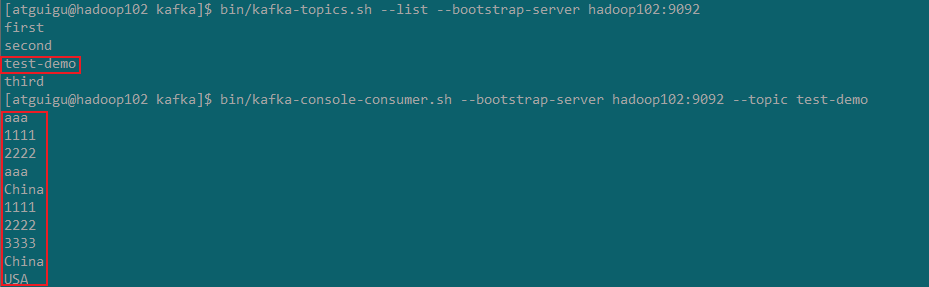

6)观察 kafka consumer 的消费情况

二.自定义interceptor(使用kafka sink)

需求:flume监控 exec 文件的追加数据,将flume采集的数据按照不同的类型输入到不同的topic中

将日志数据中带有的 hello 的,输入到kafka的 first 主题中,

将日志数据中带有 good 的,输入到kafka的 second 主题中,

其他的数据输入到kafka的 third 主题中

需求分析

通过自定义 flume 的拦截器,往 header 增加 topic 信息 ,配置文件中 kafka sink 增加 topic 配置,实现将数据按照指定 topic 发送。

1)自定义 flume 拦截器

创建工程,pom依赖

<dependencies>

<dependency>

<groupId>org.apache.flume</groupId>

<artifactId>flume-ng-core</artifactId>

<version>1.9.0</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<artifactId>maven-compiler-plugin</artifactId>

<version>2.3.2</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

</configuration>

</plugin>

</plugins>

</build>

自定义拦截器类,并打包上传至/opt/module/flume/lib包下

package com.bigdata.intercepter;

import org.apache.flume.Context;

import org.apache.flume.Event;

import org.apache.flume.interceptor.Interceptor;

import java.util.ArrayList;

import java.util.List;

import java.util.Map;

/**

* @description: TODO 自定义flume拦截器

* @author: HaoWu

* @create: 2020/7/7 20:32

*/

public class FlumeKafkaInterceptorDemo implements Interceptor {

private List<Event> events;

//初始化

@Override

public void initialize() {

events = new ArrayList<>();

}

@Override

public Event intercept(Event event) {

// 获取event的header

Map<String, String> header = event.getHeaders();

// 获取event的boby

String body = new String(event.getBody());

// 根据body中的数据设置header

if (body.contains("hello")) {

header.put("topic", "first");

} else if (body.contains("good")) {

header.put("topic", "second");

}

return event;

}

@Override

public List<Event> intercept(List<Event> events) {

// 对每次批数据进来清空events

events.clear();

// 循环处理单个event

for (Event event : events) {

events.add(intercept(event));

}

return events;

}

@Override

public void close() {

}

// 静态内部类创建自定义拦截器对象

public static class Builder implements Interceptor.Builder{

@Override

public Interceptor build() {

return new FlumeKafkaInterceptorDemo();

}

@Override

public void configure(Context context) {

}

}

}

2)编写 flume 的配置文件

flume-netstat-kafka.conf

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

#Interceptor

a1.sources.r1.interceptors = i1

#自定义拦截器全类名+$Builder

a1.sources.r1.interceptors.i1.type = com.bigdata.intercepter.FlumeKafkaInterceptorDemo$Builder

# Describe the sink

a1.sinks.k1.type = org.apache.flume.sink.kafka.KafkaSink

#默认发往的topic

a1.sinks.k1.kafka.topic = third

a1.sinks.k1.kafka.bootstrap.servers = hadoop102:9092,hadoop103:9092,hadoop104:9092

a1.sinks.k1.kafka.flumeBatchSize = 20

a1.sinks.k1.kafka.producer.acks = 1

a1.sinks.k1.kafka.producer.linger.ms = 1

# # Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

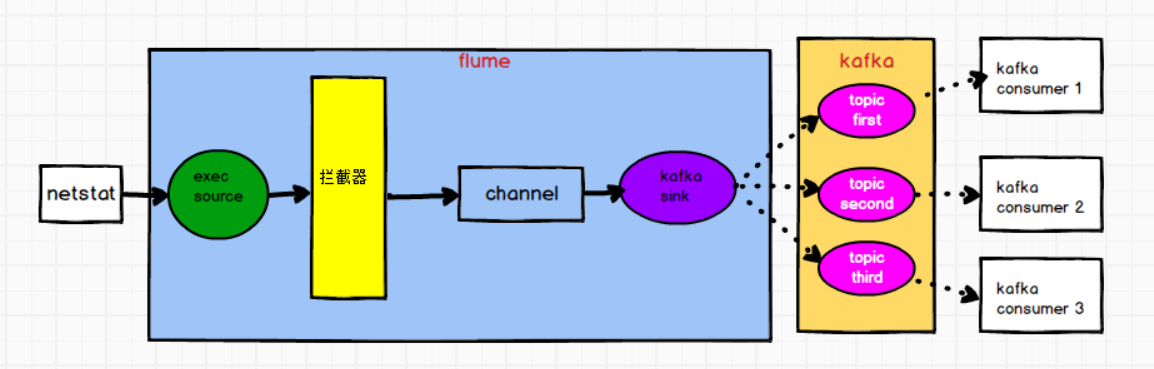

3)创建topic

在kafka中创建 first , second , third 这3个topic

[hadoop@hadoop102 kafka]$ bin/kafka-topics.sh --list --bootstrap-server hadoop102:9092

__consumer_offsets

first

second

test-demo

third

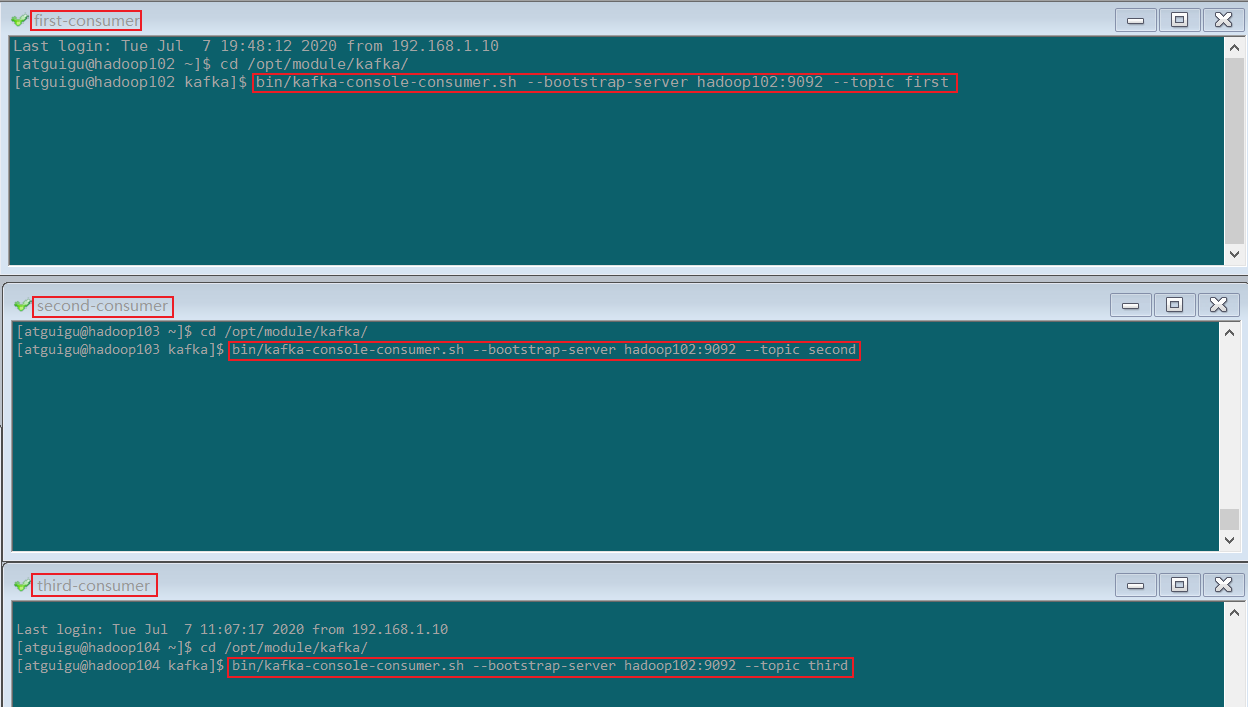

4)启动各组件

启动3个 kafka consumer 分别消费 first , second , third 中的数据

bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic first

bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic second

bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic third

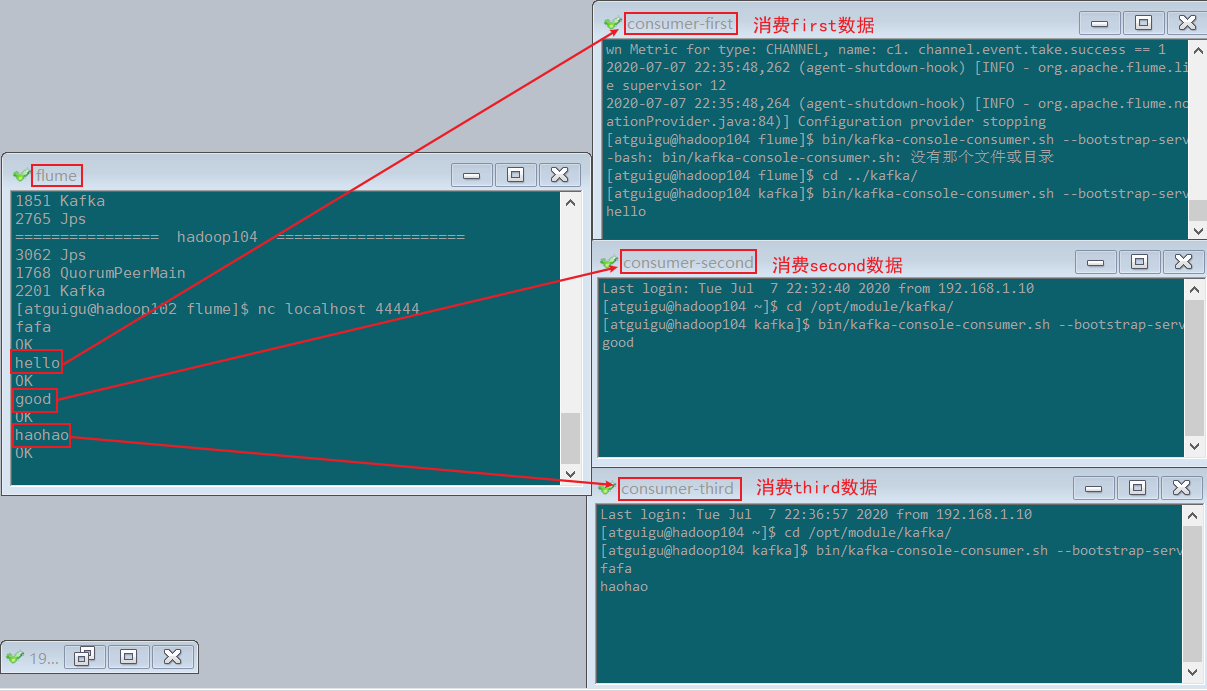

5)启动 flume,通过netstat发送数据到flume

bin/flume-ng agent -c conf/ -f job/flume-kafka/flume-netstat-kafka.conf -n a1

nc localhost 44444

6)观察消费者的消费情况

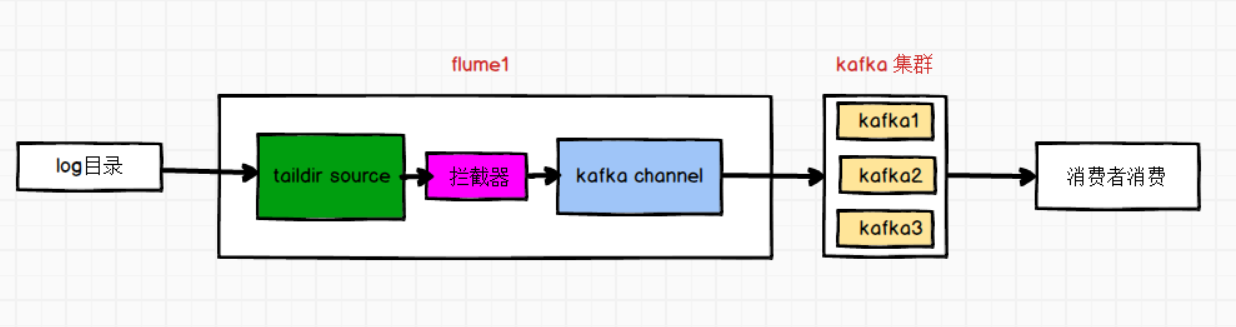

三.自定义interceptor(使用kafka channel)

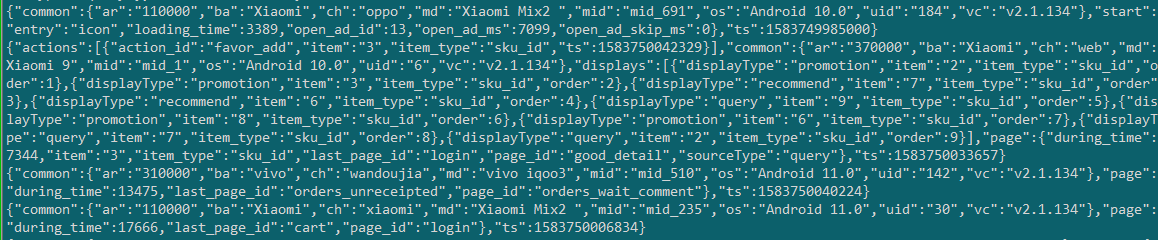

需求:使用taildir source监控/opt/module/applog/log文件夹下的文件,使用拦截器过滤非json的数据,使用kafka channel对接 kafka,将数据发往指定topic。

需求分析

使用kafka channel不需要sink

1)自定义拦截器

创建maven工程

pom文件

<dependencies>

<dependency>

<groupId>org.apache.flume</groupId>

<artifactId>flume-ng-core</artifactId>

<version>1.9.0</version>

<scope>provided</scope>

</dependency>

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>1.2.62</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<artifactId>maven-compiler-plugin</artifactId>

<version>2.3.2</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

</configuration>

</plugin>

<plugin>

<artifactId>maven-assembly-plugin</artifactId>

<configuration>

<descriptorRefs>

<descriptorRef>jar-with-dependencies</descriptorRef>

</descriptorRefs>

</configuration>

<executions>

<execution>

<id>make-assembly</id>

<phase>package</phase>

<goals>

<goal>single</goal>

</goals>

</execution>

</executions>

</plugin>

</plugins>

</build>

编写拦截器类:ETLInterceptor.java

package com.bigdata;

import com.alibaba.fastjson.JSON;

import org.apache.flume.Context;

import org.apache.flume.Event;

import org.apache.flume.interceptor.Interceptor;

import java.util.Iterator;

import java.util.List;

/**

* @description: TODO 自定义拦截器,简单的ETL清洗

* @author: HaoWu

* @create: 2020/7/10 18:14

*/

public class ETLInterceptor implements Interceptor {

@Override

public void initialize() {

}

@Override

public Event intercept(Event event) {

String s = new String(event.getBody());

try {

JSON.toJSON(s);

return event;

} catch (Exception e) {

return null;

}

}

@Override

public List<Event> intercept(List<Event> events) {

Iterator<Event> iterator = events.iterator();

while (iterator.hasNext()){

Event e = iterator.next();

if(e==null){

iterator.remove();

}

}

return events;

}

@Override

public void close() {

}

public static class Builder implements Interceptor.Builder{

@Override

public Interceptor build() {

return new ETLInterceptor();

}

@Override

public void configure(Context context) {

}

}

}

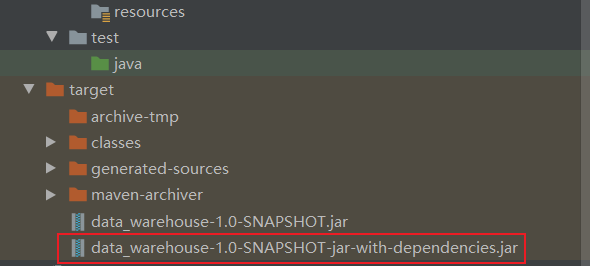

打包,将有依赖的包上传到%Flume_HOME%/lib目录下

2)flume配置

bigdata-applog-kafka.conf

#描述agent

a1.sources = r1

a1.channels = c1

#描述source

a1.sources.r1.type = TAILDIR

a1.sources.r1.positionFile = /opt/module/flume/taildir_position.json

a1.sources.r1.filegroups = f1

a1.sources.r1.filegroups.f1 = /opt/module/applog/log/app.*

#拦截器

a1.sources.r1.interceptors = i1

a1.sources.r1.interceptors.i1.type = com.bigdata.ETLInterceptor$Builder

#描述channel

a1.channels.c1.type = org.apache.flume.channel.kafka.KafkaChannel

a1.channels.c1.kafka.bootstrap.servers = hadoop102:9092,hadoop103:9092,hadoop104:9092

a1.channels.c1.kafka.topic = applog

a1.channels.c1.parseAsFlumeEvent = false

#关联source->channel->sink

a1.sources.r1.channels = c1

3)启动各组件

启动zookeeper、kafka-->启动消费者消费applog主题-->启动flume-->观察消费者

#消费者消费applog

kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic applog --from-beginning

#启动flume

bin/flume-ng agent -n a1 -c conf/ -f job/bigdata-applog-kafka.conf

consumer消费到数据

Flume对接Kafka的更多相关文章

- 基于Flume+LOG4J+Kafka的日志采集架构方案

本文将会介绍如何使用 Flume.log4j.Kafka进行规范的日志采集. Flume 基本概念 Flume是一个完善.强大的日志采集工具,关于它的配置,在网上有很多现成的例子和资料,这里仅做简单说 ...

- Flume+LOG4J+Kafka

基于Flume+LOG4J+Kafka的日志采集架构方案 本文将会介绍如何使用 Flume.log4j.Kafka进行规范的日志采集. Flume 基本概念 Flume是一个完善.强大的日志采集工具, ...

- 大数据平台架构(flume+kafka+hbase+ELK+storm+redis+mysql)

上次实现了flume+kafka+hbase+ELK:http://www.cnblogs.com/super-d2/p/5486739.html 这次我们可以加上storm: storm-0.9.5 ...

- Kafka实战-Flume到Kafka

1.概述 前面给大家介绍了整个Kafka项目的开发流程,今天给大家分享Kafka如何获取数据源,即Kafka生产数据.下面是今天要分享的目录: 数据来源 Flume到Kafka 数据源加载 预览 下面 ...

- flume+kafka+hbase+ELK

一.架构方案如下图: 二.各个组件的安装方案如下: 1).zookeeper+kafka http://www.cnblogs.com/super-d2/p/4534323.html 2)hbase ...

- flume到kafka和hbase配置

# Flume test file# Listens via Avro RPC on port 41414 and dumps data received to the logagent.channe ...

- flume从kafka中读取数据

a1.sources = r1 a1.sinks = k1 a1.channels = c1 #使用内置kafka source a1.sources.r1.type = org.apache.flu ...

- flume整合kafka

# Please paste flume.conf here. Example: # Sources, channels, and sinks are defined per # agent name ...

- spark streaming 对接kafka记录

spark streaming 对接kafka 有两种方式: 参考: http://group.jobbole.com/15559/ http://blog.csdn.net/kwu_ganymede ...

随机推荐

- 转移指令原理和Inline Hook

目录 转移指令原理和Inline Hook 转移指令 操作符offset jmp指令 根据位移进行转移的jmp指令 插播HOOK知识 Inline Hook Inline Hook 原理 Hook代码 ...

- XOR算法

原理 依据的是异或门 即同为0,异为1 0^0=0 0^1=1 1^0=1 1^1=0 对一个数据进行两次XOR运算会得到这个数据本身 所以加密时就将message和其对应的key进行一波XOR运算得 ...

- C++中gSOAP的使用

目录 SOAP简介 gSOAP 准备工作 头文件 构建客户端应用程序 生成soap源码 建立客户端项目 构建服务端应用程序 生成SOAP源码 建立服务端项目 打印报文 SOAP测试 项目源码 本文主要 ...

- Open vSwitch 应用实践

基础配置以及要点: 1.交换机创建和端口的配置 1) 创建一个新的 OVS 交换机[格式:$ ovs-vsctl add-br [名称]] $ovs-vsctl add-br ovs-switch 2 ...

- 升级JDK8的坎坷之路

为更好的适应JAVA技术的发展,使用更先进及前沿的技术.所以推出将我们现在使用的JDK1.6(1.7)及tomcat6(7)升级至JDK1.8及tomcat8,使我们的系统获得更好的性能,更好适应未来 ...

- css 马赛克悬停效果

css 马赛克悬停效果 <!DOCTYPE html> <html lang="en"> <head> <meta charset=

- 输入指令npx webpack-dev-server报错:Error: Cannot find module ‘webpack-cli/bin/config-yargs‘的解决方法

输入指令npx webpack-dev-server报错:Error: Cannot find module 'webpack-cli/bin/config-yargs'的解决方法 输入指令:npx ...

- 解决IE6,边框问题

IE6是一个让人蛋疼而又无奈的浏览器,这次不经意间发现了一个BUG的解决发放,给大家分享一下 直接中部代码<input type="text" value="&qu ...

- Django笔记&教程 5-1 基础增删查改

Django 自学笔记兼学习教程第5章第1节--基础增删查改 点击查看教程总目录 第四章介绍了模型类models.Model和创建模型,相当于介绍了数据库表和如何创建数据库表. 这一章将介绍如何使用模 ...

- Zabbix错误”zbx_mem_malloc(): out of memory”解决方法

Zabbix Server突然挂了,查看log报错如下: using configuration file: /etc/zabbix/zabbix_server.conf ... [file:dbco ...