Hadoop完全分布式集群环境搭建

1. 在Apache官网下载Hadoop

下载地址:http://hadoop.apache.org/releases.html

选择对应版本的二进制文件进行下载

2.解压配置

以hadoop-2.6.5.tar.gz为例

解压文件

tar -zxvf hadoop-2.6.5.tar.gz

移动到/opt 目录下

mv hadoop-2.6.5 /opt

配置JDK环境变量

追加Hadoop的bin和sbin目录到环境变量PATH中,这里不多讲。

使用 source命令使配置立即生效

例如:source /etc/profile

配置四个配置文件core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml

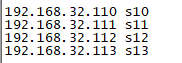

本例共四个主机,分别是s10,s11,s12,s13

s10:名称结点

s11、s12:数据结点

s13:辅助名称结点

/etc/hosts 文件配置主机映射如下:

core-site.xml 配置

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://s10:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop-2.6.5/tmp</value>

</property>

</configuration>

hdfs-site.xml 配置

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>s13:50090</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/opt/hadoop-2.6.5/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/opt/hadoop-2.6.5/hdfs/data</value>

</property>

</configuration>

mapred-site.xml 配置

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

yarn-site.xml 配置

<?xml version="1.0"?> <configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>s10</value>

</property>

</configuration>

修改 slaves 文件内容为对应的数据结点

s11

s12

为了保险,此处直接配置JAVA_HOME到 /opt/hadoop-2.6.5/etc/hadoop/hadoop-env.sh 中,防止出现JAVA_HOME is not set and could not be found.错误

hadoop-env.sh文件第一行有效代码(不包含注释)改为

export JAVA_HOME=/usr/soft/jdk1.8.0_181

3. 配置四台主机 ssh 无密码相互访问,复制配置好的 /opt/hadoop-2.6.5 到其它三台主机

快速配置四台主机ssh无密码访问方法如下:

①在四台主机上分别执行 ssh-keygen -t rsa 生成公钥和私钥

②把四台主机的公钥分别追加到s0主机~/.ssh/authorized_keys 文件中

③远程复制 authorized_keys 文件到其它三台主机

更多细节请参考:https://www.cnblogs.com/jonban/p/sshNoPasswordAccess.html

配置完成后使用 ssh 命令在每一台主机上手动登录一下其它三台主机,完成第一次访问的确认,以后就可以直接登录了

远程复制配置好的 /opt/hadoop-2.6.5 到其它三台主机,记得配置JDK环境变量和Hadoop环境变量,参考第2步

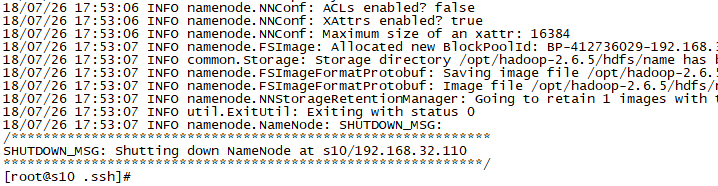

4. 格式化文件系统为hdfs

hadoop namenode -format

运行结果如下:

5. 启动Hadoop集群环境

start-dfs.sh

start-yarn.sh

在四台主机上分别输入 jps 命令,查看集群状态,内容如下:

[root@s10 hadoop]# jps

28417 Jps

28163 ResourceManager

27907 NameNode

[root@s11 hadoop]# jps

27083 Jps

26875 DataNode

26972 NodeManager

[root@s12 hadoop]# jps

27095 Jps

26887 DataNode

26984 NodeManager

[root@s13 hadoop]# jps

26882 Jps

26826 SecondaryNameNode

符合集群预期结果

s10:名称结点

s11、s12:数据结点

s13:辅助名称结点

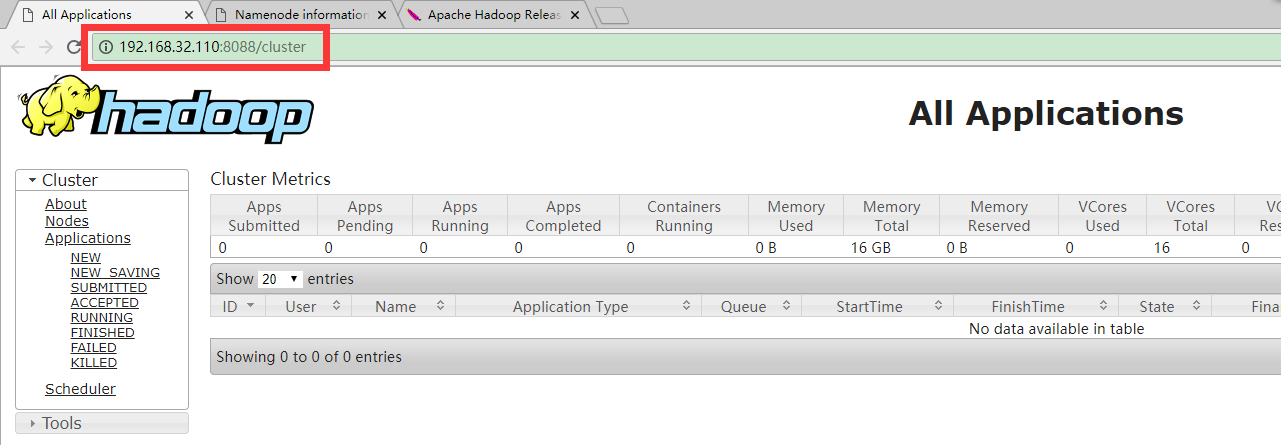

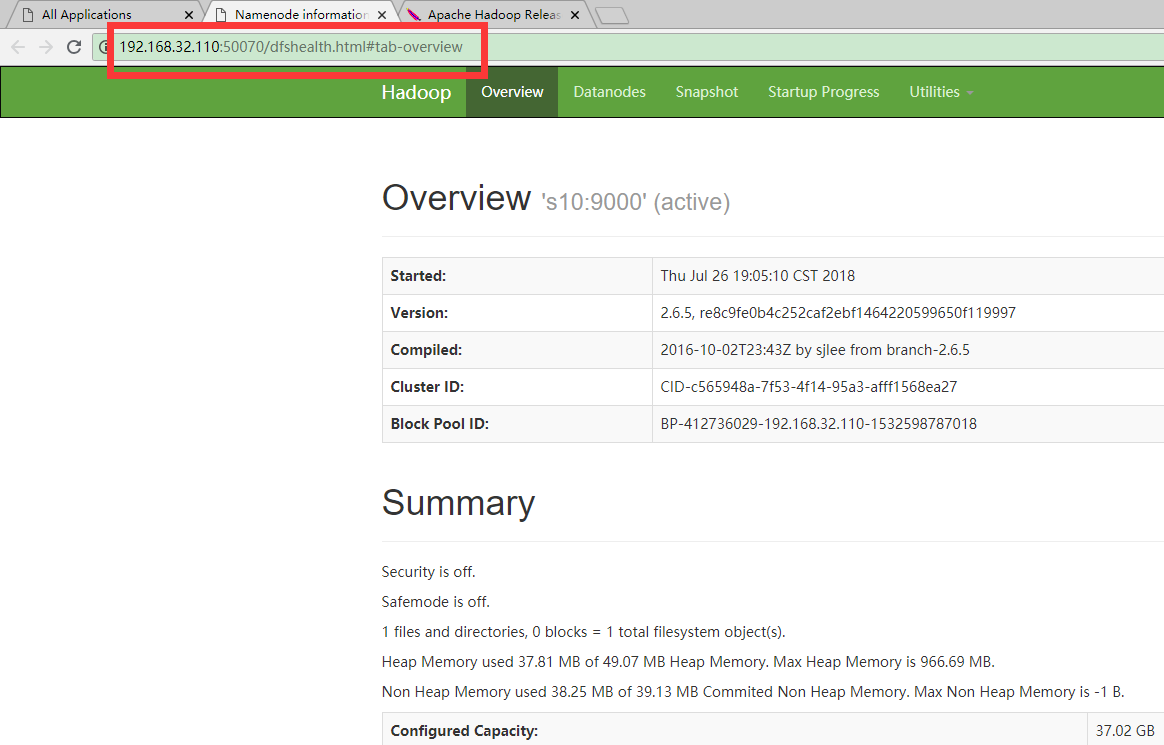

6.验证

浏览器输入地址:

http://192.168.32.110:8088

http://192.168.32.110:50070

这里的IP是主机s10的IP

效果截图如下,地址自动跳转

Hadoop完全分布式集群环境搭建

.

Hadoop完全分布式集群环境搭建的更多相关文章

- Hadoop伪分布式集群环境搭建

本教程讲述在单机环境下搭建Hadoop伪分布式集群环境,帮助初学者方便学习Hadoop相关知识. 首先安装Hadoop之前需要准备安装环境. 安装Centos6.5(64位).(操作系统再次不做过多描 ...

- 阿里云ECS服务器部署HADOOP集群(一):Hadoop完全分布式集群环境搭建

准备: 两台配置CentOS 7.3的阿里云ECS服务器: hadoop-2.7.3.tar.gz安装包: jdk-8u77-linux-x64.tar.gz安装包: hostname及IP的配置: ...

- Spark 1.6.1分布式集群环境搭建

一.软件准备 scala-2.11.8.tgz spark-1.6.1-bin-hadoop2.6.tgz 二.Scala 安装 1.master 机器 (1)下载 scala-2.11.8.tgz, ...

- hadoop完全分布式集群的搭建

集群配置: jdk1.8.0_161 hadoop-2.6.1 linux系统环境:Centos6.5 创建普通用户 dummy 准备三台虚拟机master,slave01,slave02 hado ...

- ZooKeeper 完全分布式集群环境搭建

1. 搭建前准备 示例共三台主机,主机IP映射信息如下: 192.168.32.101 s1 192.168.32.102 s2 192.168.32.103 s3 2.下载ZooKeeper, 以 ...

- Kafka 完全分布式集群环境搭建

思路: 先在主机s1上安装配置,然后远程复制到其它两台主机s2.s3上, 并分别修改配置文件server.properties中的broker.id属性. 1. 搭建前准备 示例共三台主机,主机IP映 ...

- hadoop伪分布式集群的搭建

集群配置: jdk1.8.0_161 hadoop-2.6.1 linux系统环境:Centos6.5 创建普通用户 dummy 设置静态IP地址 Hadoop伪分布式集群搭建: 为普通用户添加su ...

- hadoop学习笔记(五)hadoop伪分布式集群的搭建

本文原创,如需转载,请注明作者和原文链接 1.集群搭建的前期准备 见 搭建分布式hadoop环境的前期准备---需要检查的几个点 2.解压tar.gz包 [root@node01 ~]# ...

- Hadoop学习(一):完全分布式集群环境搭建

1. 设置免密登录 (1) 新建普通用户hadoop:useradd hadoop(2) 在主节点master上生成密钥对,执行命令ssh-keygen -t rsa便会在home文件夹下生成 .ss ...

随机推荐

- Fiddler 基础教程详解

Fiddler是最强大最好用的Web调试工具之一,它能记录所有客户端和服务器的http和https请求,允许你监视,设置断点,甚至修改输入输出数据. 使用Fiddler无论对开发还是测试来说,都有很大 ...

- 外企面试,哪有你想象的那么难!(已收埃森哲、NTTDATA等8家外企offer)

无精疯,一名背包客,大学期间穷游了十余个国家,五十余座城市,也是一位拥有健身教练证的业余健身痴迷者.从大二开始自学Java并开始了第一份实习,后面也是通过自学转到了大数据,之前在一家大数据独角兽实习, ...

- 译——meta viewport

此文翻译PPK大神的——meta viewport. 主要讲到了第三种viewport——ideal viewport,以及使用meta viewport 设置移动浏览器的视口. the meta v ...

- 如何使用JMETER从JSON响应中提取数据

如果你在这里,可能是因为你需要使用JMeter从Json响应中提取变量. 好消息!您正在掌握掌握JMeter Json Extractor的权威指南.作为Rest API测试指南的补充,您将学习掌握J ...

- LeetCode初级算法(数组)解答

这里记录了LeetCode初级算法中数组的一些题目: 加一 本来想先转成整数,加1后再转回去:耽美想到测试的例子考虑到了这个方法的笨重,所以int类型超了最大范围65536,导致程序出错. class ...

- springMvc json 参数

以前,一直以为在SpringMVC环境中,@RequestBody接收的是一个Json对象,一直在调试代码都没有成功,后来发现,其实 @RequestBody接收的是一个Json对象的字符串,而不是一 ...

- 【手撸一个ORM】第七步、SqlDataReader转实体

说明 使用Expression(表达式目录树)转Entity的文章在园子里有很多,思路也大致也一样,我在前面有篇文章对解决思路有些说明,有兴趣的小伙伴可以看下 (传送门),刚接触表达式目录树时写的,不 ...

- (转)linux内核参数注释与优化

linux内核参数注释与优化 原文:http://blog.51cto.com/yangrong/1321594 http://oldboy.blog.51.cto.com/2561410/13364 ...

- ${openid_wx} el解析式放入url的“”里才起作用。

window.location.href="${ctx }/wx/reservation/content?shopid="+shopid+"&&openi ...

- 【Lua】Lua中ipair和pair的区别

pairs会遍历table的所有键值对. 而ipairs就是固定地从key值1开始,下次key累加1进行遍历,如果key对应的value不存在,就停止遍历.顺便说下,记忆也很简单,带i的就是根据int ...