Fasttext原理

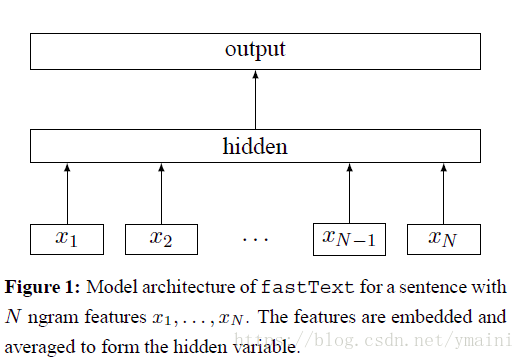

fastText 模型输入一个词的序列(一段文本或者一句话),输出这个词序列属于不同类别的概率。

序列中的词和词组组成特征向量,特征向量通过线性变换映射到中间层,中间层再映射到标签。

fastText 在预测标签时使用了非线性激活函数,但在中间层不使用非线性激活函数。

fastText 模型架构和 Word2Vec 中的 CBOW 模型很类似。不同之处在于,fastText 预测标签,而 CBOW 模型预测中间词。

fasttext结构

xi

- $X_i$: 一个句子的特征,初始值为随机生成(也可以采用预训练的词向量)

- hidden:$X_i$的平均值 x

- output: 样本标签

目标函数

N:样本个数

$y_n$:第n个样本对应的类别

f:损失函数softmaxt

$x_n$:第n个样本的归一化特征

A:权重矩阵(构建词,embedding)

B:权重举证(隐层到输出层)

词向量初始化

一个句子的embedding为[$iw_1,iw_2,....iw_n,ow_1,ow_2,...ow_s$]

$iw_i$:语料中出现的词,排在数组的前面

$ow_i$:n-gram或n-char特征

初始化为随机数, 如果提供预训练的词向量,对应的词采用预训练的词向量

hierarchical Softmax

当语料类别较多时,使用hierarchical Softmax(hs)减轻计算量

hs利用Huffman 树实现,词(生成词向量)或label(分类问题)作为叶子节点

根据词或label的count构建Huffman 树,则叶子到root一定存在一条路径

利用逻辑回归二分类计算loss

n-gram和n-char

asttext方法不同与word2vec方法,引入了两类特征并进行embedding。其中n-gram颗粒度是词与词之间,n-char是单个词之间。两类特征的存储均通过计算hash值的方法实现。

n-gram

示例: who am I? n-gram设置为2

n-gram特征有,who, who am, am, am I, I

n-char

示例: where, n=3, 设置起止符<, >

n-char特征有,<wh, whe, her, ere, er>

FastText词向量与word2vec对比

FastText= word2vec中 cbow + h-softmax的灵活使用

模型的输出层:word2vec的输出层,对应的是每一个term,计算某term的概率最大;而fasttext的输出层对应的是

分类的label。不过不管输出层对应的是什么内容,起对应的vector都不会被保留和使用;

模型的输入层:word2vec的输入层,是 context window 内的term;而fasttext 对应的整个sentence的内容,包括term,也包括 n-gram的内容;

两者本质的不同,体现在 h-softmax的使用。

Word2vec的目的是得到词向量,该词向量 最终是在输入层得到,输出层对应的 h-softmax 也会生成一系列的向量,但最终都被抛弃,不会使用。

fasttext则充分利用了h-softmax的分类功能,遍历分类树的所有叶节点,找到概率最大的label(一个或者N个)。

Fasttext原理的更多相关文章

- 转:fastText原理及实践(达观数据王江)

http://www.52nlp.cn/fasttext 1条回复 本文首先会介绍一些预备知识,比如softmax.ngram等,然后简单介绍word2vec原理,之后来讲解fastText的原理,并 ...

- FastText算法原理解析

1. 前言 自然语言处理(NLP)是机器学习,人工智能中的一个重要领域.文本表达是 NLP中的基础技术,文本分类则是 NLP 的重要应用.fasttext是facebook开源的一个词向量与文本分类工 ...

- 超快的 FastText

Word2Vec 作者.脸书科学家 Mikolov 文本分类新作 fastText:方法简单,号称并不需要深度学习那样几小时或者几天的训练时间,在普通 CPU 上最快几十秒就可以训练模型,得到不错的结 ...

- [转] fastText

mark- from : https://www.jiqizhixin.com/articles/2018-06-05-3 fastText的起源 fastText是FAIR(Facebook AIR ...

- 模型介绍之FastText

模型介绍一: 1. FastText原理及实践 前言----来源&特点 fastText是Facebook于2016年开源的一个词向量计算和文本分类工具,在学术上并没有太大创新.但是它的优点也 ...

- FastText算法

转载自: https://www.cnblogs.com/huangyc/p/9768872.html 0. 目录 1. 前言 2. FastText原理 2.1 模型架构 2.2 层次SoftMax ...

- NLP系列文章:子词嵌入(fastText)的理解!(附代码)

1. 什么是fastText 英语单词通常有其内部结构和形成⽅式.例如,我们可以从"dog""dogs"和"dogcatcher"的字⾯上推 ...

- 层次softmax函数(hierarchical softmax)

一.h-softmax 在面对label众多的分类问题时,fastText设计了一种hierarchical softmax函数.使其具有以下优势: (1)适合大型数据+高效的训练速度:能够训练模型“ ...

- Task6.神经网络基础

BP: 正向计算loss,反向传播梯度. 计算梯度时,从输出端开始,前一层的梯度等于activation' *(与之相连的后一层的神经元梯度乘上权重的和). import torch from tor ...

随机推荐

- C#实现基于ffmpeg加虹软的人脸识别demo及开发分享

对开发库的C#封装,屏蔽使用细节,可以快速安全的调用人脸识别相关API.具体见github地址.新增对.NET Core的支持,在Linux(Ubuntu下)测试通过.具体的使用例子和Demo详解,参 ...

- MySQL 8.0.12 基于Windows 安装教程(超级详细)

MySQL 8.0.12 基于Windows 安装教程(超级详细) (一步一步来,装不了你找我!) 本教程仅适用Windows系统,如果你原本装了没装上,一定要先删除原本的数据库,执行:mysqld ...

- springboot缓存注解——@CachePut

@CachePut:既调用方法,又更新缓存数据:修改了数据库的某个数据,同时又更新缓存 运行时机: 先调用目标方法 将目标方法的结果缓存起来 注意: @Cacheable的key不能用#result来 ...

- Disable access to Windows Update

Disable access to Windows Update If this policy setting is enabled, all Windows Update features are ...

- Python中怎么读写文件

python中对文件的操作大概分为三步:打开文件.操作文件(读.写.追加写入).关闭文件. 1.无论对文件做哪种操作,操作前首先要保证文件被打开了,即需要一个打开的操作. 例:open(XXX.txt ...

- C++ for循环语句

#include "pch.h" #include<iostream> using namespace std; int main() { int i = 1, sum ...

- mysql 查询正在执行的进程-亲试ok

命令:show processlist 每一列的含义和用途: 第一列 id,不用说了吧,一个标识,你要kill一个语句的时候很有用. 第二列 user列,显示单前用户,如果不是root,这个命令就只显 ...

- Mongoose 'static' methods vs. 'instance' methods

statics are the methods defined on the Model. methods are defined on the document (instance). We may ...

- c# Winform Chart入门

额外参考链接:http://www.cnblogs.com/greenerycn/archive/2008/10/27/microsoft-chart.html winform 仪表盘相关下载链接:/ ...

- TCP协议,UDP,以及TCP通信服务器的文件传输

TCP通信过程 下图是一次TCP通讯的时序图.TCP连接建立断开.包含大家熟知的三次握手和四次握手. 在这个例子中,首先客户端主动发起连接.发送请求,然后服务器端响应请求,然后客户端主动关闭连接.两条 ...