爬取图片过程遇到的ValueError: Missing scheme in request url: h 报错与解决方法

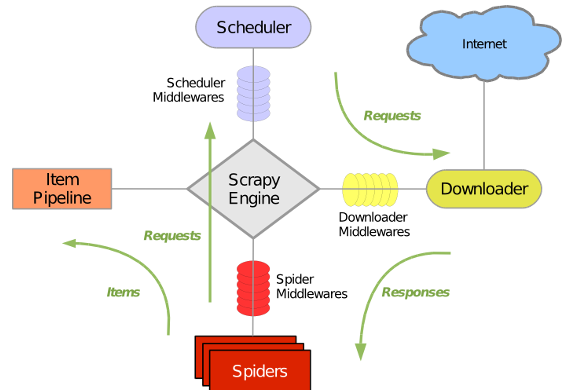

一 、scrapy整体框架

1.1 scrapy框架图

1.2 scrapy框架各结构解析

item:保存抓取的内容

spider:定义抓取内容的规则,也是我们主要编辑的文件

pipelines:管道作用,用来定义如何过滤、存储等功能(比如导出到csv或者mysql等功能)

settings:配置例如ITEM_PIPELINES 、图片存储位置等等功能

middlewares:下载器中间件是在引擎及下载器之间的特定钩子(specific hook),处理Downloader传递给引擎的response

1.3 数据流过程

从start_urls 开始,Scheduler 会将其交给 Downloader 进行下载,下载之后会交给 Spider 进行分析,Spider 分析出来的结果有两种:一种是需要进一步抓取的链接,例如之前分析的“下一页”的链接,这些东西会被传回 Scheduler ;另一种是需要保存的数据,它们则被送到 Item Pipeline 那里,那是对数据进行后期处理(详细分析、过滤、存储等)的地方。另外,在数据流动的通道里还可以安装各种中间件,进行必要的处理。

二、 爬取图片过程

2.1 整体介绍

2.1.1 环境

Anocondas+python3.6

2.1.2 创建工程

1、创建hupu这个工程

E:\pgtool>scrapy startproject hupu

2、创建相应的spiders

E:\pgtool>cd hupu##必须是进入到创建的项目中去建spiders

E:\pgtool\hupu>scrapy genspider hp hupu.com ##hp=>生成hp.py ,爬虫名称为hp.py,允许访问的域名为hupu.com

通过爬取http://photo.hupu.com/nba/p35923-1.html网页中一个系列的图片

2.2 配置各组件

2.2.1 item.py

import scrapy class HupuItem(scrapy.Item):

# define the fields for your item here like:

hupu_pic = scrapy.Field()

# images = scrapy.Field()

image_paths = scrapy.Field()

2.2.2 settings.py

BOT_NAME = 'hupu' SPIDER_MODULES = ['hupu.spiders']

NEWSPIDER_MODULE = 'hupu.spiders'

# Obey robots.txt rules

ROBOTSTXT_OBEY = False

ITEM_PIPELINES = {

'hupu.pipelines.HupuImgDownloadPipeline': 300,

}

IMAGES_URLS_FIELD = "hupu_pic" # 对应item里面设定的字段,取到图片的url

#IMAGES_RESULT_FIELD = "image_path"

IMAGES_STORE = 'E:/hupu'

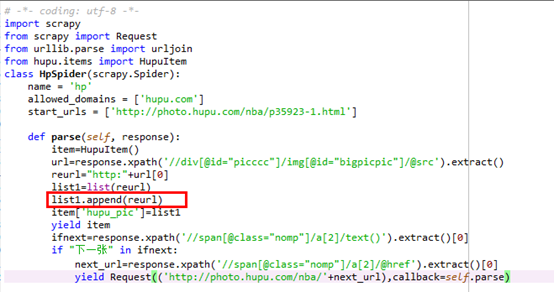

2.2.3 hp.py

# -*- coding: utf-8 -*-

import scrapy

from scrapy import Request

from urllib.parse import urljoin

from hupu.items import HupuItem

class HpSpider(scrapy.Spider):

name = 'hp'

allowed_domains = ['hupu.com']

start_urls = ['http://photo.hupu.com/nba/p35923-1.html'] def parse(self, response):

item=HupuItem()

url=response.xpath('//div[@id="picccc"]/img[@id="bigpicpic"]/@src').extract() reurl="http:"+url[0]

print ('links is :--','\n',reurl)

list1=[]

list1.append(reurl)

item['hupu_pic']=list1

yield item

ifnext=response.xpath('//span[@class="nomp"]/a[2]/text()').extract()[0]

if "下一张" in ifnext:

next_url=response.xpath('//span[@class="nomp"]/a[2]/@href').extract()[0]

yield Request(('http://photo.hupu.com/nba/'+next_url),callback=self.parse)

2.2.4 pipelines.py

from scrapy.pipelines.images import ImagesPipeline

from scrapy import Request

class HupuPipeline(object):

def process_item(self, item, spider):

return item

class HupuImgDownloadPipeline(ImagesPipeline): def get_media_requests(self, item, info):

for image_url in item['hupu_pic']:

yield Request(image_url)

三、 爬虫执行与结果

3.1 执行过程

进入到工程路径下 scrapy crawl hp

(base) E:\pgtool\Files\hupu>scrapy crawl hp

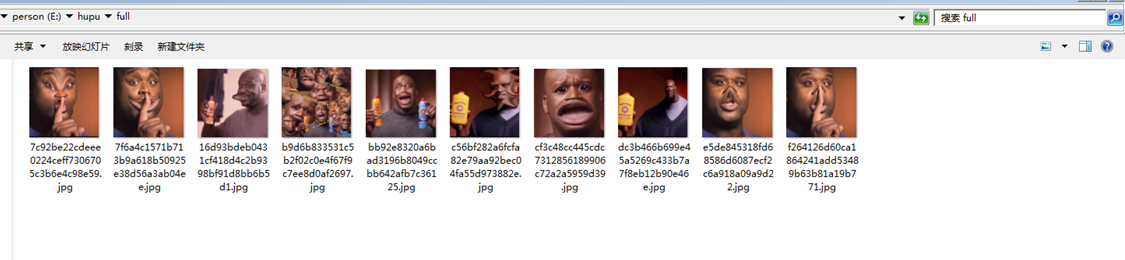

3.2 获得结果

四、遇到的问题与分析解决

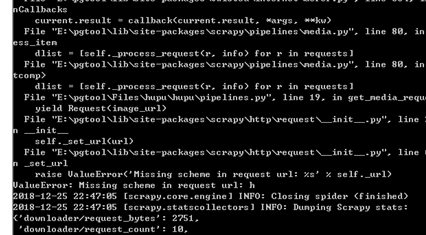

4.1 问题出现

最开始遇到ValueError: Missing scheme in request url: h 这种报错,如下图

4.2 问题解析

如果单纯获取文本,那么只需start_urls是一个list;而如果获取图片,则必须start_urls与item中存储图片路径字段这两者必须都是 list。

4.3 解决方案

未修改前的spiders:

修改后spiders

五、总结

scrapy框架简单容易理解,而且支持异步多线程,是一个比较上手的爬虫框架。本次爬虫犯了一个低级错误,在于直接将图片链接转换为list而不经意间将链接拆分为一个一个的元素,如下示例:

str1='baidu.com'

list1=list(str1)

list1的结果实际为['b','a','i','d','u','.','c','o','m'],这也就是为什么一直报错Missing scheme in request url: h(翻译为:请求URL中的丢失整体链接:在h开始的位置)所以需要我们将整个链接放在只有一个元素的list中,使用修改后list.append()将一个链接完整的放置在list[0]中。

有问题的小伙伴们可以留言讨论交流,转载请注明出处,谢谢。

爬取图片过程遇到的ValueError: Missing scheme in request url: h 报错与解决方法的更多相关文章

- 运行scrapy保存图片,报错ValueError: Missing scheme in request url: h

查阅相关资料,了解到使用ImagesPipeline传入的url地址必须是一个list,而我写的是一个字符串,所以报错,所以需要修改一下传入的url格式就行了 def parse_detail(sel ...

- 持续更新scrapy的错误,ValueError: Missing scheme in request url:

只需要将 for href in response.xpath('XX').extract(): yield Request(hrefs) 修改为下面,就可以显示出来 for href in resp ...

- scrapy 错误:Missing scheme in request url: %s' % self._url

先说报错原因:使用了和start_urls同名的参数 我通过scral crawl projename -a start_urls=http:example.com来传start_urls,然后想在项 ...

- kubernetes安装过程报错及解决方法

1.your configuration file uses an old API spec: "kubeadm.k8s.io/v1alpha2". 执行kubeadm init ...

- adb+tcpdump手机抓包过程出现的报错及解决方法

tcpdump下载:https://www.androidtcpdump.com/android-tcpdump/downloads 1.夜神模拟器连接不上adb D:1手机木马取证\android- ...

- The address where a.out.debug has been loaded is missing以及No symbol "*" in current context原因与解决方法

最近,在debug core的时候,发现p 变量的时候提示“No symbol "*" in current context”,我们的代码使用-g编译的,经查有可能是下列几个原因或 ...

- PHPmailer关于Extension missing: openssl报错的解决

最近在写一个网页的时候,需要用到PHPmailer来发送邮件,按照官网上给出的demo写出一个例子,却报错Extension missing: openssl 最后发现需要修改php.ini中的配置: ...

- missing 1 required positional argument: 'on_delete'报错解决方案

最近在使用Python的Django框架开发web站点,通过models.py文件建表后,执行数据库迁移(命令行:mange.py makemigrations)时报错,下面是查看官方文档后找到的解决 ...

- jupyter notebook中出现ValueError: signal only works in main thread 报错 即 长时间in[*] 解决办法

我在jupyter notebook中新建了一个基于py3.6的kernel用来进行tensorflow学习 但是在jupyter notebook中建立该kernel时,右上角总是显示 服务正在启动 ...

随机推荐

- Android学习笔记_JNI hello world

1.需要准备的工具,eclipse,cdt(c++)插件,cygwin(unix)和 android ndk. 在cygwin的etc目录下将ndk的路径引入到profile文件中,可以在cygwin ...

- hive中使用rcfile

(1)建student & student1 表:(hive 托管)create table student(id INT, age INT, name STRING)partitioned ...

- DBF导入到Oracle数据库

今天我遇到了一个需求,是将一个DBF文件导入到Oracle库中,之前一直使用的是公司提供的迁移工具,但是不知道怎么回事今天一直报DBF文件无法访问之类的错误,尝试多次之后,一气之下弃之不用,另寻他法. ...

- 还在占用存储的进程lsof grep deleted;

查看僵尸进程 lsof grep deleted; 用于查看已经停止但还在占用存储的进程

- zepto 基础知识(1)

1.$() 的用法. 获取元素 $('div') //获取所有页面中的div元素 $('#foo') // 获取ID 为"foo"的元素 创建元素 $("<p> ...

- NPM 常见错误

找不到兼容版本 你有一个过时的npm.请更新到最新稳定的npm. 权限错误 npm ERR! code EPERM npm ERR! code EACCES 修复缓存的权限sudo chown -R ...

- 【例题收藏】◇例题·6◇ 电压机制(voltage)

◆例题·6◆ 电压机制 周六日常模拟赛……已经不知道该说什么了(感觉做不出来的都是好题) ▷ 题目 (终于不用自己翻译英文题了╮(╯-╰)╭) [问题描述] 科学家在“无限神机”(Infinity M ...

- CentOS7——网络配置

ip addr #查看当前IP地址信息.(contos7以下的为ifconfig) /etc/sysconfig/network-scripts/ifcfg-*** #***代表不一定的,需要进入该设 ...

- java 读取图片并转化为二进制字符串

本例子的目的在于测试往oracle数据库中插入blob字段 //以下代码源于:https://www.cnblogs.com/ywlx/p/4544179.html public static Str ...

- java的动态验证码单线设计

1.java的动态验证码我这里将介绍两种方法: 一:根据java本身提供的一种验证码的写法,这种呢只限于大家了解就可以了,因为java自带的模式编写的在实际开发中是没有意义的,所以只供学习一下就可以了 ...