springcloud+kafka集群

上节说了kafka在linux环境下怎么搭建集群。这节写一下怎么在springcloud中以stream流方式去做kafka集群对接。

1.yml配置

#spring Cloud kafka -- streams --

cloud:

stream:

kafka:

binder:

minPartitionCount: 3 # 分区数量,主要就是为了减轻单台服务器的压力,扩大并发量

brokers: 192.168.100.100:,192.168.100.101:,192.168.100.102: # kafka服务地址和端口

autoCreateTopics: true

autoAddPartitions: true

2.消息发送

@RestController

@RequestMapping("/kafka")

@EnableBinding(value = {WarningStreams.class})

public class kafkaTest { @Autowired

private MessageService messageService; /**

* 测试消息发送,入参就是你的topic,进行发送的时候就算kafka中没有该topic,他也会自动创建一个你传入的topic

* 这里面的Msg是我封装的一个消息对象,可以是随意的一个消息对象,字符串也可以

* @param topic

*/

@RequestMapping("/sendMsg")

public void sendMsg(String topic){

// 循环发送6次消息,分别发送在不同的分区

for (int i=; i<=; i++ ) {

Msg msg = new Msg();

msg.setData(null);

msg.setTaskId("");

msg.setMsg("测试消息发送");

msg.setMsgId(System.currentTimeMillis() + MathUtil.getFiveRandom());

msg.setSuccess("true");

msg.setCode("");

msg.setMsgType();

String result = messageService.sendControl(msg, topic);

System.out.println(result);

}

}

} messageService类:

@Service

public class MessageService {

private Logger logger = LoggerFactory.getLogger(getClass()); @Autowired

private BinderAwareChannelResolver resolver; /**

* 发送预警消息到指定topic,这里的topic是由平台编码+平台名称组成

* 若发现kafka中没有该topic,它会自动创建一个由平台编码+平台名称组成的topic

* @param warnings

* @param topic

* @return

*/

public String sendWarning(final Msg warnings, String topic) {

logger.info("Sending warnings {}", warnings); // 获取预警的topic,然后发送预警消息到kafka的topic

MessageChannel messageChannel = resolver.resolveDestination(topic);

messageChannel.send(MessageBuilder

.withPayload(warnings)

.setHeader(MessageHeaders.CONTENT_TYPE, MimeTypeUtils.APPLICATION_JSON)

.build()); return "send msg ok";

} /**

* 发送布控消息到指定topic,这里的topic是由平台编码+平台名称组成

* 若发现kafka中没有该topic,它会自动创建一个由平台编码+平台名称组成的topic

* @param msg

* @param topic

* @return

*/

public String sendControl(final Msg msg, String topic) {

logger.info("Sending controlMsg {}", JSON.toJSONString(msg));

// 获取布控的topic,然后发送布控消息到kafka的topic

MessageChannel messageChannel = resolver.resolveDestination(topic);

messageChannel.send(MessageBuilder

.withPayload(msg)

.setHeader(MessageHeaders.CONTENT_TYPE, MimeTypeUtils.APPLICATION_JSON)

.build()); return "send msg ok";

}

}

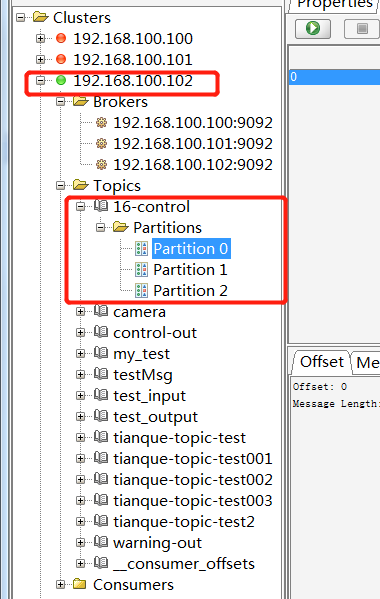

发送完毕后会在服务器中的topic下看到你传入的那个topic,并且会有三个分区,每个分区分别对应三台服务器并且每台服务器中会有两条消息,如下图:

3.消息接收

@RestController

@RequestMapping("/kafka")

@EnableBinding(value = {WarningStreams.class})

public class kafkaTest { /**

* 测试消息接收,接收对象用Object,否则收不到

* @param playLoad

*/

@StreamListener(WarningStreams.INPUT)

public void receive(Object playLoad) {

System.out.println("消息消费..result=="+ JSON.toJSONString(playLoad));

}

}

当消息被消费后,分区中的数据释放被清空,但是会保存在硬盘的log日志中。也就是在server.properties中你配置的log目录

springcloud+kafka集群的更多相关文章

- Kafka1 利用虚拟机搭建自己的Kafka集群

前言: 上周末自己学习了一下Kafka,参考网上的文章,学习过程中还是比较顺利的,遇到的一些问题最终也都解决了,现在将学习的过程记录与此,供以后自己查阅,如果能帮助到其他人,自然是更好的. ...

- kafka集群安装部署

kafka集群安装 使用的版本 系统:centos6.5 centos6.7 jdk:1.7.0_79 zookeeper:3.4.9 kafka:2.10-0.10.1.0 一.环境准备[只列,不具 ...

- ELK+Kafka集群日志分析系统

ELK+Kafka集群分析系统部署 因为是自己本地写好的word文档复制进来的.格式有些出入还望体谅.如有错误请回复.谢谢! 一. 系统介绍 2 二. 版本说明 3 三. 服务部署 3 1) JDK部 ...

- kafka集群搭建和使用Java写kafka生产者消费者

1 kafka集群搭建 1.zookeeper集群 搭建在110, 111,112 2.kafka使用3个节点110, 111,112 修改配置文件config/server.properties ...

- 搭建Kafka集群(3-broker)

Apache Kafka是一个分布式消息发布订阅系统,而Kafka环境往往是在集群中配置的.本篇就对配置3个broker的Kafka集群进行介绍. Zookeeper集群 Kafka本身提供了启动了z ...

- Kafka集群的安装和使用

Kafka是一种高吞吐量的分布式发布订阅的消息队列系统,原本开发自LinkedIn,用作LinkedIn的活动流(ActivityStream)和运营数据处理管道(Pipeline)的基础.现在它已被 ...

- Kafka【第一篇】Kafka集群搭建

Kafka初识 1.Kafka使用背景 在我们大量使用分布式数据库.分布式计算集群的时候,是否会遇到这样的一些问题: 我们想分析下用户行为(pageviews),以便我们设计出更好的广告位 我想对用户 ...

- CentOS 7部署Kafka和Kafka集群

CentOS 7部署Kafka和Kafka集群 注意事项 需要启动多个shell脚本交互客户端进行验证,运行中的客户端不要停止. 准备工作: 安装java并设置java环境变量,在`/etc/prof ...

- Kafka集群环境搭建

Kafka是一个分布式.可分区.可复制的消息系统.Kafka将消息以topic为单位进行归纳:Kafka发布消息的程序称为producer,也叫生产者:Kafka预订topics并消费消息的程序称为c ...

随机推荐

- 最新开源跳板机(堡垒机)系统 Jumpserver介绍

Jumpserver 是全球首款完全开源的堡垒机,使用 GNU GPL v2.0 开源协议,是符合 4A 的专业运维审计系统. Jumpserver 使用 Python / Django 进行开发,遵 ...

- .netcore利用DI实现订阅者模式 - xms

结合DI,实现发布者与订阅者的解耦,属于本次事务的对象主体不应定义为订阅者,因为订阅者不应与发布者产生任何关联 一.发布者订阅者模式 发布者发出一个事件主题,一个或多个订阅者接收这个事件,中间通过事件 ...

- Java操作数栈

- 与局部变量表一样,均以字长为单位的数组.不过局部变量表用的是索引,操作数栈是弹栈/压栈来访问.操作数栈可理解为java虚拟机栈中的一个用于计算的临时数据存储区.- 存储的数据与局部变量表一致含in ...

- 201871010114-李岩松《面向对象程序设计(java)》第十一周学习总结

项目 内容 这个作业属于哪个课程 https://www.cnblogs.com/nwnu-daizh/ 这个作业的要求在哪里 https://www.cnblogs.com/nwnu-daizh/p ...

- 016.Kubernetes二进制部署所有节点kube-proxy

一 部署 kube-proxy kube-proxy 运行在所有节点上,它监听 apiserver 中 service 和 endpoint 的变化情况,创建路由规则以提供服务 IP 和负载均衡功能. ...

- MyBatis批量插入模板

oracle: <insert id="insertBatch" parameterType="List"> INSERT INTO TStuden ...

- 简单的倒叙应用---倒序打印字符串(C语言)

void reverseStr(char* str){ if(*str=='\0'){ return; } reverseStr(str+1); printf("%c\n",*st ...

- nyoj 73-比大小 (Java, 高精度)

73-比大小 内存限制:64MB 时间限制:3000ms 特判: No 通过数:15 提交数:64 难度:3 题目描述: 给你两个很大的数,你能不能判断出他们两个数的大小呢? 比如1234567891 ...

- 力扣(LeetCode)验证回文串 个人题解

给定一个字符串,验证它是否是回文串,只考虑字母和数字字符,可以忽略字母的大小写. 说明:本题中,我们将空字符串定义为有效的回文串. 示例 1: 输入: "A man, a plan, a c ...

- [学习笔记] 在Eclipse中使用Hibernate,并创建第一个工程

在Eclipse中使用Hibernate 安装 Hibernate Tools 插件 https://tools.jboss.org/downloads/ Add the following URL ...