Spark MLlib线性回归代码实现及结果展示

线性回归(Linear Regression)是利用称为线性回归方程的最小平方函数对一个或多个自变量和因变量之间关系进行建模的一种回归分析。

这种函数是一个或多个称为回归系数的模型参数的线性组合。只有一个自变量的情况称为一元线性回归,大于一个自变量情况的叫做多元线性回归。

代码实现:

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.DataFrame

import org.apache.spark.ml.feature.VectorAssembler

import org.apache.spark.ml.regression.LinearRegression

/**

* Created by zhen on 2018/3/10.

*/

object LinearRegression {

def main(args: Array[String]) {

//设置环境

val spark = SparkSession.builder ().appName ("LinearRegressionTest").master ("local[2]").getOrCreate()

val sc = spark.sparkContext

val sqlContext = spark.sqlContext

//准备训练集合

val raw_data = sc.textFile("src/sparkMLlib/man.txt")

val map_data = raw_data.map{x=>

val mid = x.replaceAll(","," ,")

val split_list = mid.substring(0,mid.length-1).split(",")

for(x <- 0 until split_list.length){

if(split_list(x).trim.equals("")) split_list(x) = "0.0" else split_list(x) = split_list(x).trim

}

( split_list(1).toDouble,split_list(2).toDouble,split_list(3).toDouble,split_list(4).toDouble,

split_list(5).toDouble,split_list(6).toDouble,split_list(7).toDouble,split_list(8).toDouble,

split_list(9).toDouble,split_list(10).toDouble,split_list(11).toDouble)

}

val mid = map_data.sample(false,0.6,0)//随机取样,训练模型

val df = sqlContext.createDataFrame(mid)

val colArray = Array("c1", "c2", "c3", "c4", "c5", "c6", "c7", "c8", "c9", "c10", "c11")

val data = df.toDF("c1", "c2", "c3", "c4", "c5", "c6", "c7", "c8", "c9", "c10", "c11")

val assembler = new VectorAssembler().setInputCols(colArray).setOutputCol("features")

val vecDF = assembler.transform(data)

//准备预测集合

val map_data_for_predict = map_data

val df_for_predict = sqlContext.createDataFrame(map_data_for_predict)

val data_for_predict = df_for_predict.toDF("c1", "c2", "c3", "c4", "c5", "c6", "c7", "c8", "c9", "c10", "c11")

val colArray_for_predict = Array("c1", "c2", "c3", "c4", "c5", "c6", "c7", "c8", "c9", "c10", "c11")

val assembler_for_predict = new VectorAssembler().setInputCols(colArray_for_predict).setOutputCol("features")

val vecDF_for_predict: DataFrame = assembler_for_predict.transform(data_for_predict)

// 建立模型,进行预测

// 设置线性回归参数

val lr1 = new LinearRegression()

val lr2 = lr1.setFeaturesCol("features").setLabelCol("c5").setFitIntercept(true)

// RegParam:正则化

val lr3 = lr2.setMaxIter(10).setRegParam(0.3).setElasticNetParam(0.8)

// 将训练集合代入模型进行训练

val lrModel = lr3.fit(vecDF)

// 输出模型全部参数

lrModel.extractParamMap()

//coefficients 系数 intercept 截距

println(s"Coefficients: ${lrModel.coefficients} Intercept: ${lrModel.intercept}")

// 模型进行评价

val trainingSummary = lrModel.summary

trainingSummary.residuals.show()

println(s"均方根差: ${trainingSummary.rootMeanSquaredError}")//RMSE:均方根差

println(s"判定系数: ${trainingSummary.r2}")//r2:判定系数,也称为拟合优度,越接近1越好

val predictions = lrModel.transform(vecDF_for_predict)

val predict_result = predictions.selectExpr("features","c5", "round(prediction,1) as prediction")

predict_result.rdd.saveAsTextFile("src/sparkMLlib/manResult")

sc.stop()

}

}

性能评估:

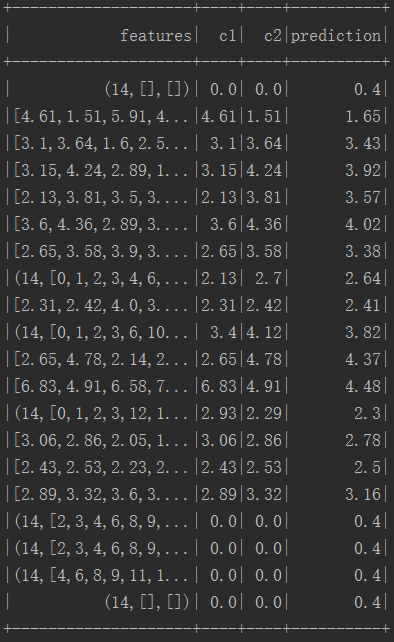

结果:

Spark MLlib线性回归代码实现及结果展示的更多相关文章

- Spark MLlib 示例代码阅读

阅读前提:有一定的机器学习基础, 本文重点面向的是应用,至于机器学习的相关复杂理论和优化理论,还是多多看论文,初学者推荐Ng的公开课 /* * Licensed to the Apache Softw ...

- Spark MLlib回归算法------线性回归、逻辑回归、SVM和ALS

Spark MLlib回归算法------线性回归.逻辑回归.SVM和ALS 1.线性回归: (1)模型的建立: 回归正则化方法(Lasso,Ridge和ElasticNet)在高维和数据集变量之间多 ...

- Spark MLlib之线性回归源代码分析

1.理论基础 线性回归(Linear Regression)问题属于监督学习(Supervised Learning)范畴,又称分类(Classification)或归纳学习(Inductive Le ...

- Spark mllib 随机森林算法的简单应用(附代码)

此前用自己实现的随机森林算法,应用在titanic生还者预测的数据集上.事实上,有很多开源的算法包供我们使用.无论是本地的机器学习算法包sklearn 还是分布式的spark mllib,都是非常不错 ...

- Spark Mllib里如何生成KMeans的训练样本数据、生成线性回归的训练样本数据、生成逻辑回归的训练样本数据和其他数据生成

不多说,直接上干货! 具体,见 Spark Mllib机器学习(算法.源码及实战详解)的第2章 Spark数据操作

- Spark入门实战系列--8.Spark MLlib(上)--机器学习及SparkMLlib简介

[注]该系列文章以及使用到安装包/测试数据 可以在<倾情大奉送--Spark入门实战系列>获取 .机器学习概念 1.1 机器学习的定义 在维基百科上对机器学习提出以下几种定义: l“机器学 ...

- Spark MLlib 机器学习

本章导读 机器学习(machine learning, ML)是一门涉及概率论.统计学.逼近论.凸分析.算法复杂度理论等多领域的交叉学科.ML专注于研究计算机模拟或实现人类的学习行为,以获取新知识.新 ...

- 《Spark MLlib机器学习实践》内容简介、目录

http://product.dangdang.com/23829918.html Spark作为新兴的.应用范围最为广泛的大数据处理开源框架引起了广泛的关注,它吸引了大量程序设计和开发人员进行相 ...

- Spark入门实战系列--8.Spark MLlib(下)--机器学习库SparkMLlib实战

[注]该系列文章以及使用到安装包/测试数据 可以在<倾情大奉送--Spark入门实战系列>获取 .MLlib实例 1.1 聚类实例 1.1.1 算法说明 聚类(Cluster analys ...

随机推荐

- RabbitMQ访问控制

Access Control (Authentication, Authorisation) in RabbitMQ 认证和授权这两个概念经常容易被混淆,甚至被互换使用.在RabbitMQ中这是错的, ...

- python自动化工具之pywinauto(一个实例)结合pyuserinput

以下是pywinauto使用指南.这个窗口句柄可以在Spy++中查看 (Microsoft Spy++(查看窗口句柄) 10.00.30319 官方最新绿色版) python自动化工具之pywinau ...

- Spring 依赖注入方式详解(四)

IoC 简介 平常的Java开发中,程序员在某个类中需要依赖其它类的方法. 通常是new一个依赖类再调用类实例的方法,这种开发存在的问题是new的类实例不好统一管理. Spring提出了依赖注入的思想 ...

- 上传文件报错--Unable to find 'struts.multipart.saveDir' property setting.

struts2 上传文件时,有时候会报这个错误. Unable to find 'struts.multipart.saveDir' property setting. Defaulting to j ...

- 使用 trash 避免 rm -rf 悲剧

昨晚做了一个令人痛心疾首的操作,rm -rf something,把我个人电脑里的重要文件夹给删掉了,懵逼了半天才缓过来.还好是个人文件,不对公司造成影响.这件事也让我意识到 rm -rf 确实是个高 ...

- Spring Boot 简介

作者其他Spring系列文章 Spring Framework简介 Spring框架快速入门 Spring Boot愿景 Spring Boot愿景就是让我们创建可运行的.独立的.基于Spring的 ...

- ubuntu搭建nodejs生产环境——快速部署手册

为什么不用CentOS而用Ubuntu作为生产环境的运行平台?这个我也比较好奇,公司订的只能沿用传统,从使用成本的角度来说,此举也是值得肯定的. 测试环境 腾讯云 Ubuntu 16.04 阿里云 U ...

- Go处理json数据

json数据格式 参见json数据格式说明. 如果没操作过json数据,建议先看下上面的文章,有助于理解本文后面的内容. Go json包 Marshal():Go数据对象 -> json数据 ...

- 使用meterpreter让没有安装python解释器的肉鸡设备执行任意python程序

目标设备不需安装python解释器就能让其执行python程序 # 需要在与目标meterpreter的session中加载python模块 meterpreter > load python ...

- RDD内存迭代原理(Resilient Distributed Datasets)---弹性分布式数据集

Spark的核心RDD Resilient Distributed Datasets(弹性分布式数据集) Spark运行原理与RDD理论 Spark与MapReduce对比,MapReduce的计 ...