机器学习4- 多元线性回归+Python实现

1 多元线性回归

更一般的情况,数据集 \(D\) 的样本由 \(d\) 个属性描述,此时我们试图学得

\]

称为多元线性回归(multivariate linear regression)或多变量线性回归。

类似的,使用最小二乘法估计 \(\boldsymbol{w}\) 和 \(b\)。

由 \(f(\boldsymbol{x}_i) = \boldsymbol{w}^T\boldsymbol{x}_i+b\) 知:

f(\boldsymbol{x}_2) = w_1x_{21} + w_2x_{22} + ... + w_dx_{2d} + b \\

... ... \\

f(\boldsymbol{x}_m) = w_1x_{m1} + w_2x_{m2} + ... + w_dx_{md} + b \\

\]

我们记

\]

x_{11} & x_{12} & \cdots & x_{1d} & 1 \\

x_{21} & x_{22} & \cdots & x_{2d} & 1 \\

\vdots & \vdots & \ddots & \vdots & \vdots \\

x_{m1} & x_{m2} & \cdots & x_{md} & 1

\end{pmatrix}

=\begin{pmatrix}

\boldsymbol{x}_1^T & 1 \\

\boldsymbol{x}_2^T & 1 \\

\vdots & \vdots \\

\boldsymbol{x}_m^T & 1

\end{pmatrix}

\]

\]

可得:

\]

类似于前篇博客的式子 (2.3) 有:

\tag{1.2}

\]

令 \(E_{\hat{\boldsymbol{w}}} = (\boldsymbol{y}-\boldsymbol{X}\hat{\boldsymbol{w}})^T(\boldsymbol{y}-\boldsymbol{X}\hat{\boldsymbol{w}})\),对 \(\hat{\boldsymbol{w}}\) 求导得:

\tag{1.3}

\]

令上式为零,得到 \(\hat{\boldsymbol{w}}\) 最优解的闭式解。

当 \(\boldsymbol{X}^T\boldsymbol{X}\) 为满秩矩阵(full-rank matrix)或正定矩阵(positive define matrix)时,令式 (1.2) 为零可得:

\]

令 \(\hat{\boldsymbol{x}_i} = (\boldsymbol{x}_i, 1)\) 得到最终学得的多元线性回归模型为:

\]

当 \(\boldsymbol{X}^T\boldsymbol{X}\) 不是满秩矩阵时,可解出多个 \(\hat{\boldsymbol{w}}\) 使得均方误差最小。选择哪个解输出取决于学习算法的归纳偏好。常用做法是引入正则化(regularization)项。

2 多元线性回归的Python实现

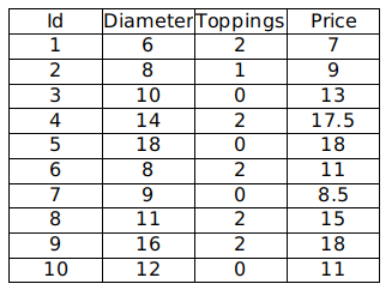

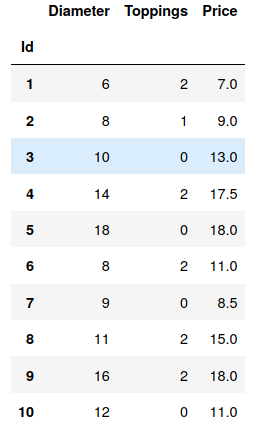

现有如下数据,我们希望通过分析披萨的直径、辅料数量与价格的线性关系,来预测披萨的价格:

2.1 手动实现

2.1.1 导入必要模块

import numpy as np

import pandas as pd

2.1.2 加载数据

pizza = pd.read_csv("pizza_multi.csv", index_col='Id')

pizza

2.1.3 计算系数

由公式

\]

可计算出 \(\hat{\boldsymbol{w}}^*\) 的值。

我们将后 5 行数据作为测试集,其他为测试集:

X = pizza.iloc[:-5, :2].values

y = pizza.iloc[:-5, 2].values.reshape((-1, 1))

print(X)

print(y)

[[ 6 2]

[ 8 1]

[10 0]

[14 2]

[18 0]]

[[ 7. ]

[ 9. ]

[13. ]

[17.5]

[18. ]]

ones = np.ones(X.shape[0]).reshape(-1,1)

X = np.hstack((X,ones))

X

array([[ 6., 2., 1.],

[ 8., 1., 1.],

[10., 0., 1.],

[14., 2., 1.],

[18., 0., 1.]])

w_ = np.dot(np.dot(np.linalg.inv(np.dot(X.T, X)), X.T), y)

w_

array([[1.01041667],

[0.39583333],

[1.1875 ]])

即:

\]

\]

b = w_[-1]

w = w_[:-1]

print(w)

print(b)

[[1.01041667]

[0.39583333]]

[1.1875]

2.1.4 预测

X_test = pizza.iloc[-5:, :2].values

y_test = pizza.iloc[-5:, 2].values.reshape((-1, 1))

print(X_test)

print(y_test)

[[ 8 2]

[ 9 0]

[11 2]

[16 2]

[12 0]]

[[11. ]

[ 8.5]

[15. ]

[18. ]

[11. ]]

y_pred = np.dot(X_test, w) + b

# y_pred = np.dot(np.hstack((X_test, ones)), w_)

print("目标值:\n", y_test)

print("预测值:\n", y_pred)

目标值:

[[11. ]

[ 8.5]

[15. ]

[18. ]

[11. ]]

预测值:

[[10.0625 ]

[10.28125 ]

[13.09375 ]

[18.14583333]

[13.3125 ]]

2.2 使用 sklearn

import numpy as np

import pandas as pd

from sklearn.linear_model import LinearRegression

# 读取数据

pizza = pd.read_csv("pizza_multi.csv", index_col='Id')

X = pizza.iloc[:-5, :2].values

y = pizza.iloc[:-5, 2].values.reshape((-1, 1))

X_test = pizza.iloc[-5:, :2].values

y_test = pizza.iloc[-5:, 2].values.reshape((-1, 1))

# 线性拟合

model = LinearRegression()

model.fit(X, y)

# 预测

predictions = model.predict(X_test)

for i, prediction in enumerate(predictions):

print('Predicted: %s, Target: %s' % (prediction, y_test[i]))

Predicted: [10.0625], Target: [11.]

Predicted: [10.28125], Target: [8.5]

Predicted: [13.09375], Target: [15.]

Predicted: [18.14583333], Target: [18.]

Predicted: [13.3125], Target: [11.]

# 模型评估

"""

使用 score 方法可以计算 R方

R方的范围为 [0, 1]

R方越接近 1,说明拟合程度越好

"""

print('R-squared: %.2f' % model.score(X_test, y_test))

R-squared: 0.77

此文原创禁止转载,转载文章请联系博主并注明来源和出处,谢谢!

作者: Raina_RLN https://www.cnblogs.com/raina/

机器学习4- 多元线性回归+Python实现的更多相关文章

- 【TensorFlow篇】--Tensorflow框架初始,实现机器学习中多元线性回归

一.前述 TensorFlow是谷歌基于DistBelief进行研发的第二代人工智能学习系统,其命名来源于本身的运行原理.Tensor(张量)意味着N维数组,Flow(流)意味着基于数据流图的计算,T ...

- 100天搞定机器学习|Day3多元线性回归

前情回顾 [第二天100天搞定机器学习|Day2简单线性回归分析][1],我们学习了简单线性回归分析,这个模型非常简单,很容易理解.实现方式是sklearn中的LinearRegression,我们也 ...

- coursera机器学习笔记-多元线性回归,normal equation

#对coursera上Andrew Ng老师开的机器学习课程的笔记和心得: #注:此笔记是我自己认为本节课里比较重要.难理解或容易忘记的内容并做了些补充,并非是课堂详细笔记和要点: #标记为<补 ...

- [机器学习Lesson4]多元线性回归

1. 多元线性回归定义 多元线性回归也被称为多元线性回归. 我们现在介绍方程的符号,我们可以有任意数量的输入变量. 这些多个特征的假设函数的多变量形式如下: hθ(x)=θ0+θ1x1+θ2x2+θ3 ...

- 梯度下降法的python代码实现(多元线性回归)

梯度下降法的python代码实现(多元线性回归最小化损失函数) 1.梯度下降法主要用来最小化损失函数,是一种比较常用的最优化方法,其具体包含了以下两种不同的方式:批量梯度下降法(沿着梯度变化最快的方向 ...

- 【机器学习】线性回归python实现

线性回归原理介绍 线性回归python实现 线性回归sklearn实现 这里使用python实现线性回归,没有使用sklearn等机器学习框架,目的是帮助理解算法的原理. 写了三个例子,分别是单变量的 ...

- day-12 python实现简单线性回归和多元线性回归算法

1.问题引入 在统计学中,线性回归是利用称为线性回归方程的最小二乘函数对一个或多个自变量和因变量之间关系进行建模的一种回归分析.这种函数是一个或多个称为回归系数的模型参数的线性组合.一个带有一个自变 ...

- 机器学习——Day 3 多元线性回归

写在开头 由于某些原因开始了机器学习,为了更好的理解和深入的思考(记录)所以开始写博客. 学习教程来源于github的Avik-Jain的100-Days-Of-MLCode 英文版:https:// ...

- 机器学习:单元线性回归(python简单实现)

文章简介 使用python简单实现机器学习中单元线性回归算法. 算法目的 该算法核心目的是为了求出假设函数h中多个theta的值,使得代入数据集合中的每个x,求得的h(x)与每个数据集合中的y的差值的 ...

随机推荐

- 树链剖分与倍增求LCA

树链剖分与倍增求\(LCA\) 首先我要吐槽机房的辣基供电情况,我之前写了一上午,马上就要完成的时候突然停电,然后\(GG\)成了送链剖分 其次,我没歧视\(tarjan LCA\) 1.倍增求\(L ...

- (转)协议森林13 9527 (DNS协议)

协议森林13 9527 (DNS协议) 作者:Vamei 出处:http://www.cnblogs.com/vamei 欢迎转载,也请保留这段声明.谢谢! 在周星驰的电影<唐伯虎点秋香> ...

- IE8使用chrome内核渲染

1 第一步 https://download.csdn.net/download/qq_34626479/11223448 下载chrome frame安装包; 2 第二步 网页头部添加一行 ...

- 网络安全从入门到精通(第一章-1)Web服务器通信原理

本文内容 IP地址 域名 端口 HTTP协议 从访客角度看网页浏览器流程 常见服务器系统 路径 Web容器 常见的Web容器 !!!多动手,多动手,只看只听是不行的!!! 1,IP地址:就是计算机在互 ...

- Linux提权小结

原文链接:http://zone.secevery.com/article/1104 Linux提权1.信息收集2.脏牛漏洞提权3.内核漏洞exp提权4.SUID提权 0x00 基础信息收集(1):内 ...

- rbac权限+中间件 初识

rbac权限+中间件 1.权限组件rbac 1.什么是权限 1 项目与应用 2 什么是权限? 一个包含正则表达式url就是一个权限 who what how ---------->True or ...

- Oracle 中文日期转换

中文日期转换 select to_char(to_date('07-5月-17'),'yyyy-MM-dd HH24:mi:ss') from dual

- 前端html学习笔记

一 HTML介绍 1. Web服务的本质 import socket sk = socket.socket() sk.bind(("127.0.0.1", 8080)) sk.li ...

- javaAPI操作ES分组聚合

连接es的客户端使用的 TransportClient SearchRequestBuilder requestBuilder = transportClient.prepareSearch(indi ...

- OLED的使用-4线SPI驱动

一 .OLED屏 1.OLED屏(七针) 2.OLED电路图 3.0.96'OLED简介 该模块特点: 1.三色可选,模块有两种单色和黄蓝双色两种颜色可选,单色为纯白色和纯蓝色,双 色为黄蓝双色: 2 ...