spark-2.1.1 yarn(高可用)搭建

一、概述

spark分布式搭建方式大致分为三种:standalone、yarn、mesos。三种分类的区别这里就不一一介绍了,不明白可自行了解。standalone是官方提供的一种集群方式,企业一般不使用。yarn集群方式在企业中应用是比较广泛的,这里也是介绍yarn的集群安装方式。mesos安装适合于超大型集群。

集群节点分配:

hadoop01:Zookeeper、NameNode(active)、ResourceManager(active)

hadoop02:Zookeeper、NameNode(standby)

hadoop03:Zookeeper、 ResourceManager(standby)

hadoop04: DataNode、 NodeManager、 JournalNode、 spark

hadoop05: DataNode、 NodeManager、 JournalNode、 spark

hadoop06: DataNode、 NodeManager、 JournalNode、 spark

二、安装

说明一下:

①选spark的时候要注意与hadoop版本对应。因为hadoop用的是2.7的,所以spark选的是spark-2.1.1-bin-hadoop2.7

②因为spark基于yarn来管理,spark只能安装在NodeManager节点上。

③spark安装放在/home/software目录下。

1、hadoop基于yarn(ha)的搭建,这里介绍步骤了。在我的上一个教程里有详细介绍。

2、安装scala,并配置好环境变量。

3、在NodeManager节点上解压spark文件。

tar -xvf spark-2.1.1-bin-hadoop2.7

3、修改spark-2.1.1-bin-hadoop2.7/conf/spark-env.sh,在文件尾部加上以下内容,其中HADOOP_CONF_DIR是必填项

export JAVA_HOME=/home/jack/jdk1.8.0_144

export SCALA_HOME=/home/jack/scala-2.12.3

export HADOOP_HOME=/home/software/hadoop-2.7.4

export HADOOP_CONF_DIR=/home/software/hadoop-2.7.4/etc/hadoop

export SPARK_MASTER_PORT=7077

export SPARK_EXECUTOR_CORES=2

export SPARK_EXECUTOR_MEMORY=1024m

export SPARK_EXECUTOR_INSTANCES=1

4、修改spark-2.1.1-bin-hadoop2.7/conf/slave文件,添加以下内容:

hadoop04

hadoop05

hadoop06

5、在hdfs上传spark的jar包,并修改/home/software/spark-2.1.1-bin-hadoop2.7/conf/spark-defaults.conf(可不做)

①hadoop fs -mkdir /spark_jars

②hadoop fs -put /home/software/spark-2.1.1-bin-hadoop2.7/jars/* /spark_jars

③修改/home/software/spark-2.1.1-bin-hadoop2.7/conf/spark-defaults.conf,添加以下内容:

spark.yarn.jars=hdfs://hadoop01:9000/spark_jars/*

6、完成以上操作就完成了spark基于yarn的安装。下面是验证部分:

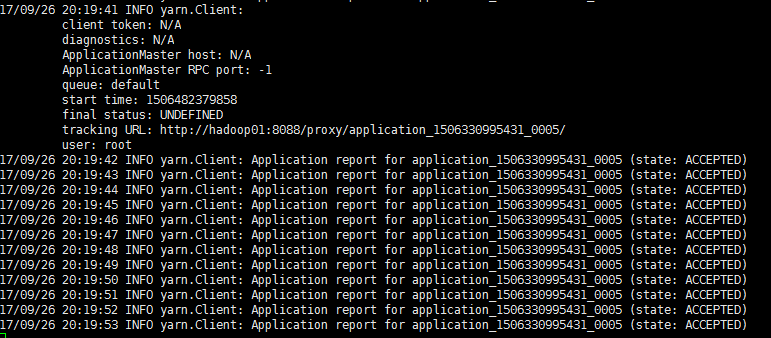

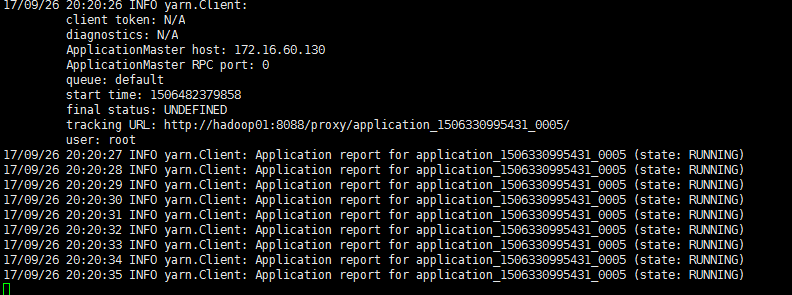

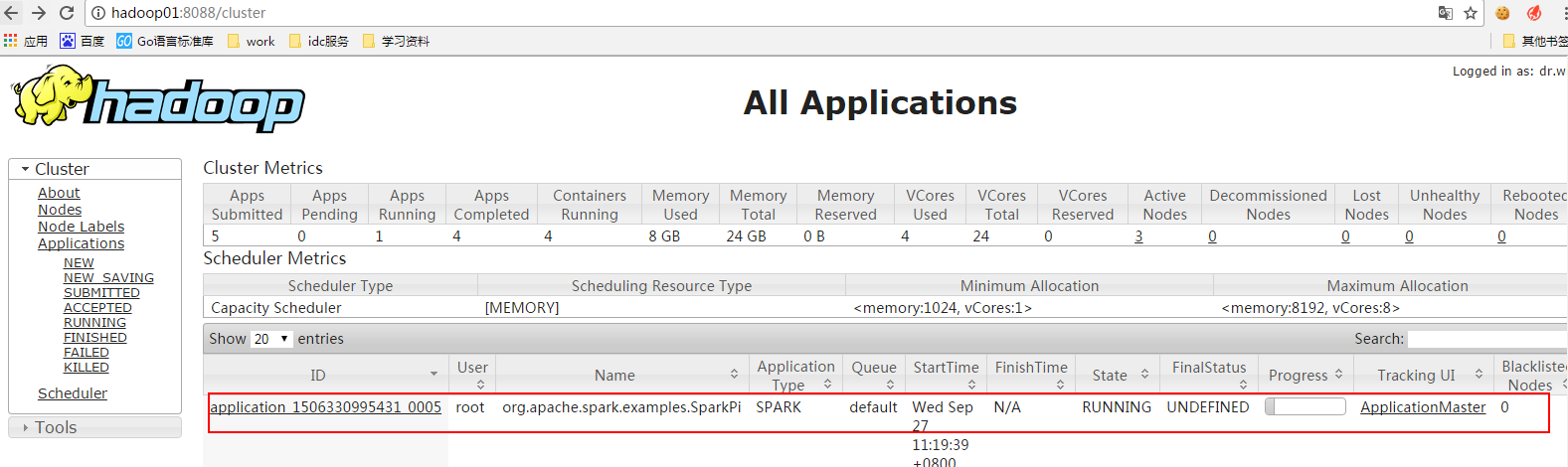

在安装有spark的节点上执行以下命令:

spark-submit --class org.apache.spark.examples.SparkPi \

--master yarn \

--deploy-mode cluster \

--driver-memory 1g \

--executor-memory 1g \

--executor-cores 1 \

--num-executors 3 \

/home/software/spark-2.1.1-bin-hadoop2.7/examples/jars/spark-examples_2.11-2.1.1.jar \

10

能看以上三张图就说明安装成功了!

备注:如果执行spark-shell --master yarn --deploy-mode client失败,报rpc连接失败,解决方法如下:

在hadoop的配置文件yarn-site.xml中加入:

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

报错的原因是:内存资源给的过小,yarn直接kill掉进程,则报rpc连接失败、ClosedChannelException等错误。

spark-2.1.1 yarn(高可用)搭建的更多相关文章

- hadoop2.6.0高可靠及yarn 高可靠搭建

以前用hadoop2.2.0只搭建了hadoop的高可用,但在hadoop2.2.0中始终没有完成YARN HA的搭建,直接下载了hadoop最新稳定版本2.6.0完成了YARN HA及HADOOP ...

- hadoop 集群HA高可用搭建以及问题解决方案

hadoop 集群HA高可用搭建 目录大纲 1. hadoop HA原理 2. hadoop HA特点 3. Zookeeper 配置 4. 安装Hadoop集群 5. Hadoop HA配置 搭建环 ...

- hadoop+zookeeper集群高可用搭建

hadoop+zookeeper集群高可用搭建 Senerity 发布于 2 ...

- 七、Hadoop3.3.1 HA 高可用集群QJM (基于Zookeeper,NameNode高可用+Yarn高可用)

目录 前文 Hadoop3.3.1 HA 高可用集群的搭建 QJM 的 NameNode HA Hadoop HA模式搭建(高可用) 1.集群规划 2.Zookeeper集群搭建: 3.修改Hadoo ...

- 10-Flink集群的高可用(搭建篇补充)

戳更多文章: 1-Flink入门 2-本地环境搭建&构建第一个Flink应用 3-DataSet API 4-DataSteam API 5-集群部署 6-分布式缓存 7-重启策略 8-Fli ...

- Hadoop入门学习笔记-第三天(Yarn高可用集群配置及计算案例)

什么是mapreduce 首先让我们来重温一下 hadoop 的四大组件:HDFS:分布式存储系统MapReduce:分布式计算系统YARN: hadoop 的资源调度系统Common: 以上三大组件 ...

- Qingcloud_MySQL Plus(Xenon) 高可用搭建实验

实验:Xenon on 5.7.30 Xenon (MySQL Plus) 是青云Qingcloud的一个开源项目,号称金融级别强一致性的高可用解决方案,项目地址为 https://github.co ...

- Spring Cloud(Dalston.SR5)--Eureka 注册中心高可用搭建

高可用集群 在微服务架构这样的分布式环境中,我们需要充分考虑发生故障的情况,所以在生产环境中必须对各个组件进行高可用部署,对与微服务和服务注册中心都需要高可用部署,Eureka 高可用实际上就是将自己 ...

- kudu集群高可用搭建

首先咱得有KUDU安装包 这里就不提供直接下载地址了(因为有5G,我 的服务器网卡只有4M,你们下的很慢) 这里使用的是CDH版本 官方下载地址http://archive.cloudera.com/ ...

随机推荐

- 快速入门分布式消息队列之 RabbitMQ(3)

目录 目录 前文列表 前言 通道 Channel 一个基本的生产者消费者实现 消费者 生产者 运行结果 应用预取计数 应用 ACK 机制 最后 前文列表 快速入门分布式消息队列之 RabbitMQ(1 ...

- Java连接Hive使用Zookeeper的方式

Java连接Hive的方式就是通过JDBC的方式来连接,URL为jdbc:hive2://host:port/db;principal=X@BIGDATA.COM等,这种方式是直接连接HiveServ ...

- python里一个class可以定义多个构造函数

不行,一个class只能有一个用于构造对象的__init__函数但python中的变量是无类型的,因此传给__init__的参数可以是任何类型python中的函数参数在定义时可以有默认值,可以让__i ...

- 03.大型数据库应用技术课堂测试3(java.lang.NoSuchMethodError: com.google.common.base.Preconditions.checkArgument(ZLjava/lang/String;Ljava/lang/Object;)V)

本次问题主要出在了之前没有安装hive,结构导致大部分时间花在了安装上面,主要一直报错,网上找不到相关教程.

- 【ABAP系列】SAP ABAP smartforms设备类型CNSAPWIN不支持页格式ZXXX

公众号:SAP Technical 本文作者:matinal 原文出处:http://www.cnblogs.com/SAPmatinal/ 原文链接:[ABAP系列]SAP ABAP smartfo ...

- Scratch少儿编程系列:(一)版本的选择及安装

工欲善其事必先利其器,为了使用Scratch,首先要到官网上下载相关软件. 官网链接地址为:https://scratch.mit.edu/download,我用的是Windows系统,下载对应的安装 ...

- Javascript实现的图片隐写术

javascript图片隐写术,感觉可以用它来干点有想法的事情 1.什么是图片隐写术? 权威的wiki说法是“隐写术是一门关于信息隐藏的技巧与科学,所谓信息隐藏指的是不让除预期的接收者之外的任何人 ...

- [转帖]Intel Xeon路线图:7nm处理器要上DDR5、PCIe 5.0

Intel Xeon路线图:7nm处理器要上DDR5.PCIe 5.0 https://www.cnbeta.com/articles/tech/849631.htm 在月初的投资者会议上,Intel ...

- sql query执行的顺序

第一, from, 选择或者join多个表得到基础数据表,所以,联结是第一步要执行的操作,它在获取最基础的数据表: 第二,where,过滤掉基础数据表中不符合条件的行,得到后续操作的数据表: 第三, ...

- DateHandler日期处理工具(JSP中使用后台工具类)

1.DateHandler.java package Utils.dateHandler; import java.text.ParseException; import java.text.Simp ...