使用selenium+BeautifulSoup 抓取京东商城手机信息

1.准备工作:

- chromedriver 传送门:国内:http://npm.taobao.org/mirrors/chromedriver/ vpn:

- selenium

- BeautifulSoup4(美味汤)

pip3 install selenium

pip3 install BeautifulSoup4

chromedriver 的安装请自行百度。我们直奔主题。

起飞前请确保准备工作以就绪...

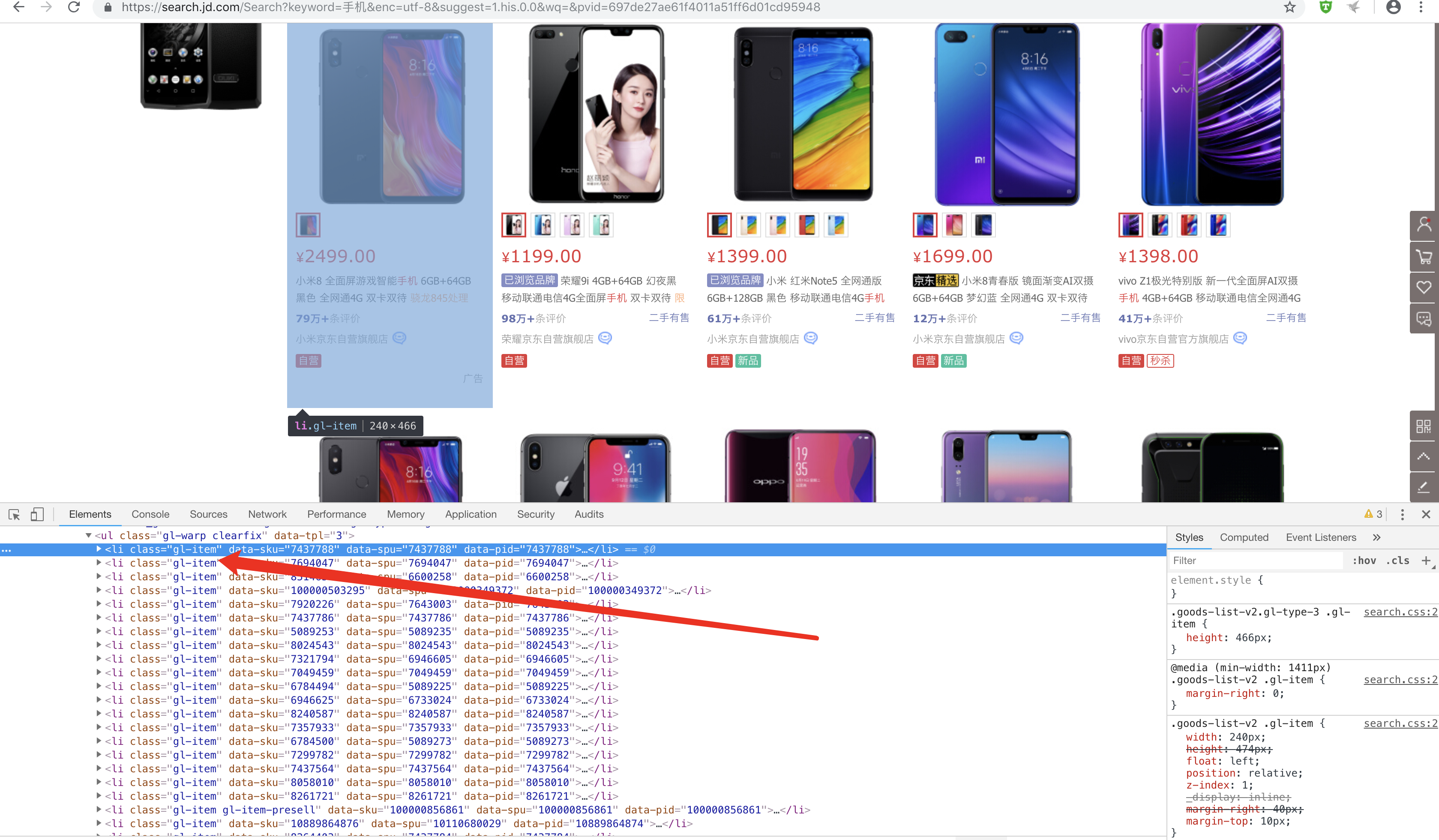

2.分析网页:

目标网址:https://www.jd.com/

所有item均保存在class="gl-item"里面

需求:

- 使用selenium 驱动浏览器自动侦测到input输入框,输入框中输入“手机”,点击搜索按钮.

- 使用seleinum抓取发挥页面的总页码,并模拟手动翻页

- 使用BeautifulSoup分析页面,抓取手机信息

从入口首页进入查询状态

# 定义入口查询界面

def search():

browser.get('https://www.jd.com/')

try:

# 查找搜索框及搜索按钮,输入信息并点击按钮

input = wait.until(EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#key")))

submit = wait.until(EC.element_to_be_clickable((By.CSS_SELECTOR, "#search > div > div.form > button")))

input[0].send_keys('手机')

submit.click()

# 获取总页数

page = wait.until(EC.presence_of_all_elements_located((By.CSS_SELECTOR, '#J_bottomPage > span.p-skip > em:nth-child(1) > b')))

return page[0].text

# 如果异常,递归调用本函数

except TimeoutException:

search()

查询结束后模拟翻页

# 翻页

def next_page(page_number):

try:

# 滑动到网页底部,加载出所有商品信息

browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(4)

html = browser.page_source

# 当网页到达100页时,下一页按钮失效,所以选择结束程序

while page_number == 101:

exit()

# 查找下一页按钮,并点击按钮

button = wait.until(EC.element_to_be_clickable((By.CSS_SELECTOR, '#J_bottomPage > span.p-num > a.pn-next > em')))

button.click()

# 判断是否加载到本页最后一款产品Item(每页显示60条商品信息)

wait.until(EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#J_goodsList > ul > li:nth-child(60)")))

# 判断翻页成功

wait.until(EC.text_to_be_present_in_element((By.CSS_SELECTOR, "#J_bottomPage > span.p-num > a.curr"), str(page_number)))

return html

except TimeoutException:

return next_page(page_number)

解析页面上的a标签

# 解析每一页面上的a链接

def parse_html(html):

"""

解析商品列表网页,获取商品的详情页

""" soup = BeautifulSoup(html, 'html.parser')

items = soup.select('.gl-item')

for item in items:

a = item.select('.p-name.p-name-type-2 a')

link = str(a[0].attrs['href'])

if 'https:' in link:

continue

else:

link = "https:"+link

yield link

根据url 截取商品id 获取价格信息

# 获取手机价格,由于价格信息是请求另外一个地址https://p.3.cn/prices/mgets?skuIds=J_+product_id

def get_price(product_id):

url = 'https://p.3.cn/prices/mgets?skuIds=J_' + product_id

response = requests.get(url,heeders)

result = ujson.loads(response.text)

return result

进入item商品详情页

# 进入详情页

def detail_page(link):

"""

进入item详情页

:param link: item link

:return: html

"""

browser.get(link)

try:

browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(3)

html = browser.page_source

return html

except TimeoutException:

detail_page(link)

# 获取详情页的手机信息

def get_detail(html,result):

"""

获取详情页的数据

:param html:

:return:

"""

dic ={}

soup = BeautifulSoup(html, 'html.parser')

item_list = soup.find_all('div', class_='Ptable-item')

for item in item_list:

contents1 = item.findAll('dt')

contents2 = item.findAll('dd')

for i in range(len(contents1)):

dic[contents1[i].string] = contents2[i].string dic['price_jd '] = result[0]['p']

dic['price_mk '] = result[0]['m']

print(dic)

滴滴滴.. 基本上的思路就酱紫咯.. 传送门依旧打开直github: https://github.com/shinefairy/spider/

end~

使用selenium+BeautifulSoup 抓取京东商城手机信息的更多相关文章

- asp.net mvc 抓取京东商城分类

555 asp.net mvc 抓取京东商城分类 URL:http://www.jd.com/allSort.aspx 效果: //后台代码 public ActionResult Get ...

- 如何利用BeautifulSoup选择器抓取京东网商品信息

昨天小编利用Python正则表达式爬取了京东网商品信息,看过代码的小伙伴们基本上都坐不住了,辣么多的规则和辣么长的代码,悲伤辣么大,实在是受不鸟了.不过小伙伴们不用担心,今天小编利用美丽的汤来为大家演 ...

- 如何利用Xpath抓取京东网商品信息

前几小编分别利用Python正则表达式和BeautifulSoup爬取了京东网商品信息,今天小编利用Xpath来为大家演示一下如何实现京东商品信息的精准匹配~~ HTML文件其实就是由一组尖括号构成的 ...

- 如何利用CSS选择器抓取京东网商品信息

前几天小编分别利用Python正则表达式.BeautifulSoup.Xpath分别爬取了京东网商品信息,今天小编利用CSS选择器来为大家展示一下如何实现京东商品信息的精准匹配~~ CSS选择器 目前 ...

- Scrapy实战篇(四)爬取京东商城文胸信息

创建scrapy项目 scrapy startproject jingdong 填充 item.py文件 在这里定义想要存储的字段信息 import scrapy class JingdongItem ...

- Scrapy实战篇(五)爬取京东商城文胸信息

创建scrapy项目 scrapy startproject jingdong 填充 item.py文件 在这里定义想要存储的字段信息 import scrapy class JingdongItem ...

- php+phpquery简易爬虫抓取京东商品分类

这是一个简单的php加phpquery实现抓取京东商品分类页内容的简易爬虫.phpquery可以非常简单地帮助你抽取想要的html内容,phpquery和jquery非常类似,可以说是几乎一样:如果你 ...

- Scrapy实战篇(八)之Scrapy对接selenium爬取京东商城商品数据

本篇目标:我们以爬取京东商城商品数据为例,展示Scrapy框架对接selenium爬取京东商城商品数据. 背景: 京东商城页面为js动态加载页面,直接使用request请求,无法得到我们想要的商品数据 ...

- Python脚本抓取京东手机的配置信息

以下代码是使用python抓取京东小米8手机的配置信息 首先找到小米8商品的链接:https://item.jd.com/7437788.html 然后找到其配置信息的标签,我们找到其配置信息的标签为 ...

随机推荐

- HTML--JS 定时刷新、时钟、倒计时

<html> <head> <title>定时刷新时间</title> <script language="JavaScript&quo ...

- hdu2182Frog(动态规划)

Problem Description A little frog named Fog is on his way home. The path's length is N (1 <= N &l ...

- 通过JS,用a标签代替form中的submit

---恢复内容开始--- 有时候在使用表单的时候,不一定会用到表单中的input_submit来提交表单数据,可能会用a.button等来代替 然后自然而然地想到了用JS中的提交表单数据的动作 < ...

- CodeChef 3-Palindromes(Manacher+dp)

3-Palindromes Problem code: PALIN3 Submit All Submissions All submissions for this problem are ...

- UVAlive 6756 Increasing Shortest Path

We all love short and direct problems, it is easier to write, read and understand the problem statem ...

- Codeforces 375D D. Tree and Queries

传送门 题意: 给一棵树,每个节点有一个颜色,询问x为根的子树,出现次数大于等于k的颜色个数. 输入格式: 第一行 2 个数 n,m 表示节点数和询问数. 接下来一行 n 个数,第 i 个数 ci ...

- git 命令图解

git 命令图解 初始化版本库 git config user.name "lsgx" git config user.email "lsgxthink@163.co ...

- SR-IOV

SR-IOV 来源 http://blog.csdn.net/liushen0916/article/details/52423507 摘要: 介绍SR-IOV 的概念.使用场景.VMware 和 K ...

- CSS中的关系选择器

关系选择器是指根据与其他元素的关系选择元素的选择器,常见的符号有空格.>.~,还 有+等,这些都是非常常用的选择器. 后代选择器:选择所有合乎规则的后代元素.空格连接. 相邻后代选择器:仅仅选择 ...

- CSS样式表能否控制文字禁止选择,复制, 焦点

div中禁止文字被选择 在做div的点击计数事件时,遇到一个小问题. 因为div里面有文字,所以当点击多次时,特别是鼠标点的比较快的时候,文字会被选中. 查了下,用css和javascript可以实现 ...