卷积神经网络(CNN)模型

一、概述

卷积神经网络(Convolutional Neural Network, CNN)是一种深度学习模型,广泛应用于图像识别、计算机视觉等领域。其设计理念源于对生物视觉皮层神经机制的模拟,核心原理是通过卷积、池化(下采样)、全连接等操作,自动提取输入数据的层级特征,完成分类或回归任务。

二、模型原理

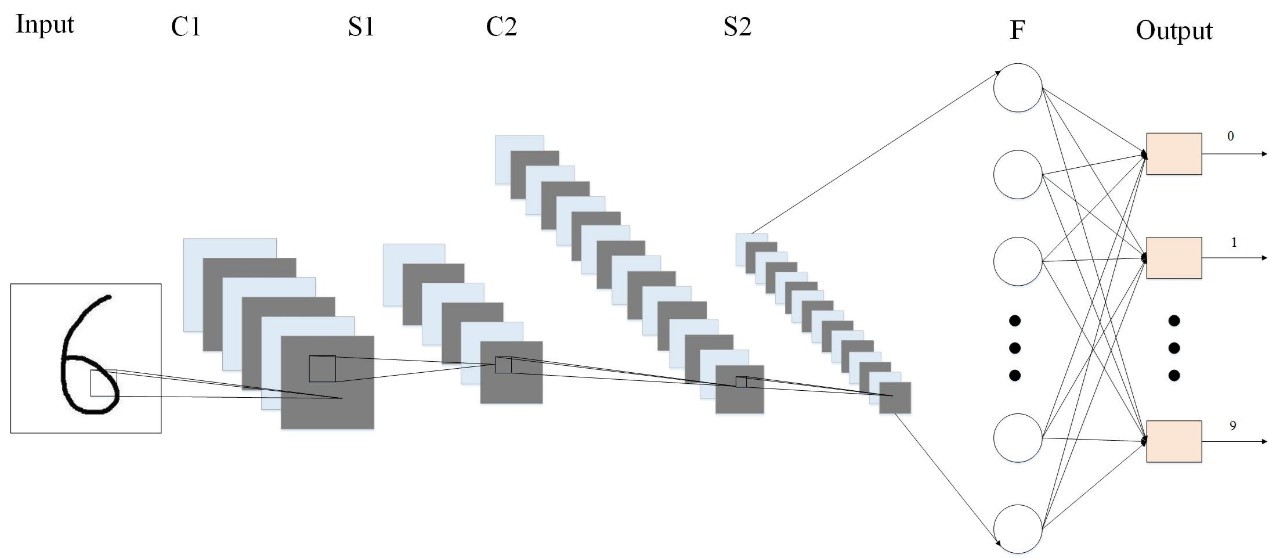

一个典型卷积神经网络模型通常依次由输入层、卷积层、下采样层、全连接层、输出层等构成。该模型最主要的三个特点是局部感知、权值共享、下采样,局部感知和权值共享体现在卷积层,下采样体现在采样层。一个典型CNN结构图如下图所示

1.输入层

即输入数据,通常是图像,或其他结构化的数据。

2.卷积层

通过卷积核(Filter/Kernel)在输入数据(如图像)上滑动,每次仅与局部区域进行加权求和,模拟生物视觉的局部感知机制。如果输入数据为一张灰度图,那么卷积核为二维张量(如3×3),对应计算输入图像的值;如果输入数据为一张 RGB 图像(3 通道),则卷积核通常为三维张量(如 3×3×3),对应计算输入图像的多通道值。

同一个卷积核在滑动过程中参数(权重)保持不变,例如,一个输入图像用 3×3 的卷积核提取特征,只需学习 9 个参数,大幅减少模型参数量。卷积运算的结果称为特征映射,每个特征映射对应输入数据的一种特征(如边缘、纹理、颜色等)。该层操作有卷积核大小、步长(Stride)、填充(Padding)等关键参数。卷积核大小常见有 3×3、5×5 等;步长(Stride)是卷积核滑动的间隔,步长为 1 时逐像素滑动,步长为 2 时每隔一个像素滑动;填充(Padding)是指在输入数据边缘补零,保持特征图尺寸(如 “Same Padding” 使输出尺寸与输入相同)或控制尺寸缩小比例。通过叠加多个卷积核,可提取多维度特征。该层的输出通常叫做特征图(fature map)。

3.下采样层

下采样(Downsampling)也叫做池化(Pooling)。该层的一个作用是实现下采样,通过聚合局部区域特征(如取最大值或平均值),缩小特征图尺寸,减少计算量。另一个作用是实现平移不变性,使特征对输入数据的微小位移不敏感,增强模型鲁棒性。同样,该层的输出也可叫做特征图。

4.全连接层

经过多层卷积和池化操作后,特征图被展平为一维向量,输入到全连接层(Fully Connected Layer)。全连接层中的每个神经元与上一层的所有神经元相连,通过矩阵乘法和激活函数,将提取到的特征映射到预测输出。

5.输出层

经过多层计算之后,输出预测内容。对于分类任务,通常使用 Softmax 激活函数,输出各类别的概率分布;对于回归任务,通常可直接设计为一个以线性函数为激活函数的神经元,输出连续型变量值。

三、网络层级与深度的理解

1.低层级卷积层提取边缘、颜色、纹理等基础特征。

2.高层级通过多层卷积和池化,组合基础特征形成复杂语义(如 “眼睛”→“人脸”→“物体类别”)。

3.网络深度增加(层数增多),可提取更抽象的特征,但需解决梯度消失 / 爆炸问题(通过残差连接、批量归一化等技术优化)。

四、优势与应用

1. 优势

参数效率高:权值共享和局部感知减少参数量,适合处理高维数据(如图像)。

特征自动提取:无需人工设计特征,端到端学习从原始数据到标签的映射。

2. 应用领域

图像领域:分类、目标检测(如 YOLO、Faster R-CNN)、语义分割(如 U-Net)。

视频领域:行为识别(3D CNN)、视频生成。

其他领域:自然语言处理(文本 CNN)、医学影像分析、自动驾驶等。

3.一些典型CNN架构应用

| 模型 | 特点 |

|---|---|

| LeNet-5 | 首个成功应用于手写数字识别的 CNN,包含卷积层、池化层和全连接层。 |

| AlexNet | 通过更深的结构(5 层卷积)和 Dropout 技术,在 ImageNet 竞赛中大幅提升准确率。 |

| VGGNet | 使用小尺寸卷积核(3×3)堆叠增加深度,验证了深度对性能的重要性。 |

| ResNet | 引入残差连接(Residual Connection),解决深层网络训练困难问题。 |

| GoogLeNet | 采用 Inception 模块,并行使用不同尺寸卷积核,平衡计算量与特征多样性。 |

五、Python实现示例

(环境:Python 3.11,PyTorch 2.4.0)

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

from torch.utils.data import DataLoader

# 定义数据预处理

transform = transforms.Compose([

transforms.ToTensor(), # 转换为张量

transforms.Normalize((0.1307,), (0.3081,)) # 标准化处理

])

# 加载训练集和测试集

train_dataset = datasets.MNIST('data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST('data', train=False, transform=transform)

# 创建数据加载器

train_loader = DataLoader(train_dataset, batch_size=64, shuffle=True)

test_loader = DataLoader(test_dataset, batch_size=1000)

# 定义卷积神经网络模型

class SimpleCNN(nn.Module):

def __init__(self):

super(SimpleCNN, self).__init__()

self.conv1 = nn.Conv2d(1, 10, kernel_size=5) # 输入通道1,输出通道10

self.conv2 = nn.Conv2d(10, 20, kernel_size=5) # 输入通道10,输出通道20

self.conv2_drop = nn.Dropout2d() # Dropout层,防止过拟合

self.fc1 = nn.Linear(320, 50) # 全连接层

self.fc2 = nn.Linear(50, 10) # 输出层,10个类别

def forward(self, x):

x = nn.functional.relu(nn.functional.max_pool2d(self.conv1(x), 2))

x = nn.functional.relu(nn.functional.max_pool2d(self.conv2_drop(self.conv2(x)), 2))

x = x.view(-1, 320) # 展平张量

x = nn.functional.relu(self.fc1(x))

x = nn.functional.dropout(x, training=self.training)

x = self.fc2(x)

return nn.functional.log_softmax(x, dim=1)

# 初始化模型、损失函数和优化器

model = SimpleCNN()

criterion = nn.NLLLoss() # 负对数似然损失函数

optimizer = optim.Adam(model.parameters(), lr=0.001) # Adam优化器

# 训练函数

def train(model, train_loader, optimizer, epoch):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

optimizer.zero_grad() # 梯度清零

output = model(data) # 前向传播

loss = criterion(output, target) # 计算损失

loss.backward() # 反向传播

optimizer.step() # 更新参数

if batch_idx % 100 == 0:

print(f'Train Epoch: {epoch} [{batch_idx * len(data)}/{len(train_loader.dataset)} '

f'({100. * batch_idx / len(train_loader):.0f}%)]\tLoss: {loss.item():.6f}')

# 测试函数

def test(model, test_loader):

model.eval()

test_loss = 0

correct = 0

with torch.no_grad():

for data, target in test_loader:

output = model(data)

test_loss += criterion(output, target).item() # 累加损失

pred = output.argmax(dim=1, keepdim=True) # 获取预测结果

correct += pred.eq(target.view_as(pred)).sum().item() # 统计正确预测数

test_loss /= len(test_loader.dataset)

print(f'\nTest set: Average loss: {test_loss:.4f}, '

f'Accuracy: {correct}/{len(test_loader.dataset)} '

f'({100. * correct / len(test_loader.dataset):.2f}%)\n')

# 训练模型

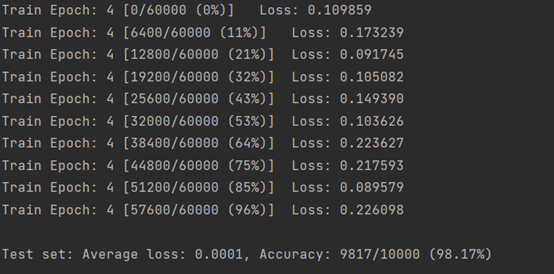

for epoch in range(1, 5): # 训练4个轮次

train(model, train_loader, optimizer, epoch)

test(model, test_loader)

End.

卷积神经网络(CNN)模型的更多相关文章

- 卷积神经网络(CNN)模型结构

在前面我们讲述了DNN的模型与前向反向传播算法.而在DNN大类中,卷积神经网络(Convolutional Neural Networks,以下简称CNN)是最为成功的DNN特例之一.CNN广泛的应用 ...

- 卷积神经网络(CNN)前向传播算法

在卷积神经网络(CNN)模型结构中,我们对CNN的模型结构做了总结,这里我们就在CNN的模型基础上,看看CNN的前向传播算法是什么样子的.重点会和传统的DNN比较讨论. 1. 回顾CNN的结构 在上一 ...

- 深度学习方法(五):卷积神经网络CNN经典模型整理Lenet,Alexnet,Googlenet,VGG,Deep Residual Learning

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld. 技术交流QQ群:433250724,欢迎对算法.技术感兴趣的同学加入. 关于卷积神经网络CNN,网络和文献中 ...

- 卷积神经网络(CNN)反向传播算法

在卷积神经网络(CNN)前向传播算法中,我们对CNN的前向传播算法做了总结,基于CNN前向传播算法的基础,我们下面就对CNN的反向传播算法做一个总结.在阅读本文前,建议先研究DNN的反向传播算法:深度 ...

- 卷积神经网络CNN总结

从神经网络到卷积神经网络(CNN)我们知道神经网络的结构是这样的: 那卷积神经网络跟它是什么关系呢?其实卷积神经网络依旧是层级网络,只是层的功能和形式做了变化,可以说是传统神经网络的一个改进.比如下图 ...

- 【深度学习系列】手写数字识别卷积神经--卷积神经网络CNN原理详解(一)

上篇文章我们给出了用paddlepaddle来做手写数字识别的示例,并对网络结构进行到了调整,提高了识别的精度.有的同学表示不是很理解原理,为什么传统的机器学习算法,简单的神经网络(如多层感知机)都可 ...

- 深度学习之卷积神经网络(CNN)详解与代码实现(一)

卷积神经网络(CNN)详解与代码实现 本文系作者原创,转载请注明出处:https://www.cnblogs.com/further-further-further/p/10430073.html 目 ...

- 【深度学习系列】卷积神经网络CNN原理详解(一)——基本原理

上篇文章我们给出了用paddlepaddle来做手写数字识别的示例,并对网络结构进行到了调整,提高了识别的精度.有的同学表示不是很理解原理,为什么传统的机器学习算法,简单的神经网络(如多层感知机)都可 ...

- 卷积神经网络(CNN)学习笔记1:基础入门

卷积神经网络(CNN)学习笔记1:基础入门 Posted on 2016-03-01 | In Machine Learning | 9 Comments | 14935 Vie ...

- 深度学习之卷积神经网络CNN

转自:https://blog.csdn.net/cxmscb/article/details/71023576 一.CNN的引入 在人工的全连接神经网络中,每相邻两层之间的每个神经元之间都是有边相连 ...

随机推荐

- 【ARM+Qt+OpenCV】基于ARM的双目图像采集系统

点击查看代码 系统使用ARM处理器,运行linux系统,Qt创建工程编写主程序,可以使用OpenCV进行图像处理. 通过两个摄像头采集会图像,在LCD上进行显示,然后通过LCD上的按钮实现退出程序.保 ...

- 内网环境部署Deepseek+Dify,构建企业私有化AI应用

0.简介 公司为生产安全和保密,内部的服务器不可连接外部网络,为了可以在内网环境下部署,采用的方案为ollama(Docker)+Dify(Docker Compose),方便内网环境下迁移和备份,下 ...

- Pwnable_orw

题源 题解 保护 只开启了栈保护 分析 进入ida分析 main函数如下 seccomp (Secure Computing Mode)是一种 Linux 内核安全机制,它可以 限制进程可执行的系统调 ...

- github520cli解决无法github访问问题

github并没有被GFW直接墙掉,而是因为DNS污染导致经常无法访问 访问的时候经常出现push或者pull代码的时间很长,出现无法访问仓库,请检查是否有权限的报错,这可能就是被DNS污染了 如何解 ...

- go map fatal error: concurrent map iteration and map write 读写锁与深度拷贝的坑

起因 从币安实时拉取交易对的数据,这里使用了 map,用于存放每个交易对的最新价格,由于 map 并不是并发安全的所以加了读写锁. 但系统有时候还是会发生 fatal error: concurren ...

- go包管理工具 govendor

govendor介绍 govendor 是 GoLang 常用的一个第三方包管理工具,它的出现解决了不同用户在 clone 同一个项目时从外部获取不同依赖库版本的问题. govendor会将项目需要的 ...

- IM服务器:一个使用imserver服务器进行聊天的web端案例

该案例中包含一个基于web网页的前端程序,该案例会使用websocket与IM服务器(imserver)进行通信. 一.环境准备 1.下载 "imserver网页调用案例",并解压 ...

- 主存的扩展及其与CPU的连接——字扩展

一块芯片的容量为\(2^{18}B\),而该CPU需要的容量为:\(2^{地址总线位宽}\)=\(2^{21}B\),所以需要8片该芯片来扩展. 由于CPU由21个地址引脚,芯片只有18个地址引脚,C ...

- 基于STM32F4+FREERTOS进行结构体变量的传递

原始参考链接如下↓ Freertos 接收消息队列数据不对,是姿势不正确吗 - STM32H7 - 硬汉嵌入式论坛 - Powered by Discuz! https://www.armbbs.cn ...

- 使用Python和SymPy推导斯特林公式

引言 斯特林公式(Stirling's Approximation)是一种用来近似计算阶乘的数学公式.它是数学分析中非常重要的近似公式之一,尤其在概率论.统计学.物理学等领域中广泛应用.本文将使用 P ...