hadoop-hdfs编程

1、开发环境搭建

一、新建一个普通的java工程

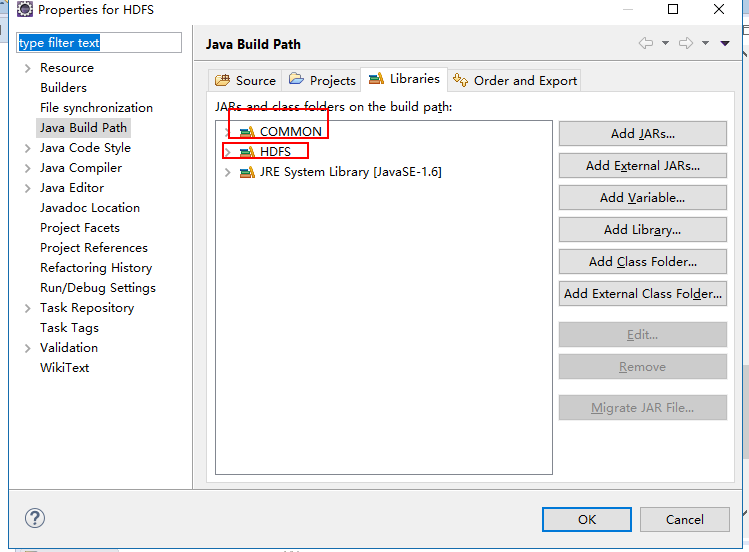

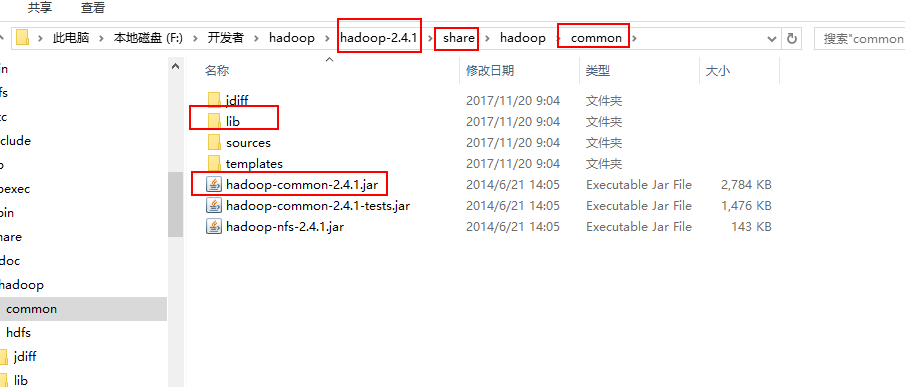

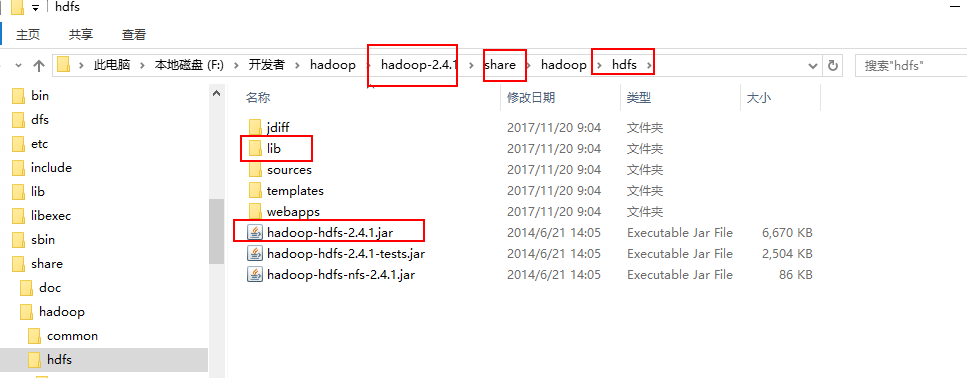

二、引入hdfs相关的jar包

需要引入的jar包:

common下的jar

hdfs下的jar

2、编写HDFS相关的程序

package com.cvicse.ump.hadoop.hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; public class FileOperation { //创建文件

public static void createFile(String dst,byte[] contents) throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path dstPath = new Path(dst);

FSDataOutputStream outputStream = fs.create(dstPath);;

outputStream.write(contents);

outputStream.close();

fs.close();

System.out.println(dst+",文件创建成果");

} //上传文件

public static void uploadFile(String src,String dst) throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path srcPath = new Path(src);

Path dstPath = new Path(dst);

fs.copyFromLocalFile(srcPath, dstPath);

System.out.println("Upload to "+conf.get("fs.default.name"));

System.out.println("------list files---------"+"\n");

FileStatus[] fileStatus = fs.listStatus(dstPath);

for(FileStatus file:fileStatus){

System.out.println(file.getPath());

}

fs.close(); } //删除目录

public static void delete(String filePath)throws Exception{ Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path path = new Path(filePath);

boolean isOk = fs.deleteOnExit(path);

if(isOk){

System.out.println("delete OK.");

}else{

System.out.println("delete failure.");

}

fs.close(); }

//创建目录

public static void mkdir(String path)throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path srcPath = new Path(path);

boolean isOK = fs.mkdirs(srcPath);

if(isOK){

System.out.println("create dir ok!");

}else{

System.out.println("create dir failure!");

}

fs.close();

} //下载文件

public static void downFile(String src,String dst)throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path srcPath = new Path(src);

Path dstPath = new Path(dst); fs.copyToLocalFile(srcPath, dstPath);

System.out.println("down load over"); } public static void main(String[] args) throws Exception {

/*String dst = args[0];

byte[] contents = "hello,dyh".getBytes();

createFile(dst, contents);*/ /*String src = args[0];

String dst = args[1];

uploadFile(src, dst);*/ /*String filePath = args[0];

delete(filePath);*/ /*String path = args[0];

mkdir(path);*/ String src = args[0];

String dst = args[1];

downFile(src, dst);

} }

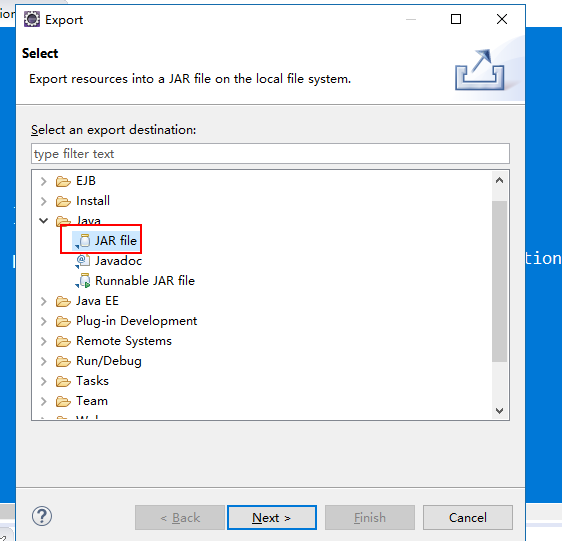

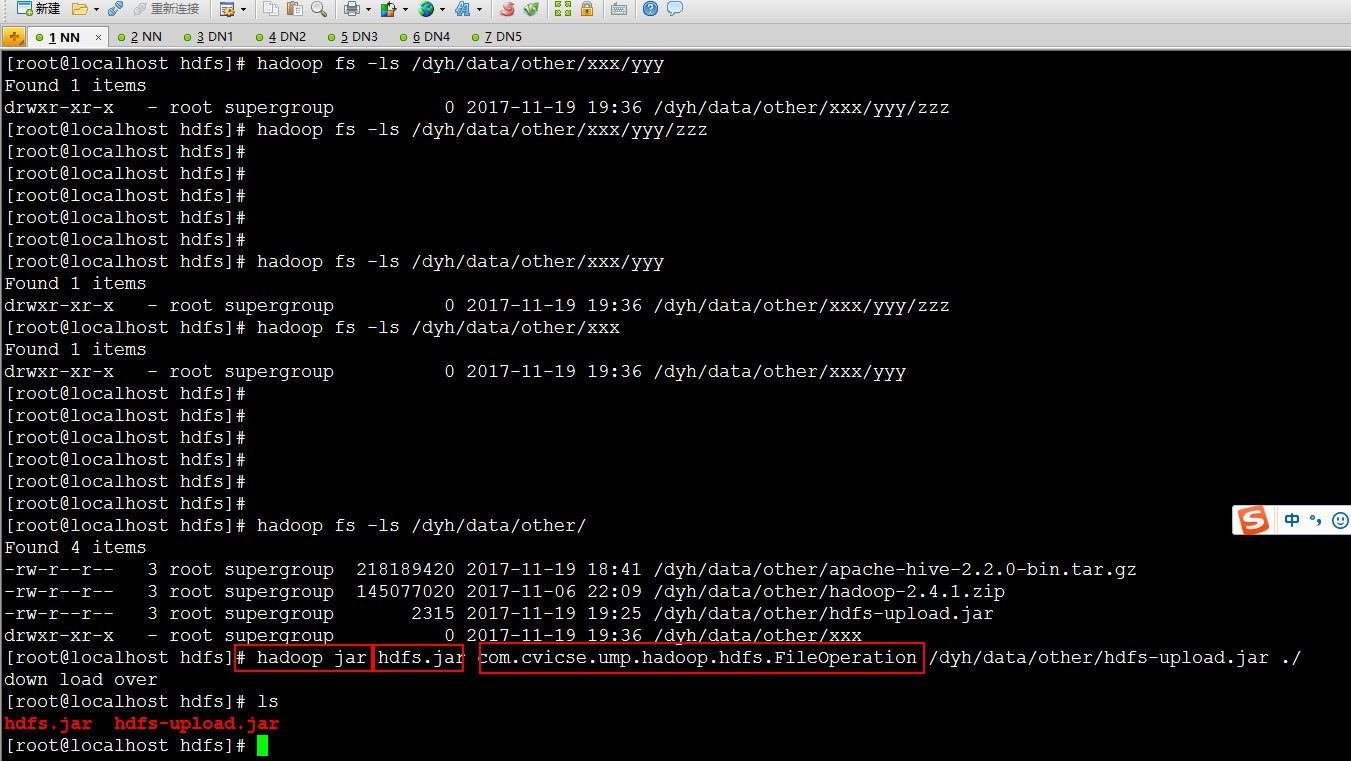

导出jar包

上传jar到HADOOP运行环境,并执行

执行命令:hadoop jar jar包名字 main函数所在的类

hadoop-hdfs编程的更多相关文章

- Hadoop HDFS编程 API入门系列之HDFS_HA(五)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs3; import java.io.FileInputStream;import ...

- Hadoop HDFS编程 API入门系列之简单综合版本1(四)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs4; import java.io.IOException; import ja ...

- Hadoop HDFS编程 API入门系列之HdfsUtil版本2(七)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs1; import java.io.FileInputStream;import ...

- Hadoop HDFS编程 API入门系列之HdfsUtil版本1(六)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs2; import java.io.FileOutputStream;impor ...

- Hadoop HDFS编程 API入门系列之合并小文件到HDFS(三)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs7; import java.io.IOException;import ja ...

- Hadoop HDFS编程 API入门系列之路径过滤上传多个文件到HDFS(二)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs6; import java.io.IOException;import jav ...

- Hadoop HDFS编程 API入门系列之从本地上传文件到HDFS(一)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs5; import java.io.IOException; import ja ...

- Hadoop HDFS编程 API入门系列之RPC版本2(九)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.RPC.rpc2; public class LoginServiceImpl implement ...

- Hadoop HDFS编程 API入门系列之RPC版本1(八)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.RPC.rpc1; import java.io.IOException;import java. ...

- Hadoop MapReduce编程 API入门系列之压缩和计数器(三十)

不多说,直接上代码. Hadoop MapReduce编程 API入门系列之小文件合并(二十九) 生成的结果,作为输入源. 代码 package zhouls.bigdata.myMapReduce. ...

随机推荐

- MySql数据库基础笔记(一)

一.表与库的概念 数据库管理数据,它是以什么样的形式组成的? 生活中的表---->表 table多行多列,传统的数据库都是这样的;声明了表头,一个表创建好了,剩下的就是往表中添加数据 多张表放在 ...

- 八皇后问题的Python实现和C#实现

看到八皇后问题的解决思路, 感觉很喜欢. 我用C#实现的版本之前贴在了百度百科上(https://baike.baidu.com/item/%E5%85%AB%E7%9A%87%E5%90%8E%E9 ...

- web页面中快速找到html对应元素两种方法

一.第一种方法(通过先进入开发模式然后再去选择网页元素) 1.打开IE.Chrome.FireFox等,按 F12 键进入开发模式 2.在打开的控制窗口左上角有个 箭头 按钮,点击它之后,此时将鼠标 ...

- HTTP数据组织方式

HTTP网络传输中的数据组织方式有三种方式: 1.HTML方式 2.XML方式 3.JSON方式 XML介绍:XML称为可扩展标记语言,它与HTML一样,都是SGML(标准通用标记语言) XM ...

- 在环中(Going in Cycle!!, UVa 11090)

[题目描述] 给定一个 n 个点 m 条边的加权有向图,求平均权值最小的回路. [输入格式] 输入第一行为数据组数 T .每组数据第一行为图的点数 n 和边数 m (n ≤ 50).以下 m 行每行3 ...

- 转://UDEV简介及配置过程

在Linux环境下安装Oracle11g RAC时,OS层面配置好多路径软件后(multipath),下一步就需要配置udev或asmlib来处理共享分区(Lun),以便Orace ASM能够看到这些 ...

- 使用ElasticSearch服务从MySQL同步数据实现搜索即时提示与全文搜索功能

最近用了几天时间为公司项目集成了全文搜索引擎,项目初步目标是用于搜索框的即时提示.数据需要从MySQL中同步过来,因为数据不小,因此需要考虑初次同步后进行持续的增量同步.这里用到的开源服务就是Elas ...

- 转载 【.NET基础】--委托、事件、线程(3)

之前的两篇文章我们了解了委托和事件,本文我们看一下线程. 1,一个窗体程序,默认拥有一个线程(相当于一个商店里面,只有一个店员),这个默认的线程叫做 UI线程/主线程. 2,进程和线程的关系: A ...

- nodeJS之crypto模块公钥加密及解密

nodeJS之crypto模块公钥加密及解密 NodeJS有以下4个与公钥加密相关的类.1. Cipher: 用于加密数据:2. Decipher: 用于解密数据:3. Sign: 用于生成签名:4. ...

- vue将表格导出为excel

vue将表格导出为excel 一:在项目中需要安装2个依赖项,如下命令: npm install --save file-saver xlsx 二:在vue文件中如下使用即可: <templat ...