hadoop-hdfs编程

1、开发环境搭建

一、新建一个普通的java工程

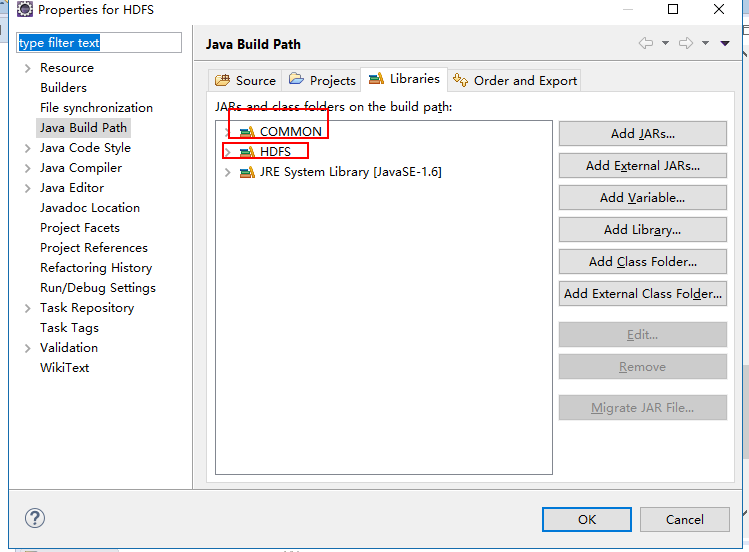

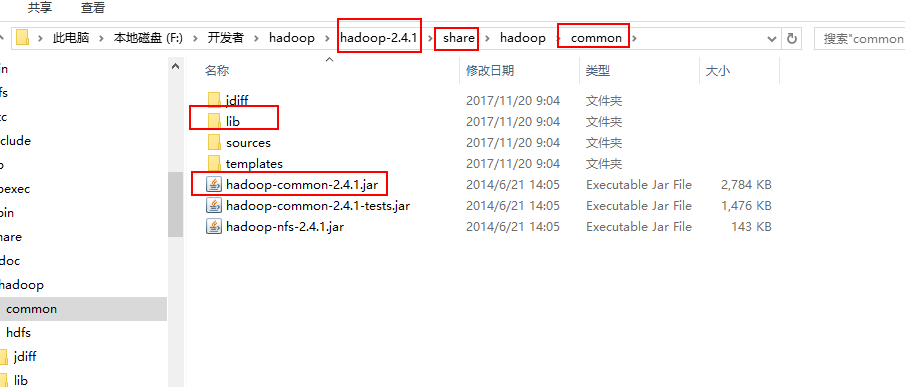

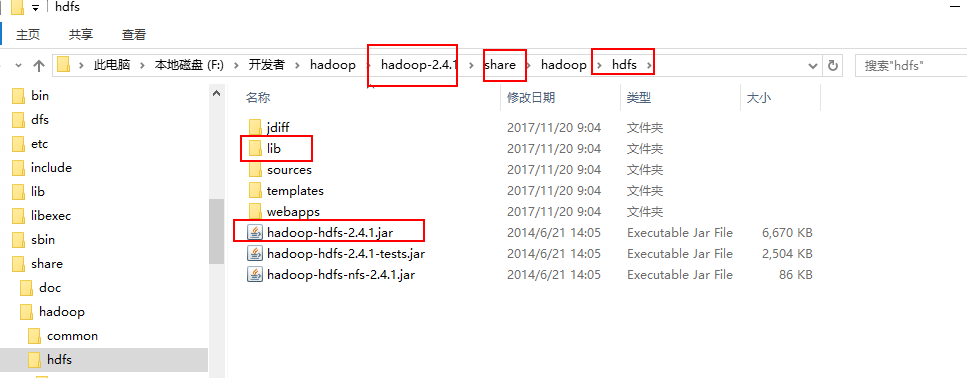

二、引入hdfs相关的jar包

需要引入的jar包:

common下的jar

hdfs下的jar

2、编写HDFS相关的程序

package com.cvicse.ump.hadoop.hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; public class FileOperation { //创建文件

public static void createFile(String dst,byte[] contents) throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path dstPath = new Path(dst);

FSDataOutputStream outputStream = fs.create(dstPath);;

outputStream.write(contents);

outputStream.close();

fs.close();

System.out.println(dst+",文件创建成果");

} //上传文件

public static void uploadFile(String src,String dst) throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path srcPath = new Path(src);

Path dstPath = new Path(dst);

fs.copyFromLocalFile(srcPath, dstPath);

System.out.println("Upload to "+conf.get("fs.default.name"));

System.out.println("------list files---------"+"\n");

FileStatus[] fileStatus = fs.listStatus(dstPath);

for(FileStatus file:fileStatus){

System.out.println(file.getPath());

}

fs.close(); } //删除目录

public static void delete(String filePath)throws Exception{ Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path path = new Path(filePath);

boolean isOk = fs.deleteOnExit(path);

if(isOk){

System.out.println("delete OK.");

}else{

System.out.println("delete failure.");

}

fs.close(); }

//创建目录

public static void mkdir(String path)throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path srcPath = new Path(path);

boolean isOK = fs.mkdirs(srcPath);

if(isOK){

System.out.println("create dir ok!");

}else{

System.out.println("create dir failure!");

}

fs.close();

} //下载文件

public static void downFile(String src,String dst)throws Exception{

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path srcPath = new Path(src);

Path dstPath = new Path(dst); fs.copyToLocalFile(srcPath, dstPath);

System.out.println("down load over"); } public static void main(String[] args) throws Exception {

/*String dst = args[0];

byte[] contents = "hello,dyh".getBytes();

createFile(dst, contents);*/ /*String src = args[0];

String dst = args[1];

uploadFile(src, dst);*/ /*String filePath = args[0];

delete(filePath);*/ /*String path = args[0];

mkdir(path);*/ String src = args[0];

String dst = args[1];

downFile(src, dst);

} }

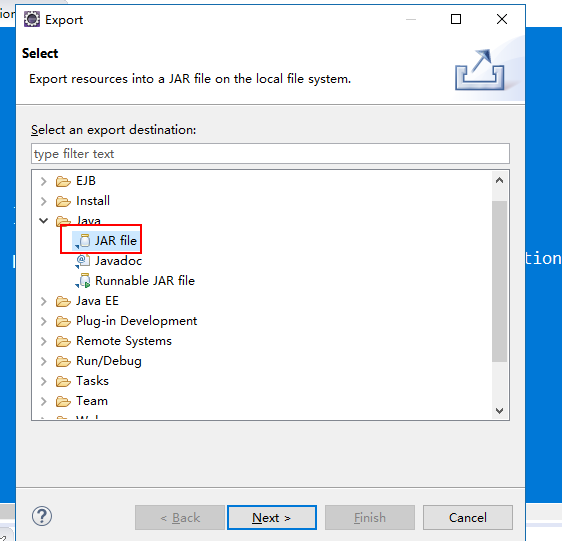

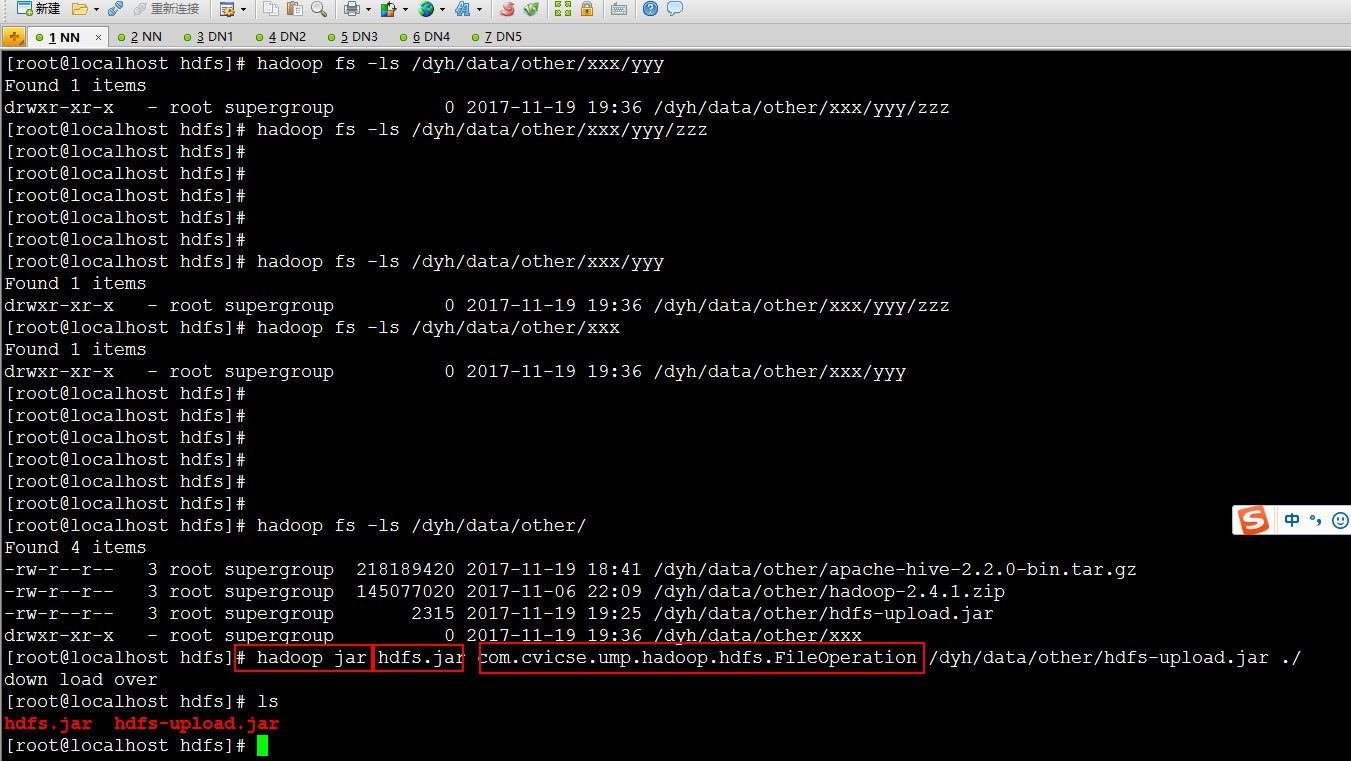

导出jar包

上传jar到HADOOP运行环境,并执行

执行命令:hadoop jar jar包名字 main函数所在的类

hadoop-hdfs编程的更多相关文章

- Hadoop HDFS编程 API入门系列之HDFS_HA(五)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs3; import java.io.FileInputStream;import ...

- Hadoop HDFS编程 API入门系列之简单综合版本1(四)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs4; import java.io.IOException; import ja ...

- Hadoop HDFS编程 API入门系列之HdfsUtil版本2(七)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs1; import java.io.FileInputStream;import ...

- Hadoop HDFS编程 API入门系列之HdfsUtil版本1(六)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs2; import java.io.FileOutputStream;impor ...

- Hadoop HDFS编程 API入门系列之合并小文件到HDFS(三)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs7; import java.io.IOException;import ja ...

- Hadoop HDFS编程 API入门系列之路径过滤上传多个文件到HDFS(二)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs6; import java.io.IOException;import jav ...

- Hadoop HDFS编程 API入门系列之从本地上传文件到HDFS(一)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs5; import java.io.IOException; import ja ...

- Hadoop HDFS编程 API入门系列之RPC版本2(九)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.RPC.rpc2; public class LoginServiceImpl implement ...

- Hadoop HDFS编程 API入门系列之RPC版本1(八)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.RPC.rpc1; import java.io.IOException;import java. ...

- Hadoop MapReduce编程 API入门系列之压缩和计数器(三十)

不多说,直接上代码. Hadoop MapReduce编程 API入门系列之小文件合并(二十九) 生成的结果,作为输入源. 代码 package zhouls.bigdata.myMapReduce. ...

随机推荐

- January 29th, 2018 Week 05th Monday

Losing all hope was freedom. 彻底绝望就是真正的自由. Losing all the hopes, and we are free to challenge everyth ...

- 使用POI读写word docx文件

目录 1 读docx文件 1.1 通过XWPFWordExtractor读 1.2 通过XWPFDocument读 2 写docx文件 2.1 直接通过XWPF ...

- C# X509Certificate类 调用证书

一.命名空间 using System.Security.Cryptography.X509Certificates; 二.调用代码 string certPath = Server.MapPath( ...

- Django复习之ORM

QuerySet数据类型: 1.可切片,可迭代 [obj,....] 2.惰性查询: ...

- dispatchTouchEvent

View /** * Pass the touch screen motion event down to the target view, or this * view if it is the ...

- centos7下安装docker(12.2自定义网络)

通常默认的情况下我们使用的是docker的bridge的网络,用户也可以根据自己的业务需要,创建user-defined docker 提供三种user-defined网络驱动:bridge,over ...

- golang []byte和string相互转换

测试例子 package main import ( "fmt" ) func main() { str2 := "hello" ...

- eclipse+tomcat测试连接时候HTTP Status 404错误

想要在eclipse里部署tomcat,结果tomcat单独可以通过连接测试,用eclipse就404了 404肯定都是目录不对,试了半天在eclipse下改了一下配置和文件位置就行了 1.先在菜单栏 ...

- Win平台阅读Kafka源码时候使用bat脚本时候报错以及解决方案

问题1: 使用bat脚本报错: 解决方案: 在配置好kafka的server.properties文件后,cmd进入命令窗口输入命令:.\bin\windows\kafka-server-start. ...

- HTML5的快速使用和css3的入门知识汇总

各位开发者朋友和技术大神大家好!博主刚开始学习html5 ,自本周开始会每周更新技术博客,与大家分享每周所学.鉴于博主水品有限,如发现有问题的地方欢迎大家指正,有更好的意见和建议可在评论下方发表,我会 ...