从HDFS的写入和读取中,我发现了点东西

摘要:从HDFS的写入和读取中,我们能学习到什么?

本文分享自华为云社区《从HDFS的写入和读取中,我们能学习到什么》,作者: breakDawn 。

最近开发过程涉及了一些和文件读取有关的问题,于是对hdfs的读取机制感到兴趣,顺便深入学习了一下。

写入

- 客户端向NameNode发出写文件请求,告诉需要写的文件名和路径、用户

- NameNode检查是否已存在文件、检查权限。如果通过,会返回一个输出流对象

- 注意此时会按照“日志先行“原则,写入NameNode的editLog

- 客户端按照128MB的大小切分文件。 也就是block大小

- 客户端把nameNode传来的DataNode列表和Data数据一同发送给 最近的第一个DataNode节点。

- 第一个dataNode节点收到数据和DataNode列表时, 会先根据列表,找到下一个自己要连接的最近DataNode, 删除自己后,再一样往下发。以此类推,发完3台或者N台。

- 传输单位是packet,包,比block小一点。

- dataNode每写完一个block块, 则返回ACK信息给上一个节点进行确认。(注意是写完block才确认)

- 写完数据, 关闭输出流, 发送完成信息给DataNode

写过程的核心总结:

- 客户端只向一个dataNode写数据,然后下一个dataNode接着往另一个dataNode写,串联起来。

- 按128MB分block。 每次传数据按pack传。 校验按照chunk 校验,每次chunk都会写入pack。

- 写完block才发ACK确认。

Q: NameNode的editlog有什么用?怎么起作用的?

A:作用:

- 硬盘中需要有一份元数据的镜像——FSImage

- 每次要修改元数据就信息时,必须得改文件(hdfs没有数据库)

- 可能会比较久,改的时候如果断电了,就丢失这个操作了

为了避免丢失,引入editlog,每次修改元数据前,先追加方式写入editlog, 然后再处理,这样即使断电了也能修复。

一般都是那些更改操作有断开风险,为了确保能恢复,都会引入这类操作。

Q: 什么时候发送完成信号? 全部节点都写入完成吗

A:发送完成信号的时机取决于集群是强一致性还是最终一致性,强一致性则需要所有DataNode写完后才向NameNode汇报。最终一致性则其中任意一个DataNode写完后就能单独向NameNode汇报,HDFS一般情况下都是强调强一致性

Q: 怎么验证写入时的数据完整性?

A:

- 因为每个chunk中都有一个校验位,一个个chunk构成packet,一个个packet最终形成block,故可在block上求校验和。

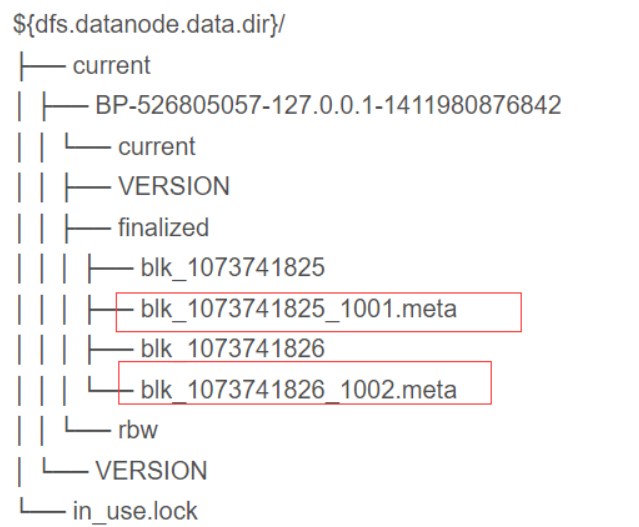

- 当客户端创建一个新的HDFS文件时候,分块后会计算这个文件每个数据块的校验和,此校验和会以一个隐藏文件形式保存在同一个 HDFS 命名空间下。就是.meta文件

- 当client端从HDFS中读取文件内容后,它会检查分块时候计算出的校验和(隐藏文件里)和读取到的文件块中校验和是否匹配,如果不匹配,客户端可以选择从其他 Datanode 获取该数据块的副本。

Q: 写入时怎么确定最近节点?

A:按照按照hadoop时设置的机架、数据中心、节点来估算

假设有数据中心d1机架r1中的节点n1。该节点可以表示为/d1/r1/n1。利用这种标记,这里给出四种距离描述。

- Distance(/d1/r1/n1, /d1/r1/n1)=0(同一节点上的进程)

- Distance(/d1/r1/n1, /d1/r1/n2)=2(同一机架上的不同节点)

- Distance(/d1/r1/n1, /d1/r3/n2)=4(同一数据中心不同机架上的节点)

- Distance(/d1/r1/n1, /d2/r4/n2)=6(不同数据中心的节点)

读取

读取就比较简单了,没有那种复杂的串行过程。NameNode直接告诉客户端去哪读就行了。

- client访问NameNode,查询元数据信息,获得这个文件的数据块位置列表,返回输入流对象。

- 就近挑选一台datanode服务器,请求建立输入流 。

- DataNode向输入流中中写数据,以packet为单位来校验。

- 关闭输入流

从HDFS的写入和读取中,我发现了点东西的更多相关文章

- HDFS 03 - 你能说说 HDFS 的写入和读取过程吗?

目录 1 - HDFS 文件的写入 1.1 写入过程 1.2 写入异常时的处理 1.3 写入的一致性 2 - HDFS 文件的读取 2.1 读取过程 2.2 读取异常时的处理 版权声明 1 - HDF ...

- HDFS写入和读取流程

HDFS写入和读取流程 一.HDFS HDFS全称是Hadoop Distributed System.HDFS是为以流的方式存取大文件而设计的.适用于几百MB,GB以及TB,并写一次读多次的场合.而 ...

- HDFS数据流-剖析文件读取及写入

HDFS数据流-剖析文件读取及写入 文件读取 1. 客户端通过调用FileSystem对象的open方法来打开希望读取的文件,对于HDFS来说,这个对象是分布式文件系统的一个实例.2. Distrib ...

- iOS中plist的创建,数据写入与读取

iOS中plist的创建,数据写入与读取 Documents:应用将数据存储在Documents中,但基于NSuserDefaults的首选项设置除外Library:基于NSUserDefaults的 ...

- 蜗牛爱课- iOS中plist的创建,数据写入与读取

iOS中plist的创建,数据写入与读取功能创建一个test.plist文件-(void)triggerStorage{ NSArray *paths=NSSearchPathForDirect ...

- Java 实现Excel表数据的读取和写入 以及过程中可能遇到的问题

问题1:Unable to recognize OLE stream 格式的问题要可能是因为给的数据是2010年的数据表后缀为.xlsx,要先转化成2003版的后缀为.xls 问题2: Warning ...

- [转]VC++中对文件的写入和读取

本文转自:http://blog.csdn.net/fanghb_1984/article/details/7425705 本文介绍两种方法对文件进行读取和写入操作:1.采用fstream类:2.采用 ...

- 在C#程序中,创建、写入、读取XML文件的方法

一.在C#程序中,创建.写入.读取XML文件的方法 1.创建和读取XML文件的方法,Values为需要写入的值 private void WriteXML(string Values) { //保存的 ...

- ResquestInfoServlet类通过访问HttpServletRequest对象的各种方法来读取HTTP请求中的特定信息,并且把它们写入到HTML中

ResquestInfoServlet类通过访问HttpServletRequest对象的各种方法来读取HTTP请求中的特定信息,并且把它们写入到HTML中 ResquestInfoServlet.j ...

随机推荐

- opencv笔记--Active contours

Active Contours 也称作 Snake,通过定义封闭区域曲线的能量函数,并使其最小化得到最终曲线. Active Contours 被用作物体边界精确定位上,opencv 给出了一个实现, ...

- Redis持久化、主从与哨兵架构详解

目录 Redis持久化 RDB快照(snapshot) AOF(append-only file) AOF重写 Redis 4.0 混合持久化 Redis数据备份策略: Redis主从架构 Redis ...

- ReentrantLock与synchronized比较分析

ReentrantLock:完成了Lock接口,是一个可重入锁,并且支持线程公正竞赛和非公正竞赛两种形式,默认情况下对错公正形式.ReentrantLock算是synchronized的补充和替代计划 ...

- Numpy的各种下标操作

技术背景 本文所使用的Numpy版本为:Version: 1.20.3.基于Python和C++开发的Numpy一般被认为是Python中最好的Matlab替代品,其中最常见的就是各种Numpy矩阵类 ...

- java: 程序包com.sun.media.jai.codec不存在

Q:IDEA编译时提示"java: 程序包com.sun.media.jai.codec不存在" A:添加下面的repository到pom.xml中 <repository ...

- 自动同步bing壁纸

在百度搜东西,经常出来一大坨广告:要么就是复制粘贴文章.完全没有创新,搜索越来越困难.偶尔用一下bing还挺好用. bing的壁纸是真心好看,每天不重样.决定写个脚本同步一下它的壁纸. 一.以我的Wi ...

- Linux系统日志清除实验

实验目的 1.了解Linux日志的作用. 2.掌握删除Linux日志的方法. 实验原理 所谓日志(Log)是指系统所指定对象的某些操作和其操作结果按时间有序的集合.每个日志文件由日志记录组成,每条日志 ...

- OpenStack学习系列之十二:安装ceph并对接OpenStack

Ceph 是一种为优秀的性能.可靠性和可扩展性而设计的统一的.分布式文件系统.Ceph 的统一体现在可以提供文件系统.块存储和对象存储,分布式体现在可以动态扩展.在国内一些公司的云环境中,通常 ...

- Spring Cloud Sleuth 和 Zipkin 进行分布式跟踪使用指南

分布式跟踪允许您跟踪分布式系统中的请求.本文通过了解如何使用 Spring Cloud Sleuth 和 Zipkin 来做到这一点. 对于一个做所有事情的大型应用程序(我们通常将其称为单体应用程序) ...

- 【windows 访问控制】七、window 访问控制编辑器(Access Control Editor)

window 访问控制编辑器(Access Control Editor) 右键(文件.目录.程序)>选择属性>安全>高级 进入访问控制编辑器