Linux下配置Hadoop伪分布式环境

1. 准备Linux环境

提示:我用的系统是CentOS 6.4。

1.0点击VMware快捷方式,右键打开文件所在位置 -> 双击vmnetcfg.exe -> VMnet1 host-only ->修改subnet ip 设置网段:192.168.1.0 子网掩码:255.255.255.0 -> apply -> ok

回到windows --> 打开网络和共享中心 -> 更改适配器设置 -> 右键VMnet1 -> 属性 -> 双击IPv4 -> 设置windows的IP:192.168.1.100 子网掩码:255.255.255.0 -> 点击确定

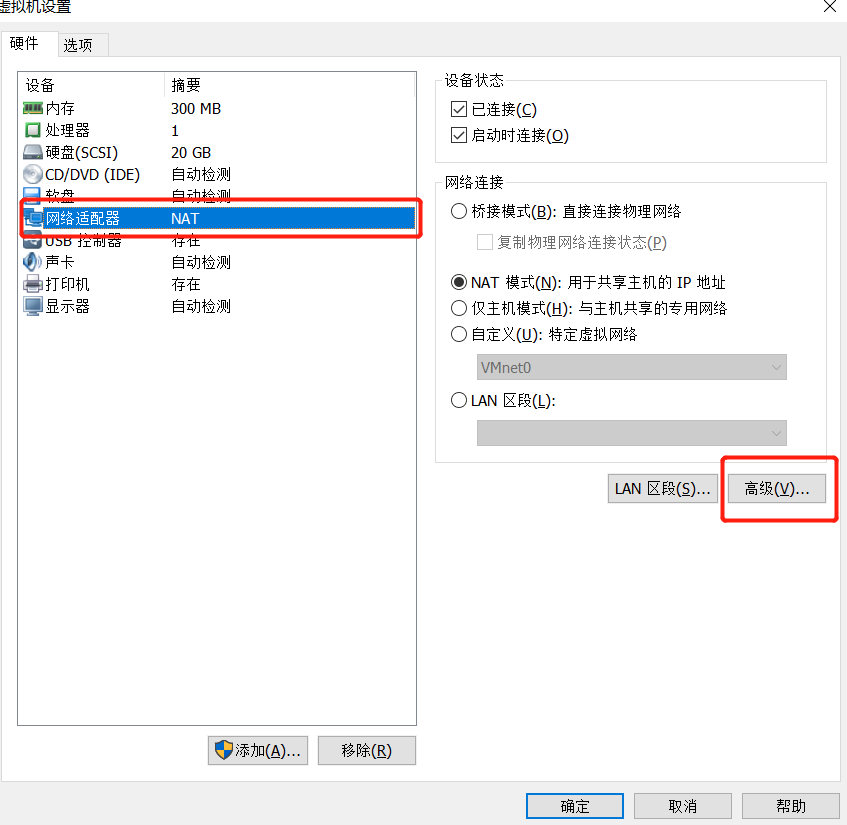

在虚拟软件上 --My Computer -> 选中虚拟机 -> 右键 -> settings -> network adapter -> host only -> ok

1.1修改主机名

vim /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=weekend110 ###

1.2修改IP

两种方式:

第一种:通过Linux图形界面进行修改(强烈推荐)

进入Linux图形界面 -> 右键点击右上方的两个小电脑 ->

点击Edit connections ->

选中当前网络System eth0 ->

点击edit按钮 ->

选择IPv4 ->

method选择为manual ->

点击add按钮 ->

添加IP:192.168.230.134

子网掩码:255.255.255.0

网关:192.168.230.1 -> apply

第二种:修改配置文件方式

vim /etc/sysconfig/network-scripts/ifcfg-eth0

DEVICE="eth0"

BOOTPROTO="static" ###

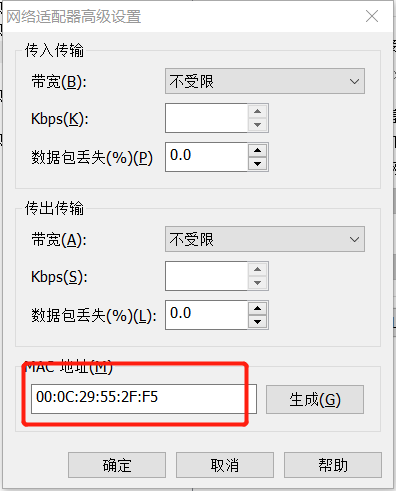

HWADDR="00:0C:29:3C:BF:E7"

IPV6INIT="yes"

NM_CONTROLLED="yes"

ONBOOT="yes"

TYPE="Ethernet"

UUID="ce22eeca-ecde-4536-8cc2-ef0dc36d4a8c"

IPADDR="192.168.230.134" ###

NETMASK="255.255.255.0" ###

GATEWAY="192.168.230.1" ###

修改完成后,执行sudo service network restart

但是可能会报错:Error:No suitable device found: no device found for connection "System eth0"

按照下面的方式找MAC地址,然后把刚才配置文件中的HWADDR进行修改即可。

参考:https://blog.csdn.net/seven_zhao/article/details/43429571

https://jingyan.baidu.com/article/ff42efa9d58ae4c19e2202a1.html

=======================================================

DEVICE=eth2

BOOTPROTO=static

HWADDR=00:0C:29:66:ED:93

ONBOOT=yes

NETMASK=255.255.255.0

IPADDR=10.129.64.11

USERCTL=no

IPV6INIT=no

NM_CONTROLLED=yes

GATEWAY=10.129.64.1

TYPE=Ethernet

1.3修改主机名和IP的映射关系

vim /etc/hosts

192.168.230.134 weekend110

1.4关闭防火墙

#查看防火墙状态

service iptables status

#关闭防火墙

service iptables stop

#查看防火墙开机启动状态

chkconfig iptables --list

#关闭防火墙开机启动

chkconfig iptables off

1.5重启Linux

reboot

注:Ubuntu系统可能用secureCRT无法连接,是因为Ubuntu默认没有ssh,安装一个即可

sudo apt-get install openssh-server openssh-client

2. 安装JDK

2.1上传alt+p 后出现sftp窗口,然后put d:\xxx\yy\ll\jdk-7u_65-i585.tar.gz

2.2解压jdk

#创建文件夹

mkdir /home/hadoop/app

#解压

tar -zxvf jdk-7u55-linux-i586.tar.gz -C /home/hadoop/app

2.3将java添加到环境变量中

vim /etc/profile

#在文件最后添加

export JAVA_HOME=/home/hadoop/app/jdk-7u_65-i585

#刷新配置

source /etc/profile

3. 安装hadoop

先上传hadoop的安装包到服务器上去/home/hadoop/

注意:hadoop2.x的配置文件$HADOOP_HOME/etc/hadoop

伪分布式需要修改5个配置文件

3.1配置hadoop

第一个:hadoop-env.sh

vim hadoop-env.sh

#第27行

export JAVA_HOME=/home/hadoop/app/jdk1.7.0_65

第二个:core-site.xml

<!-- 指定HADOOP所使用的文件系统schema(URI),HDFS的老大(NameNode)的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://weekend110:9000(端口号默认就是9000)</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/app/hadoop-2.4.1/data</value>

</property>

第三个:hdfs-site.xml

<!-- 指定HDFS副本的数量 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<!-- 下面是配置SecondaryNameNode的IP,可以不用配置 -->

<property>

<name>dfs.secondary.http.address</name>

<value>192.168.230.134:50090</value>

</property>

第四个:mapred-site.xml (mv mapred-site.xml.template mapred-site.xml)

mv mapred-site.xml.template mapred-site.xml

vim mapred-site.xml

<!-- 指定mr运行在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

第五个:yarn-site.xml

<!-- 指定YARN的老大(ResourceManager)的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>weekend110</value>

</property>

<!-- reducer获取数据的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

3.2将hadoop添加到环境变量

vim /etc/proflie

export JAVA_HOME=/home/hadoop/app/jdk1.7.0_65

export HADOOP_HOME=/home/hadoop/app/hadoop-2.4.1

source /etc/profile

3.3格式化namenode(是对namenode进行初始化)

hdfs namenode -format (hadoop namenode -format)

3.4启动hadoop

先启动HDFS

sbin/start-dfs.sh

再启动YARN

sbin/start-yarn.sh

3.5验证是否启动成功

使用jps命令验证

27408 NameNode

28218 Jps

27643 SecondaryNameNode

28066 NodeManager

27803 ResourceManager

27512 DataNode

http://192.168.230.134:50070 (HDFS管理界面)

http://192.168.230.134:8088 (MR管理界面)

4. 配置ssh免登陆

在hadoop主机上,

#删除.ssh文件

rm -rf ~/.ssh

#生成ssh免登陆密钥

ssh-keygen -t rsa (三个回车)

ssh-copy-id localhost

下面是不用ssh-copy-id localhost的另外一种方式(了解即可)

执行完这个命令后,会生成两个文件id_rsa(私钥)、id_rsa.pub(公钥)

将公钥拷贝到要免登陆(chenchi)的机器上

sudo scp id_rsa.pub chenchi:/home/chenchi

接下来,在chenchi主机上,先去到目录/home/hadoop/.ssh

再touch authorized_keys

改权限sudo chmod 600 authorized_keys

将拷贝过来的公钥追加到authorized_keys文件后面

cat ../id_rsa.pub >>authorized_keys

与此同时,在hadoop主机上,先去到目录/home/hadoop/.ssh

再touch authorized_keys

改权限sudo chmod 600 authorized_keys

将自己的公钥追加到authorized_keys文件后面

cat id_rsa.pub >>authorized_keys

Linux下配置Hadoop伪分布式环境的更多相关文章

- Linux下配置Hadoop全分布式环境

1. 前提 部署全分布式环境,我们肯定不能在一台服务器上了,这里我用了7台服务器,在VMware上开了7个虚拟机,如下图所示: 我基本配置了一晚上才搞定,第一次配置一般都有错,这时候不妨去到hadoo ...

- CentOS7下Hadoop伪分布式环境搭建

CentOS7下Hadoop伪分布式环境搭建 前期准备 1.配置hostname(可选,了解) 在CentOS中,有三种定义的主机名:静态的(static),瞬态的(transient),和灵活的(p ...

- Hadoop学习笔记(一):ubuntu虚拟机下的hadoop伪分布式集群搭建

hadoop百度百科:https://baike.baidu.com/item/Hadoop/3526507?fr=aladdin hadoop官网:http://hadoop.apache.org/ ...

- 基于Centos搭建 Hadoop 伪分布式环境

软硬件环境: CentOS 7.2 64 位, OpenJDK- 1.8,Hadoop- 2.7 关于本教程的说明 云实验室云主机自动使用 root 账户登录系统,因此本教程中所有的操作都是以 roo ...

- 【Hadoop离线基础总结】CDH版本Hadoop 伪分布式环境搭建

CDH版本Hadoop 伪分布式环境搭建 服务规划 步骤 第一步:上传压缩包并解压 cd /export/softwares/ tar -zxvf hadoop-2.6.0-cdh5.14.0.tar ...

- 《OD大数据实战》Hadoop伪分布式环境搭建

一.安装并配置Linux 8. 使用当前root用户创建文件夹,并给/opt/下的所有文件夹及文件赋予775权限,修改用户组为当前用户 mkdir -p /opt/modules mkdir -p / ...

- Hadoop伪分布式环境搭建+Ubuntu:16.04+hadoop-2.6.0

Hello,大家好 !下面就让我带大家一起来搭建hadoop伪分布式的环境吧!不足的地方请大家多交流.谢谢大家的支持 准备环境: 1, ubuntu系统,(我在16.04测试通过.其他版本请自行测试, ...

- [转]搭建Hadoop伪分布式环境

https://my.oschina.net/MyHeaven1987/blog/1821509 http://hadoop.apache.org/docs/current/hadoop-projec ...

- Ubuntu16.04 下 hadoop的安装与配置(伪分布式环境)

一.准备 1.1创建hadoop用户 $ sudo useradd -m hadoop -s /bin/bash #创建hadoop用户,并使用/bin/bash作为shell $ sudo pass ...

随机推荐

- win8.1安装开发工具 vs2015 Visual Studio 2015 Preview Downloads

1.首先全新安装win8.1 略 破解激活.... 2.安装Visual Studio 2015 Visual Studio 2015 是免费的,不存在破解版本, 如果安装过程中存在问题,建议先把本文 ...

- auto_ptr

1. int *pi = new int(1024); delete pi; // 释放pi指向的int对象占用的内存空间 pi = 0; // 将pi设置为0,不指向任何东西,为Null 注意:删除 ...

- 解决Fiddler不能监听Java HttpURLConnection请求的方法

在默认情况下,Fiddler不能监听Java HttpURLConnection请求.究其原因,Java的网络通信协议栈可能浏览器的通信协议栈略有区别,Fiddler监听Http请求的原理是 在应用程 ...

- 算法笔记_145:拓扑排序的应用(Java)

目录 1 问题描述 2 解决方案 1 问题描述 给出一些球,从1~N编号,他们的重量都不相同,也用1~N标记加以区分(这里真心恶毒啊,估计很多WA都是因为这里),然后给出一些约束条件,< a ...

- Linux下的编译器(转)

转自:http://ju.outofmemory.cn/entry/2051 简单的说,编译器就是一个可执行程序,它专门用于将程序员易于编写的高级语言 (如 C 语言) 翻译为机器可以识别的低级语言. ...

- HttpClient设置超时(转)

HttpClient 4.5版本设置连接超时时间-CloseableHttpClient设置Timeout(区别于4.3.2) HttpClient升级到4.5版本后,API有很多变化,HttpCl ...

- mini2440裸机试炼之——看门狗中断和复位操作

看门狗的工作原理: 设本系统程序完整执行一周期的时间是Tp,看门狗的定时周期为Ti,Ti>Tp,在程序正常执行时,定时器就不会溢出,若因为干扰等原因使系统不能在Tp时刻改动定时器的记数值,定时器 ...

- 【JS】jQuery设置定时器,访问服务器(PHP示例)配合微信、支付宝原生支付,跳转web网页

废话不多说,直接上代码: 把下面的js放在html的</body>即可 <!-- 设置页面定时器,3秒查询一次数据库该订单状态,ok就跳走 --xzz1115> <scr ...

- 关闭mysql慢查询日志

开启mysql慢日志 MySQL的慢查询日志是MySQL提供的一种日志记录,它用来记录在MySQL中响应时间超过阀值的语句,具体指运行时间超过long_query_time值的SQL,则会被记录到慢查 ...

- Linux命令-网络命令:wall

wall hello word 向所有登录用户发送消息hello world root用户自己也会收到消息,wangyunpeng用户收到消息如下图: