cdh版本的hadoop安装及配置(伪分布式模式) MapReduce配置 yarn配置

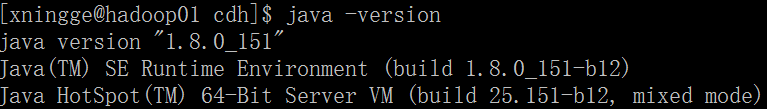

安装hadoop需要jdk依赖,我这里是用jdk8

jdk版本:jdk1.8.0_151

hadoop版本:hadoop-2.5.0-cdh5.3.6

hadoop下载地址:链接:https://pan.baidu.com/s/1qZNeVFm 密码:ciln

jdk下载地址:链接:https://pan.baidu.com/s/1qZLddl6 密码:c9w3

一切准备好以后,开始安装

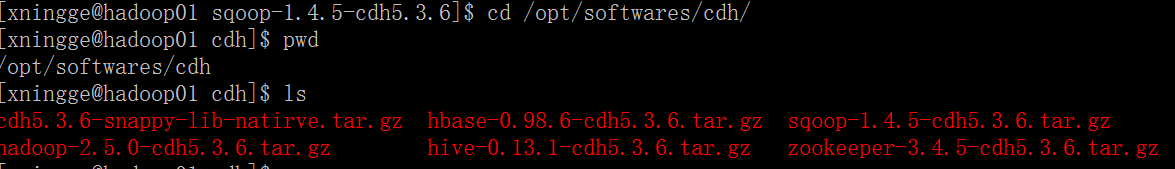

1、上传hadoop软件包和jdk软件包到Linux系统指定目录:/opt/softwares/cdh

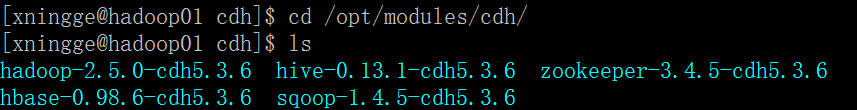

2、解压 hadoop软件包和jdk软件包到指定目录:/opt/modules/cdh/

解压命令:tar -zxvf hadoop-2.5.0-cdh5.3.6.tar.gz -C /opt/modules/cdh/

tar -zxvf jdk-8u151-linux-x64.tar.gz -C /opt/modules/cdh

3、jdk环境变量配置

在/etc/profile文件中配置

3.1 sudo vi /etc/profile

==========================================================================

#JAVA_HOME#

export JAVA_HOME=/opt/modules/jdk1.8.0_151

export CLASSPATH=.:$JAVA_HOME/jre/lib/rt.jar:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$PATH:$JAVA_HOME/bin

==========================================================================

3.2 source /etc/profile

4、测试java是否已经安装成功

4.1 java -version

5、hadoop配置

5.1 删除hadoop/share/doc

5.2 修改配置文件

3个?-env,sh文件(hadoop,mapred,yarn)

export JAVA_HOME=/opt/modules/jdk1.8.0_151

4个?-site.xml文件(core-site.xml 、hdfs-site.xml、mapred-site.xml、yarn-site.xml)

core-site.xml

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop01.xningge.com:8020</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/modules/cdh/hadoop-2.5.0-cdh5.3.6/data/tmp</value>

</property>

hdfs-site.xml

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop01.xningge.com:50090</value>

</property>

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

mapred-site.xml

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop01.xningge.com:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop01.xningge.com:19888</value>

</property>

yarn-site.xml

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop01.xningge.com</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>86400</value>

</property>

1个slaves

hadoop01.xningge.com

6、格式化namenode

$ bin/hdfs namenode -format

7、开启各服务

$ sbin/hadoop-daemon.sh start namenode

$ sbin/hadoop-daemon.sh start datanode

$ sbin/hadoop-daemon.sh start secondarynamenode

$ sbin/mr-jobhistory-daemon.sh start historyserver

$ sbin/yarn-daemon.sh start resourcemanager

$ sbin/yarn-daemon.sh start nodemanager

配置SSH免密登陆可使用:

$ sbin/start-dfs.sh

$ sbin/start-yarn.sh

$ sbin/start-all.sh

8、基本测试

$ bin/hdfs dfs -mkdir -p /user/xningge/mapreduce/input

$ bin/hdfs dfs -put /opt/datas/wc.input /user/xningge/mapreduce/input

$ bin/hdfs dfs -get /user/xningge/mapreduce/input/wc.input /

$ bin/hdfs dfs -cat /user/xningge/mapreduce/input/wc.input

9、跑一个简单的job

$ bin/yarn jar share/hadoop/mapreduce2/hadoop-mapreduce-examples-2.5.0-cdh5.3.6.jar wordcount /user/xningge/mapreduce/input /user/xningge/mapreduce/output

cdh版本的hadoop安装及配置(伪分布式模式) MapReduce配置 yarn配置的更多相关文章

- 云计算课程实验之安装Hadoop及配置伪分布式模式的Hadoop

一.实验目的 1. 掌握Linux虚拟机的安装方法. 2. 掌握Hadoop的伪分布式安装方法. 二.实验内容 (一)Linux基本操作命令 Linux常用基本命令包括: ls,cd,mkdir,rm ...

- 使用docker搭建hadoop环境,并配置伪分布式模式

docker 1.下载docker镜像 docker pull registry.cn-hangzhou.aliyuncs.com/kaibb/hadoop:latest 注:此镜像为阿里云个人上传镜 ...

- 06_Hadoop配置伪分布式模式详解

查看IP地址,设为手动模式: 配置hadoop用户sudo权限 su切换到root身份,配置vim /etc/sudoers文件,加入 hadoop ALL=(root)NOPASSWD:ALL ...

- Hadoop安装教程_伪分布式

文章更新于:2020-04-09 注1:hadoop 的安装及单机配置参见:Hadoop安装教程_单机(含Java.ssh安装配置) 注2:hadoop 的完全分布式配置参见:Hadoop安装教程_分 ...

- Hadoop Single Node Setup(hadoop本地模式和伪分布式模式安装-官方文档翻译 2.7.3)

Purpose(目标) This document describes how to set up and configure a single-node Hadoop installation so ...

- 初学者值得拥有【Hadoop伪分布式模式安装部署】

目录 1.了解单机模式与伪分布模式有何区别 2.安装好单机模式的Hadoop 3.修改Hadoop配置文件---五个核心配置文件 (1)hadoop-env.sh 1.到hadoop目录中 2.修 ...

- hadoop 2.7.3伪分布式环境运行官方wordcount

hadoop 2.7.3伪分布式模式运行wordcount 基本环境: 系统:win7 虚机环境:virtualBox 虚机:centos 7 hadoop版本:2.7.3 本次以伪分布式模式来运行w ...

- Hadoop伪分布式模式部署

Hadoop的安装有三种执行模式: 单机模式(Local (Standalone) Mode):Hadoop的默认模式,0配置.Hadoop执行在一个Java进程中.使用本地文件系统.不使用HDFS, ...

- cdh版本的hue安装配置部署以及集成hadoop hbase hive mysql等权威指南

hue下载地址:https://github.com/cloudera/hue hue学习文档地址:http://archive.cloudera.com/cdh5/cdh/5/hue-3.7.0-c ...

随机推荐

- 图的遍历(Python实现)

图的遍历(Python实现) 记录两种图的遍历算法——广度优先(BFS)与深度优先(DFS). 图(graph)在物理存储上采用邻接表,而邻接表是用python中的字典来实现的. 两种遍历方式的代码如 ...

- mysql日志管理#二进制日志详解

查看MySQL二进制文件中的内容有两种方式 mysqlbinlog SHOW BINLOG EVENTS [IN 'log_name'] [FROM pos] [LIMIT [offset,] row ...

- Java学习笔记四:Java的八种基本数据类型

Java的八种基本数据类型 Java语言提供了八种基本类型.六种数字类型(四个整数型,两个浮点型),一种字符类型,还有一种布尔型. Java基本类型共有八种,基本类型可以分为三类,字符类型char,布 ...

- ts包、表、子表、section的关系

我们经常接触到创建 DEMUX,注册 Filter 过滤数据, 通过回调过滤出 section 数据,然后我们对 section 数据做具体的解析或者其他操作. 我们这里说的 section 就是段的 ...

- 实验7 shell程序设计二(1)

编写一个shell过程完成如下功能(必须在脚本中使用函数)1.程序接收3个参数:$1/$2和$3,合并两个文件$1/$2为$3,并显示,三个文件均为文本文件.2.如果文件$3不存在,那么先报告缺少$3 ...

- 10---git安装

卸载原来的版本: # 查看版本 git --version # 移除原来的版本 yum remove git 安装依赖库: yum install curl-devel expat-devel get ...

- idea 普通文件夹 转换成 module

经常会遇到从GitHub上download的progect在idea里面打开是普通文件夹形式,而并不是我们想要的module形式(文件夹图标右下角有个蓝色的tag),那么如何快速转换成我们想要的mod ...

- HBase import tsv,csv File

一,HBase中创建table 表(liupeng:test)并创建 info ,contect 列簇 hbase(main):258:0> create "liupeng:Test& ...

- 源码-集合:ArrayList

只是文章摘录,还未研究 JAVA ArrayList详细介绍(示例) http://www.jb51.net/article/42764.htm Jdk1.6 JUC源码解析汇总 - 永远保持敬畏之心 ...

- 【java并发编程实战】第八章:线程池的使用

1.线程饥饿锁 定义:在线程池中,如果任务的执行依赖其他任务,那么可能会产生线程饥饿锁.尤其是单线程线程池. 示例: public class ThreadDeadStarveTest { publi ...