Pytorch学习笔记(一)---- 基础语法

书上内容太多太杂,看完容易忘记,特此记录方便日后查看,所有基础语法以代码形式呈现,代码和注释均来源与书本和案例的整理。

# -*- coding: utf-8 -*-

# All codes and comments from <<深度学习框架Pytorch入门与实践>>

# Code url : https://github.com/zhouzhoujack/pytorch-book

# lesson_1 : Basic code syntax of PT(Pytorch)

import torch as t

import numpy as np

# 1.The version of torch

print(t.__version__) # version is 1.0.1

# 2.The defination of tensor

x = t.Tensor(5, 3) # 构建 5x3 矩阵,只是分配了空间,未初始化

x = t.Tensor([[1,2],[3,4]])

# 3.Initialize tensor by [0,1] uniform distribution

x = t.rand(5, 3)

print(x, x.size()[0]) # torch.Size 是tuple对象的子类,因此它支持tuple的所有操作,如x.size()[0]

# 4.Addition

x = t.rand(5, 3)

y = t.rand(5, 3)

print("first method: ", x + y)

print("second method: ", t.add(x,y))

result = t.Tensor(5, 3) # 加法的第三种写法:指定加法结果的输出目标为result,预先分配空间

t.add(x, y, out=result) # 结果存到result

print("thid method: ", result) # 函数名后面带下划线_ 的函数会修改Tensor本身。x.add_(y)会改变x,但x.add(y)返回一个新的Tensor,x不变

# 5.Tensor <-> Numpy

a = t.ones(5)

b = a.numpy()

print(b) # array([1., 1., 1., 1., 1.], dtype=float32)

a = np.ones(5)

b = t.from_numpy(a)

print(b) # tensor([1., 1., 1., 1., 1.], dtype=torch.float64)

# 6.Get specific index from a tensor

a = t.rand(5)

scalar = a[0]

print(scalar,scalar.size()) # 0-dim tensor

print(scalar.item()) # 使用scalar.item()能从中取出python对象的数值

# 7.Autograd

# 在Tensor上的所有操作,autograd都能为它们自动提供微分

# 使得Tensor使用autograd功能,只需要设置tensor.requries_grad=True.

# Variable正式合并入Tensor, Variable本来实现的自动微分功能,Tensor就能支持

# Variable主要包含三个属性:

# data:保存Variable所包含的Tensor

# grad:保存data对应的梯度,grad也是个Variable,而不是Tensor,它和data的形状一样。

# grad_fn:指向一个Function对象,这个Function用来反向传播计算输入的梯度

x = t.ones(2, 2, requires_grad=True) # 为tensor设置 requires_grad 标识,代表着需要求导数

y = x.sum()

y.backward() # 反向传播,计算梯度

print(x.grad) # tensor([[ 1., 1.],[ 1., 1.]])

x.grad.data.zero_() # grad在反向传播过程中是累加的,每一次运行反向传播,梯度都会累加之前的梯度,所以反向传播之前需把梯度清零。

print(x.grad) # tensor([[ 0., 0.],[ 0., 0.]])

新建Tensor的几种方法

| 函数 | 功能 |

|---|---|

| Tensor(*sizes) | 基础构造函数 |

| tensor(data,) | 类似np.array的构造函数 |

| ones(*sizes) | 全1Tensor |

| zeros(*sizes) | 全0Tensor |

| eye(*sizes) | 对角线为1,其他为0 |

| arange(s,e,step) | 从s到e,步长为step |

| linspace(s,e,steps) | 从s到e,均匀切分成steps份 |

| rand/randn(*sizes) | 均匀/标准正态分布 |

| normal(mean,std)/uniform(from,to) | 正态分布/均匀分布 |

| randperm(m) | 随机排列 |

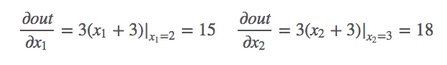

Backward()详解

对上面的y.backward() 运行原理还不是很熟悉,特此记录一下:

backward()函数用于反向求导数,使用链式法则求导,当自变量为不同变量形式时,求导方式和结果有变化。

1.scalar标量

import torch as t

from torch.autograd import Variable

a = Variable(t.FloatTensor([2, 3]), requires_grad=True) # 这里为一维标量

b = a + 3

c = b * b * 3

out = c.mean()

out.backward()

print(a.grad) # tensor([15., 18.])

2.张量

# y1 = x1^2 y2 = x2^3

# dy1/dx1 | x1=2 = 2*x1 = 2*2 =4

# dy2/dx2 | x2=3 = 3*x2*x2 = 27

m = Variable(t.FloatTensor([[2, 3]]), requires_grad=True) # 注意这里有两层括号,非标量

n = Variable(t.zeros(1, 2))

n[0, 0] = m[0, 0] ** 2

n[0, 1] = m[0, 1] ** 3

n.backward(t.Tensor([[1, 1]]),retain_graph=True) # 这里[[1, 1]]作为梯度的系数看待

print(m.grad) # tensor[[4,27]]

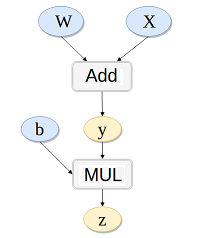

3.链式求导(还有疑问)

z = (w+x)Tb 其中:dz/dx = dz/dw= z, dz/db = w+x = y , dz/dy = b

# y = x*w

# z = y + b

# k.backward(p)接受的参数p必须要和k的大小一样,x.grad = p*dk/dx

w = Variable(t.randn(3), requires_grad=True)

x = Variable(t.randn(3), requires_grad=True)

b = Variable(t.randn(3), requires_grad=True)

y = w + x

z = y.dot(b)

y.backward(b,retain_graph=True)

print(x.grad,w.grad,b) # x.gard=w.gard=b

参考资料

Backward()详解:http://www.mamicode.com/info-detail-2167311.html

Pytorch学习笔记(一)---- 基础语法的更多相关文章

- Java学习笔记之---基础语法

Java学习笔记之---基础语法 一. Java中的命名规范 (一)包名 由多个单词组成时,所有字母小写(例如:onetwo) (二)类名和接口 由多个单词组成时,所有单词首字母大写(例如:OneTw ...

- Hive学习笔记:基础语法

Hive基础语法 1.创建表 – 用户表 CREATE [EXTERNAL外部表] TABLE [IF NOT EXISTS 是否存在] HUserInfo ( userid int comment ...

- 【C语言C++编程学习笔记】基础语法,第一个简单的实例编程入门教程!

C语言/C++编程学习:一个简单的实例 让我们来看一个简单的C语言程序.从下面的程序可以看出编写C语言程序的一些基本特征. 如果你能知道该程序将会在显示器上显示一些内容,那说明你还是知道一些的! ...

- PHP学习笔记01——基础语法

<!DOCTYPE html> <html> <?php // 1.使用$加变量名来表示变量,php是弱类型语言,不要求在使用变量前声明,第一次赋值时变量才被创建 $a ...

- 01-Python学习笔记-基础语法

Python标识符 -d 在解析时显示调试信息 -O 生成优化代码 ( .pyo 文件 ) -S 启动时不引入查找Python路径的位置 - ...

- java学习笔记之基础语法(一)

1.java语言基础由关键字.标识符.注释.常量和变量.运算符.语句.函数和数组等组成. 2.1关键字 定义:被java语言赋予了特殊含义的单词 特点:关键字中所有的字母都是小写. 2.2用于定义数据 ...

- Java学习笔记之基础语法(顺序,条件,循环语句)

顺序结构:自上而下 条件分支选择结构: if条件语句 1,一旦某一个分支确定执行以后,其他分支就不会执行.if后面的条件必须是boolean类型 2,if 后面如果不加大括号,默认相邻的下一 ...

- Java学习笔记之基础语法(数据类型)

8种基本数据类型 整型: byte[1字节] short[2字节] int[4字节] long[8字节] 1,四种整型之间的区别:申 ...

- Python 学习笔记(基础语法 restful 、 Flask 和 Requests)

input 函数 #!/usr/bin/env python3 name = input("\n\n按下 enter 键后退出.") print(name) print() 在 p ...

- JavaWeb学习笔记——jsp基础语法

1.JSP注释 显式注释 <!-- 注释内容 --> 隐式注释,隐式注释在客户端无法看见 // /* */ <% 注释内容 %> 2.Scriptlet(小脚本程序) 所有嵌入 ...

随机推荐

- Python--day10(函数(使用、分类、返回值))

1. 函数 1. 函数: 完成特定功能的代码块,作为一个整体,对其进行特定的命名,该名字就代表这函数 现实中:很多问题要通过一些工具进行处理 => 可以将工具提前生产出来并命名 =>通 ...

- MR-join连接1......

MR-join连接

- Linux之判断字符串是否为空

help命令可以查看帮助 help test 正确做法: #!/bin/sh STRING= if [ -z "$STRING" ]; then echo "ST ...

- Ubuntu安装Navicat 12 for MySQL

环境准备 要想运行Navicat,必须先安装Wine,这个可以使用下面的命令来安装Wine: ubuntu@ubuntu ~ $ sudo apt-get install wine-stable 安装 ...

- 【MySQL 读书笔记】当我们在执行该查询语句的时候我们在干什么

看了非常多 MySQL 相关的书籍和文章,没有看到过如此优秀的专栏.所以未来一段时间我会梳理读完该专栏的所学所得. 当我们在执行该查询语句的时候我们在干什么 mysql> select * fr ...

- easyui判断下拉列表

{field:'state',title:'状态',width:100, formatter : function(value, row, index){ if (value == 0) { retu ...

- 拒绝回调,拥抱async await

之前使用jquery中ajax,请求的结果需要写在回调函数里面,后面接触到了axios/fetch,使用了es6中Promise进行封装,这种链式结构调用,看起来比之前直观,可是还是没有解决回调的问题 ...

- Python——pyqt5——智能提示(lineEdit/conmbobox)

一.文本框智能补全 completer = QtWidgets.QCompleter(data) completer.setCompletionMode(QtWidgets.QCompleter.Po ...

- word里面对齐用Tab键

1 Tab 组1 2 组2

- JS生成随机数进行循环匹配数组

function RndNum(n) { var rnd = ""; for (var i = 0; i < n; i++) rnd += Math.floor(Math.r ...