flink---实时项目--day01--1. openrestry的安装 2. 使用nginx+lua将日志数据写入指定文件中 3. 使用flume将本地磁盘中的日志数据采集到的kafka中去

1. openrestry的安装

OpenResty = Nginx + Lua,是⼀一个增强的Nginx,可以编写lua脚本实现⾮非常灵活的逻辑

(1)安装开发库依赖

yum install -y pcre-devel openssl-devel gcc curl

(2)配置yum的依赖源

yum install yum-utils

yum-config-manager --add-repo https://openresty.org/package/centos/openresty.repo

(3)安装OpenResty

yum install openresty

安装过程中出现问题的解决办法

cd /etc/yum.repos.d

yum install wget

wget https://openresty.org/package/centos/openresty.repo

vi openresty.repo

将https改成http(改两个地方)

yum install openresty

(4)openresty的默认安装⽬目录

/usr/local/openresty

(5)启动openresty(Nginx)

/usr/local/openresty/nginx/sbin/nginx

(6)通过浏览器器查看nginx的⻚页⾯面

2. 使用nginx+lua将日志数据写入指定文件中

需求:访问某个地址,nginx页面只显示1*1像素的空图片,然后将日志记录到指定的文件中去

(1)创建存放日志的目录并设置权限

mkdir /logs

chmod o+w /logs

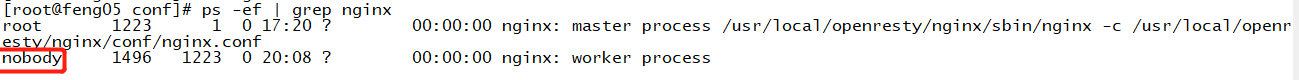

为什么要设置权限呢,因为往logs的access.log文件写日志数据的用户是nobody,如下

(2)vi nginx.conf

location /log.gif{

#伪装成gif文件

default_type 'image/gif';

#关闭access_log

access_log off;

# 使用lua将nginx接受的参数写入到日志文件中

log_by_lua_file 'conf/log.lua';

#返回空图片

empty_gif;

}

(3)在nginx的conf⽬目录下创建⼀一个log.lua⽂文件

vi /usr/local/openresty/nginx/conf/log.lua

log.lua脚本内容如下

-- 引⼊入lua所有解析json的库

local cjson = require "cjson"

-- 获取请求参数列列表

local request_args_tab = ngx.req.get_uri_args()

-- 使⽤用lua的io打开⼀一个⽂文件,如果⽂文件不不存在,就创建,a为append模式

local file = io.open("/logs/access.log", "a")

-- 定义⼀一个json对象

local log_json = {}

-- 将参数的K和V迭代出来,添加到json对象中

for k, v in pairs(request_args_tab) do

log_json[k] = v

end

-- 将json写⼊入到指定的log⽂文件,末尾追加换⾏行行

file:write(cjson.encode(log_json), "\n")

-- 将数据写⼊入

file:flush()

(4)在浏览器上请求feng05/log.gjf,能发现数据写入了/logs/access.log

上诉做法存在一个问题:如果一直往一个⽂件中写入数据,这个日志文件会过大,造成读写效率变低,现在按照小时生成文件

log.lua脚本内容修改如下所示

-- 引⼊入lua⽤用来解析json的库

local cjson = require "cjson"

-- 获取请求参数列列表

local request_args_tab = ngx.req.get_uri_args()

-- 获取当前系统时间

local time = os.date("%Y%m%d%H",unixtime)

-- 使⽤用lua的io打开⼀一个⽂文件,如果⽂文件不不存在,就创建,a为append模式

local path = "/mylog/access-" .. time .. ".log"

local file = io.open(path, "a")

-- 定义⼀一个json对象

local log_json = {}

-- 将参数的K和V迭代出来,添加到json对象中

for k, v in pairs(request_args_tab) do

log_json[k] = v

end

-- 将json写⼊入到指定的log⽂文件,末尾追加换⾏行行

file:write(cjson.encode(log_json), "\n")

-- 将数据写⼊入

file:flush()

这样就会按照时间滚动生成日志文件了

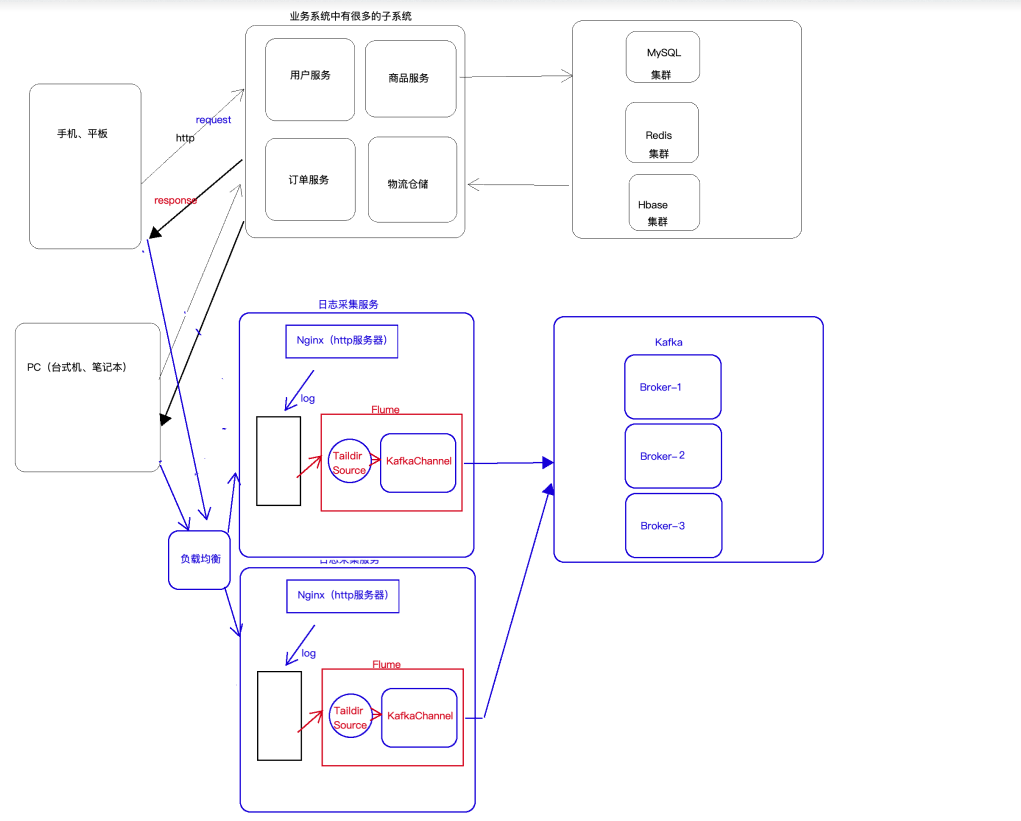

3. 使用flume将本地磁盘中的日志数据采集到的kafka中去

此处数据采集的架构为flume+kafka(taildir+kafkachannel), 这样既能实现负载均衡又能使用高可用

flume采集数据的配置文件如下所示:nginx-kafka.conf

a1.sources = r1

a1.channels = c1 a1.sources.r1.type = TAILDIR

a1.sources.r1.positionFile = /root/taildir_position.json //此处表示taildir采集的记录,即偏移量

a1.sources.r1.filegroups = f1

a1.sources.r1.filegroups.f1 = /log/access-.*\.log a1.channels.c1.type = org.apache.flume.channel.kafka.KafkaChannel

a1.channels.c1.kafka.bootstrap.servers = feng05:9092,feng06:9092,feng07:9092

a1.channels.c1.kafka.topic = access12

a1.channels.c1.parseAsFlumeEvent = false a1.sources.r1.channels = c1

运行flume进行采集,数据即可采集至kafka中,命令如下

/usr/apps/apache-flume-1.9.0-bin/bin/flume-ng agent -n a1 -c conf \

-f myconf/nginx-kafka.conf \

-Dflume.root.logger=INFO,console

/usr/apps/kafka_2.11-2.4.0/bin/kafka-console-consumer.sh --bootstrap-server feng05:9092 --topic access --from-beginning

flink---实时项目--day01--1. openrestry的安装 2. 使用nginx+lua将日志数据写入指定文件中 3. 使用flume将本地磁盘中的日志数据采集到的kafka中去的更多相关文章

- PHP将数据写入指定文件中

首先创建一个空的txt文件,这里我们创建了一个1.txt的空文件. 第一种方法:fwrite函数 <?php $file=fopen('1.txt','rb+'); var_dump(fwrit ...

- 程序一 用记事本建立文件src.dat,其中存放若干字符。编写程序,从文件src.dat中读取数据,统计其中的大写字母、小写字母、数字、其它字符的个数,并将这些数据写入到文件test.dat中。

用记事本建立文件src.dat,其中存放若干字符.编写程序,从文件src.dat中读取数据,统计其中的大写字母.小写字母.数字.其它字符的个数,并将这些数据写入到文件test.dat中. #inclu ...

- Python:将爬取的网页数据写入Excel文件中

Python:将爬取的网页数据写入Excel文件中 通过网络爬虫爬取信息后,我们一般是将内容存入txt文件或者数据库中,也可以写入Excel文件中,这里介绍关于使用Excel文件保存爬取到的网页数据的 ...

- 10.Flink实时项目之订单维度表关联

1. 维度查询 在上一篇中,我们已经把订单和订单明细表join完,本文将关联订单的其他维度数据,维度关联实际上就是在流中查询存储在 hbase 中的数据表.但是即使通过主键的方式查询,hbase 速度 ...

- 1.Flink实时项目前期准备

1.日志生成项目 日志生成机器:hadoop101 jar包:mock-log-0.0.1-SNAPSHOT.jar gmall_mock |----mock_common |----mock ...

- 5.Flink实时项目之业务数据准备

1. 流程介绍 在上一篇文章中,我们已经把客户端的页面日志,启动日志,曝光日志分别发送到kafka对应的主题中.在本文中,我们将把业务数据也发送到对应的kafka主题中. 通过maxwell采集业务数 ...

- 3.Flink实时项目之流程分析及环境搭建

1. 流程分析 前面已经将日志数据(ods_base_log)及业务数据(ods_base_db_m)发送到kafka,作为ods层,接下来要做的就是通过flink消费kafka 的ods数据,进行简 ...

- 4.Flink实时项目之数据拆分

1. 摘要 我们前面采集的日志数据已经保存到 Kafka 中,作为日志数据的 ODS 层,从 kafka 的ODS 层读取的日志数据分为 3 类, 页面日志.启动日志和曝光日志.这三类数据虽然都是用户 ...

- 6.Flink实时项目之业务数据分流

在上一篇文章中,我们已经获取到了业务数据的输出流,分别是dim层维度数据的输出流,及dwd层事实数据的输出流,接下来我们要做的就是把这些输出流分别再流向对应的数据介质中,dim层流向hbase中,dw ...

随机推荐

- Luogu 520题纪念

一入OI深似海......

- simulate_screencap

#!/bin/bashadb shell screencap -p /sdcard/screen.pngadb pull /sdcard/screen.png ./adb shell rm /sdca ...

- C#写TXT文档

//C#写TXT文档 String strDir = System.IO.Path.GetDirectoryName(System.Reflection.Assembly.GetExecutingAs ...

- Linux的inode与block

1,inode包含文件的元信息,具体来说有以下内容: 文件的字节数 文件拥有者的User ID 文件的Group ID 文件的读.写.执行权限 文件的时间戳,共有三个:ctime指inode上次文件属 ...

- SpringCloud微服务实战——搭建企业级开发框架(十四):集成Sentinel高可用流量管理框架【限流】

Sentinel 是面向分布式服务架构的高可用流量防护组件,主要以流量为切入点,从限流.流量整形.熔断降级.系统负载保护.热点防护等多个维度来帮助开发者保障微服务的稳定性. Sentinel 具有 ...

- 基于霸道秉火的STM32F103ZET6嵌入式开发之------基于定时TIM3的PWM实验

1:PWM脉冲宽度调制 STM32 的定时器除了 TIM6 和 7.其他的定时器都可以用来产生 PWM 输出.其中高级定时器 TIM1 和 TIM8 可以同时产生多达 7 路的 PWM 输出.而通用定 ...

- SqlServer新建表操作DDL

创建新表:1,五要素 2,not null 3,默认值 4,字段注释,表名称 5,索引 6,指定约束名称 -- ------------------------------ Table structu ...

- 通过大量实战案例分解Netty中是如何解决拆包黏包问题的?

TCP传输协议是基于数据流传输的,而基于流化的数据是没有界限的,当客户端向服务端发送数据时,可能会把一个完整的数据报文拆分成多个小报文进行发送,也可能将多个报文合并成一个大报文进行发送. 在这样的情况 ...

- Json跨域登录问题的之Access-Control-Allow-Origin 站点跨域请求的问题

跨域调用json问题 闲暇之时,做了一个博客站点,站点发布网络之后程序功能完成,最后发现了一个跨域的问题,比如我使用abc.com打开系统,一切正常,后台没有任何文件请求报错问题,然后我又使用了www ...

- Veeam Backup & Replication 10.0.0.4461安装部署(包含补丁)

Veeam Backup & Replication 是一款数据保护软件,为VMware 和Hyper-V 虚拟机.物理与云环境提供了备份.复制与恢复选项.如有需要请去官方购买正版授权:htt ...