【GUI软件】小红书按关键词采集笔记详情,支持多个关键词,含笔记正文、转评赞藏等

一、背景介绍

1.1 爬取目标

您好!我是@马哥python说,一名10年程序猿。

熟悉我的小伙伴都了解,我之前开发过2款软件:

【GUI软件】小红书搜索结果批量采集,支持多个关键词同时抓取!

【GUI软件】小红书详情数据批量采集,含笔记内容、转评赞藏等,支持多笔记同时采集!

现在介绍的这个软件,相当于以上2个软件的结合版,即根据关键词爬取笔记的详情数据。

开发界面软件的目的:方便不懂编程代码的小白用户使用,无需安装python,无需改代码,双击打开即用!

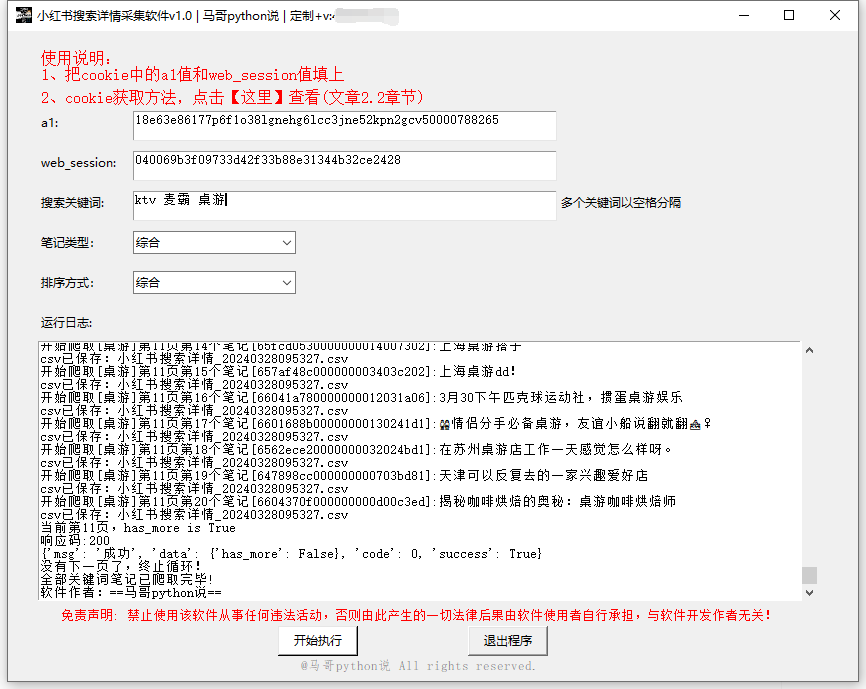

软件界面截图:

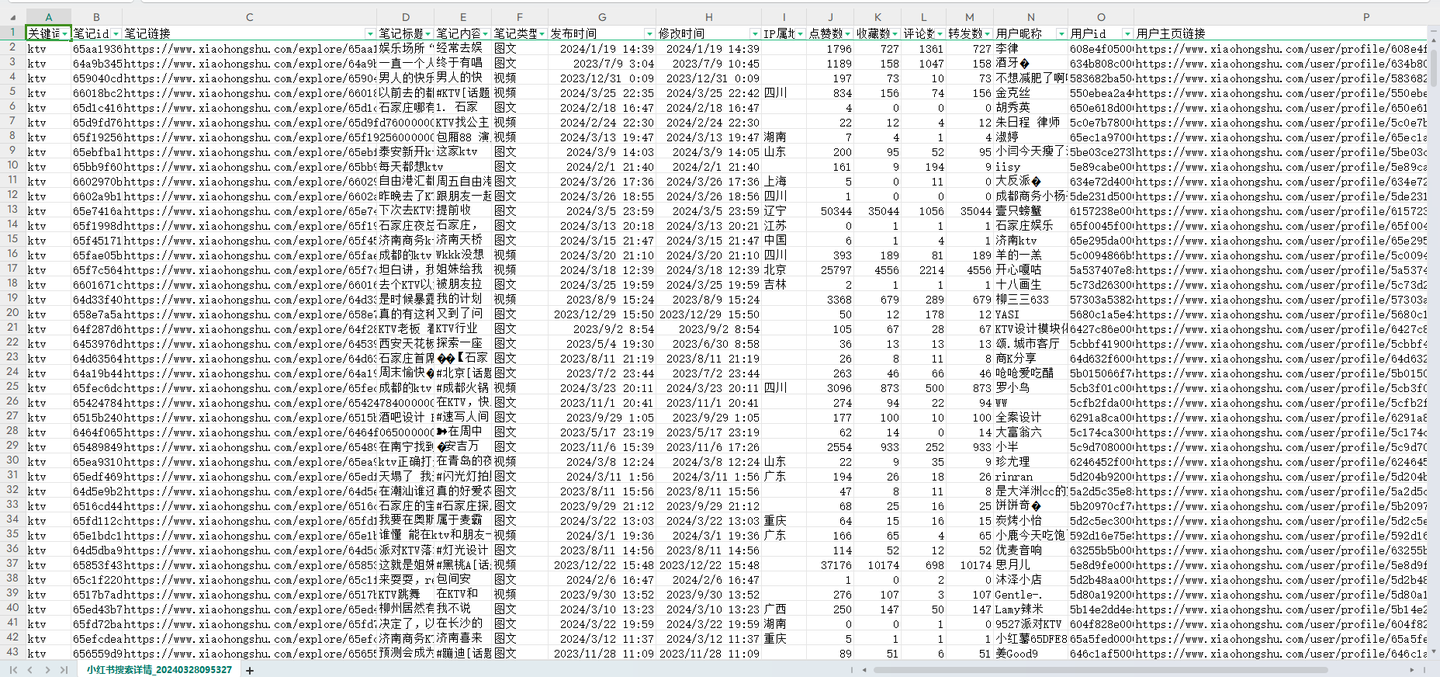

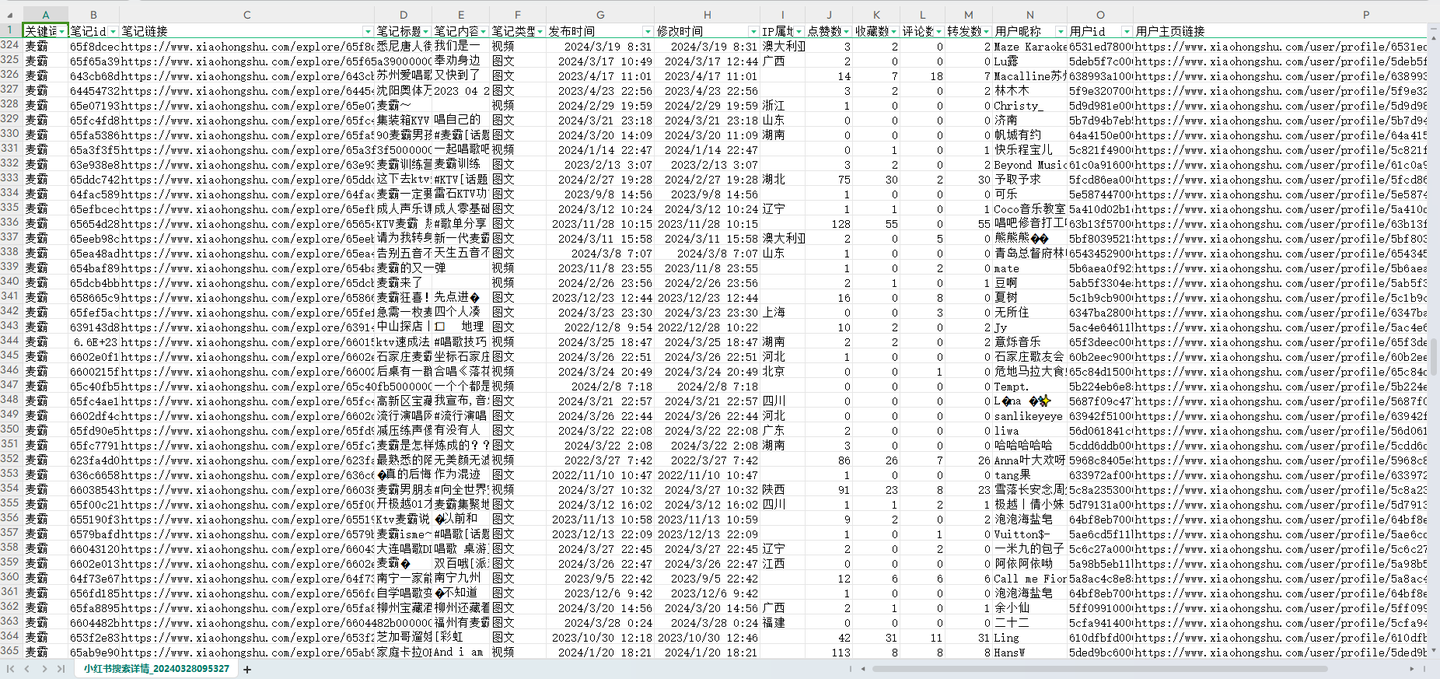

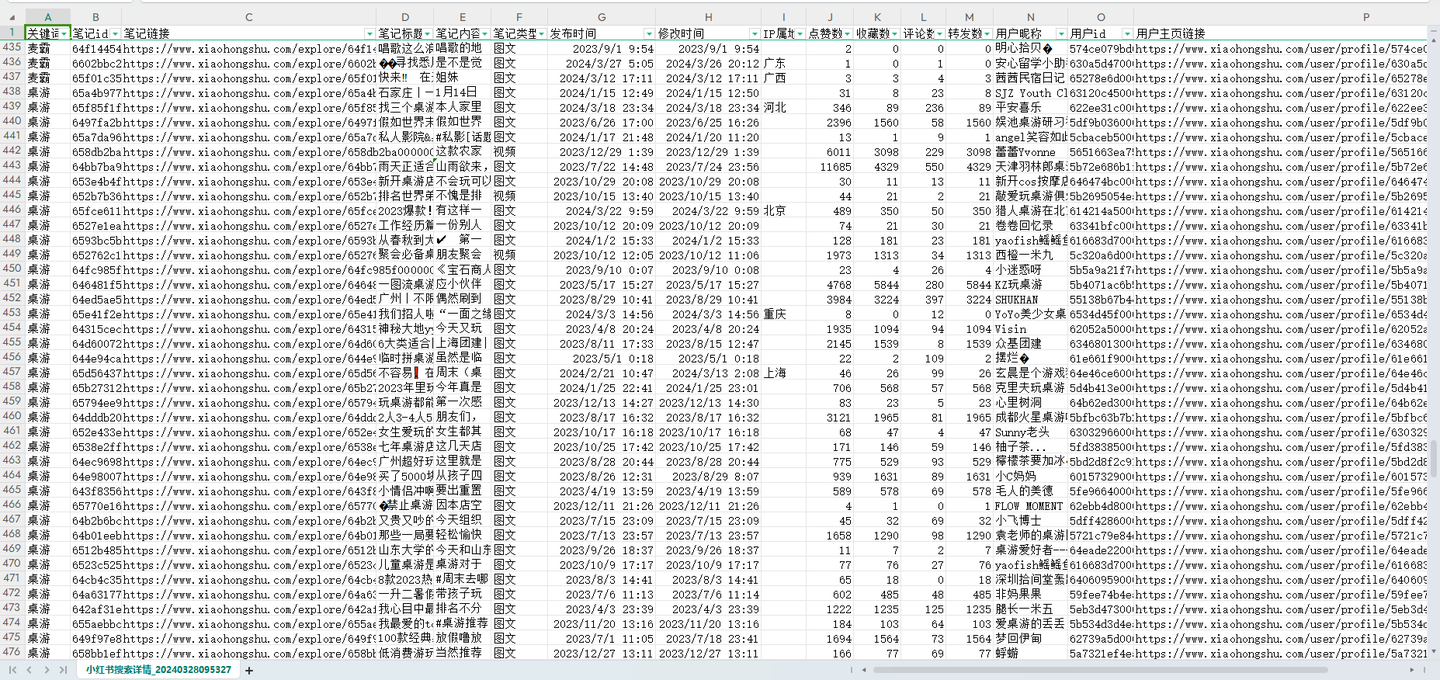

爬取结果截图:

结果截图1:

结果截图2:

结果截图3:

以上。

1.2 演示视频

软件使用演示:(不懂编程的小白直接看视频,了解软件作用即可,无需看代码)

演示视频:【小红书采集软件】根据关键词自动采集笔记详情,含笔记正文、转评赞藏等

1.3 软件说明

几点重要说明:

- Windows用户可直接双击打开使用,无需Python运行环境,非常方便!

- 需要填入cookie中的a1值和web_session值

- 支持按笔记类型(综合/视频/图文)和排序方式(综合/最新/最热)爬取

- 支持同时爬多个关键词

- 每个关键词最多可采集220条左右笔记,与网页端数量一致

- 爬取过程中,每爬一条,存一次csv结果,防止程序异常中断丢失前面的数据(每条间隔1~2s)

- 爬取过程中,有log文件详细记录运行过程,方便回溯

- 爬取完成后,自动导出结果到csv文件

- 爬取共16个字段,含:关键词,笔记id,笔记链接,笔记标题,笔记内容,笔记类型,发布时间,修改时间,IP属地,点赞数,收藏数,评论数,转发数,用户昵称,用户id,用户主页链接。

以上。

二、代码讲解

2.1 爬虫采集-搜索接口

首先,定义接口地址作为请求地址:

# 请求地址

url = 'https://edith.xiaohongshu.com/api/sns/web/v1/search/notes'

定义一个请求头,用于伪造浏览器:

# 请求头

h1 = {

'Accept': 'application/json, text/plain, */*',

'Accept-Encoding': 'gzip, deflate, br',

'Accept-Language': 'zh-CN,zh;q=0.9,en;q=0.8,en-GB;q=0.7,en-US;q=0.6',

'Content-Type': 'application/json;charset=UTF-8',

'Cookie': '换成自己的cookie值',

'Origin': 'https://www.xiaohongshu.com',

'Referer': 'https://www.xiaohongshu.com/',

'Sec-Ch-Ua': '"Microsoft Edge";v="119", "Chromium";v="119", "Not?A_Brand";v="24"',

'Sec-Ch-Ua-Mobile': '?0',

'Sec-Ch-Ua-Platform': '"macOS"',

'Sec-Fetch-Dest': 'empty',

'Sec-Fetch-Mode': 'cors',

'Sec-Fetch-Site': 'same-site',

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36 Edg/119.0.0.0',

}

加上请求参数,告诉程序你的爬取条件是什么:

# 请求参数

post_data = {

"keyword": search_keyword,

"page": page,

"page_size": 20,

"search_id": v_search_id,

"sort": v_sort,

"note_type": v_note_type,

"image_scenes": "FD_PRV_WEBP,FD_WM_WEBP",

}

2.2 爬虫采集-详情接口

首先,定义接口地址作为请求地址:

# 请求地址

url = 'https://edith.xiaohongshu.com/api/sns/web/v1/feed'

定义一个请求头,用于伪造浏览器:

# 请求头

h1 = {

'Accept': 'application/json, text/plain, */*',

'Accept-Encoding': 'gzip, deflate, br',

'Accept-Language': 'zh-CN,zh;q=0.9,en;q=0.8,en-GB;q=0.7,en-US;q=0.6',

'Content-Type': 'application/json;charset=UTF-8',

'Cookie': '换成自己的cookie值',

'Origin': 'https://www.xiaohongshu.com',

'Referer': 'https://www.xiaohongshu.com/',

'Sec-Ch-Ua': '"Microsoft Edge";v="119", "Chromium";v="119", "Not?A_Brand";v="24"',

'Sec-Ch-Ua-Mobile': '?0',

'Sec-Ch-Ua-Platform': '"macOS"',

'Sec-Fetch-Dest': 'empty',

'Sec-Fetch-Mode': 'cors',

'Sec-Fetch-Site': 'same-site',

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36 Edg/119.0.0.0',

}

加上请求参数,告诉程序你的爬取条件是什么:

# 请求参数

post_data = {

"source_note_id": note_id,

"image_formats": ["jpg", "webp", "avif"],

"extra": {"need_body_topic": "1"}

}

下面就是发送请求和接收数据:

# 发送请求

r = requests.post(url, headers=h1, data=data_json)

# 接收数据

json_data = r.json()

逐个解析字段数据,以"笔记标题"为例:

# 笔记标题

try:

title = json_data['data']['items'][0]['note_card']['title']

except:

title = ''

熟悉xhs的朋友都知道,有些笔记是没有标题的,所以这里加上try保护,防止程序报错导致中断运行。

其他字段同理,不再赘述。

下面就是发送请求和接收数据:

# 发送请求

r = requests.post(url, headers=h1, data=data_json.encode('utf8'))

print(r.status_code)

# 以json格式接收返回数据

json_data = r.json()

定义一些空列表,用于存放解析后字段数据:

# 定义空列表

note_id_list = [] # 笔记id

note_title_list = [] # 笔记标题

note_type_list = [] # 笔记类型

like_count_list = [] # 点赞数

user_id_list = [] # 用户id

user_name_list = [] # 用户昵称

循环解析字段数据,以"笔记标题"为例:

# 循环解析

for data in json_data['data']['items']:

# 笔记标题

try:

note_title = data['note_card']['display_title']

except:

note_title = ''

print('note_title:', note_title)

note_title_list.append(note_title)

其他字段同理,不再赘述。

最后,是把数据保存到csv文件:

# 把数据保存到Dataframe

df = pd.DataFrame(

{

'关键词': search_keyword,

'页码': page,

'笔记id': note_id_list,

'笔记链接': ['https://www.xiaohongshu.com/explore/' + i for i in note_id_list],

'笔记标题': note_title_list,

'笔记类型': note_type_list,

'点赞数': like_count_list,

'用户id': user_id_list,

'用户主页链接': ['https://www.xiaohongshu.com/user/profile/' + i for i in user_id_list],

'用户昵称': user_name_list,

}

)

if os.path.exists(result_file):

header = False

else:

header = True

# 把数据保存到csv文件

df.to_csv(result_file, mode='a+', index=False, header=header, encoding='utf_8_sig')

完整代码中,还含有:判断循环结束条件、js逆向解密、笔记类型(综合/视频图文)筛选、排序方式筛选(综合/最新/最热)等关键实现逻辑。

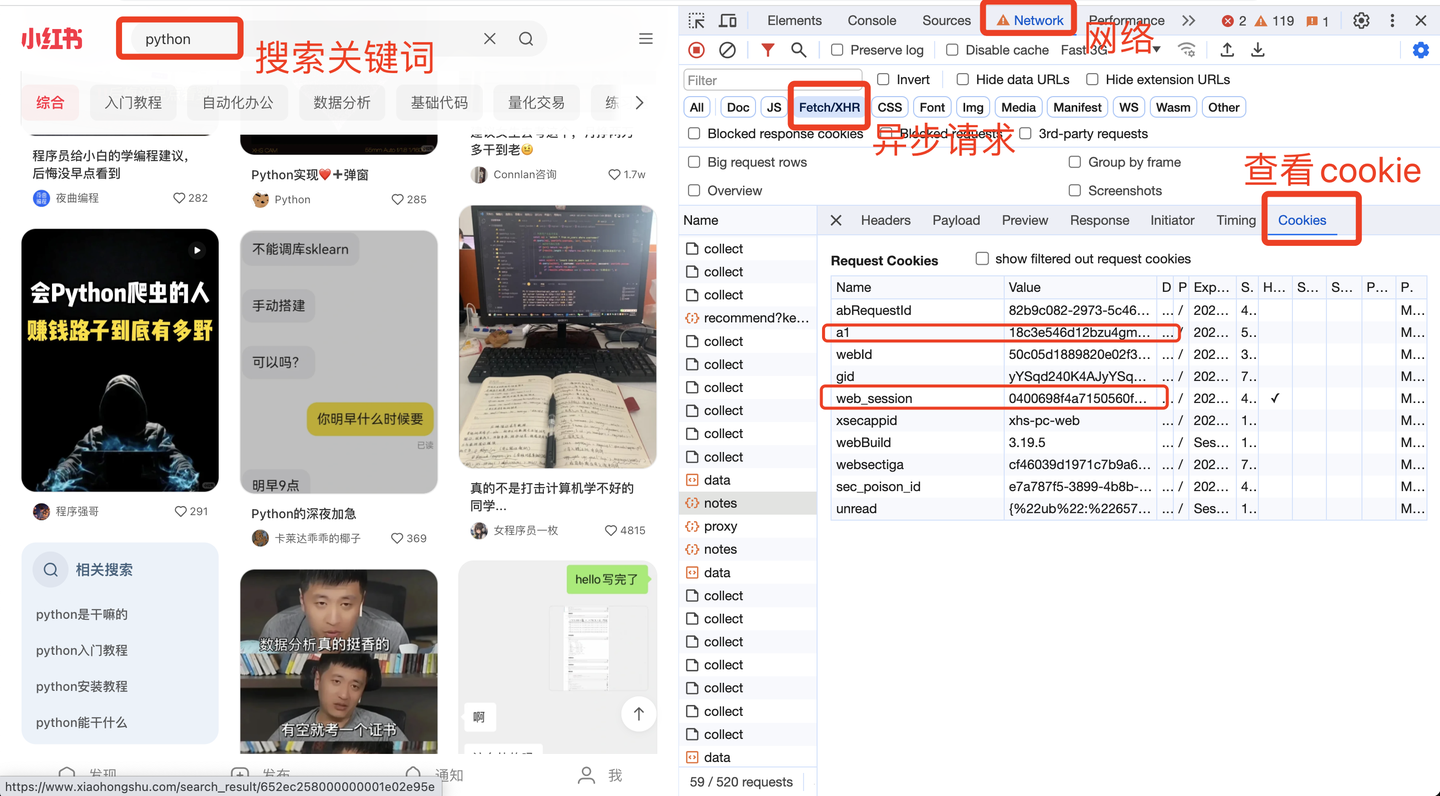

2.3 cookie说明

其中,cookie是个关键参数。

cookie里的a1和web_session获取方法,如下:

这两个值非常重要,软件界面需要填写!!

开发者模式的打开方法:页面空白处->右键->检查。

2.4 软件界面模块

主窗口部分:

# 创建主窗口

root = tk.Tk()

root.title('小红书搜索详情采集软件v1.0 | 马哥python说 |')

# 设置窗口大小

root.minsize(width=850, height=650)

输入控件部分:

# 搜索关键词

tk.Label(root, justify='left', text='搜索关键词:').place(x=30, y=160)

entry_kw = tk.Text(root, bg='#ffffff', width=60, height=2, )

entry_kw.place(x=125, y=160, anchor='nw') # 摆放位置

底部版权部分:

# 版权信息

copyright = tk.Label(root, text='@马哥python说 All rights reserved.', font=('仿宋', 10), fg='grey')

copyright.place(x=290, y=625)

以上。

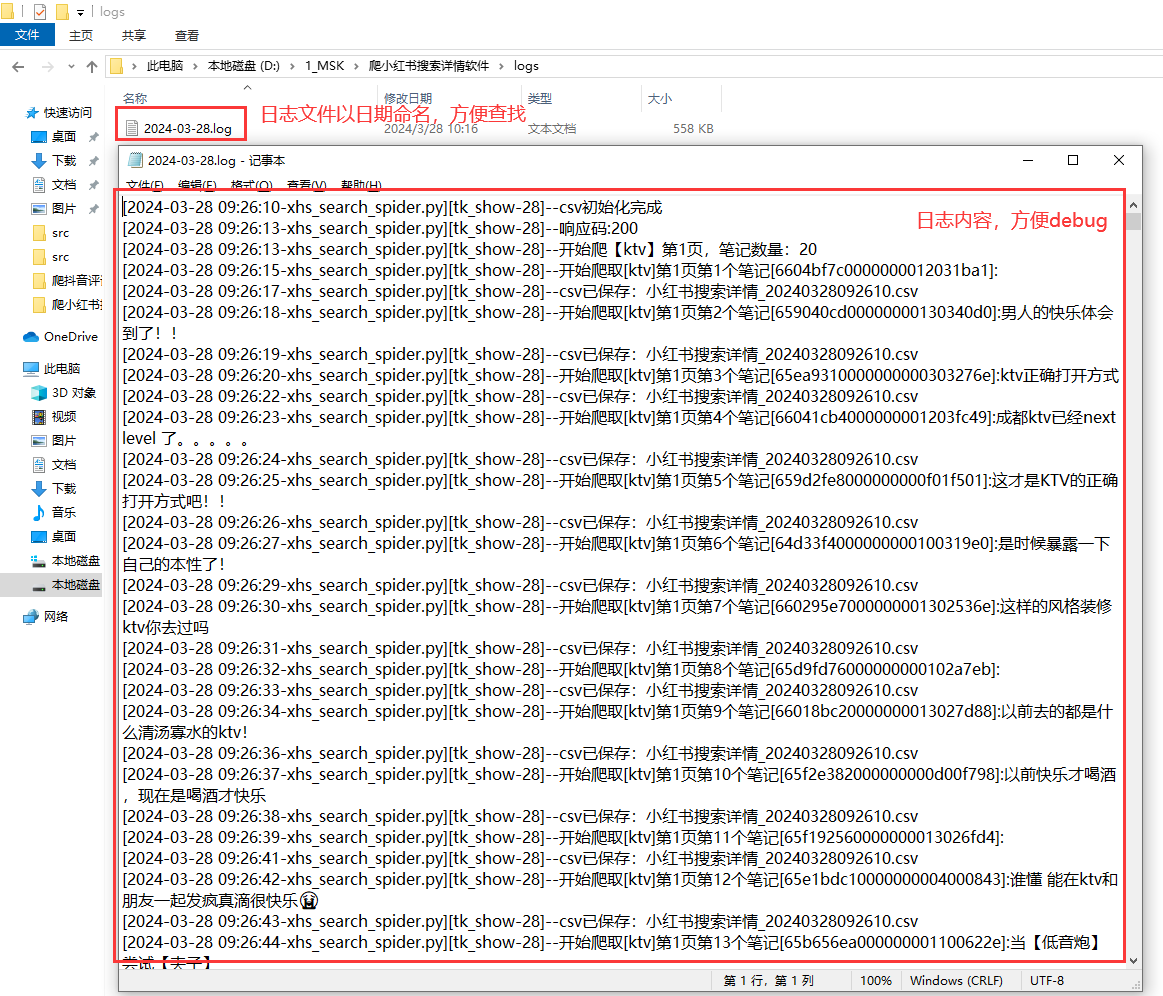

2.5 日志模块

好的日志功能,方便软件运行出问题后快速定位原因,修复bug。

核心代码:

def get_logger(self):

self.logger = logging.getLogger(__name__)

# 日志格式

formatter = '[%(asctime)s-%(filename)s][%(funcName)s-%(lineno)d]--%(message)s'

# 日志级别

self.logger.setLevel(logging.DEBUG)

# 控制台日志

sh = logging.StreamHandler()

log_formatter = logging.Formatter(formatter, datefmt='%Y-%m-%d %H:%M:%S')

# info日志文件名

info_file_name = time.strftime("%Y-%m-%d") + '.log'

# 将其保存到特定目录,ap方法就是寻找项目根目录,该方法博主前期已经写好。

case_dir = r'./logs/'

info_handler = TimedRotatingFileHandler(filename=case_dir + info_file_name,

when='MIDNIGHT',

interval=1,

backupCount=7,

encoding='utf-8')

日志文件截图:

以上。

三、获取源码及软件

完整python源码及exe软件,微信公众号"老男孩的平凡之路"后台回复"爬小红书搜索详情软件"即可获取。点击直达

我是@马哥python说,一名10年程序猿,持续分享python干货中!

【GUI软件】小红书按关键词采集笔记详情,支持多个关键词,含笔记正文、转评赞藏等的更多相关文章

- 使用Vue2完成“小红书” app

小红书项目说明 整体页面格调.功能和原版 app 无限接近.具体页面细节可以下载 “小红书” app查看. 图片素材:https://pan.baidu.com/s/1qYOcx7e 整体要求: · ...

- 剑指Offer——小米+小红书笔试题+知识点总结

剑指Offer--小米+小红书笔试题+知识点总结 情景回顾 时间:2016.9.23 19:00-21:00 2016.9.24 15:00-17:00 地点:山东省网络环境智能计算技术重点实验室 事 ...

- 2月第3周业务风控关注|上海网信办复测23个被约谈APP 涉及1号店、小红书等

易盾业务风控周报每周呈报值得关注的安全技术和事件,包括但不限于内容安全.移动安全.业务安全和网络安全,帮助企业提高警惕,规避这些似小实大.影响业务健康发展的安全风险. 1.上海网信办复测23个被约谈A ...

- 6.简单提取小红书app数据(简单初步试采集与分析)-1

采集小红书数据爬虫:1.本来是要通过app端的接口去直接采集数据,但是app接口手机端设置本地代理这边开启抓包后就不能正常访问数据.所以就采用了微信小程序里的小红书app接口去采集数据. 2.通过 f ...

- 最新 小红书java校招面经 (含整理过的面试题大全)

从6月到10月,经过4个月努力和坚持,自己有幸拿到了网易雷火.京东.去哪儿.小红书等10家互联网公司的校招Offer,因为某些自身原因最终选择了小红书.6.7月主要是做系统复习.项目复盘.LeetCo ...

- 从字节跳动离职后,拿到探探、趣头条、爱奇艺、小红书、15家公司的 offer【转】

前言 博主目前从事Android开发3年,前两年一直在抖音工作.我这篇文章并不是简单的描述一些面试中的题,或者总结一些Android的知识,而是想记录我整个的想法和准备的过程,以及一些心得体会,让大家 ...

- Keep、小红书、美图…独角兽App能拿到新一轮救命钱吗?

大多数人热爱手机,不是因为时尚的外观或者结实的零部件,而是因琳琅满目的App赋予其太多的功能.智能手机最先是清理掉人类的零碎时间,现如今又开始肢解我们大块的时间,或者说,智能手机本身就是生活.在如此背 ...

- 小红书携手HMS Core,畅玩高清视界,种草美好生活

在相同流量消耗的情况下,540p可秒变1080p?这不是魔法,通过视频超分辨率技术(简称视频超分),就能让视频变得更清晰. 7月20日,在小红书最新版本7.48的App中,用户就能体验到这项技术带来的 ...

- Android -- 仿小红书欢迎界面

1,觉得小红书的欢迎界面感觉很漂亮,就像来学习学习一下来实现类似于这种效果 原效果图如下: 2,根据效果我们来一点点分析 第一步:首先看一下我们的主界面布局文件视图效果如下: main_activi ...

- 超实用教程,教你用墨刀做出小红书app原型

一个新手怎么用1小时快速学会APP原型设计? 1小时很短,这意味着学习时必须把握APP原型设计中的重点.难点,而非面面俱到. 要在短时间内理解.掌握一个工具的使用,最有效的方式莫过于临摹: 看实例视频 ...

随机推荐

- OGNL表达式注入分析

OGNL基础 依赖 <dependency> <groupId>ognl</groupId> <artifactId>ognl</artifact ...

- Hybrid-PSC:基于对比学习的混合网络,解决长尾图片分类 | CVPR 2021

论文提出新颖的混合网络用于解决长尾图片分类问题,该网络由用于图像特征学习的对比学习分支和用于分类器学习的交叉熵分支组成,在训练过程逐步将训练权重调整至分类器学习,达到更好的特征得出更好的分类器的思想 ...

- 无法进去wordpress后台,也不能修改密码怎么办?wordpress无需下载插件修改代码配置SMTP发送邮件(网易邮箱)

(解决不能进入wordpress后台,忘记密码,找回密码时提示站点邮件配置失败的问题,配置好之后即可通过邮件重置wordpress密码) 使用ssh工具远程连接自己的服务器(Xshell或者服务器自带 ...

- 循环队列(LoopQueue)

循环队列相比普通的队列,元素出队时无需移动大量元素. 代码 ArrayQueue.h 点它 代码清单 #ifndef C___LOOPQUEUE_H #define C___LOOPQUEUE_H # ...

- Refresh 重构(Refactor)

最近在闲暇之余重(第)温(一..次)此书, 首先能感受到的, 无论你是新程序员还是老程序员, 这本书都已经不具备太多的可读性了. 由于本书成书年代久远, 那个时候软件行业还不够发达, 面向对象还没有被 ...

- #树上差分 or 01-Trie#洛谷 6623 [省选联考 2020 A 卷] 树

题目 分析(01trie) 考虑用trie做需要满足什么操作:加入某个数.01-Trie的合并.全局加一. 主要是全局加一比较难做,考虑改变的地方就是 \(X*2^T+2^T-1\). 把01-Tri ...

- #费马小定理#JZOJ 4015 数列

题目 给出\(x_n=(ax_{n-1}^2+bx_{n-1}+c)\bmod m\) 给出\(x_0.a,b,c,n,m\),求\(x_n\) \(\text{Subtask 1:}n\leq 10 ...

- netty系列之:给ThreadLocal插上梦想的翅膀,详解FastThreadLocal

目录 简介 从ThreadLocalMap中获取数据 FastThreadLocal 总结 简介 JDK中的ThreadLocal可以通过get方法来获得跟当前线程绑定的值.而这些值是存储在Threa ...

- Qt6安装

*:Qt现在基本都是在线安装了,但是下载的速度特别慢,所以此次记录下如何提速,快速安装 一.在线安装器下载 我用的这个(非官网):https://mirrors.tuna.tsinghua.edu.c ...

- 新手真的别再用过时的jenkins freestyle了,10分钟教你搞定快速编写jenksinfile,快速离线调试

Pipeline是一套运行于jenkins上的工作流框架,将原本独立运行于单个或者多个节点的任务连接起来,实现单个任务难以完成的复杂流程编排与可视化.它通过Domain Specific Langua ...