centOS7下Spark安装配置

环境说明:

操作系统: centos7 64位 3台

centos7-1 192.168.190.130 master

centos7-2 192.168.190.129 slave1

centos7-3 192.168.190.131 slave2

安装spark需要同时安装如下内容:

jdk scale

1.安装jdk,配置jdk环境变量

这里不讲如何安装配置jdk,自行百度。

2.安装scala

下载scala安装包,https://www.scala-lang.org/download/选择符合要求的版本进行下载,使用客户端工具上传到服务器上。解压:

#tar -zxvf scala-2.13.0-M4.tgz

再次修改/etc/profile文件,添加如下内容:

export SCALA_HOME=$WORK_SPACE/scala-2.13.0-M4

export PATH=$PATH:$SCALA_HOME/bin

#source /etc/profile // 让其立即生效

#scala -version //查看scala是否安装完成

3.安装spark

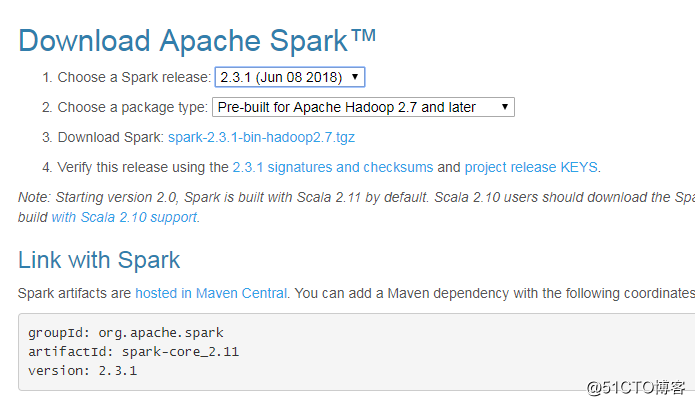

spark下载地址:http://spark.apache.org/downloads.html

说明:有不同的版本包下载,选则你需要的下载安装即可

Source code: Spark 源码,需要编译才能使用,另外 Scala 2.11 需要使用源码编译才可使用

Pre-build with user-provided Hadoop: “Hadoop free” 版,可应用到任意 Hadoop 版本

Pre-build for Hadoop 2.7 and later: 基于 Hadoop 2.7 的预先编译版,需要与本机安装的 Hadoop 版本对应。可选的还有 Hadoop 2.6。我这里因为装的hadoop是3.1.0,所以直接安装for hadoop 2.7 and later的版本。

注:hadoop的安装请查看我的上一篇博客,不在重复描述。

#mkdir spark

#cd /usr/spark

#tar -zxvf spark-2.3.1-bin-hadoop2.7.tgz

#vim /etc/profile

#添加spark的环境变量,加如PATH下、export出来

#source /etc/profile

#进入conf目录下,把spark-env.sh.template拷贝一份改名spark-env.sh

#cd /usr/spark/spark-2.3.1-bin-hadoop2.7/conf

#cp spark-env.sh.template spark-env.sh

#vim spark-env.sh

export SCALA_HOME=/usr/scala/scala-2.13.0-M4

export JAVA_HOME=/usr/lib/jvm/jre-1.8.0-openjdk-1.8.0.171-8.b10.el7_5.x86_64

export HADOOP_HOME=/usr/hadoop/hadoop-3.1.0

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

export SPARK_HOME=/usr/spark/spark-2.3.1-bin-hadoop2.7

export SPARK_MASTER_IP=master

export SPARK_EXECUTOR_MEMORY=1G

#进入conf目录下,把slaves.template拷贝一份改名为slaves

#cd /usr/spark/spark-2.3.1-bin-hadoop2.7/conf

#cp slaves.template slaves

#vim slaves

#添加节点域名到slaves文件中

#master //该域名为centos7-1的域名

#slave1 //该域名为centos7-2的域名

#slave2 //该域名为centos7-3的域名启动spark

#启动spark之前先要把hadoop节点启动起来

#cd /usr/hadoop/hadoop-3.1.0/

#sbin/start-all.sh

#jps //检查启动的线程是否已经把hadoop启动起来了

#cd /usr/spark/spark-2.3.1-bin-hadoop2.7

#sbin/start-all.sh

备注:在slave1\slave2节点上也必须按照上面的方式安装spark,或者直接拷贝一份到slave1,slave2节点上

#scp -r /usr/spark root@slave1ip:/usr/spark

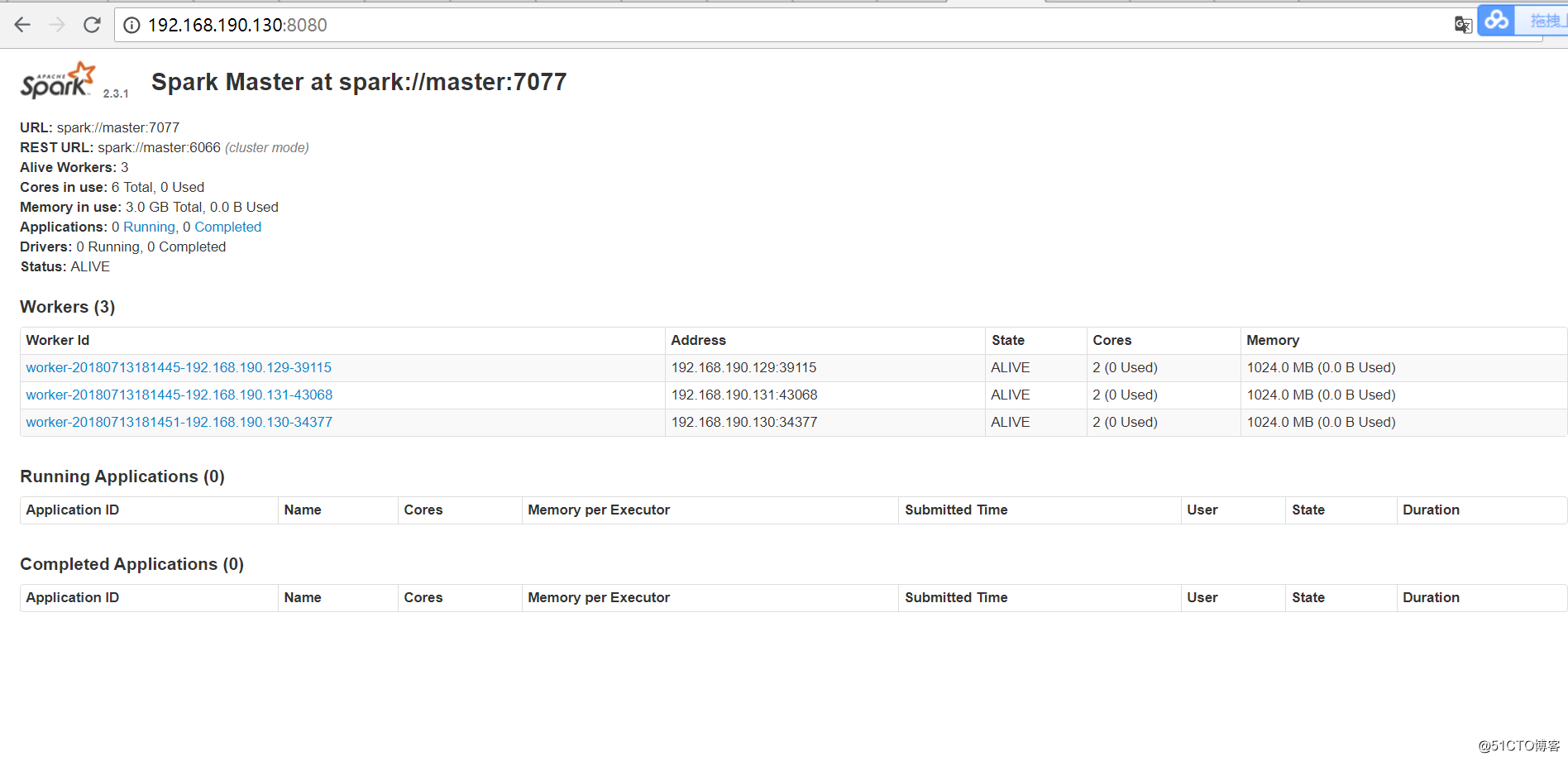

启动信息如下:starting org.apache.spark.deploy.master.Master, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.master.Master-1-master.out

slave2: starting org.apache.spark.deploy.worker.Worker, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.worker.Worker-1-slave2.com.cn.out

slave1: starting org.apache.spark.deploy.worker.Worker, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.worker.Worker-1-slave1.com.cn.out

master: starting org.apache.spark.deploy.worker.Worker, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.worker.Worker-1-master.out

测试Spark集群:

用浏览器打开master节点上的spark集群url:http://192.168.190.130:8080/

centOS7下Spark安装配置的更多相关文章

- ubuntu下spark安装配置

一.安装vmware虚拟机 二.在虚拟机上安装ubuntu12.04操作系统 三.安装jdk1.8.0_25 http://www.oracle.com/technetwork/java/javase ...

- centos7下elasticSearch安装配置

OS:Centos7x虚拟机 1H2Gjdk:1.8elasticsearch:5.6.0 1.下载“elasticsearch-5.6.0.tar.gz”解压到/usr/local/elastics ...

- Centos7下yum安装配置nginx与php

实现LNMP环境搭建. 开始安装Nginx和PHP-FPM之前,首先卸载系统中以前安装的Apache和PHP保证安装不会冲突.用root登录输入下面的命令: yum remve httpd* php* ...

- 在Centos7下源代码安装配置Nginx

1.安装前准备开发环境安装pcre开发包:yum install -y pcre-devel 安装编译源码所需的工具和库:yum install gcc gcc-c++ ncurses-devel p ...

- centos7下zookeeper安装配置

1.下载zookeeper文件 cd /opt/ wget http://mirrors.hust.edu.cn/apache/zookeeper/stable/zookeeper-3.4.9.tar ...

- centos7下编译安装php-7.0.15(PHP-FPM)

centos7下编译安装php-7.0.15(PHP-FPM) 一.下载php7源码包 http://php.net/downloads.php 如:php-7.0.15.tar.gz 二.安装所需依 ...

- Centos7下快速安装Mongo3.2

Centos7下快速安装Mongo3.2 一般安装Mongo推荐源码安装,有时候为了快部署测试环境,或者仅仅是想装个mongo shell,这时候yum安装是最合适的方式, 下面介绍一下如何在Cent ...

- 19.CentOS7下PostgreSQL安装过程

CentOS7下PostgreSQL安装过程 装包 sudo yum install postgresql-server postgresql-contrib 说明: 这种方式直接明了,其他方法也可以 ...

- centos7 下 yum 安装Nginx

centos7 下 yum 安装和配置 Nginx 添加yum源 Nginx不在默认的yum源中,可以使用epel或者官网的yum源,这里使用官网的yum源 rpm -ivh http://nginx ...

随机推荐

- 从壹开始前后端分离 41 || Nginx+Github+PM2 快速部署项目(一)

前言 哈喽大家周一好!今天是农历腊月二十三,小年开始,恭祝大家新年快乐(哈哈你五福了么

- 从壹开始前后端分离[.NetCore ] 38 ║自动初始化数据库(不定期更新)

缘起 哈喽大家好呀,我们又见面啦,这里先祝大家圣诞节快乐哟,昨天的红包不知道有没有小伙伴抢到呢.今天的这篇内容灰常简单,只是对我们的系统的数据库进行CodeFirst,然后就是数据处理,因为这几个月来 ...

- String求求你别秀了

小鲁班今年计算机专业大四了,在学校可学了不少软件开发的东西,也自学了一些JAVA的后台框架,踌躇满志,一心想着找个好单位实习.当投递了无数份简历后,终于收到了一个公司发来的面试通知,小鲁班欣喜若狂. ...

- 我们必须要知道的RESTful服务最佳实践

看过很多RESTful相关的文章总结,参齐不齐,结合工作中的使用,非常有必要归纳一下关于RESTful架构方式了,RESTful只是一种架构方式的约束,给出一种约定的标准,完全严格遵守RESTful标 ...

- Flannel工作原理

flanneld程序启动会有一个参数叫做-etcd-prefix和-iface.前者是指定flanneld程序使用etcd的哪个节点来存储数据,-face是指定flanneld使用网络是使用宿主机哪个 ...

- 别开心太早,Python 官方文档的翻译差远了

近几天,很多公众号发布了 Python 官方文档的消息.然而,一个特别奇怪的现象就发生了,让人啼笑皆非. Python 文档的中文翻译工作一直是“默默无闻”,几个月前,我还吐槽过这件事<再聊聊P ...

- Win10+RTX2080深度学习环境搭建:tensorflow、mxnet、pytorch、caffe

目录 准备工作 设置conda国内镜像源 conda 深度学习环境 tensorflow.mxnet.pytorch安装 tensorflow mxnet pytorch Caffe安装 配置文件修改 ...

- 泛微关于js设计的一些小技巧

1.关于泛微流程的js设计 泛微oa可以插入javascript可以diy自己想要的表单页面前端功能.如果有前端开发经验,或者熟练使用jQuery的话,这将变得非常容易!同时泛微OA内部有很多库,包括 ...

- iOS----------demo总结

1.demo总结 2.第三方使用 一.demo总结 1.选择相册单张照片 二.第三方使用

- gin+gorm

在[环境变量]中添加如下[用户变量]/[系统变量]:GO111MODULE,值为on go mod init目录 在项目中新建文件main.go,并添加测试代码 package main import ...