@KafkaListener和@KafkaListeners的使用

正文前先来一波福利推荐:

福利一:

百万年薪架构师视频,该视频可以学到很多东西,是本人花钱买的VIP课程,学习消化了一年,为了支持一下女朋友公众号也方便大家学习,共享给大家。

福利二:

毕业答辩以及工作上各种答辩,平时积累了不少精品PPT,现在共享给大家,大大小小加起来有几千套,总有适合你的一款,很多是网上是下载不到。

获取方式:

微信关注 精品3分钟 ,id为 jingpin3mins,关注后回复 百万年薪架构师 ,精品收藏PPT 获取云盘链接,谢谢大家支持!

------------------------正文开始---------------------------

2. consumer

使用了@KafkaListener注解。

2.1. pom.xml

引入以下依赖

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

<version>1.2.0.RELEASE</version>

</dependency>2.2. 配置类

@Configuration

@EnableKafka

public class KafkaConfig {

@Value("${kafka.bootstrap.servers}")

private String kafkaBootstrapServers;

@Value("${session.timeout.ms}")

private Integer sessionTimeoutMs;

@Value("${enable.auto.commit}")

private boolean enableAutoCommit;

@Value("${auto.commit.interval.ms}")

private Integer autoCommitIntervalMs;

@Value("${auto.offset.reset}")

private String autoOffsetReset;

@Value("${group.id}")

private String groupId;

@Bean

KafkaListenerContainerFactory<ConcurrentMessageListenerContainer<Integer, String>> kafkaListenerContainerFactory() {

ConcurrentKafkaListenerContainerFactory<Integer, String> factory = new ConcurrentKafkaListenerContainerFactory<>();

factory.setConsumerFactory(consumerFactory());

factory.setConcurrency(3);

factory.getContainerProperties().setPollTimeout(3000);

return factory;

}

@Bean

public ConsumerFactory<Integer, String> consumerFactory() {

return new DefaultKafkaConsumerFactory<>(consumerConfigs());

}

@Bean

public Map<String, Object> consumerConfigs() {

Map<String, Object> props = new HashMap<>();

props.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, kafkaBootstrapServers);

props.put(ConsumerConfig.GROUP_ID_CONFIG, groupId);

props.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, enableAutoCommit);

props.put(ConsumerConfig.AUTO_COMMIT_INTERVAL_MS_CONFIG, autoCommitIntervalMs);

props.put(ConsumerConfig.SESSION_TIMEOUT_MS_CONFIG, sessionTimeoutMs);

props.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, autoOffsetReset);

props.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, IntegerDeserializer.class);

props.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class);

return props;

}

@Bean

public KafkaConsumer consumer() {

return new KafkaConsumer();

}

}2.3. 消费处理

public class KafkaConsumer {

@KafkaListeners({@KafkaListener(topics="topic1"), @KafkaListener(topics="topic2")})

public void listen(ConsumerRecord<Integer, String> msg) {

// 消费到数据后的处理逻辑

}

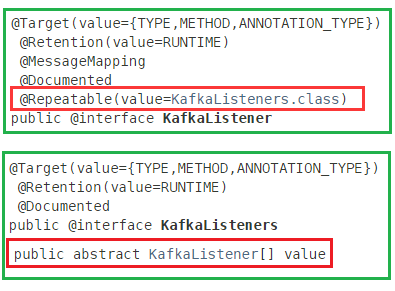

}2.4. @KafkaListener和@KafkaListners

@KafkaListeners是@KafkaListener的Container Annotation,这也是jdk8的新特性之一,注解可以重复标注。

@KafkaListeners({@KafkaListener(topics="topic1"), @KafkaListener(topics="topic2")})

public void listen(ConsumerRecord<Integer, String> msg) {}

等同于

@KafkaListener(topics="topic1")

@KafkaListener(topics="topic2")

public void listen(ConsumerRecord<Integer, String> msg) {}2.5. @KafkaListener使用小结

在注解上可以方便地进行各种配置,但是如果要消费的topic个数不定,用@KafkaListener就很难优雅解决。

注解要求必须在compile-time就能确定值,可以移步stackOverFlow查看更加详细的解释。

@KafkaListener和@KafkaListeners的使用的更多相关文章

- spring-kafka之KafkaListener注解深入解读

简介 Kafka目前主要作为一个分布式的发布订阅式的消息系统使用,也是目前最流行的消息队列系统之一.因此,也越来越多的框架对kafka做了集成,比如本文将要说到的spring-kafka. Kafka ...

- springboot + @KafkaListener 手动提交及消费能力优化

转载 https://blog.csdn.net/asd5629626/article/details/82776450 https://blog.csdn.net/asd5629626/artic ...

- Spring-framework应用程序启动loadtime源码分析笔记(三)——@KafkaListener

org.springframework.context.annotation.ConfigurationClassParser.getConfigurationClasses()读所有@Configu ...

- Spring for Apache Kafka @KafkaListener使用及注意事项

官方文档: https://docs.spring.io/spring-kafka/reference/html/ @KafkaListener The @KafkaListener annota ...

- Spring-Kafka —— KafkaListener定时启动和停止

一.定时启动的应用场景 比如现在单机环境下,我们需要利用Kafka做数据持久化的功能,由于用户活跃的时间为早上10点至晚上12点,那在这个时间段做一个大数据量的持久化可能会影响数据库性能导致用户体验降 ...

- Spring-Kafka —— KafkaListener禁止自启动

应用服务启动时,KafkaListener默认会自动启动进行消费,如果想不自动消费,可以设置AutoStartup属性值为false @Override @KafkaListener(id = Con ...

- Spring-Kafka —— KafkaListener手动启动和停止

一.KafkaListener消费 /** * 手动提交监听. * * @param record 消息记录 * @param ack 确认实例 */ @Override @KafkaListener ...

- Kafka从入门到进阶

1. Apache Kafka是一个分布式流平台 1.1 流平台有三个关键功能: 发布和订阅流记录,类似于一个消息队列或企业消息系统 以一种容错的持久方式存储记录流 在流记录生成的时候就处理它们 ...

- 《Kafka笔记》4、Kafka架构,与其他组件集成

目录 1 kafka架构进阶 1.1 Kafka底层数据的同步机制(面试常问) 1.1.1 高水位截断的同步方式可能带来数据丢失(Kafka 0.11版本前的问题) 1.1.2 解决高水位截断数据丢失 ...

随机推荐

- loaction.reload(false)和location.reload(true)的区别

loaction.reload(false)和location.reload(true)有差别啊,一个是先判断页面有没修改,有的话就从服务器下载页面,没有就直接从缓存里拿(这个会提升响应性能)而把该方 ...

- Linux之创建多个子进程

/*** fork_test.c ***/ #include<stdio.h> #include<stdlib.h> #include<unistd.h> int ...

- ICP、MRR、BKA等特性

一.Index Condition Pushdown(ICP) Index Condition Pushdown (ICP)是 mysql 使用索引从表中检索行数据的一种优化方式,从mysql5.6开 ...

- python 获取主机名称和ip地址

python2.7 #!/usr/bin/env python # Python Network Programming Cookbook -- Chapter - # This program is ...

- Kafaka详细介绍机制原理

1. kafka介绍 1.1. 主要功能 根据官网的介绍,ApacheKafka®是一个分布式流媒体平台,它主要有3种功能: 1:It lets you publish and ...

- Robot Framework(十六) 扩展RobotFramework框架——使用监听器接口

4.3使用监听器接口 Robot Framework有一个侦听器接口,可用于接收有关测试执行的通知.监听器是具有某些特殊方法的类或模块,它们可以用Python和Java实现.监听器接口的示例用法包括外 ...

- 八十年代的经典 NFS和AFS

NFS:(C/S模式) 大体架构: 1985年Sun公司基于UDP开发了网络共享文件系统(Network FileSystem) NFS由一系列NFS命令和进程组成的客户机/服务器模式,在第三版中加入 ...

- 【Golang】基于录制,自动生成go test接口自动化用例

背景 之前写过一篇博客,介绍怎么用Python通过解析抓包数据,完成自动化用例的编写.最近这段时间在使用go test,所以就在想能不能也使用代码来生成自动化用例,快速提升测试用例覆盖率.说干就干. ...

- vue实现穿梭框效果

vue实现穿梭框效果 一.总结 一句话总结: 用两个数组分别记录左右框框里面的值,用两个数组绑定checkbox,用来记录选中的checkbox值,根据选中的checkbox的值实现删除增加即可 1. ...

- [MyBatis]org.apache.ibatis.binding.BindingException的避免

我遇到的org.apache.ibatis.binding.BindingException问题是因为Mapper.java中接口和SQL的参数多于一个,Mybatis不知道如何一一对应,解决方法是加 ...