斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时5

课时5 数据驱动的图像分类方式:K最邻近与线性分类器(下)

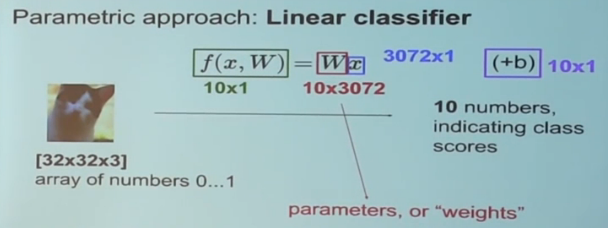

在参数化方法中,我们要做的是构造一个函数,输入一张图片,对每一类输出一个数值。对任意一张图片,我们会计算出它到底属于哪一类。这些参数有时候也会被称作权重。我们不能改原始图像,但是我们可以修改权重,我们希望把它设成对训练集中每张图像可以实现正确输出的值。

我们没办法应对不同大小的图片,但是我们可以做到的最简单的事情是改变每一张图片的大小使他们变成相同的大小。然后我们就可以确定的把它们转换成在空间上都对齐的列。事实上,目前最前沿水平的方法只使用方形的图片。

有一种比较局限的W分类器的解释:类似于模板匹配

从定义出发,神经网络可以具备多个模型,分别针对于不同的车,然后结合这些模型给出更强大的分类器,使分类更加合理。

可以把图片看成有很高维度的。线性分类器都在描述在这个3072维度空间上的梯度,而这些分数就是在这个取样空间中负点指向正点方向的梯度。我们会随机的初始化这些分类器,也就是说这条线代表的分类器在开始优化的时候,这个分类器会逐渐的移动渐渐的把属于你要找的类的点与其他点分隔开,从而完成训练。

损失函数可以定量的测定分类器工作的好坏。损失函数能够定量的测量每一个W,通过这个函数,我们不需要控制W的初始值。一旦找到一个W,使得你损失的值非常低,则可以说这个分类器正确的分类你所有的图片。在优化的过程中,我们会选择一个随机的W开始,我们可以通过一个循环的过程,在这个过程中每一次循环都可以使这个权值有一个微小的提高,这个提高可以通过损失函数值的减少来表现。在这个循环中,我们通过观察损失函数的梯度,可以确定在哪个方向上损失函数值会减少,然后通过调整参数使得函数值向着这个方向一点点运动从而达到降低损失值的目的。

斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时5的更多相关文章

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时3

课时3 计算机视觉历史回顾与介绍下 ImageNet有5000万张图片,全部都是人工清洗过得,标注了超过2万个分类. CS231n将聚焦于视觉识别问题,图像分类关注的是大图整体:物体检测告诉你东西具体 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时1

课时1 计算机视觉历史回顾与介绍上 CS231n:这一一门关于计算机视觉的课程,基于一种专用的模型架构,叫做神经网络(更细一点说,是卷积神经网络CNN).计算机视觉是人工智能领域中发展最为迅猛的一个分 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时26&&27

课时26 图像分割与注意力模型(上) 语义分割:我们有输入图像和固定的几个图像分类,任务是我们想要输入一个图像,然后我们要标记每个像素所属的标签为固定数据类中的一个 使用卷积神经,网络为每个小区块进行 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时24&&25

课时24 深度学习开源库使用介绍(上) Caffe 被用于重新实现AlexNet,然后用AlexNet的特征来解决其他事情 用C++书写的,可以去GitHub上面读取源代码 主要四个类: Blob可以 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时8&&9

课时8 反向传播与神经网络初步(上) 反向传播在运算连路中,这是一种通过链式法则来进行递推的计算过程,这个链路中的每一个中间变量都会对最终的损失函数产生影响. 链式法则通常包含两部分,局部梯度和后一层 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时12&&13

课时12 神经网络训练细节part2(上) 训练神经网络是由四步过程组成,你有一个完整的数据集图像和标签,从数据集中取出一小批样本,我们通过网络做前向传播得到损失,告诉我们目前分类效果怎么样.然后我们 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时11

课时11 神经网络训练细节part1(下) 2010年,Glorot等人写的论文,我们称之为Xavier初始化,他们关注了神经元的方差表达式.他们推荐一种初始化方式,那就是对每个神经元的输入进行开根号 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时10

课时10 神经网络训练细节part1(上) 没有大量的数据也不会有太多影响,只需要找一个经过预训练的卷积神经网络然后进行调整 从数据集中抽样一小批数据, 将数据运入卷积神经网络中来计算损失值 通过反向 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时7

课时7 线性分类器损失函数与最优化(下) 我们为什么要最大化对数概率而非直接最大化概率? 你在做逻辑斯蒂回归时,如果你只是想要最大化概率,那你使用log是无意义的.因为log函数是单调函数,最大化概率 ...

- 斯坦福CS231n—深度学习与计算机视觉----学习笔记 课时14&&15

课时14 卷积神经网络详解(上) CNN处理的是一些数据块,在这之间有很多层,一系列的层将输入数据变换为输出数据,所以完成操作的中间量不仅是NN时候讲的那些向量,而是立体结构,有宽,高和深度,在整个计 ...

随机推荐

- 十步叫你如何无损修复硬盘锁(mbr病毒)

经常看见有人被锁硬盘 开机以后出现一行红字 FUCK YOU POJIEZHE 等等云云的 这个问题主要还是病毒对Mbr分区的修改造成的 下面我教给大家一个无损数据 无损硬盘 无需重装系统 ...

- Matlab中配置VLFeat

在VLFeat官网上是这么介绍VLFeat的:VLFeat开源库实现了很多著名的机器视觉算法,如HOG, SIFT, MSER, k-means, hierarchical k-means, aggl ...

- vim中末行去掉^M

在Ubuntu系统中打开文件,发现文件中每一个末行都有^M,我们要做的是知道这一个无关的字符是什么作用,然后删除掉这一个无关的字符. 工具/原料 ubuntu操作系统 Vim编辑器 方法/步骤 ...

- [poj 2331] Water pipe ID A*迭代加深搜索(dfs)

Water pipe Time Limit: 3000MS Memory Limit: 65536K Total Submissions: 2265 Accepted: 602 Description ...

- linux的主分区与逻辑分区的关系

主分区和扩展分区的差别在于主分区位于硬盘的最開始.MBR 扇区的位置.这个位置的数据在计算机启动时.会自己主动被 BIOS 读取而且运行,也就是说这个位置的分区表会自己主动被 BIOS 读取到内 ...

- 【转载】读懂IL代码就这么简单(二)

一 前言 IL系列 第一篇写完后 得到高人指点,及时更正了文章中的错误,也使得我写这篇文章时更加谨慎,自己在了解相关知识点时,也更为细致.个人觉得既然做为文章写出来,就一定要保证比较高的质量,和正确率 ...

- [Elasticsearch] 部分匹配 (四) - 索引期间优化ngrams及索引期间的即时搜索

本章翻译自Elasticsearch官方指南的Partial Matching一章. 索引期间的优化(Index-time Optimizations) 眼下我们讨论的全部方案都是在查询期间的.它们不 ...

- C# 通过window消息控制指定控件的scroll滚动

[DllImport("User32.dll", CharSet = CharSet.Auto, SetLastError = true)] private st ...

- ActionFilterAttribute之HtmlFilter,压缩HTML代码

当开启这个过滤器后,最终生成的HTML代码将会被压缩一下,在流量很大的网站中,能减少带宽成本就减少一点,何乐而不为? [csharp] view plaincopy using System; usi ...

- BZOJ 4976: 宝石镶嵌 背包

4976: 宝石镶嵌 Time Limit: 2 Sec Memory Limit: 128 MB Description 魔法师小Q拥有n个宝石,每个宝石的魔力依次为w_1,w_2,...,w_n ...