Spark 分布式调试工具

0. 说明

编写工具类,考察 Spark 分布式程序的执行地点

1. 工具类编写

[ JMX ]

Java Management Extend , Java 管理扩展服务。

主要用于运维和监控。

【测试 JMX】

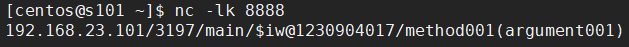

开启 nc,参考 [Linux] nc

nc -lk 8888

通过 Client 模式运行 Spark

spark-shell --master spark://s101:7077 --deploy-mode client

在 Spark Shell 下通过 :paste 执行以下代码

def sendInfo(obj:Object ,m:String , param:String)= {

val ip = java.net.InetAddress.getLocalHost.getHostAddress

val pid = java.lang.management.ManagementFactory.getRuntimeMXBean.getName.split("@")(0)

val tname = Thread.currentThread().getName

val classname = obj.getClass.getSimpleName

val objHash = obj.hashCode()

val info = ip + "/" + pid + "/" + tname + "/" + classname + "@" + objHash + "/" + m + "("+param+")" + "\r\n"

//发送数据给nc 服务器

val sock = new java.net.Socket("s101" , 8888)

val out = sock.getOutputStream

out.write(info.getBytes())

out.flush()

out.close()

}

再执行以下命令

sendInfo(this, "method001" , "argument001")

在 nc 端监听到的数据如下

IP 进程id 线程 对象id 方法(参数 )

2. WordCount

通过 Client 模式运行 Spark

spark-shell --master spark://s101:7077 --deploy-mode client

在 Spark Shell 下通过 :paste 执行以下代码

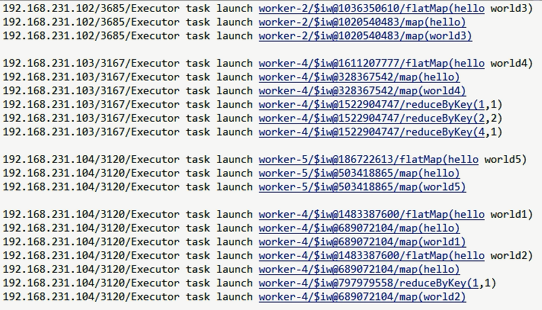

val rdd1 = sc.textFile("/user/centos/data/11.txt" , 4)

val rdd2 = rdd1.flatMap(line=>{

sendInfo(this , "flatMap" , line)

line.split(" ")}

)

val rdd3 = rdd2.map(word=>{

sendInfo(this , "map" , word)

(word,1)

})

val rdd4 = rdd3.reduceByKey((a,b)=>{

sendInfo(this, "reduceByKey", a + "," + b)

a + b

})

val arr = rdd4.collect()

nc 监听到的数据(参考 [Linux] nc)

Spark 分布式调试工具的更多相关文章

- 深度剖析Spark分布式执行原理

让代码分布式运行是所有分布式计算框架需要解决的最基本的问题. Spark是大数据领域中相当火热的计算框架,在大数据分析领域有一统江湖的趋势,网上对于Spark源码分析的文章有很多,但是介绍Spark如 ...

- Spark分布式执行原理

Spark分布式执行原理 让代码分布式运行是所有分布式计算框架需要解决的最基本的问题. Spark是大数据领域中相当火热的计算框架,在大数据分析领域有一统江湖的趋势,网上对于Spark源码分析的文章有 ...

- Spark 分布式环境--连接独立集群管理器

Spark 分布式环境:master,worker 节点都配置好的情况下 : 却无法通过spark-shell连接到 独立集群管理器 spark-shell --master spark://soyo ...

- Spark分布式编程之全局变量专题【共享变量】

转载自:http://www.aboutyun.com/thread-19652-1-1.html 问题导读 1.spark共享变量的作用是什么?2.什么情况下使用共享变量?3.如何在程序中使用共享变 ...

- Spark 分布式SQL引擎

SparkSQL作为分布式查询引擎:两种方式 SparkSQL作为分布式查询引擎:Thrift JDBC/ODBC服务 SparkSQL作为分布式查询引擎:Thrift JDBC/ODBC服务 Spa ...

- 【异常检测】Isolation forest 的spark 分布式实现

1.算法简介 算法的原始论文 http://cs.nju.edu.cn/zhouzh/zhouzh.files/publication/icdm08b.pdf .python的sklearn中已经实现 ...

- Spark Standalone Mode 单机启动Spark -- 分布式计算系统spark学习(一)

spark是个啥? Spark是一个通用的并行计算框架,由UCBerkeley的AMP实验室开发. Spark和Hadoop有什么不同呢? Spark是基于map reduce算法实现的分布式计算,拥 ...

- Spark实战--搭建我们的Spark分布式架构

Spark的分布式架构 如我们所知,spark之所以强大,除了强大的数据处理功能,另一个优势就在于良好的分布式架构.举一个例子在Spark实战--寻找5亿次访问中,访问次数最多的人中,我用四个spar ...

- Spark分布式安装

三台 服务器 n0,n2,n3 centos 6.4 X64 JDK, SCALA 2.11 Hadoop 2.2.0 spark-0.9.1-bin-hadoop2.tgz 说明: 1.所有机器上安 ...

随机推荐

- Prometheus+Grafana打造Mysql监控平台

prometheus/node_exporter/mysqld_exporter都是由go语言编写,需要先安装GoLang环境 下载node_exporter(监控服务器的CPU.内存.存储使用情况) ...

- 嵌入式Linux安装Dropbear SSH server

0. 背景 OpenSSH因为其相对较大,一般不太适用于嵌入式平台,多用于PC或者服务器的Linux版本中. Dropbear是一个相对较小的SSH服务器和客户端.它运行在一个基于POSIX的各种平台 ...

- Nodejs微信公众号开发

概览 key value 项目名称 node微信公众号开发 项目描述 使用node编写接口,前后端分离获取签名数据 开发者 leinov 发布日期 2018-11-07 仓库 github地址 安装& ...

- [转]C# NPOI 导入与导出Excel文档 兼容xlsx, xls

本文转自:https://www.cnblogs.com/lazyneal/p/6148912.html 参考:http://www.cnblogs.com/restran/p/3889479.htm ...

- 访问 .obj文件,由于扩展配置问题而无法提供您请求的页面。如果该页面是脚本,请添加处理程序。如果应下载文件,请添加 MIME 映射

一.错误描述 HTTP 错误 404.3 - Not Found 由于扩展配置问题而无法提供您请求的页面.如果该页面是脚本,请添加处理程序.如果应下载文件,请添加 MIME 映射. 最可能的原因: 可 ...

- Python生成语音

from aip import AipSpeech # 利用百度语音合成音频文件 """ 你的 APPID AK SK """ APP_ID ...

- 编程输出杨辉三角的前10行---多维数组的应用---java实现

import java.util.Scanner;public class yanghui{ public static void main(String[] args){ Scanner sc=n ...

- js获取指定格式的时间字符串

如下: // 对Date的扩展,将 Date 转化为指定格式的String // 月(M).日(d).小时(h).分(m).秒(s).季度(q) 可以用 1-2 个占位符, // 年(y)可以用 1- ...

- Java 基础:变量 与 字符串

变量 Java中没有初始化的变量是不能直接使用的 局部变量 String msg; System.out.print(msg); 就会提示错误,我们必须显式的为变量指定一个初值如null.刚开始学Ja ...

- 说说gogoTester-nodejs 的实现

一直在使用goagent,所以对于查找google可用ip有了很大的兴趣,在github上面发现有一个项目是gogoTester,是用来查找google ip的,于是突发奇想自己用nodejs写了一个 ...