tensorflow笔记:模型的保存与训练过程可视化

tensorflow笔记系列:

(一) tensorflow笔记:流程,概念和简单代码注释

(二) tensorflow笔记:多层CNN代码分析

(三) tensorflow笔记:多层LSTM代码分析

(四) tensorflow笔记:常用函数说明

(五) tensorflow笔记:模型的保存与训练过程可视化

(六)tensorflow笔记:使用tf来实现word2vec

保存与读取模型

在使用tf来训练模型的时候,难免会出现中断的情况。这时候自然就希望能够将辛辛苦苦得到的中间参数保留下来,不然下次又要重新开始。好在tf官方提供了保存和读取模型的方法。

保存模型的方法:

# 之前是各种构建模型graph的操作(矩阵相乘,sigmoid等等....)

saver = tf.train.Saver() # 生成saver

with tf.Session() as sess:

sess.run(tf.global_variables_initializer()) # 先对模型初始化

# 然后将数据丢入模型进行训练blablabla

# 训练完以后,使用saver.save 来保存

saver.save(sess, "save_path/file_name") #file_name如果不存在的话,会自动创建将模型保存好以后,载入也比较方便,如下所示:

saver = tf.train.Saver()

with tf.Session() as sess:

#参数可以进行初始化,也可不进行初始化。即使初始化了,初始化的值也会被restore的值给覆盖

sess.run(tf.global_variables_initializer())

saver.restore(sess, "save_path/file_name") #会将已经保存的变量值resotre到 变量中。简单的说,就是通过saver.save来保存模型,通过saver.restore来加载模型

使用tensorboard来使训练过程可视化

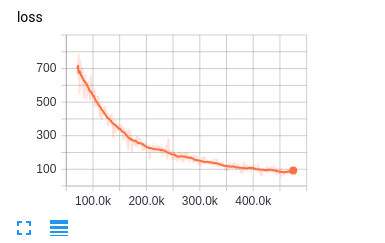

tensorflow还提供了一个可视化工具,叫tensorboard.启动以后,可以通过网页来观察模型的结构和训练过程中各个参数的变化。如下图所示

关于如何合理清楚的显示网络结构,我目前还不太搞得清楚,而且目前看来也不是太重要;但是要将训练的过程可视化还是比较方便的。简单的说,流程如下所示:

- 使用tf.scalar_summary来收集想要显示的变量

- 定义一个summury op, 用来汇总多个变量

- 得到一个summy writer,指定写入路径

- 通过summary_str = sess.run()

# 1. 由之前的各种运算得到此批数据的loss

loss = .....

# 2.使用tf.scalar_summary来收集想要显示的变量,命名为loss

tf.scalar_summary('loss',loss)

# 3.定义一个summury op, 用来汇总由scalar_summary记录的所有变量

merged_summary_op = tf.merge_all_summaries()

# 4.生成一个summary writer对象,需要指定写入路径,例如我这边就是/tmp/logdir

summary_writer = tf.train.SummaryWriter('/tmp/logdir', sess.graph)

# 开始训练,分批喂数据

for(i in range(batch_num)):

# 5.使用sess.run来得到merged_summary_op的返回值

summary_str = sess.run(merged_summary_op)

# 6.使用summary writer将运行中的loss值写入

summary_writer.add_summary(summary_str,i)接下来,程序开始运行以后,跑到shell里运行

$ tensorboard --logdir /tmp/logdir开始运行tensorboard.接下来打开浏览器,进入127.0.0.1:6006 就能够看到loss值在训练中的变化值了。

tensorflow笔记:模型的保存与训练过程可视化的更多相关文章

- tensorflow:模型的保存和训练过程可视化

在使用tf来训练模型的时候,难免会出现中断的情况.这时候自然就希望能够将辛辛苦苦得到的中间参数保留下来,不然下次又要重新开始. 保存模型的方法: #之前是各种构建模型graph的操作(矩阵相乘,sig ...

- TensorFlow笔记-模型的保存,恢复,实现线性回归

模型的保存 tf.train.Saver(var_list=None,max_to_keep=5) •var_list:指定将要保存和还原的变量.它可以作为一个 dict或一个列表传递. •max_t ...

- TensorFlow笔记-04-神经网络的实现过程,前向传播

TensorFlow笔记-04-神经网络的实现过程,前向传播 基于TensorFlow的NN:用张量表示数据,用计算图搭建神经网络,用会话执行计算图,优化线上的权重(参数),得到模型 张量(tenso ...

- 【TensorFlow】TensorFlow基础 —— 模型的保存读取与可视化方法总结

TensorFlow提供了一个用于保存模型的工具以及一个可视化方案 这里使用的TensorFlow为1.3.0版本 一.保存模型数据 模型数据以文件的形式保存到本地: 使用神经网络模型进行大数据量和复 ...

- Tensorflow学习笔记----模型的保存和读取(4)

一.模型的保存:tf.train.Saver类中的save TensorFlow提供了一个一个API来保存和还原一个模型,即tf.train.Saver类.以下代码为保存TensorFlow计算图的方 ...

- Tensorflow Learning1 模型的保存和恢复

CKPT->pb Demo 解析 tensor name 和 node name 的区别 Pb 的恢复 CKPT->pb tensorflow的模型保存有两种形式: 1. ckpt:可以恢 ...

- tensorflow 之模型的保存与加载(一)

怎样让通过训练的神经网络模型得以复用? 本文先介绍简单的模型保存与加载的方法,后续文章再慢慢深入解读. #!/usr/bin/env python3 #-*- coding:utf-8 -*- ### ...

- tensorflow 之模型的保存与加载(三)

前面的两篇博文 第一篇:简单的模型保存和加载,会包含所有的信息:神经网络的op,node,args等; 第二篇:选择性的进行模型参数的保存与加载. 本篇介绍,只保存和加载神经网络的计算图,即前向传播的 ...

- tensorflow 之模型的保存与加载(二)

上一遍博文提到 有些场景下,可能只需要保存或加载部分变量,并不是所有隐藏层的参数都需要重新训练. 在实例化tf.train.Saver对象时,可以提供一个列表或字典来指定需要保存或加载的变量. #!/ ...

随机推荐

- 记录--常用的linux命令

mysql event /*查询event是否开启(查询结果Off为关闭 On为开启)*/ show variables like '%sche%'; /*开启/关闭命令(1开启--0关闭)*/ se ...

- 巨蟒python全栈开发-第11天 第一类对象 闭包 迭代器

一.今日主要内容总览(重点) 1.第一类对象->函数名=>变量名 (1)函数对象可以像变量一样进行赋值 (2)还可以作为列表的元素进行使用 (3)还可以作为返回值返回 (4)还可以作为参数 ...

- 巨蟒python全栈开发-第23天 内置常用模块2

一.今日主要内容 1.nametuple:(命名元组,本质还是元组) 命名元组=>类似创建了一个类 结构化时间其实是个命名元组 2.os 主要是针对操作系统的 一般用来操作文件系统 os.mak ...

- 巨蟒python全栈开发flask3

首先,我们新建一个项目: 这个时候,我们调用ab函数,可以在所有的模板中使用. 上边是一个特殊装饰器, 1.flask特殊装饰器 下面说几个特殊的装饰器 再请求之前的装饰器 运行: 这个时候,服务端打 ...

- php 正则表达式四,例子

PHP常用正则表达式汇总:http://bbs.php100.com/read-htm-tid-83266.html 1.非空匹配: .+ 2.浮点数匹配: ^\d+.\d{2}$ 3.手机号匹配: ...

- 实践中需要了解的cpu特性

目录 分段机制 特权级检查 GDT和LDT 堆栈切换 分页机制 中断 分段机制 实模式中cs是一个实实在在的段首地址,ip为cs所指向段的偏移,所以cs<<4+ip是当前cpu执行的指令. ...

- buffer/interger overflow /return-to-libc攻击实验

buffer/interger overflow /return-to-libc攻击实验 http://blog.sina.com.cn/s/blog_70dd16910100rdgn.html ht ...

- Set 接口常用子类及其特点

Set 集合中元素不可重复,是无序的(存入和取出的顺序是不一样的), Set 接口中的方法和 Collection 接口一致. 常用子类: HashSet : 内部数据结构是哈希表, 是不同步的 Li ...

- 浅谈 Python 的 with 语句(转)

add by zhj: 上下文管理器是对try-except-finally的再封装而已,只能算是优化代码这一级别的feature 原文:http://www.ibm.com/developerwor ...

- 初识Locust---认识

性 能测试工具: 基于Python的性能测试工具-locust 现在性能测试方面有很多测试工具,比如我们熟悉的loadrunner.jmeter.ab等,用过的也就是这几种,如果是学过这些工具的可能对 ...