tensorflow笔记:模型的保存与训练过程可视化

tensorflow笔记系列:

(一) tensorflow笔记:流程,概念和简单代码注释

(二) tensorflow笔记:多层CNN代码分析

(三) tensorflow笔记:多层LSTM代码分析

(四) tensorflow笔记:常用函数说明

(五) tensorflow笔记:模型的保存与训练过程可视化

(六)tensorflow笔记:使用tf来实现word2vec

保存与读取模型

在使用tf来训练模型的时候,难免会出现中断的情况。这时候自然就希望能够将辛辛苦苦得到的中间参数保留下来,不然下次又要重新开始。好在tf官方提供了保存和读取模型的方法。

保存模型的方法:

# 之前是各种构建模型graph的操作(矩阵相乘,sigmoid等等....)

saver = tf.train.Saver() # 生成saver

with tf.Session() as sess:

sess.run(tf.global_variables_initializer()) # 先对模型初始化

# 然后将数据丢入模型进行训练blablabla

# 训练完以后,使用saver.save 来保存

saver.save(sess, "save_path/file_name") #file_name如果不存在的话,会自动创建将模型保存好以后,载入也比较方便,如下所示:

saver = tf.train.Saver()

with tf.Session() as sess:

#参数可以进行初始化,也可不进行初始化。即使初始化了,初始化的值也会被restore的值给覆盖

sess.run(tf.global_variables_initializer())

saver.restore(sess, "save_path/file_name") #会将已经保存的变量值resotre到 变量中。简单的说,就是通过saver.save来保存模型,通过saver.restore来加载模型

使用tensorboard来使训练过程可视化

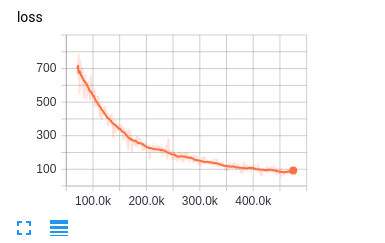

tensorflow还提供了一个可视化工具,叫tensorboard.启动以后,可以通过网页来观察模型的结构和训练过程中各个参数的变化。如下图所示

关于如何合理清楚的显示网络结构,我目前还不太搞得清楚,而且目前看来也不是太重要;但是要将训练的过程可视化还是比较方便的。简单的说,流程如下所示:

- 使用tf.scalar_summary来收集想要显示的变量

- 定义一个summury op, 用来汇总多个变量

- 得到一个summy writer,指定写入路径

- 通过summary_str = sess.run()

# 1. 由之前的各种运算得到此批数据的loss

loss = .....

# 2.使用tf.scalar_summary来收集想要显示的变量,命名为loss

tf.scalar_summary('loss',loss)

# 3.定义一个summury op, 用来汇总由scalar_summary记录的所有变量

merged_summary_op = tf.merge_all_summaries()

# 4.生成一个summary writer对象,需要指定写入路径,例如我这边就是/tmp/logdir

summary_writer = tf.train.SummaryWriter('/tmp/logdir', sess.graph)

# 开始训练,分批喂数据

for(i in range(batch_num)):

# 5.使用sess.run来得到merged_summary_op的返回值

summary_str = sess.run(merged_summary_op)

# 6.使用summary writer将运行中的loss值写入

summary_writer.add_summary(summary_str,i)接下来,程序开始运行以后,跑到shell里运行

$ tensorboard --logdir /tmp/logdir开始运行tensorboard.接下来打开浏览器,进入127.0.0.1:6006 就能够看到loss值在训练中的变化值了。

tensorflow笔记:模型的保存与训练过程可视化的更多相关文章

- tensorflow:模型的保存和训练过程可视化

在使用tf来训练模型的时候,难免会出现中断的情况.这时候自然就希望能够将辛辛苦苦得到的中间参数保留下来,不然下次又要重新开始. 保存模型的方法: #之前是各种构建模型graph的操作(矩阵相乘,sig ...

- TensorFlow笔记-模型的保存,恢复,实现线性回归

模型的保存 tf.train.Saver(var_list=None,max_to_keep=5) •var_list:指定将要保存和还原的变量.它可以作为一个 dict或一个列表传递. •max_t ...

- TensorFlow笔记-04-神经网络的实现过程,前向传播

TensorFlow笔记-04-神经网络的实现过程,前向传播 基于TensorFlow的NN:用张量表示数据,用计算图搭建神经网络,用会话执行计算图,优化线上的权重(参数),得到模型 张量(tenso ...

- 【TensorFlow】TensorFlow基础 —— 模型的保存读取与可视化方法总结

TensorFlow提供了一个用于保存模型的工具以及一个可视化方案 这里使用的TensorFlow为1.3.0版本 一.保存模型数据 模型数据以文件的形式保存到本地: 使用神经网络模型进行大数据量和复 ...

- Tensorflow学习笔记----模型的保存和读取(4)

一.模型的保存:tf.train.Saver类中的save TensorFlow提供了一个一个API来保存和还原一个模型,即tf.train.Saver类.以下代码为保存TensorFlow计算图的方 ...

- Tensorflow Learning1 模型的保存和恢复

CKPT->pb Demo 解析 tensor name 和 node name 的区别 Pb 的恢复 CKPT->pb tensorflow的模型保存有两种形式: 1. ckpt:可以恢 ...

- tensorflow 之模型的保存与加载(一)

怎样让通过训练的神经网络模型得以复用? 本文先介绍简单的模型保存与加载的方法,后续文章再慢慢深入解读. #!/usr/bin/env python3 #-*- coding:utf-8 -*- ### ...

- tensorflow 之模型的保存与加载(三)

前面的两篇博文 第一篇:简单的模型保存和加载,会包含所有的信息:神经网络的op,node,args等; 第二篇:选择性的进行模型参数的保存与加载. 本篇介绍,只保存和加载神经网络的计算图,即前向传播的 ...

- tensorflow 之模型的保存与加载(二)

上一遍博文提到 有些场景下,可能只需要保存或加载部分变量,并不是所有隐藏层的参数都需要重新训练. 在实例化tf.train.Saver对象时,可以提供一个列表或字典来指定需要保存或加载的变量. #!/ ...

随机推荐

- Percolator

Percolator_百度百科 https://baike.baidu.com/item/Percolator/3772109 英 [ˈpɜ:kəleɪtə(r)]美 [ˈpɚkəˌletɚ] n.过 ...

- Character Sets, Collation, Unicode :: utf8_unicode_ci vs utf8_general_ci

w Hi, You can check and compare sort orders provided by these two collations here: http://www.collat ...

- Java 语言基础之函数

函数的定义: 函数就是定义在类中的具有特定功能的一段独立小程序 函数也称为方法 函数定义格式: 修饰符 返回值类型 函数名(参数类型 形式参数1, 参数类型 形式参数2,...) { 执行语句; re ...

- JavaScript 入门之常见对象

常见对象 1. Object 对象 2. String 对象 3. Array 对象 4. Date 对象 5. Number 对象 6. 自定义对象 with 语句 为了简化对象调用内容的书写 格式 ...

- 如何重定向 stderr ?

可以使用该方法写一个轻量级日志类 #include <cstdio> int main() { FILE *stream = freopen("freopen.txt" ...

- Java创建Timestamp的几种方式

1.java创建Timestamp的几种方式 Timestamp time1 = new Timestamp(System.currentTimeMillis()); Timestamp time2 ...

- python2 一些错误处理

python2各种问题 pip安装django出错:python2 -m pip install django 编码问题:Unicode Decode Error ascii codec can't ...

- 对比MySQL,你究竟在什么时候更需要MongoDB(转)

译文:对比MySQL,你究竟在什么时候更需要MongoDB 原文链接: When Should I Use MongoDB rather than MySQL (or other RDBMS): Th ...

- Python(数据库之约束表的关系)

一.约束 约束条件与数据类型的宽度一样,都是可选参数 作用:用于保证数据的完整性和一致性 主要分为: RIMARY KEY (PK) 标识该字段为该表的主键,可以唯一的标识记录 FOREIGN KEY ...

- Android studio 如何快速收起代码?

windows下 ctrl+shift+(小键盘上的减号 -) mac下 commang+shift+减号,搞定