Tensorflow之CNN卷积层池化层padding规则

padding的规则

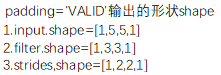

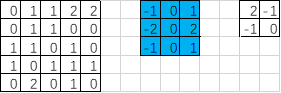

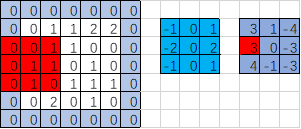

· padding=‘VALID’时,输出的宽度和高度的计算公式(下图gif为例)

输出宽度:output_width = (in_width-filter_width+1)/strides_width =(5-3+1)/2=1.5【向上取整=2】

输出高度:output_height = (in_height-filter_height+1)/strides_height =(5-3+1)/2=1.5【向上取整=2】

输出的形状[1,2,2,1]

import tensorflow as tf

image = [0,1.0,1,2,2,0,1,1,0,0,1,1,0,1,0,1,0,1,1,1,0,2,0,1,0]

input = tf.Variable(tf.constant(image,shape=[1,5,5,1])) ##1通道输入

fil1 = [-1.0,0,1,-2,0,2,-1,0,1]

filter = tf.Variable(tf.constant(fil1,shape=[3,3,1,1])) ##1个卷积核对应1个featuremap输出 op = tf.nn.conv2d(input,filter,strides=[1,2,2,1],padding='VALID') ##步长2,VALID不补0操作 init = tf.global_variables_initializer() with tf.Session() as sess:

sess.run(init)

# print('input:\n', sess.run(input))

# print('filter:\n', sess.run(filter))

print('op:\n',sess.run(op)) ##输出结果

'''

[[[[ 2.]

[-1.]] [[-1.]

[ 0.]]]]

'''

VALID步长2

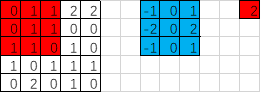

如果strides=[1,3,3,1]的情况又是如何呢?

输出宽度:output_width = (in_width-filter_width+1)/strides_width =(5-3+1)/3=1

输出高度:output_height = (in_height-filter_height+1)/strides_height =(5-3+1)/3=1

输出的形状[1,1,1,1],因此输出的结果只有一个

import tensorflow as tf

image = [0,1.0,1,2,2,0,1,1,0,0,1,1,0,1,0,1,0,1,1,1,0,2,0,1,0]

input = tf.Variable(tf.constant(image,shape=[1,5,5,1])) ##1通道输入

fil1 = [-1.0,0,1,-2,0,2,-1,0,1]

filter = tf.Variable(tf.constant(fil1,shape=[3,3,1,1])) ##1个卷积核对应1个featuremap输出 op = tf.nn.conv2d(input,filter,strides=[1,3,3,1],padding='VALID') ##步长2,VALID不补0操作 init = tf.global_variables_initializer() with tf.Session() as sess:

sess.run(init)

# print('input:\n', sess.run(input))

# print('filter:\n', sess.run(filter))

print('op:\n',sess.run(op)) ##输出结果

'''

op:

[[[[ 2.]]]]

'''

VALID步长3

padding=‘SAME’时,输出的宽度和高度的计算公式

输出宽度:output_width = in_width/strides_width=5/2=2.5【向上取整3】

输出高度:output_height = in_height/strides_height=5/2=2.5【向上取整3】

则输出的形状:[1,3,3,1]

那么padding补0的规则又是如何的呢?【先确定输出形状,再计算补多少0】

pad_width = max((out_width-1)*strides_width+filter_width-in_width,0)=max((3-1)*2+3-5,0)=2

pad_height = max((out_height-1)*strides_height+filter_height-in_height,0)=max((3-1)*2+3-5,0)=2

pad_top = pad_height/2=1

pad_bottom = pad_height-pad_top=1

pad_left = pad_width/2=1

pad_right = pad_width-pad_left=1

import tensorflow as tf

image = [0,1.0,1,2,2,0,1,1,0,0,1,1,0,1,0,1,0,1,1,1,0,2,0,1,0]

input = tf.Variable(tf.constant(image,shape=[1,5,5,1])) ##1通道输入

fil1 = [-1.0,0,1,-2,0,2,-1,0,1]

filter = tf.Variable(tf.constant(fil1,shape=[3,3,1,1])) ##1个卷积核对应1个featuremap输出 op = tf.nn.conv2d(input,filter,strides=[1,2,2,1],padding='SAME') ##步长2,VALID不补0操作 init = tf.global_variables_initializer() with tf.Session() as sess:

sess.run(init)

# print('input:\n', sess.run(input))

# print('filter:\n', sess.run(filter))

print('op:\n',sess.run(op)) ##输出结果

'''

op:

[[[[ 3.]

[ 1.]

[-4.]] [[ 3.]

[ 0.]

[-3.]] [[ 4.]

[-1.]

[-3.]]]]

'''

SAME步长2

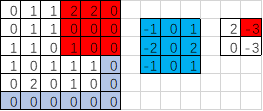

如果步长为3呢?补0的规则又如何?

输出宽度:output_width = in_width/strides_width=5/3=2

输出高度:output_height = in_height/strides_height=5/3=2

则输出的形状:[1,2,2,1]

那么padding补0的规则又是如何的呢?【先确定输出形状,再计算补多少0】

pad_width = max((out_width-1)*strides_width+filter_width-in_width,0)=max((2-1)*3+3-5,0)=1

pad_height = max((out_height-1)*strides_height+filter_height-in_height,0)=max((2-1)*3+3-5,0)=1

pad_top = pad_height/2=0【向下取整】

pad_bottom = pad_height-pad_top=1

pad_left = pad_width/2=0【向下取整】

pad_right = pad_width-pad_left=1

import tensorflow as tf

print(3/2)

image = [0,1.0,1,2,2,0,1,1,0,0,1,1,0,1,0,1,0,1,1,1,0,2,0,1,0]

input = tf.Variable(tf.constant(image,shape=[1,5,5,1])) ##1通道输入

fil1 = [-1.0,0,1,-2,0,2,-1,0,1]

filter = tf.Variable(tf.constant(fil1,shape=[3,3,1,1])) ##1个卷积核对应1个featuremap输出 op = tf.nn.conv2d(input,filter,strides=[1,3,3,1],padding='SAME') ##步长2,VALID不补0操作 init = tf.global_variables_initializer() with tf.Session() as sess:

sess.run(init)

# print('input:\n', sess.run(input))

# print('filter:\n', sess.run(filter))

print('op:\n',sess.run(op)) ##输出结果

'''

op:

[[[[ 2.]

[-3.]] [[ 0.]

[-3.]]]]

'''

SAME步长3

Tensorflow之CNN卷积层池化层padding规则的更多相关文章

- tensorflow中的卷积和池化层(一)

在官方tutorial的帮助下,我们已经使用了最简单的CNN用于Mnist的问题,而其实在这个过程中,主要的问题在于如何设置CNN网络,这和Caffe等框架的原理是一样的,但是tf的设置似乎更加简洁. ...

- tensorflow的卷积和池化层(二):记实践之cifar10

在tensorflow中的卷积和池化层(一)和各种卷积类型Convolution这两篇博客中,主要讲解了卷积神经网络的核心层,同时也结合当下流行的Caffe和tf框架做了介绍,本篇博客将接着tenso ...

- CNN中卷积层 池化层反向传播

参考:https://blog.csdn.net/kyang624823/article/details/78633897 卷积层 池化层反向传播: 1,CNN的前向传播 a)对于卷积层,卷积核与输入 ...

- tensorflow 1.0 学习:池化层(pooling)和全连接层(dense)

池化层定义在 tensorflow/python/layers/pooling.py. 有最大值池化和均值池化. 1.tf.layers.max_pooling2d max_pooling2d( in ...

- CNN中的池化层的理解和实例

池化操作是利用一个矩阵窗口在输入张量上进行扫描,并且每个窗口中的值通过取最大.取平均或其它的一些操作来减少元素个数.池化窗口由ksize来指定,根据strides的长度来决定移动步长.如果stride ...

- 『TensorFlow』卷积层、池化层详解

一.前向计算和反向传播数学过程讲解

- 第十三节,使用带有全局平均池化层的CNN对CIFAR10数据集分类

这里使用的数据集仍然是CIFAR-10,由于之前写过一篇使用AlexNet对CIFAR数据集进行分类的文章,已经详细介绍了这个数据集,当时我们是直接把这些图片的数据文件下载下来,然后使用pickle进 ...

- tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图

tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图 因为很多 demo 都比较复杂,专门抽出这两个函数,写的 demo. 更多教程:http://www.tensorflown ...

- CNN卷积神经网络的卷积层、池化层的输出维度计算公式

卷积层Conv的输入:高为h.宽为w,卷积核的长宽均为kernel,填充为pad,步长为Stride(长宽可不同,分别计算即可),则卷积层的输出维度为: 其中上开下闭开中括号表示向下取整. MaxPo ...

随机推荐

- 【转】交换分区SWAP

SWAP就是LINUX下的虚拟内存分区,它的作用是在物理内存使用完之后,将磁盘空间(也就是SWAP分区)虚拟成内存来使用. 它和Windows系统的交换文件作用类似,但是它是一段连续的磁盘空间,并且对 ...

- 网络流最大流dinic

hdu 6214 #include <bits/stdc++.h> #include<cstdio> #include<cstring> #include<q ...

- bzoj4165 矩阵 堆维护多路归并

题目传送门 https://lydsy.com/JudgeOnline/problem.php?id=4165 题解 大概多路归并是最很重要的知识点了吧,近几年考察也挺多的(虽然都是作为签到题的). ...

- heroinfo_set.all 函数

如果是 一对多 关系 即使用 heroinfo_set.all 此时关联字段类型通用,即上边的字段通用,但是需要添加many=True的参数heroinfo_set = serializers.Pr ...

- 【leetcode】1170. Compare Strings by Frequency of the Smallest Character

题目如下: Let's define a function f(s) over a non-empty string s, which calculates the frequency of the ...

- Oracle RAC数据泵导出问题处理

1. 设置导出文件路径 sqlplus / as sysdba SQL> alter session set container=spdb1pdb; SQL> create directo ...

- overload(重载) 和 override(重写)的区别

overload(重载): 重载是基于一个类中,方法名相同,参数列表不同(如果参数列表相同时,参数的类型要不同),与返回值和访问修饰符都无关 如果在面试中就直接说:"同名不同参" ...

- React Native 之ScrollView

import React, { Component } from 'react' import { Text, StyleSheet, View, Button ,TouchableOpacity,A ...

- sh_04_qq号码

sh_04_qq号码 # 1. 定义一个变量记录 QQ 号码 qq_number = " # 2. 定义一个变量记录 QQ 密码 qq_password = " # 注意:在使用解 ...

- webpack学习笔记二

sourceMap 源代码与打包后的代码的映射关系.例如,在某个源文件中test.js里面有个错误,如果开启状态,那么打包后运行的报错信息就会说明是错误的具体位置,如果是关闭状态,报错后,提示的报错位 ...