爬虫之 案列1补充(pipelines优化)

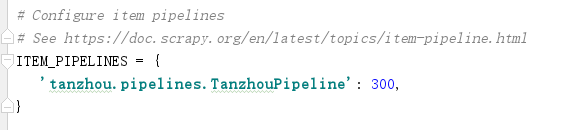

1. 先打开settings.py文件将 'ITEM_PIPELINES'启动(取消注释即可)

2. spider代码

# -*- coding: utf-8 -*-

import scrapy

import json class TzcSpider(scrapy.Spider):

# spider的名字,唯一

name = 'tzc'

# 起始地址

start_urls = ['https://hr.tencent.com/position.php?keywords=python&tid=0&lid=2268'] # 每个url爬取之后会调用这个方法

def parse(self, response):

tr = response.xpath( '//table[@class="tablelist"]/tr[@class = "even"]|//table[@class="tablelist"]/tr[@class = "odd"]')

if tr:

for i in tr:

data = {

"jobName": i.xpath('./td[1]/a/text()').extract_first(),

"jobType":i.xpath('./td[2]/text()').extract_first(),

"Num":i.xpath('./td[3]/text()').extract_first(),

"Place":i.xpath('./td[4]/text()').extract_first(),

"Time":i.xpath('./td[5]/text()').extract_first()

}

# 将数据变成json数据便于存储

# data = json.dumps(data,ensure_ascii=False)

yield data

# 寻找下一页标签

url_next = response.xpath('//a[@id = "next"]/@href').extract_first()

# 提取的是段标签,需要加上域名

url_next = 'https://hr.tencent.com/{}'.format(url_next)

# 返回下一页地址,scrapy会递归

yield scrapy.Request(url_next)

3. pipelines.py代码

import json class TanzhouPipeline(object):

def process_item(self, item, spider):

# 数据json化

item = json.dumps(item,ensure_ascii=False)

self.f.write(item)

self.f.write('\n')

return item

# 爬虫开启时运行

def open_spider(self,spider):

# 打开文件

self.f = open('info3.json','w')

# 爬虫关闭时运行

def close_spider(self,spider):

# 关闭文件

self.f.close()

4. 补充2,防止item不规范,可以使用items.py文件对其限制(还要改spider中的item代码)(还要修改pipelines中的代码,要先dict(item)转化成字典,再json转化)

pipeline.py中先转化成字典dict()再json转化:

item = json.dumps(dict(item),ensure_ascii=False)

items.py代码:

import scrapy class TanzhouItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

jobName = scrapy.Field()

jobType = scrapy.Field()

Num = scrapy.Field()

Place = scrapy.Field()

Time =scrapy.Field()

spider代码:

import scrapy

import json

from ..items import TanzhouItem class TzcSpider(scrapy.Spider):

# spider的名字,唯一

name = 'tzc'

# 起始地址

start_urls = ['https://hr.tencent.com/position.php?keywords=python&tid=0&lid=2268'] # 每个url爬取之后会调用这个方法

def parse(self, response):

tr = response.xpath( '//table[@class="tablelist"]/tr[@class = "even"]|//table[@class="tablelist"]/tr[@class = "odd"]')

if tr:

for i in tr:

# 自定义字典的方式,下面是第二种方式

data = {

"jobName": i.xpath('./td[1]/a/text()').extract_first(),

"jobType":i.xpath('./td[2]/text()').extract_first(),

"Num":i.xpath('./td[3]/text()').extract_first(),

"Place":i.xpath('./td[4]/text()').extract_first(),

"Time":i.xpath('./td[5]/text()').extract_first()

}

# 第二种方式,用items.py约束

# data = TanzhouItem()

# data["jobName"] = i.xpath('./td[1]/a/text()').extract_first()

# data["jobType"] = i.xpath('./td[2]/text()').extract_first()

# data["Num"] = i.xpath('./td[3]/text()').extract_first()

# data["Place"] = i.xpath('./td[4]/text()').extract_first()

# data["Time"] = i.xpath('./td[5]/text()').extract_first()

# 将数据变成json数据便于存储

# data = json.dumps(data,ensure_ascii=False)

yield data

# 寻找下一页标签

url_next = response.xpath('//a[@id = "next"]/@href').extract_first()

# 提取的是段标签,需要加上域名

url_next = 'https://hr.tencent.com/{}'.format(url_next)

# 返回下一页地址,scrapy会递归

yield scrapy.Request(url_next)

爬虫之 案列1补充(pipelines优化)的更多相关文章

- 2021年-在windwos下如何用TOMACT发布一个系统(完整配置案列)

2021年新年第一篇:博主@李宗盛-关于在Windwos下使用TOMCAT发布一个系统的完成配置案列. 之前写过关于TOMCAT的小篇幅文档,比较分散,可以作为对照与参考. 此篇整合在一起,一篇文档写 ...

- Spring MVC的配置文件(XML)的几个经典案列

1.既然是配置文件版的,那配置文件自然是必不可少,且应该会很复杂,那我们就以一个一个的来慢慢分析这些个经典案列吧! 01.实现Controller /* * 控制器 */ public class M ...

- js闭包的作用域以及闭包案列的介绍:

转载▼ 标签: it js闭包的作用域以及闭包案列的介绍: 首先我们根据前面的介绍来分析js闭包有什么作用,他会给我们编程带来什么好处? 闭包是为了更方便我们在处理js函数的时候会遇到以下的几 ...

- SAMSUNG某型号一千短信成功记录!对比其他软件恢复不成功的案列!

Hello! 大家好欢迎再次来到Dr.wonde的博客, 下面谈一下今天的案列,今年11月26号收到了一客户寄来的三星S4手机恢复里面短信, 如下图所示,用其他软件恢复以后,数据为零,没有恢复,,这下 ...

- php知识案列分享

今天再跟大家分享一下,以下案列. 使用array_flip函数生成随机数,可以去掉重复值. 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 < ...

- linux下mysql函数的详细案列

MYSQL * STDCALL mysql_real_connect(MYSQL *mysql, const char *host, const char *user, const char *pas ...

- axis1,xfire,jUnit 测试案列+开Web Service开发指南+axis1.jar下载 代码

axis1,xfire,jUnit 测试案列+Web Service开发指南(中).pdf+axis1.jar下载 代码 项目和资源文档+jar 下载:http://download.csdn. ...

- 大数据技术之_14_Oozie学习_Oozie 的简介+Oozie 的功能模块介绍+Oozie 的部署+Oozie 的使用案列

第1章 Oozie 的简介第2章 Oozie 的功能模块介绍2.1 模块2.2 常用节点第3章 Oozie 的部署3.1 部署 Hadoop(CDH版本的)3.1.1 解压缩 CDH 版本的 hado ...

- react 的安装和案列Todolist

react 的安装和案列Todolist 1.react的安装和环境的配置 首先检查有没有安装node.js和npm node -v npm -v 查看相关版本 2.安装脚手架工具 2.构建:crea ...

随机推荐

- kafka集群报错

bin/kafka-server-start.sh config/server.properties ,问题来了 : [root@localhost kafka_2.12-0.10.2.0]# Exc ...

- Confluence 6 删除垃圾内容

属性(profile)垃圾 属性垃圾的定义为,一个垃圾用户在 Confluence 创建了用户,但是这个用户在自己的属性页面中添加了垃圾 URL. 如果你有很多垃圾用户在你的系统中创建了属性,你可以使 ...

- Confluence 6 配置校验和识别

校验你的设置 查看你 Confluence 当前使用的设置,请参考 Viewing System Properties 页面中的内容. 识别系统属性 请参考 Recognized System Pro ...

- Confluence 6 数据库表和参考

扩展下面的链接来显示主要的表格和每一个表格的外键. 单击这里来显示/隐藏表格... AO_9412A1_AOUSER ID AO_9412A1_USER_APP_LINK USER_ID fk_ao ...

- leetcode(js)算法605之种花问题

假设你有一个很长的花坛,一部分地块种植了花,另一部分却没有.可是,花卉不能种植在相邻的地块上,它们会争夺水源,两者都会死去. 给定一个花坛(表示为一个数组包含0和1,其中0表示没种植花,1表示种植了花 ...

- django模板导入外部js和css等文件

1.新建文件夹templates(存放模板文件),新建文件夹media(存放js.css.images文件夹),并把两个文件夹放到了项目的根目录下 2.设定模板路径 设置模板路径比较简单,只要在set ...

- 使用Calendar获取上一月,下一月,上一年,下一年的当天日期

Calendar的add(int field,int amount)方法 field 表示月或年,天等字段 amount 代表增量或减量 例如: 上月的当天日期 Calendar cal = Cal ...

- Eclipse中java文件生成jar文件的方法

在eclpse中找到你要导出的java程序 选中它 单击文件 -->export 在弹出的export对话框中找到 jar File 单击选中-->next 按图示顺序依次 选 ...

- 使用7zip批量压缩文件夹到不同压缩包

for /d %%X in (*) do "c:\Program Files\7-Zip\7z.exe" a "%%X.7z" "%%X\" ...

- python WebDriver如何处理右键菜单

WebDriver如何处理右键菜单 一.背景 在学习selenium webdriver的过程中,遇到这样一个问题.ActionChains类中提供了context_click的方法,它可以用来在we ...