kafka删除topic的方法及我在kafka上边的一些经验

kafka删除topic的方法

kafka删除topic的方法2014-09-02 22:50:54

0.8的官方文档提供了一个删除topic的命令:

kafka-topics.sh --delete 但是在运行时会报错找不到这个方法。

kafka-topics.sh最终是运行了kafka.admin.TopicCommand这个类,在0.8的源码中这个类中没有找到有delete topic相关的代码。

在kafka的admin包下,提供了一个DeleteTopicCommand的类,可以实现删除topic的功能。

kafka.admin.DeleteTopicCommand

其中删除topic的具体实现代码如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

import org.I0Itec.zkclient.ZkClientimport kafka.utils.{Utils, ZKStringSerializer, ZkUtils}....... val topic = options.valueOf(topicOpt) val zkConnect = options.valueOf(zkConnectOpt) var zkClient: ZkClient = null try { zkClient = new ZkClient(zkConnect, 30000, 30000, ZKStringSerializer) zkClient.deleteRecursive(ZkUtils.getTopicPath(topic)) //其实最终还是通过删除zk里面对应的路径来实现删除topic的功能 println("deletion succeeded!") } catch { case e: Throwable => println("delection failed because of " + e.getMessage) println(Utils.stackTrace(e)) } finally { if (zkClient != null) zkClient.close() } |

因为这个命令只会删除zk里面的信息,真实的数据还是没有删除,所以需要登录各个broker,把对应的topic的分区数据目录删除,也可能正因为这一点,delete命令才没有集成到kafka.admin.TopicCommand这个类。

本文出自 “菜光光的博客” 博客,请务必保留此出处http://caiguangguang.blog.51cto.com/1652935/1548069

-------------------------------------------------------------------------------------------------------------------------------

kafka-topics.sh --delete 但是在运行时会报错找不到这个方法。

kafka-topics.sh最终是运行了kafka.admin.TopicCommand这个类,在0.8的源码中这个类中没有找到有delete topic相关的代码。

在kafka的admin包下,提供了一个DeleteTopicCommand的类,可以实现删除topic的功能。

kafka.admin.DeleteTopicCommand

其中删除topic的具体实现代码如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

import org.I0Itec.zkclient.ZkClientimport kafka.utils.{Utils, ZKStringSerializer, ZkUtils}....... val topic = options.valueOf(topicOpt) val zkConnect = options.valueOf(zkConnectOpt) var zkClient: ZkClient = null try { zkClient = new ZkClient(zkConnect, 30000, 30000, ZKStringSerializer) zkClient.deleteRecursive(ZkUtils.getTopicPath(topic)) //其实最终还是通过删除zk里面对应的路径来实现删除topic的功能 println("deletion succeeded!") } catch { case e: Throwable => println("delection failed because of " + e.getMessage) println(Utils.stackTrace(e)) } finally { if (zkClient != null) zkClient.close() } |

因为这个命令只会删除zk里面的信息,真实的数据还是没有删除,所以需要登录各个broker,把对应的topic的分区数据目录删除,也可能正因为这一点,delete命令才没有集成到kafka.admin.TopicCommand这个类。

在zookeeper上删除数据:用zookeeper客户端zkClient连接zookeeper,如:

./zkCli.sh -server 192.165.1.91:12181 此处最好只连接本机的zookeeper:端口,即在集群中每台机器上单独操作!!!

连接上后,可以用命令查看zk的目录结构

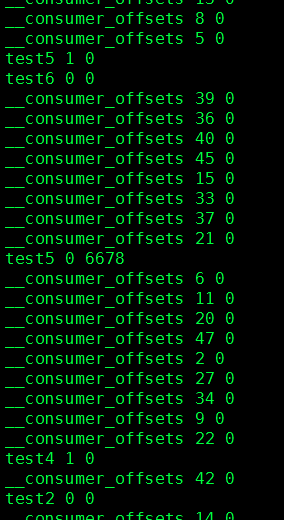

ls /brokers/topics

然后可以看到该目录下有test5目录 tab 补全 ls 发现下边有 (0,1) 字样 ,这是说test5 有俩个分区 然后以以下方式层层递减删除他...

删除方式:

delete /brokers/topics/test5/partitions/0/state

delete /brokers/topics/test5/partitions/1/state

delete /brokers/topics/test5/partitions/0

delete /brokers/topics/test5/partitions/1

delete /brokers/topics/test5/partitions

delete /brokers/topics/test5

===========停止kafka和zookeeper========================

a.查看server.properties中配置的log.dirs路径

b.进入到此路径中(如果kafka是一个集群,需要在每台机器上执行)

假定要删除的topic名称叫做:test5

vi replication-offset-checkpoint

原文为:

像我本地,是要全都删除的,直接改为:

0

同理修改

===========启动kafka和zookeeper========================此时,已修改好;

创建集群的时候要注意:kafka的日志清理

kafka将会保留所有发布的消息,不论他们是否被消费过

如果需要清理,则需要进行配置;

server.properties配置:

log.cleanup.policy=delete

日志清理策略

log.retention.hours=168 (即7天)

数据存储的最大时间超过这个时间会根据log.cleanup.policy设置的策略处理数据,也就是消费端能够多久去消费数据

log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除

log.retention.bytes=-1

topic每个分区的最大文件大小

一个topic的大小限制=分区数*log.retention.bytes

-1表示没有大小限制

log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除

log.retention.check.interval.ms=5minutes

文件大小检查的周期时间

3.kafka的分布式

一个日志的多个partition被分散在kafka集群的多个server上,并且每一个server处理来自于某个partition的数据请求。每个partition可以配置副本个数(即备份),以便容错。

(注:在创建topic时,可以指定--replication-factor参数)

每个partition都有一个server作为leader,并且有0或者多个server作为followers。leader处理对于这个partition的所有读写请求,而followers则被动的复制一切。如果leader挂掉了,一个followers则会自动的成为新的leader。每个server都会在某些partition上作为leader,而在另一些partition上作为follower,所以整个集群是非常平衡的。

(注:如果topic的repliation配置为1,则每个partition就只有唯一的一个leader,没有follower;所以要保证容错性,至少replication应该配置为2)这块我还没有闹懂,我现在的程序中是没有备份的,在另外一套系统中跑的程序入库,,然后另一套做实时展示计算;

4.kafka 的负载均衡问题 producer操作的时候,最好使用轮询的方式向topic写数据,保证topic每个partition的负载是均衡的,之前用的是默认的(随机算法),我现场用的是俩个分区,三台机器组成一个集群,结果一台机器的一个分区里边已经有10亿条数据了,集群中的另一台机器的分区中才只有8亿多一点,,,所以说最好用轮询,也有用hash的,但是为了负载均衡保证消费的高可用,(现场消费一般都是分组消费,consumer在消费的时候一般都是均衡的在broker上去取数据),,所以我个人极力鼓励用轮询来处理数据的分区的问题;省事,安全,不用去考虑负载不均衡带来的其他问题.

kafka删除topic的方法及我在kafka上边的一些经验的更多相关文章

- kafka 删除topic清空数据

原 kafka 删除topic清空数据 2018年11月20日 18:17:50 Ming! 阅读数:1391 版权声明:版权声明:本文为博主原创文章,未经博主允许不得转载. https://bl ...

- kafka删除topic及其相关数据

1.删除kafka存储目录(server.properties文件log.dirs配置,默认为"/tmp/kafka-logs")相关topic目录 2.Kafka 删除topic ...

- kafka 删除topic

两种方法: 一.修改配置文件server.properties 添加如下配置: delete.topic.enable=true 说明:官方给的文档说明“Enables delete topic. D ...

- kafka删除topic详解

1.删除topic命令 bin/kafka-topics.sh --delete --zookeeper 192.168.242.131:2181 --topic aaa 注:此命令如果要生效,还需在 ...

- kafka删除topic数据

一.概述 生产环境中,有一个topic的数据量非常大.这些数据不是非常重要,需要定期清理. 要求:默认保持24小时,某些topic 需要保留2小时或者6小时 二.清除方式 主要有3个: 1. 基于时间 ...

- kafka删除topic中的数据,适用于比较高的版本

server.properties中增加选项 delete.topic.enable=true 修改之后重启kafka 进入kafka目录,输入命令 bin/kafka-topics.sh --zoo ...

- Kafka:ZK+Kafka+Spark Streaming集群环境搭建(十一)定制一个arvo格式文件发送到kafka的topic,通过Structured Streaming读取kafka的数据

将arvo格式数据发送到kafka的topic 第一步:定制avro schema: { "type": "record", "name": ...

- kafka删除topic

手动: 删除kafka存储目录(server.properties文件log.dirs配置,默认为"/tmp/kafka-logs")相关topic目录 删除zookeeper & ...

- kafka删除topic后再创建同名的topic报错(ERROR org.apache.kafka.common.errors.TopicExistsException)

[hadoop@datanode3 logs]$ kafka-topics.sh --delete --zookeeper datanode1:2181 --topic firstTopic firs ...

随机推荐

- 成C++应用程序世界------异常处理

一. 概述 C++自身有着很强的纠错能力,发展到现在,已经建立了比較完好的异常处理机制.C++的异常情况无非两种,一种是语法错误,即程序中出现了错误的语句,函数,结构和类,致使编译程序无法进行.还有一 ...

- 【MS SQL】数据库维护计划之数据库备份(二)

原文:[MS SQL]数据库维护计划之数据库备份(二) 上篇[MS SQL]数据库维护计划之数据库备份(一) 说了数据库备份的一些概念后,这篇以HRP_KQYY数据库备份为例,进行备份计划设置. 考虑 ...

- SSIS Package to Call Web Service

原文 SSIS Package to Call Web Service SSIS Package to Call Web Service. You can Call WebService from S ...

- 华丽的NHibernate

华丽的NHibernate http://www.cnblogs.com/kissdodog/archive/2013/02/21/2919886.html 华丽的NHibernate NHibern ...

- .NET Framework和C#版本历史概览

发布日期 .Net版本 C#版本 CLR版本 开发工具 功能介绍 2002 1.0 1.0 初始版本 Visual Studio .Net 初始版本 .NET框架结构,详见: 2003 1.1 ...

- Varnish缓存服务

Varnish缓存服务详解及应用实现 1.varnish的基本介绍 Varnish 的作者Poul-Henning Kamp是FreeBSD的内核开发者之一,他认为现在的计算机比起1975年已 ...

- Domain Model(领域模型) 和 EntityFramework 如何正确进行对象关系映射?

Domain Model(领域模型) 和 EntityFramework 如何正确进行对象关系映射? 写在前面 阅读目录: 设计误区 数据库已死 枚举映射 关联映射 后记 在上一篇<一缕阳光:D ...

- Git 和 Github的关系

惭愧,这个问题到昨天才弄明白! Git 其实是一种版本控制的协议,和SVN/CVS类似,git协议定义了一个版本控制相关的各个操作,和SVN/CVS不同的是,git采用的是分布式的方法,并不需要服务器 ...

- MVC使用RDL报表

MVC使用RDL报表 这次我们来演示MVC3怎么显示RDL报表,坑爹的微软把MVC升级到5都木有良好的支持报表,让MVC在某些领域趋于短板 我们只能通过一些方式来使用rdl报表. Razor视图不支持 ...

- Google C++测试框架系列:入门

Google C++测试框架系列:入门 原始链接:V1_6_Primer 注 GTest或者Google Test: Google的C++测试框架. Test Fixtures: 这个词实在找不到对应 ...