Python爬虫和函数调试

一:函数调试

用之前学过的try···except进行调试

def gameover(setA,setB):

if setA==3 or setB==3:

return True

else:

return False

try:

a=gameover(7,11)

print(a)

except:

print("Error")

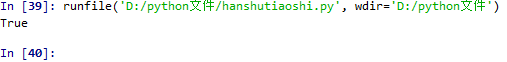

调试完毕~~~~

结果如下

输入7,8的结果

输入3,4的结果

不输入参数时,得到Error

二:Python爬虫

requests库是一个简洁且简单的处理HTTP请求的第三方库。

get()是对应与HTTP的GET方式,获取网页的最常用方法,可以增加timeout=n 参数,设定每次请求超时时间为n秒

text()是HTTP相应内容的字符串形式,即url对应的网页内容

content()是HTTP相应内容的二进制形式

用requests()打开搜狗主页20次

# -*- coding: utf-8 -*-

"""

Created on Mon May 20 10:20:45 2019 @author: guo'yu'yi

"""

import requests

try:

for i in range(20):

r=get("https://123.sogou.com/")

r.raise_for_status()

r.encoding='utf-8'

print(r)

print(len(r.text))

print(len(r.content))

except:

print("Error")

结果如下:

获取中国大学排名

直接上代码

import requests

from bs4 import BeautifulSoup

import pandas

# 1. 获取网页内容

def getHTMLText(url):

try:

r = requests.get(url, timeout = 30)

r.raise_for_status()

r.encoding = 'utf-8'

return r.text

except Exception as e:

print("Error:", e)

return "" # 2. 分析网页内容并提取有用数据

def fillTabelList(soup): # 获取表格的数据

tabel_list = [] # 存储整个表格数据

Tr = soup.find_all('tr')

for tr in Tr:

Td = tr.find_all('td')

if len(Td) == 0:

continue

tr_list = [] # 存储一行的数据

for td in Td:

tr_list.append(td.string)

tabel_list.append(tr_list)

return tabel_list # 3. 可视化展示数据

def PrintTableList(tabel_list, num):

# 输出前num行数据

print("{1:^2}{2:{0}^10}{3:{0}^5}{4:{0}^5}{5:{0}^8}".format(chr(12288), "排名", "学校名称", "省市", "总分", "生涯质量"))

for i in range(num):

text = tabel_list[i]

print("{1:{0}^2}{2:{0}^10}{3:{0}^5}{4:{0}^8}{5:{0}^10}".format(chr(12288), *text)) # 4. 将数据存储为csv文件

def saveAsCsv(filename, tabel_list):

FormData = pandas.DataFrame(tabel_list)

FormData.columns = ["排名", "学校名称", "省市", "总分", "生涯质量", "培养结果", "科研规模", "科研质量", "顶尖成果", "顶尖人才", "科技服务", "产学研合作", "成果转化"]

FormData.to_csv(filename, encoding='utf-8', index=False) if __name__ == "__main__":

url = "http://www.zuihaodaxue.cn/zuihaodaxuepaiming2016.html"

html = getHTMLText(url)

soup = BeautifulSoup(html, features="html.parser")

data = fillTabelList(soup)

#print(data)

PrintTableList(data, 10) # 输出前10行数据

saveAsCsv("D:\\python文件\\daxuepaimingRank.csv", data)

Python爬虫和函数调试的更多相关文章

- python爬虫基础18-Chrome调试前端工具

01 Chrome调试 抓包工具原理 Chrome 开发者工具是一套内置在Google Chrome中Web开发和调试工具.使用开发者工具来重演,调试和剖析您的网站. 其中常用的有Elements(元 ...

- python 爬虫可视化函数,可以先看看要爬取的数据是否存在

import requests url = "http://www.spbeen.com" headers = { "User-Agent":"tes ...

- Python爬虫:新浪新闻详情页的数据抓取(函数版)

上一篇文章<Python爬虫:抓取新浪新闻数据>详细解说了如何抓取新浪新闻详情页的相关数据,但代码的构建不利于后续扩展,每次抓取新的详情页时都需要重新写一遍,因此,我们需要将其整理成函数, ...

- Python帮助函数调试函数 用于获取对象的属性及属性值

Python帮助函数调试函数 用于获取对象的属性及属性值 刚接触Python,上篇 <Python入门>第一个Python Web程序--简单的Web服务器 中调试非常不方便,不知道对象详 ...

- python爬虫利器Selenium使用详解

简介: 用pyhon爬取动态页面时普通的urllib2无法实现,例如下面的京东首页,随着滚动条的下拉会加载新的内容,而urllib2就无法抓取这些内容,此时就需要今天的主角selenium. Sele ...

- Python爬虫:用BeautifulSoup进行NBA数据爬取

爬虫主要就是要过滤掉网页中没用的信息.抓取网页中实用的信息 一般的爬虫架构为: 在python爬虫之前先要对网页的结构知识有一定的了解.如网页的标签,网页的语言等知识,推荐去W3School: W3s ...

- [转]Python爬虫框架--pyspider初体验

标签: python爬虫pyspider 2015-09-05 10:57 9752人阅读 评论(0) 收藏 举报 分类: Python(8) 版权声明:本文为博主原创文章,未经博主允许不得转载. ...

- python爬虫 - Urllib库及cookie的使用

http://blog.csdn.net/pipisorry/article/details/47905781 lz提示一点,python3中urllib包括了py2中的urllib+urllib2. ...

- python爬虫积累(一)--------selenium+python+PhantomJS的使用(转)

阅读目录 一.Selenium介绍 二.爬虫为什么要用selenium? 三.PhantomJS介绍 四.PhantomJS安装 五.操作实战 六.在此推荐虫师博客的学习资料 selenium + p ...

随机推荐

- Jmeter 常用函数(23)- 详解 __longSum

如果你想查看更多 Jmeter 常用函数可以在这篇文章找找哦 https://www.cnblogs.com/poloyy/p/13291704.htm 作用 计算两个或多个长值的和 注意 当值不在 ...

- WordCloud教程(上)

先贴代码: import wordcloud,jieba with open('datas/1.txt') as rt:#,encoding='utf-8' comment_text=rt.read( ...

- OVS 流表offload

原文链接:https://www.dazhuanlan.com/2019/12/31/5e0af1858dada/ 最近开始调研网卡的OVS流表offload功能,所以目前查看一下OVS这块是怎么做的 ...

- 第四篇 Scrum冲刺博客

一.会议图片 二.项目进展 成员 完成情况 今日任务 冯荣新 商品底部工具栏 购物车列表 陈泽佳 渲染搜索结果,防抖的实现 静态结构 徐伟浩 未完成 商品信息录入 谢佳余 未完成 搜索算法设计 邓帆涛 ...

- docker-compose 官网下载特别慢怎么办?

docker compose 官放推荐的下载方式是这样的: sudo curl -L "https://github.com/docker/compose/releases/download ...

- Laravel Reponse 响应客户端

Laravel Response 响应客户端 本篇文章逻辑较长,只说明和响应生命周期相关的必要代码. 本文主要内容顺序为: 1.执行上文管道中的then方法指定的闭包,路由的分发 2.在路由器中(Ro ...

- 2020重新出发,NOSQL,什么是Redis?

@ 目录 Redis是什么? NoSQL和传统数据库的区别 Redis的优点 Redis在Java Web中的应用 缓存 高速读/写场合 Redis是什么? Redis 是一个由 Salvatore ...

- java返回树形结构的正确姿势

业务场景 通常我们前端需要一个树形的导航菜单或者分类菜单,如后台权限管理中的权限树,亦或者下面例子中商城系统的商品分类多级菜单(一般为三级菜单) 数据库设计 数据库设计,采用parentId来指向自己 ...

- Google Code Jam 2020 Round1B Join the Ranks

题意 给你一个形如\(1,2,\cdots,R,1,2,\cdots,R,1\cdots\)的序列,共重复\(C\)次.你每次可以选择一个区间\([L,R]\)将其平移到序列首部,最终使得序列具有\( ...

- [AngstromCTF 2019]Cookie Cutter

最近看到了一个国外高中生的CTF比赛,翻了一下往年的例题,发现有一道关于jwt session伪造的题比较有意思,记录一下 题目简介中给出了我们题目的地址和后端处理的源码,看看源码先代码审计一下: c ...