『PyTorch』第三弹_自动求导

torch.autograd 包提供Tensor所有操作的自动求导方法。

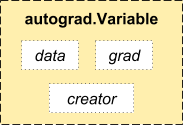

数据结构介绍

autograd.Variable 这是这个包中最核心的类。 它包装了一个Tensor,并且几乎支持所有的定义在其上的操作。一旦完成了你的运算,你可以调用 .backward()来自动计算出所有的梯度,Variable有三个属性:

访问原始的tensor使用属性.data;

关于这一Variable的梯度则集中于 .grad;

.creator反映了创建者,标识了是否由用户使用.Variable直接创建(None)。

import torch

from torch.autograd import Variable '''求导数''' x = Variable(torch.ones(2,2),requires_grad=True)

y = x + 2

print(x.creator) # None,用户直接创建没有creater属性

print(y.creator) # <torch.autograd._functions.basic_ops.AddConstant object at 0x7fb9b4d4b208>

返回:

None

<torch.autograd._functions.basic_ops.AddConstant object at 0x7fb9b4d4b208>

求导运算

如果你想要进行求导计算,你可以在Variable上调用.backward()。

如果Variable是一个标量(例如它包含一个单元素数据),你无需对backward()指定任何参数

z = y*y*3

out = z.mean() out.backward() print(x,y,z)

print(x.grad) # 输出对out对x求倒结果

print(y.grad) # y不是自动求导变量Variable containing:

1 1

1 1

[torch.FloatTensor of size 2x2]

Variable containing:

3 3

3 3

[torch.FloatTensor of size 2x2]

Variable containing:

27 27

27 27

[torch.FloatTensor of size 2x2] Variable containing:

4.5000 4.5000

4.5000 4.5000

[torch.FloatTensor of size 2x2] None最终得出的结果应该是一个全是4.5的矩阵。设置输出的变量为o。我们通过这一公式来计算:

,

,

,因此,

,最后有

如果它有更多的元素(矢量),你需要指定一个和tensor的形状匹配的grad_output参数(y在指定方向投影对x的导数)

x = torch.randn(3)

x = Variable(x, requires_grad = True)

y = x * 2

while y.data.norm() < 1000:

y = y * 2

gradients = torch.FloatTensor([0.1, 1.0, 0.0001])

y.backward(gradients)

x.gradVariable containing:

-0.8143

-1.5852

-0.8598

[torch.FloatTensor of size 3] Variable containing:

-1.6286

-3.1704

-1.7195

[torch.FloatTensor of size 3] 3.9573325720437613

Variable containing:

51.2000

512.0000

0.0512

[torch.FloatTensor of size 3]测试传入向量的意义:

x = torch.randn(3)

x = Variable(x,requires_grad=True)

y = x*2 gradients = torch.FloatTensor([0.5,0.5,1])

y.backward(gradients) # 沿着某方向的梯度

print(x.grad) # Variable containing:

#

#

#

# [torch.FloatTensor of size 3]

x = torch.randn(3)

x = Variable(x,requires_grad=True)

y = x*2 gradients = torch.FloatTensor([1,1,1])

y.backward(gradients) # 沿着某方向的梯度

print(x.grad) # Variable containing:

#

#

#

# [torch.FloatTensor of size 3]

『PyTorch』第三弹_自动求导的更多相关文章

- 『PyTorch』第三弹重置_Variable对象

『PyTorch』第三弹_自动求导 torch.autograd.Variable是Autograd的核心类,它封装了Tensor,并整合了反向传播的相关实现 Varibale包含三个属性: data ...

- 『PyTorch』第四弹_通过LeNet初识pytorch神经网络_下

『PyTorch』第四弹_通过LeNet初识pytorch神经网络_上 # Author : Hellcat # Time : 2018/2/11 import torch as t import t ...

- 『PyTorch』第四弹_通过LeNet初识pytorch神经网络_上

总结一下相关概念: torch.Tensor - 一个近似多维数组的数据结构 autograd.Variable - 改变Tensor并且记录下来操作的历史记录.和Tensor拥有相同的API,以及b ...

- 『PyTorch』第十弹_循环神经网络

RNN基础: 『cs231n』作业3问题1选讲_通过代码理解RNN&图像标注训练 TensorFlow RNN: 『TensotFlow』基础RNN网络分类问题 『TensotFlow』基础R ...

- 『PyTorch』第五弹_深入理解autograd_下:函数扩展&高阶导数

一.封装新的PyTorch函数 继承Function类 forward:输入Variable->中间计算Tensor->输出Variable backward:均使用Variable 线性 ...

- 『PyTorch』第五弹_深入理解autograd_上:Variable属性方法

在PyTorch中计算图的特点可总结如下: autograd根据用户对variable的操作构建其计算图.对变量的操作抽象为Function. 对于那些不是任何函数(Function)的输出,由用户创 ...

- 『PyTorch』第五弹_深入理解Tensor对象_下:从内存看Tensor

Tensor存储结构如下, 如图所示,实际上很可能多个信息区对应于同一个存储区,也就是上一节我们说到的,初始化或者普通索引时经常会有这种情况. 一.几种共享内存的情况 view a = t.arang ...

- 『PyTorch』第五弹_深入理解autograd_中:Variable梯度探究

查看非叶节点梯度的两种方法 在反向传播过程中非叶子节点的导数计算完之后即被清空.若想查看这些变量的梯度,有两种方法: 使用autograd.grad函数 使用hook autograd.grad和ho ...

- 『PyTorch』第五弹_深入理解Tensor对象_中下:数学计算以及numpy比较_&_广播原理简介

一.简单数学操作 1.逐元素操作 t.clamp(a,min=2,max=4)近似于tf.clip_by_value(A, min, max),修剪值域. a = t.arange(0,6).view ...

随机推荐

- hihoCoder week10 后序遍历

题目链接 https://hihocoder.com/contest/hiho10/problem/1 给出先序 中序 求 后序 #include <bits/stdc++.h> usi ...

- AT2442 フェーン現象 (Foehn Phenomena)

题目地址 原题地址 题解 其实就是一个区间加,单点查询的问题 当然可以线段树/树状数组做,但是这两个做法要分类讨论所以代码会比较多 我们考虑一种更简便的做法 差分! 因为温度只和海拔差有关,这相当于题 ...

- (转载)MySQL基础(非常全)

MySQL基础 一.MySQL概述 1.什么是数据库 ? 答:数据的仓库,如:在ATM的示例中我们创建了一个 db 目录,称其为数据库 2.什么是 MySQL.Oracle.SQLite.Access ...

- [0413] FFTSHIFT的四种写法

FFTSHIFT的四种写法 前言 matlab说,"你读过书,--我便考你一考.fftshift的函数,怎样写的?"我想,讨饭一样的人,也配考我么?便回过脸去,不再理会.matla ...

- layer 弹出层 回调函数调用 弹出层页面 函数

1.项目中用到layer 弹出层,定义一个公用的窗口,问题来了窗口弹出来了,如何保存页面上的数据呢?疯狂百度之后,有了结果,赶紧记下. 2.自己定义的公共页面方法: layuiWindow: func ...

- Unicode转字符串

/// <summary> /// Unicode转字符串 /// </summary> /// <returns>The to string.</retur ...

- 设计模式(七)Adapter Pattern适配器模式

适用场景:旧系统的改造升级 实际场景:java.io.InputStreamReader(InputStream)等 1.一个被适配的类 package com.littlepage.AdapterP ...

- 前端阶段_div以及css介绍

1.div div是html的一个标签,是块级元素,单独使用没有意义,必须结合css来使用,进行网页布局 2.span span是一个html标签,是一个内联元素,主要对括起来的内容进行修饰 3.&l ...

- python中shutil模块

shutil是对OS中文件操作的补充:移动.复制.打包.压缩.解压. 1.copy文件内容到另一个文件,可以copy指定大小的内容. shutil.copyfileobj(fsrc, fdst[, l ...

- django使用MySQL数据库

在实际生产环境,Django是不可能使用SQLite这种轻量级的基于文件的数据库作为生产数据库.一般较多的会选择MySQL. 下面介绍一下如何在Django中使用MySQL数据库. 一.安装MySQL ...