Windows上结合使用Flume和Kafka

Win7+Flume1.8.0 + Kafka1.0.0

1.目标

①使用Flume作为Kafka的Producer;

②使用Kafka作为Flume的Sink;

其实以上两点是同一个事情在Flume和Kafka两个立场上的不同描述而已,其实就是同一个事情。

2.运行Kafka

①运行Zookeeper

zkserver

②运行Kafka

这里注意一下是否正常运行了,如果日志报错则将日志文件夹删除后再让其自动重新生成。

.\bin\windows\kafka-server-start.bat .\config\server.properties

③创建一个名字为flume的Topic

kafka-topics.bat --create --zookeeper localhost: --replication-factor --partitions --topic flume

④打开这个Topic的一个Consumer

kafka-console-consumer.bat --zookeeper localhost: --topic flume

具体可参看《Windows上搭建Kafka运行环境》

3.运行Flume

①创建一个kafka_sink.conf配置文件

# example.conf: A single-node Flume configuration # Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1 # Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = # Describe the sink

a1.sinks.k1.channel = c1

a1.sinks.k1.type = org.apache.flume.sink.kafka.KafkaSink

a1.sinks.k1.kafka.topic = flume

a1.sinks.k1.kafka.bootstrap.servers = localhost:

a1.sinks.k1.kafka.flumeBatchSize =

a1.sinks.k1.kafka.producer.acks =

a1.sinks.k1.kafka.producer.linger.ms =

a1.sinks.k1.kafka.producer.compression.type = snappy # Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity =

a1.channels.c1.transactionCapacity = # Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

②启动Flume

flume-ng agent --conf ../conf --conf-file ../conf/kafka_sink.conf --name a1 -property flume.root.logger=INFO,console

具体可参看《Windows上搭建Flume运行环境》

4.使用telnet连接并发送数据

①启动另外一个cmd,使用telnet连接到44444端口并发送信息Test Flume and Kafka!

(这里注意一下,在测试过程中,首条数据显示较慢!)

telnet localhost

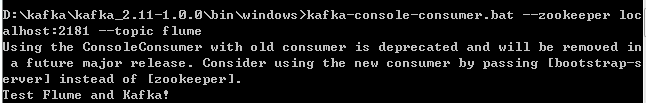

②在Kafka的Consumer终端显示如下:

以上。

Windows上结合使用Flume和Kafka的更多相关文章

- Windows上搭建Flume运行环境

1.如果没有安装过Java环境,则需首先安装JDK. 可参考<Windows上搭建Kafka运行环境>中的搭建环境安装JDK部分 2.官方下载Flume(当前为apache-flume-1 ...

- Windows上安装Kafka需要注意的几点

1.不能安装在有空格的路径上 比如:D:\Program Files 2.设置日志路径时,要用"/",不能用Windows上的"\",比如: # A comma ...

- 20190312 Windows上Kafka集群

1. 复制config/server.properties为server1.properties和server2.properties 2. 以server1.properties为例,修改配置 br ...

- (转)Windows上搭建Kafka运行环境

转自:<Windows上搭建Kafka运行环境> 完整解决方案请参考: Setting Up and Running Apache Kafka on Windows OS 在环境搭建过 ...

- [转]Windows上搭建Kafka运行环境

[转]http://www.cnblogs.com/alvingofast/p/kafka_deployment_on_windows.html Windows上搭建Kafka运行环境 完整解决方 ...

- 在Windows上搭建kafka环境

英文文档:https://dzone.com/articles/running-apache-kafka-on-windows-os 第一步:安装JDK 百度很多,不赘述 第二步:安装ZooKeepe ...

- Kafka实战-Flume到Kafka

1.概述 前面给大家介绍了整个Kafka项目的开发流程,今天给大家分享Kafka如何获取数据源,即Kafka生产数据.下面是今天要分享的目录: 数据来源 Flume到Kafka 数据源加载 预览 下面 ...

- 【转】Kafka实战-Flume到Kafka

Kafka实战-Flume到Kafka Kafka 2015-07-03 08:46:24 发布 您的评价: 0.0 收藏 2收藏 1.概述 前面给大家介绍了整个Kafka ...

- Flume与Kafka集成

一.Flume介绍 Flume是一个分布式.可靠.和高可用的海量日志聚合的系统,支持在系统中定制各类数据发送方,用于收集数据:同时,Flume提供对数据进行简单处理,并写到各种数据接受方(可定制)的能 ...

随机推荐

- python之块包导入

一.模块 1.什么是模块 常见的场景:一个模块就是一个包含了python定义和声明的文件,文件名就是模块名字加上.py的后缀. 但其实import加载的模块分为四个通用类别: 1 使用python编写 ...

- vim 快捷键(update)

网上盗的图,233 2018年08月31日14:31:19 update: 批量行操作 esc->ctrl+v->选中批量行->shift+i->operation-> ...

- Python3+Dlib实现简单人脸识别案例

Python3+Dlib实现简单人脸识别案例 写在前边 很早很早之前,当我还是一个傻了吧唧的专科生的时候,我就听说过人脸识别,听说过算法,听说过人工智能,并且也出生牛犊不怕虎般的学习过TensorFl ...

- android拨号

android:textColor="#A0ff1400" A0表示透明度00完全透明FF完全不透明,后面6位是RGB问题:类中类的findViewById方法为何用不了?解:类中 ...

- bzoj 2753 [SCOI 2012] 滑雪与时间胶囊 - Prim

题目传送门 传送点I 传送点II 题目大意 给定一个有$n$个点$m$条边的图,每个点有一个高度$h_{i}$,能从$u$经过一条边到达$v$,当且仅当存在一条边是$(u, v)$或$(v, u)$, ...

- NOI 2007 货币兑换Cash (bzoj 1492) - 斜率优化 - 动态规划 - CDQ分治

Description 小Y最近在一家金券交易所工作.该金券交易所只发行交易两种金券:A纪念券(以下简称A券)和 B纪念券(以下 简称B券).每个持有金券的顾客都有一个自己的帐户.金券的数目可以是一个 ...

- C++的STL之map自动排序特性

#include <iostream> #include <map> using namespace std; int main() {方法一: map<int,int& ...

- centos设置中文输入法无效的解决办法

安装 im-chooser: yum install im-chooser 回到当前使用的普通用户,设置 ibus 输入法为默认输入系统: imsettings-switch ibus

- 【Spring Security】七、RememberMe配置

一.概述 RememberMe 是指用户在网站上能够在 Session 之间记住登录用户的身份的凭证,通俗的来说就是用户登陆成功认证一次之后在制定的一定时间内可以不用再输入用户名和密码进行自动登录.这 ...

- 关于视觉跟踪中评价标准的相关记录(The Evaluation of Visual Tracking Results on OTB-100 Dataset)

关于视觉跟踪中评价标准的相关记录(The Evaluation of Visual Tracking Results on OTB-100 Dataset) 2018-01-22 21:49:17 ...