ceph集群

ceph集群部署

ceph理解:

Ceph是一个分布式存储,可以提供对象存储、块存储和文件存储,其中对象存储和块存储可以很好地和各大云平台集成。其他具体介绍可见官网简介:http://docs.ceph.com/docs/master/start/intro/

三个节点地址及主机名对应:

192.168.10.100 node01

192.168.10.101 node02

192.168.10.102 node03

软件环境

操作系统:Centos 7.3

Openstack:N

Ceph:Jewel

[root@centos ~]# hostnamectl set-hostname node01

[root@centos ~]# hostnamectl set-hostname node02

[root@centos ~]# hostnamectl set-hostname node03

关闭firewalld、修改selinux

[root@node01 ~]# systemctl stop firewalld

[root@node01 ~]# systemctl disable firewalld

[root@node01 ~]# setenforce 0

[root@node01 ~]# sed -i 's/SELINUX=enforcing/SELINUX=disabled/g' /etc/sysconfig/selinux

yum install wget vim -y

[root@node01 ~]# cat /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.10.100 node01

192.168.10.101 node02

192.168.10.102 node03

ssh实现三个节点免密登陆

[root@node01 ~]# ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

[root@node01 ~]# ssh-copy-id root@node01

[root@node01 ~]# ssh-copy-id root@node02

[root@node01 ~]# ssh-copy-id root@node03

三个节点:

wget -O /etc/yum.repos.d/CentOS-Base.repo http://mirrors.aliyun.com/repo/Centos-7.repo

wget -O /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

[root@node01 yum.repos.d]# sed -i '/aliyuncs/d' /etc/yum.repos.d/CentOS-Base.repo

[root@node01 yum.repos.d]# sed -i '/aliyuncs/d' /etc/yum.repos.d/epel.repo

[root@node01 yum.repos.d]# sed -i 's/$releasever/7/g' /etc/yum.repos.d/CentOS-Base.repo

[root@node01 yum.repos.d]# cat ceph.repo

[ceph]

name=ceph

baseurl=http://mirrors.163.com/ceph/rpm-luminous/el7/x86_64/

gpgcheck=0

[ceph-noarch]

name=cephnoarch

baseurl=http://mirrors.163.com/ceph/rpm-luminous/el7/noarch/

gpgcheck=0

root@node01 yum.repos.d]#yum clean all

root@node01 yum.repos.d]#yum repolist

[root@node01 yum.repos.d]# scp /etc/yum.repos.d/* node02:/etc/yum.repos.d/

[root@node01 yum.repos.d]# scp /etc/yum.repos.d/* node03:/etc/yum.repos.d/

[root@node01 yum.repos.d]# scp /etc/hosts node02:/etc/

[root@node01 yum.repos.d]# scp /etc/hosts node03:/etc/

安装ntp,在所有ceph节点上执行

[root@node01 yum.repos.d]# yum install ntp ntpdate -y

[root@node01 yum.repos.d]# systemctl start ntpd

[root@node01 yum.repos.d]# systemctl enable ntpd

[root@node01 yum.repos.d]#ntpdate cn.ntp.org.cn

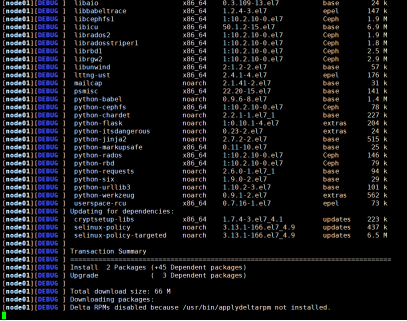

[root@node01 ]# yum install ceph-deploy ceph -y 三个节点

创建集群,生成一个新的ceph集群,集群包括ceph配置文件以及monitor的密钥环。

[root@node01 ~]# mkdir my-cluster

[root@node01 ~]# cd my-cluster/

[root@node01 my-cluster]# ceph-deploy new node01 node02 node03

安装ceph软件包(如果安装过程出现问题,可以重新执行得以解决)

yum -y install ceph ceph-radosgw ceph-release

[root@node01 my-cluster]# ceph-deploy install node01 node02 node03

在ceph-node1上创建第一个ceph monitor

ceph-deploy mon create-initial

[root@node01 my-cluster]# ceph-deploy mon create-initial

执行完命令后,当前目录会生成如下几个keyring:

[root@node01 yum.repos.d]#• {cluster-name}.client.admin.keyring

[root@node01 yum.repos.d]#• {cluster-name}.bootstrap-osd.keyring

[root@node01 yum.repos.d]#• {cluster-name}.bootstrap-mds.keyring

[root@node01 yum.repos.d]#• {cluster-name}.bootstrap-rgw.keyring

创建集群

[root@node01 yum.repos.d]#ceph-deploy new node01 node02 node03

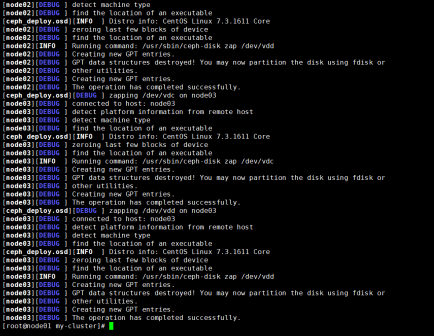

在node01上创建osd

ceph-deploy disk list ceph-node01(列出disk)

[root@node01 my-cluster]# ceph-deploy osd create node01:/dev/sdb node01:/dev/sdc node02:/dev/sdb node02:/dev/sdc node03:/dev/sdb node03:/dev/sdc

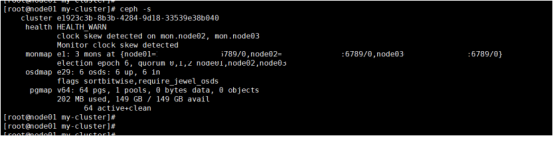

查看集群状态

[root@node01 my-cluster]# ceph -s

cluster e1923c3b-8b3b-4284-9d18-33539e38b040

health HEALTH_WARN

clock skew detected on mon.node02, mon.node03

Monitor clock skew detected

monmap e1: 3 mons at

{node01=192.168.10.100:6789/0,node02=192.168.10.101:6789/0,node03=192.168.10.102:6789/0}

election epoch 6, quorum 0,1,2 node01,node02,node03

osdmap e29: 6 osds: 6 up, 6 in

flags sortbitwise,require_jewel_osds

pgmap v64: 64 pgs, 1 pools, 0 bytes data, 0 objects

202 MB used, 149 GB / 149 GB avail

64 active+clean

ceph集群的更多相关文章

- Ubuntu 14.04 部署 CEPH集群

注:下文的所有操作都在admin节点进行 1.准备三台虚拟机,其中一台作为admin节点,另外两台作为osd节点,并相应地用hostname命令将主机名修改为admin,osd0,osd1,最后修改/ ...

- ceph集群安装

所有 Ceph 部署都始于 Ceph 存储集群.一个 Ceph 集群可以包含数千个存储节点,最简系统至少需要一个监视器和两个 OSD 才能做到数据复制.Ceph 文件系统. Ceph 对象存储.和 C ...

- 使用虚拟机CentOS7部署CEPH集群

第1章 CEPH部署 1.1 简单介绍 Ceph的部署模式下主要包含以下几个类型的节点 Ø CephOSDs: A Ceph OSD 进程主要用来存储数据,处理数据的replication,恢复 ...

- docker创建ceph集群

背景 Ceph官方现在提供两类镜像来创建集群,一种是常规的,每一种Ceph组件是单独的一个镜像,如ceph/daemon.ceph/radosgw.ceph/mon.ceph/osd等:另外一种是最新 ...

- ceph集群搭建

CEPH 1.组成部分 1.1 monitor admin节点安装ceph-deploy工具 admin节点安装ceph-deploy 添加源信息 rm -f /etc/yum.repos.d/* w ...

- Ceph集群搭建及Kubernetes上实现动态存储(StorageClass)

集群准备 ceph集群配置说明 节点名称 IP地址 配置 作用 ceph-moni-0 10.10.3.150 centos7.5 4C,16G,200Disk 管理节点,监视器 monitor ...

- CEPH集群操作入门--配置

参考文档:CEPH官网集群操作文档 概述 Ceph存储集群是所有Ceph部署的基础. 基于RADOS,Ceph存储集群由两种类型的守护进程组成:Ceph OSD守护进程(OSD)将数据作为对象 ...

- Ceph集群更换public_network网络

1.确保ceph集群是连通状态 这里,可以先把机器配置为以前的x.x.x.x的网络,确保ceph集群是可以通的.这里可以执行下面的命令查看是否连通,显示HEALTH_OK则表示连通 2.获取monma ...

- Ceph 集群整体迁移方案(转)

场景介绍:在我们的IDC中,存在着运行了3-6年的Ceph集群的服务器,这些服务器性能和容量等都已经无法满足当前业务的需求,在购入一批高性能机器后,希望将旧机器上的集群整体迁移到新机器上,当然,是保证 ...

- ceph集群性能测试结果

对ceph存储集群(8台万兆服务器)从以下几个方面进行测试的结果 1.读写稳定性 无故障下的ceph集群性能完全满足业务对磁盘性能的需求. 测试数据结果如下表1-1,1-2 2.业务稳定性 ceph集 ...

随机推荐

- 小程序 video 层级,原生组件

原生组件的层级是最高的,所以页面中的其他组件无论设置 z-index 为多少,都无法盖在原生组件上. 后插入的原生组件可以覆盖之前的原生组件. 原生组件还无法在 scroll-view.swiper. ...

- _bzoj1208 [HNOI2004]宠物收养所【Splay】

传送门:http://www.lydsy.com/JudgeOnline/problem.php?id=1208 以后在空间限制允许的情况下我绝对不纠结内存占用问题啦!就因为不舍得用long long ...

- [ZPG TEST 118] 最大值【dp+离线】

题4 最大值(findmax) [题目描述] 找到一个数组的最大值的一种方法是从数组开头从前到后对数组进行扫描,令max=a[0](数组下表从0..N-1),如果a[i]>max,就更新max ...

- MyEclipse中Tomcat对应JVM的参数配置

MyEclipse中Tomcat对应JVM的参数配置: -Xmx512M -Xms256M -XX:MaxPermSize=256m

- 08 H5新增input元素

<!doctype html> <html> <head> <meta charset="utf-8"> <title> ...

- sed简单脚本练习

sed脚本的执行顺序可以简记为:Read,Execute,Print,Repeat(读取,执行,打印,重复)简称REPR 分析脚本的执行顺序: l 读取一行到模式空间(sed内部的一个临时缓存,用于存 ...

- Java多线程——进程和线程

Java多线程——进程和线程 摘要:本文主要解释在Java这门编程语言中,什么是进程,什么是线程,以及二者之间的关系. 部分内容来自以下博客: https://www.cnblogs.com/dolp ...

- orcale 数据库的一些知识

最近学了一些Oracle数据库的知识,我想自己整理一下,以后也方便自己查阅的. orcale 数据库登录(tiger) 1. sql plus 登录 用户名: sys 口令: 主机字符串:orcl a ...

- 重构31-Replace conditional with Polymorphism(多态代替条件)

多态(Polymorphism)是面向对象编程的基本概念之一.在这里,是指在进行类型检查和执行某些类型操作时,最好将算法封装在类中,并且使用多态来对代码中的调用进行抽象. public class O ...

- 仿陌陌的ios客户端+服务端源码

软件功能:模仿陌陌客户端,功能很相似,注册.登陆.上传照片.浏览照片.浏览查找附近会员.关注.取消关注.聊天.语音和文字聊天,还有拼车和搭车的功能,支持微博分享和查找好友. 后台是php+mysql, ...