课程一(Neural Networks and Deep Learning),第二周(Basics of Neural Network programming)—— 1、10个测验题(Neural Network Basics)

--------------------------------------------------中文翻译-----------------------------------------------------------------------------------------

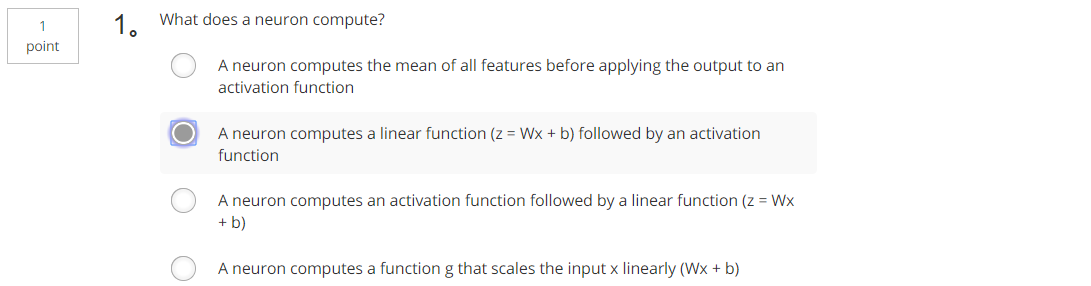

1、神经元的计算是什么?(B)

B. 神经元计算一个线性函数 (z = Wx + b), 然后是一个激活函数

C. 神经元计算一个激活函数, 后跟一个线性函数 (z = Wx + b)

D. 一个神经元计算一个函数 g, 它将输入 x 线性地缩放 (Wx + b)

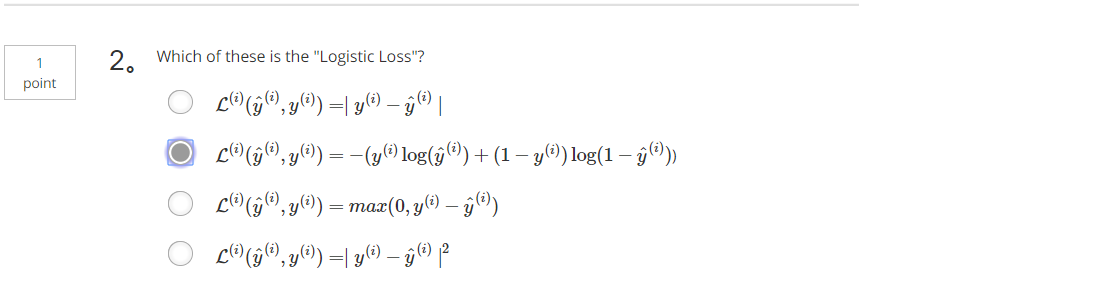

2、下面哪个是损失函数?(B)

见对应的英文题2

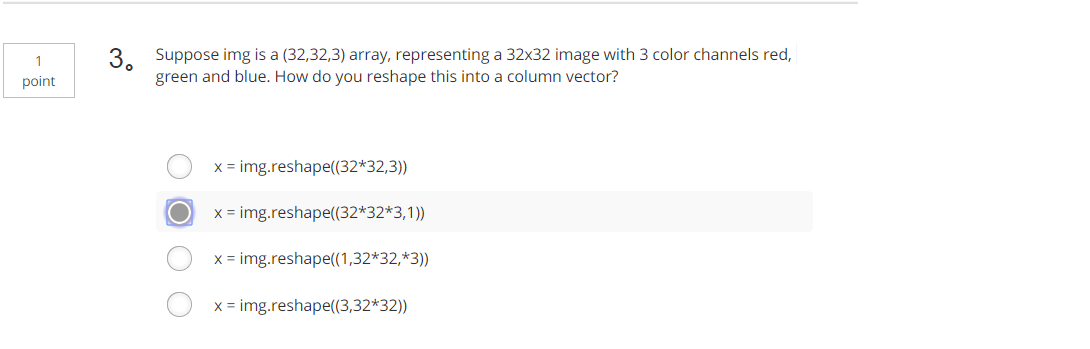

3、假设 img 是一个 (32,32,3) 数组, 代表一个32x32 的图像与3色通道红色, 绿色和蓝色。如何将其重塑为列向量?(B)

A. x = img 重塑 (32 * 32,3))

B. x = img 重塑 (32 * 32 * 3,1))

a = np.random.randn(2, 3) # a.shape = (2, 3)

b = np.random.randn(2, 1) # b.shape = (2, 1)

c = a + b

A. c.shape = (2, 1)

B. c.shape = (2, 3)

C. c.shape = (3, 2)

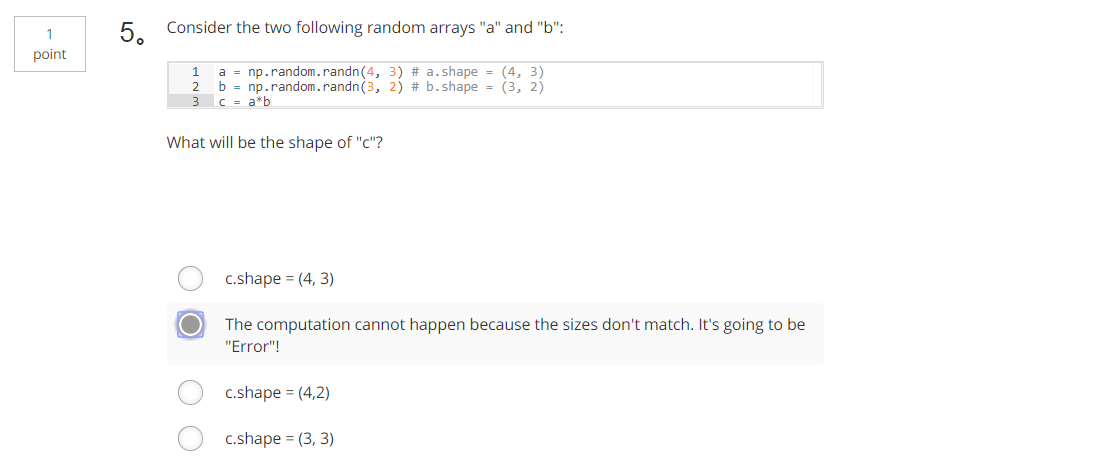

5、考虑以下两个随机数组 "a" 和 "b", "c" 的形状是什么?(A)

a = np.random.randn(4, 3) # a.shape = (4, 3)

b = np.random.randn(3, 2) # b.shape = (3, 2)

c = a*b

A. 由于大小不匹配, 无法进行计算。这将是 "错误"!

A. c.shape = (3, 3)

B. c.shape = (4, 2)

C. c.shape = (4, 3)

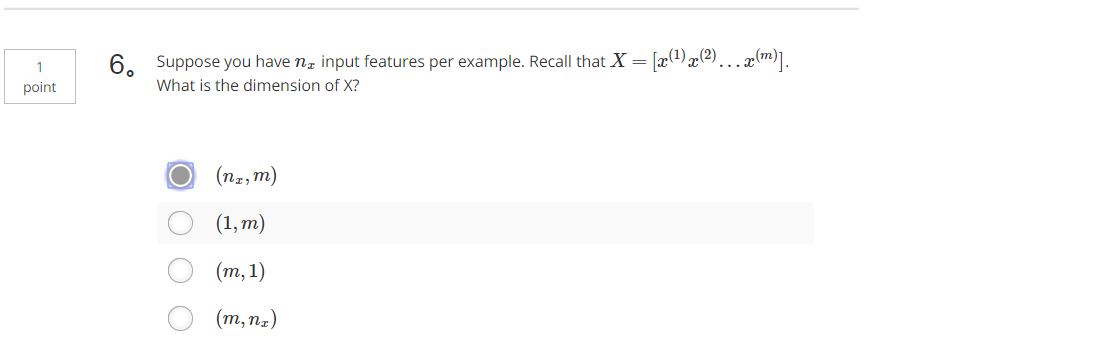

6、假设每一个样本的特征为nx维,X=[x(1)x(2)...x(m)],X的维度是多少?(A)

A. (nx,m)

B. (1,m)

C. (m,1)

D. (m,nx)

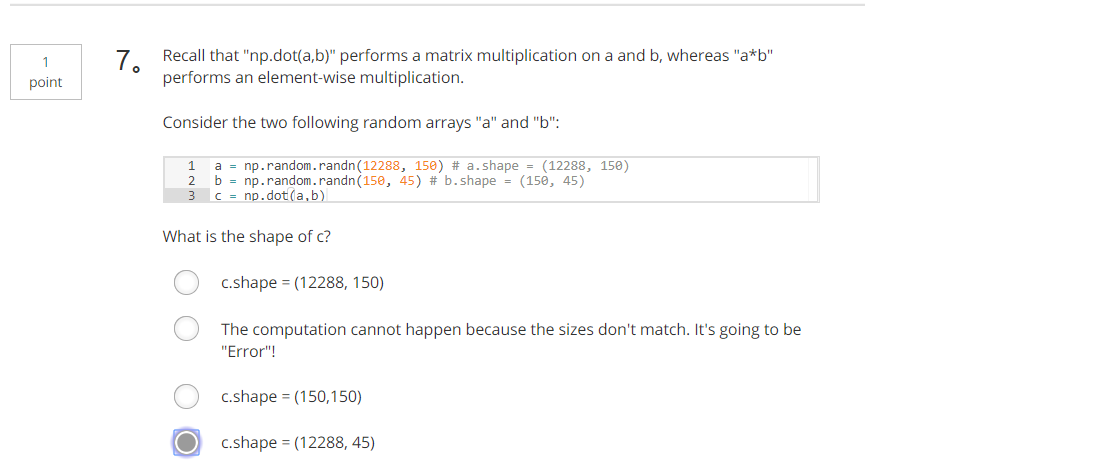

7、记得 "np. dot(a, b)" 在 a 和 b 上执行矩阵乘法, 而 "a * b" 执行元素乘法。考虑以下两个随机数组 "a" 和 "b":

a = np.random.randn(12288, 150) # a.shape = (12288, 150)

b = np.random.randn(150, 45) # b.shape = (150, 45)

c = np.dot(a,b)

A. c. 形状 = (12288, 150)

B. 由于大小不匹配, 无法进行计算。这将是 "错误"!

C. c. 形状 = (150150)

D. c. 形状 = (12288, 45)

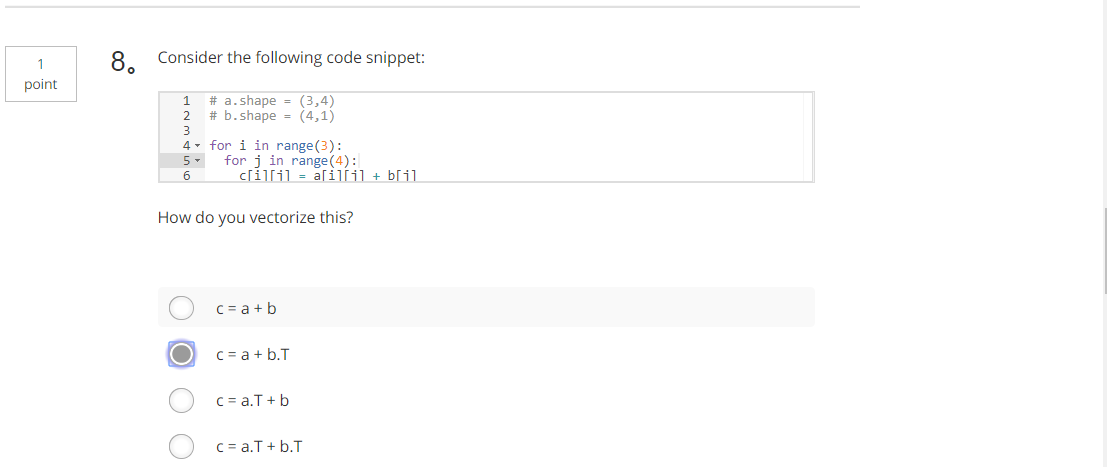

8、请考虑以下代码段,你怎么量化?(B)

# a.shape = (3,4)

# b.shape = (4,1) for i in range(3):

for j in range(4):

c[i][j] = a[i][j] + b[j]

A. c = a + b

B. c = a + b.T

C. c = a.T + b

D. c = a.T + b.T

9、请考虑以下代码:c的结果?(如果您不确定, 请随时在 python 中运行此查找)。(A)

a = np.random.randn(3, 3)

b = np.random.randn(3, 1)

c = a*b

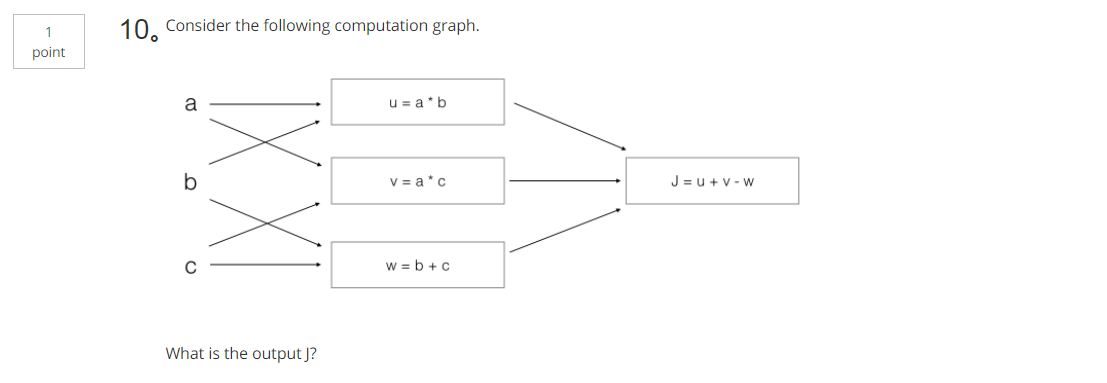

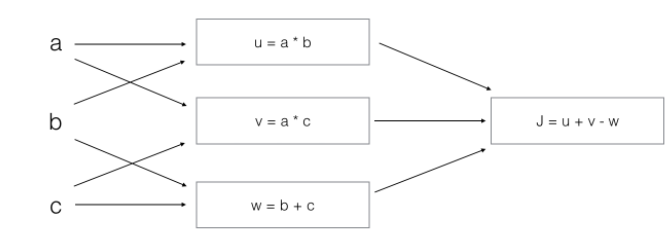

A. J = (c - 1)*(b + a)

B. J = (a - 1) * (b + c)

C. J = a*b + b*c + a*c

D. J = (b - 1) * (c + a)

课程一(Neural Networks and Deep Learning),第二周(Basics of Neural Network programming)—— 1、10个测验题(Neural Network Basics)的更多相关文章

- 吴恩达《深度学习》-第一门课 (Neural Networks and Deep Learning)-第二周:(Basics of Neural Network programming)-课程笔记

第二周:神经网络的编程基础 (Basics of Neural Network programming) 2.1.二分类(Binary Classification) 二分类问题的目标就是习得一个分类 ...

- 【DeepLearning学习笔记】Coursera课程《Neural Networks and Deep Learning》——Week2 Neural Networks Basics课堂笔记

Coursera课程<Neural Networks and Deep Learning> deeplearning.ai Week2 Neural Networks Basics 2.1 ...

- 【DeepLearning学习笔记】Coursera课程《Neural Networks and Deep Learning》——Week1 Introduction to deep learning课堂笔记

Coursera课程<Neural Networks and Deep Learning> deeplearning.ai Week1 Introduction to deep learn ...

- 第四节,Neural Networks and Deep Learning 一书小节(上)

最近花了半个多月把Mchiael Nielsen所写的Neural Networks and Deep Learning这本书看了一遍,受益匪浅. 该书英文原版地址地址:http://neuralne ...

- Neural Networks and Deep Learning学习笔记ch1 - 神经网络

近期開始看一些深度学习的资料.想学习一下深度学习的基础知识.找到了一个比較好的tutorial,Neural Networks and Deep Learning,认真看完了之后觉得收获还是非常多的. ...

- Neural Networks and Deep Learning

Neural Networks and Deep Learning This is the first course of the deep learning specialization at Co ...

- [C3] Andrew Ng - Neural Networks and Deep Learning

About this Course If you want to break into cutting-edge AI, this course will help you do so. Deep l ...

- 《Neural Networks and Deep Learning》课程笔记

Lesson 1 Neural Network and Deep Learning 这篇文章其实是 Coursera 上吴恩达老师的深度学习专业课程的第一门课程的课程笔记. 参考了其他人的笔记继续归纳 ...

- 课程一(Neural Networks and Deep Learning),第二周(Basics of Neural Network programming)—— 4、Logistic Regression with a Neural Network mindset

Logistic Regression with a Neural Network mindset Welcome to the first (required) programming exerci ...

- Neural Networks and Deep Learning 课程笔记(第四周)深层神经网络(Deep Neural Networks)

1. 深层神经网络(Deep L-layer neural network ) 2. 前向传播和反向传播(Forward and backward propagation) 3. 总结 4. 深层网络 ...

随机推荐

- SVD图片有损压缩测试

注意文件名别保持成svd.m,这样与系统的默认svd程序冲突 图片处理函数生成的三组二维数组对应RGB,处理时保留一组 clear all; close all; clc; a1=imread('C: ...

- idea在相应的包下右键创建servlet,找不到servlet选项

开始pom.xml文件里面我是只引进了个servlet包,但是右键依旧没有servlet选项 <dependency> <groupId>javax.servlet</g ...

- i2c设备驱动注册

Linux I2C设备驱动编写(二) 原创 2014年03月16日 23:26:50 在(一)中简述了Linux I2C子系统的三个主要成员i2c_adapter.i2c_driver.i2c ...

- php 获取当前在线用户数量

<?php //在线人数统计 $filename='online.txt';//数据文件 $cookiename='VGOTCN_OnLineCount';//cookie名称 $onlinet ...

- 常见笔记本进入bios方法

联想 y510p ->F2 ThinkPad E431 -> Fn + F1

- Chapter15 Principles of Metabolic Regulation

15.1 调节代谢的通路 (1)细胞和有机体维持着动态稳定 调节作用的基因多 2500个 12% 激酶占比多 300个 一个通路受到多方调节 (2)酶的数量和催化活性 可以被调节 反应物的调控 糖酵解 ...

- 最完美的Linux桌面软件

下面是关于Linux桌面环境下,目前为止最完美的部分.之所以说他们完美,是因为他们不但很养眼,而且也使用最好的多媒体技术,有最好的可用性.在某些方面,他们甚至超过了Windows和Mac-OS. 基础 ...

- (转)ASP.NET MVC 第五个预览版和表单提交场景

转自:http://ourlife.blog.51cto.com/708821/296171 上个星期四,ASP.NET MVC开发团队发布了ASP.NET MVC框架的“第五个预览版”.你可以在这里 ...

- Java理论学时第四节。课后作业。

请查看String.equals()方法的实现代码,注意学习其实现方法. public class StringEquals { public static void main(String[] ar ...

- android 增量更新原理

原理如下:服务器端设计增量表,记录数据操作顺序id,和增删改查信息.在进行数据库表操作的时候同时进行将信息保存在增量表. android客户端在请求的时候上传最后保存的id.服务端判断最后的id,返回 ...