【Hadoop报错】The directory item limit is exceeded: limit=1048576 items=1048576

问题描述:

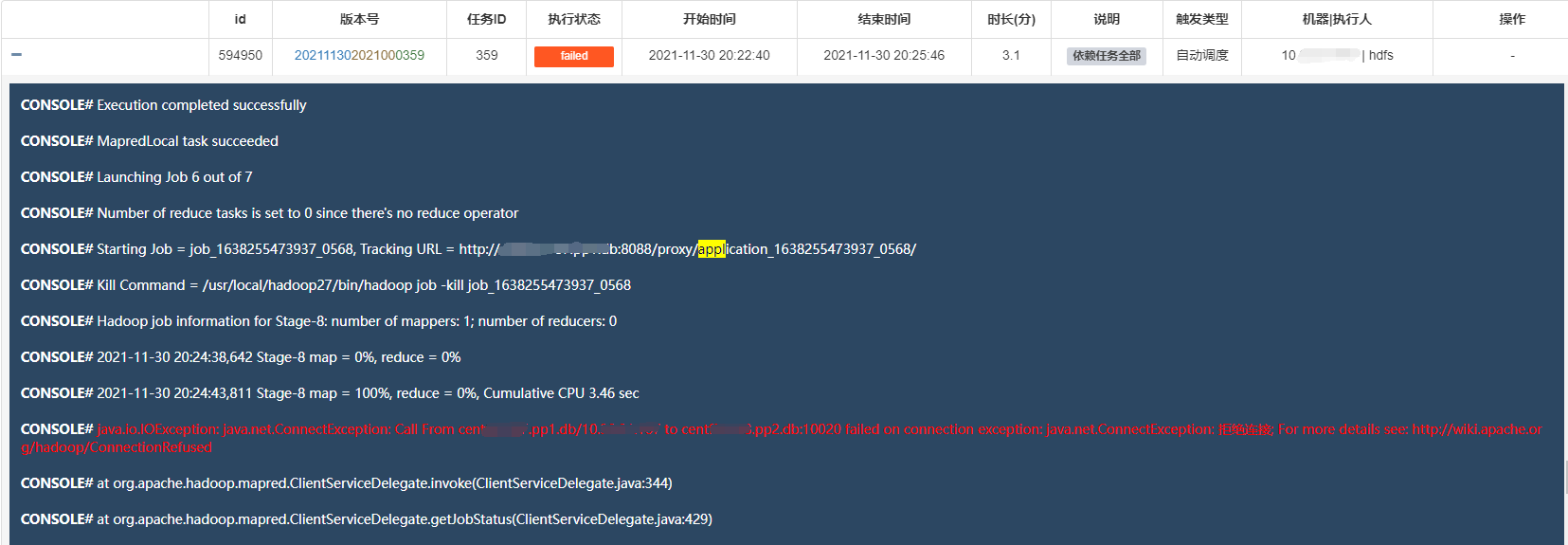

调度系统执行hive任务失败,一直执行失败,报错如下:

java.io.IOException: java.net.ConnectException: Call From #HostName/#IP to #HostName:10020 failed on connection exception: java.net.ConnectException: 拒绝连接; For more details see: http://wiki.apache.org/hadoop/ConnectionRefused

Caused by: java.net.ConnectException: Call From #HostName/#IP to #HostName:10020 failed on connection exception: java.net.ConnectException: 拒绝连接; For more details see: http://wiki.apache.org/hadoop/ConnectionRefused

CONSOLE# Ended Job = job_1638255473937_0568 with exception 'java.io.IOException(java.net.ConnectException: Call From #HostName/#IP to #HostName:10020 failed on connection exception: java.net.ConnectException: 拒绝连接; For more details see: http://wiki.apache.org/hadoop/ConnectionRefused)

CONSOLE# FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.mr.MapRedTask. java.net.ConnectException: Call From #HostName/#IP to #HostName:10020 failed on connection exception: java.net.ConnectException: 拒绝连接; For more details see: http://wiki.apache.org/hadoop/ConnectionRefused

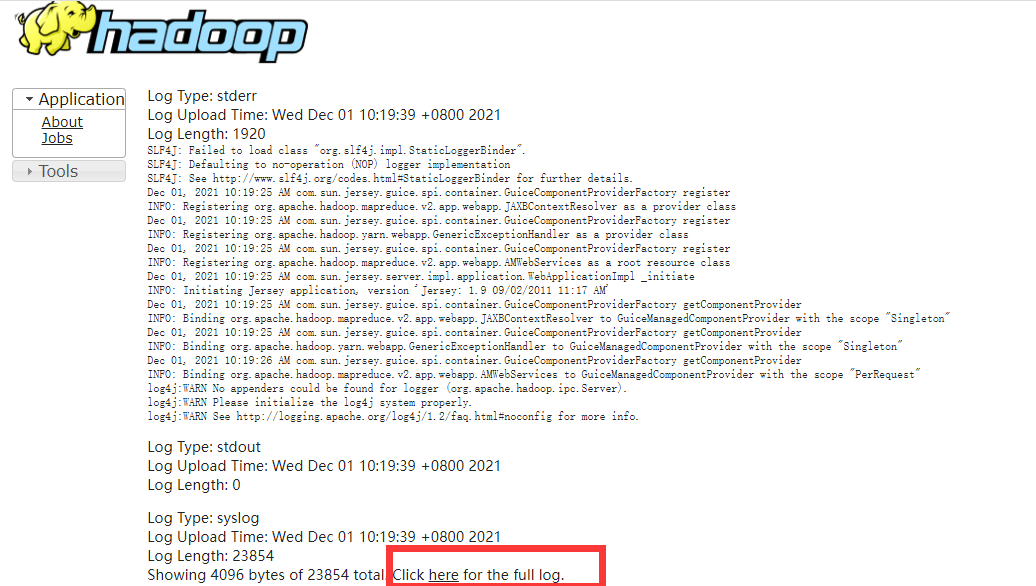

这个信息还看不出具体的问题所在,查看服务器上所有的日志,也没有看出问题,最后查看yarn的日志,看出问题所在。

根据调度系统,获取到ApplicationId:application_1638255473937_0568 , 然后从hdfs上查看对应的日志信息。

查看yarn日志信息:

[hdfs@centos hadoop27]$ yarn logs -applicationId application_1638255473937_0568

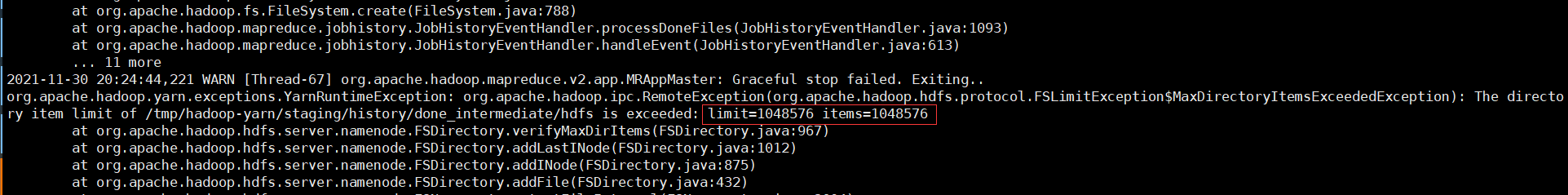

关键报错信息:

org.apache.hadoop.ipc.RemoteException(org.apache.hadoop.hdfs.protocol.FSLimitException$MaxDirectoryItemsExceededException): The directory item limit of /tmp/hadoop-yarn/staging/history/done_intermediate/hdfs is exceeded: limit=1048576 items=1048576

报错原因:

hadoop单个目录下文件超1048576个,默认limit限制数为1048576,所以要调大limit限制数。

解决方法1:

hdfs-site.xml配置文件添加配置参数:dfs.namenode.fs-limits.max-directory-items ,调大参数值。

将配置文件推送到hadoop集群所有节点,重启Hadoop服务。

解决方法2:

如果不方便修改配置重启hadoop集群服务。可以先删除该目录:/tmp/hadoop-yarn/staging/history/done_intermediate/hdfs

然后重建目录即可。

hadoop fs -rm -r /tmp/hadoop-yarn/staging/history/done_intermediate/hdfs

hadoop fs -mkdir /tmp/hadoop-yarn/staging/history/done_intermediate/hdfs

造成这个目录文件数超上限,本质原因还是hadoop集群之前没有开启jobhistory server,没有清除历史job日志信息导致的。

参考文章:http://www.tracefact.net/tech/079.html

扩展信息:

一:如何查看yarn日志存放目录及日志详细信息

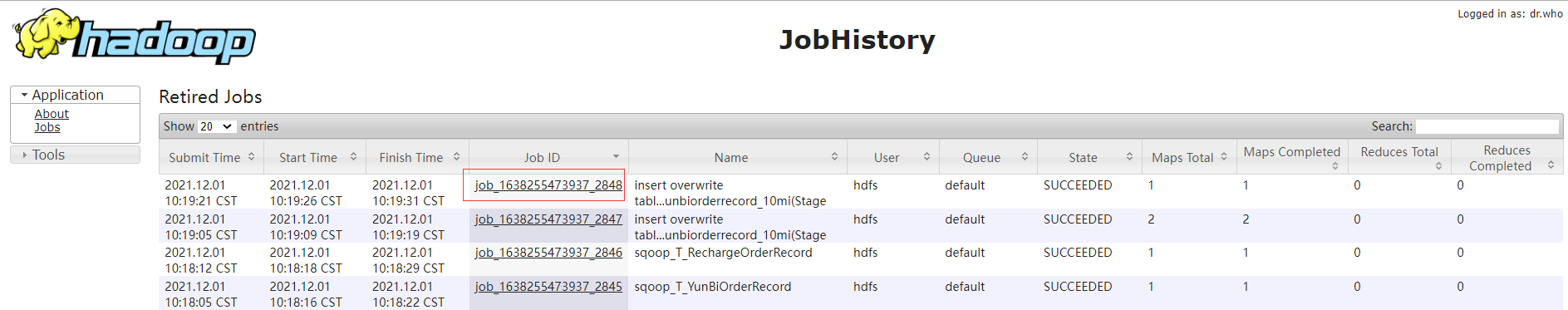

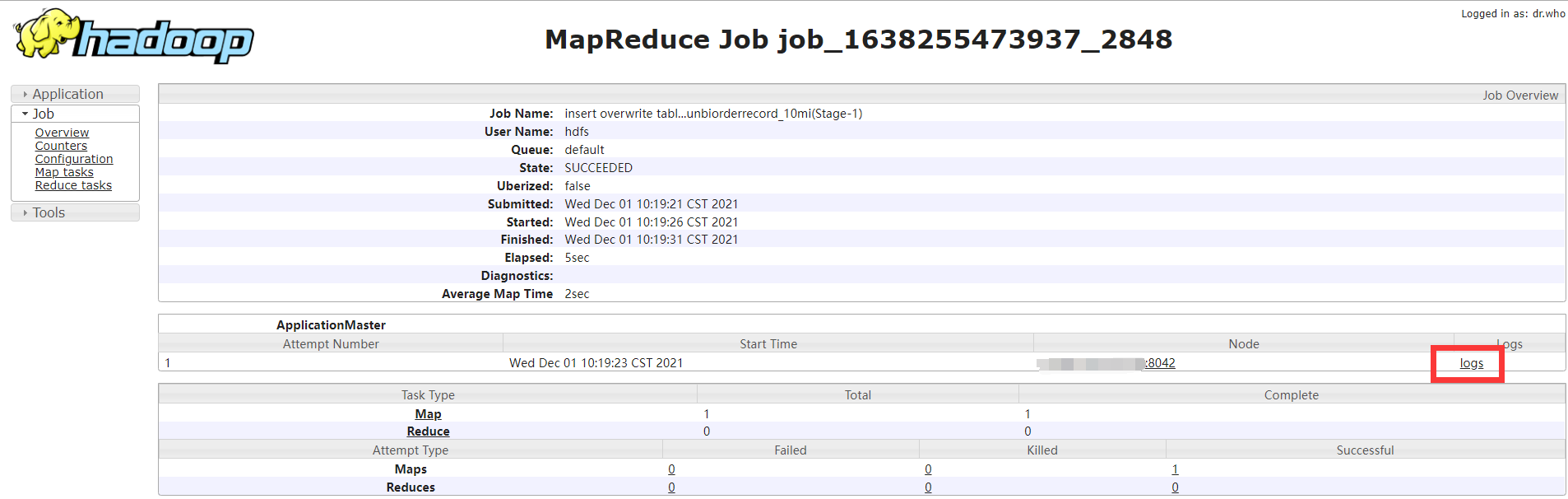

1:通过history server UI界面查看。(我这里是http://IP:8801/jobhistory)

2:通过yarn命令查看(用户要和提交任务的用户一致)

2.1: yarn application -list -appStates ALL(这个不显示时间信息)

2.2: yarn logs -applicationId application_1638255473937_0568

3:直接查看hdfs路径的log (是存放在hdfs目录上的,不是存放在centos系统的自定义日志目录上)

3.1: 查看yarn-site.xml文件,确认log配置目录。

<property>

<name>yarn.nodemanager.remote-app-log-dir</name>

<value>/data1/hadoop27/logs</value>

</property>

3.2: 查看日志文件信息

[hdfs@centos hadoop]$ hdfs dfs -ls /data1/hadoop27/logs/hdfs/logs/application_1638255473937_0568

Found 1 items

-rw-r----- 2 hdfs hdfs 66188 2021-11-30 20:24 /data1/hadoop27/logs/hdfs/logs/application_1638255473937_0568/centos.pp1.db_46654

3.3: 查看日志详细信息

3.3.1: yarn logs -applicationId application_1638255473937_0568 (同2)

3.3.2: hdfs dfs -cat /data1/hadoop27/logs/hdfs/logs/application_1638255473937_0568/centos.pp1.db_46654 ## 通过-cat查看

3.3.3: hdfs dfs -cat /data1/hadoop27/logs/hdfs/logs/application_1638255473937_0568/centos.pp1.db_46654 > tmp.log ## 通过-cat把内容存到当前目录的tmp.log中。

3.3.4: hdfs dfs -get /data1/hadoop27/logs/hdfs/logs/application_1638255473937_0568/centos.pp1.db_46654 ## 通过get把hdfs文件下载到当前啊目录下,然后查看。

二: hdfs操作命令:

1.1: 查看hdfs的指定目录下有多少个文件夹和文件。

[hdfs@centos hadoop]$ hadoop fs -count /tmp/hadoop-yarn/staging/history/done_intermediate/hdfs

1 1048576 3253261451467 /tmp/hadoop-yarn/staging/history/done_intermediate/hdfs

第一个数值1表示该目录下有1个文件夹。

第二个数值1048576表示该目录下有1个文件。

第三个数值3253261451467表示该目录下所有文件总大小。

【Hadoop报错】The directory item limit is exceeded: limit=1048576 items=1048576的更多相关文章

- eclipse连接远程Hadoop报错,Caused by: java.io.IOException: 远程主机强迫关闭了一个现有的连接。

eclipse连接远程Hadoop报错,Caused by: java.io.IOException: 远程主机强迫关闭了一个现有的连接.全部报错信息如下: Exception in thread & ...

- 解决sqoop报错Invalid number; item = ITEM_UNICODE

报错栈: java.sql.SQLException: Invalid number; item = ITEM_UNICODE at com.intersys.jdbc.SysList.getInt( ...

- hadoop报错WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable

19/06/14 10:44:58 WARN common.Util: Path /opt/hadoopdata/hdfs/name should be specified as a URI in c ...

- 解决windows下Eclipse连接远程Hadoop报错

Exception in thread "main" java.lang.UnsatisfiedLinkError: org.apache.hadoop.io.nativeio.N ...

- hadoop报错:java.io.IOException(java.net.ConnectException: Call From xxx/xxx to xxx:10020 failed on connection exception: java.net.ConnectException: 拒绝连接

任务一直报错 现象比较奇怪,部分任务可以正常跑,部分问题报错 报错信息如下: Ended Job = job_1527476268558_132947 with exception 'java.io. ...

- hadoop报错:could only be replicated to 0 nodes, instead of 1

错误 [root@hadoop test]# hadoop jar hadoop.jarcom.hadoop.hdfs.CopyToHDFS 14/01/26 10:20:00 WARN hdfs.D ...

- hadoop报错

19/11/24 08:29:08 INFO qlh.MyMapreduce: ================this is job================= 19/11/24 08:29: ...

- ubuntu环境下重启mysql服务报错“No directory, logging in with HOME=-”

前提:使用系统的环境 3.13.0-24-generic mysql的版本:5.6.33 错误描述: 首先用mysqld_safe启动报错如下: root@zabbix-forFunction:~# ...

- hadoop报错:hdfs.DFSClient: Exception in createBlockOutputStream

hadoop跑任务搞的好好的,后来把hadoop-dir移了一个位置,结果报错: java.io.EOFException: Premature EOF: no length prefix avail ...

- HADOOP报错Incompatible namespaceIDs

出现这个问题的原因是因为namespaceIDs导致的 解决方案1<推荐> 1. 进入链接不上的从机 stop-all.sh关闭hadoop 2. 编辑namespaceID,路径是< ...

随机推荐

- 【爬虫案例】用Python爬大麦网任意城市的近期演出活动!

目录 一.爬取目标 二.展示爬取结果 三.讲解代码 四.同步视频 五.附完整源码 一.爬取目标 大家好,我是@马哥python说 ,一枚10年程序猿. 今天分享一期python爬虫案例,爬取目标是大麦 ...

- XTuner 微调 LLM实操-书生浦语大模型实战营第二期第4节作业

这一作业中提及的解释比较少,更多的只是一些步骤截图.这是因为教程中已经提及了几乎所有的细节信息,没有什么需要补充的.这个页面相较于官方教程的部分解释得过于详细的内容甚至是有所删减的.比如关于文件路径可 ...

- 基于三菱Q系列cc-Link的立体仓库控制系统

系统说明: 方案选择: 工艺流程: 触摸屏设计: 程序设计:采用SFC进行编程,结构清晰,逻辑明了 本文章为学习记录,水平有限,望各路大佬们轻喷!!! 转载请注明出处!!!

- go 操作elasticsearch

olivere/elastic 包 github.com/olivere/elastic doc: https://pkg.go.dev/github.com/olivere/elastic?utm_ ...

- java中调用exe程序和问题处理

常规方法如下: public class RunExe { public static void main(String[] args) { try { // exe文件的完整路径 String fi ...

- 版本管理工具 nvm WIN版

nvm -h //查看nvm的指令 nvm list //查看本地已经安装的node版本列表 nvm list available //查看可以安装的node版本 nvm install latest ...

- PageOffice 6 版本最简单的打开保存文件

在OA办公.文档流转等各个Web系统中,实现最简单的打开编辑保存文件功能,调用PageOffice只需要几行代码就可以完成. 后端代码 在后端编写代码调用webOpen方法打开文件之前给SaveFil ...

- vue项目使用研究1

在windows上安装了npm vue-cli之后,创建vue项目. 用pycharm打开 vue form表单最简单提交方法 <!DOCTYPE html> <html lang= ...

- CICD详解之gitlab,Jenkins

持续集成概念 持续集成Continuous Integration 持续交付Continuous Delivery 持续部署Continuous Deployment 什么是持续集成: 持续集成是指开 ...

- 基于uniapp+vue3自定义增强版table表格组件「兼容H5+小程序+App端」

vue3+uniapp多端自定义table组件|uniapp加强版综合表格组件 uv3-table:一款基于uniapp+vue3跨端自定义手机端增强版表格组件.支持固定表头/列.边框.斑马纹.单选/ ...