三、k8s集群可用性验证与调参(第一章、k8s高可用集群安装)

作者:北京小远

出处:http://www.cnblogs.com/bj-xy/

参考课程:Kubernetes全栈架构师(电脑端购买优惠)

文档禁止转载,转载需标明出处,否则保留追究法律责任的权利!

目录:

一、集群可用性验证

k8s安装完成后需要进行可用性验证,因为k8s中有pod通信 server通信 node通信要保证通信正常

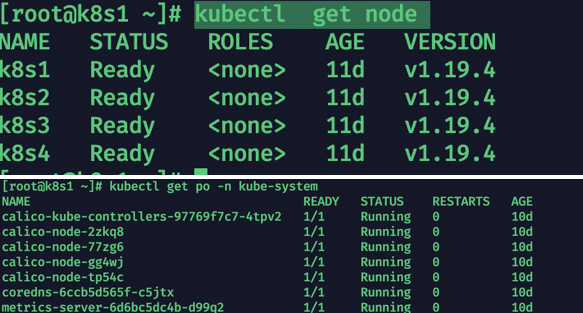

1、1查看基本组件情况

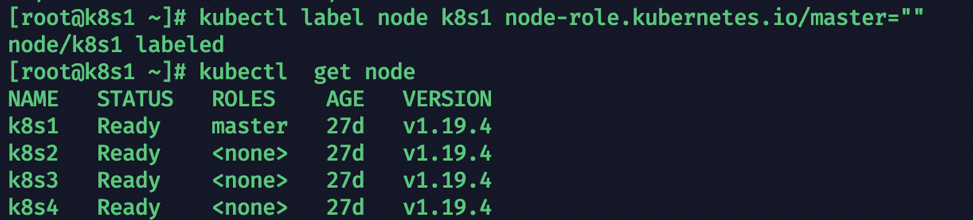

kubectl get node

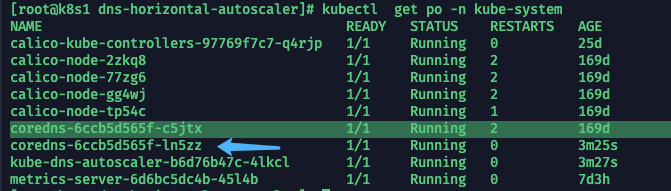

kubectl get po -n kube-system

1、2创建测试pod

cat<<EOF | kubectl apply -f -

apiVersion: v1

kind: Pod

metadata:

name: busybox

namespace: default

spec:

containers:

- name: busybox

image: busybox:1.28

command:

- sleep

- "3600"

imagePullPolicy: IfNotPresent

restartPolicy: Always

EOF

1.3 测试连通性

1、测试pod能否解析同namespace的kubernetes的 svc

kubectl get svc (查看kubernetes的svc)

kubectl exec busybox -n default -- nslookup kubernetes (解析)

结果:

Server: 10.96.0.10

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.local

Name: kubernetes

Address 1: 10.96.0.1 kubernetes.default.svc.cluster.local

2、测试pod能否解析跨namespace的 svc

kubectl get svc -n kube-system

kubectl exec busybox -n default -- nslookup kube-dns.kube-system

结果:

Server: 10.96.0.10

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.local

Name: kube-dns.kube-system

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.local

3、测试每个节点能否访问kubernetes svc的443端口 与kube-dns service的53端口

kubectl get svc 获取 cluster ip

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 24d

在每个节点执行

telnet 10.96.0.1 443

测试kube-dns的联通

kubectl get svc -n kube-system

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kube-dns ClusterIP 10.96.0.10 <none> 53/UDP,53/TCP,9153/TCP 21d

metrics-server ClusterIP 10.111.181.43 <none> 443/TCP 21d

在每个节点执行

telnet 10.96.0.10 53

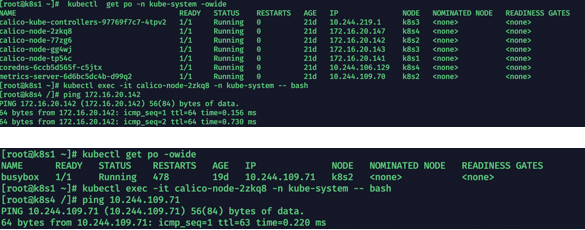

4、测试pod之间能否通信

kubectl get po -n kube-system -owide 获取pod

进入到calico-node的某台容器中

kubectl exec -it calico-node-2zkq8 -n kube-system -- bash

然后找一个其他节点的 calico-node pod的一个ip ping测试连通性

测试与busybox 测试容器的连通性

kubectl get po -owide

5、清除测试pod

kubectl delete po busybox

查看是否删除

kubectl get po

二、参数优化

2.1 容器配置参数优化

每台机器执行

cat > /etc/docker/daemon.json <<EOF

{

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "50m",

"max-file": "3"

},

"registry-mirrors": ["https://ufkb7xyg.mirror.aliyuncs.com"],

"max-concurrent-downloads": 10,

"max-concurrent-uploads": 5,

"live-restore": true

}

EOF

systemctl daemon-reload

systemctl restart docker

#删除状态是exited的容器

docker rm $(docker ps -q -f status=exited)

参数解析:

exec-opts:docker的CgroupDriver改成systemd

log-driver:日志格式

log-opts:日志存储大小与份数

registry-mirrors:镜像下载代理地址

max-concurrent-downloads:镜像下载启动的进程

max-concurrent-uploads:镜像上传启动的进程

live-restore:配置守护进程,让重启docker服务不重启容器

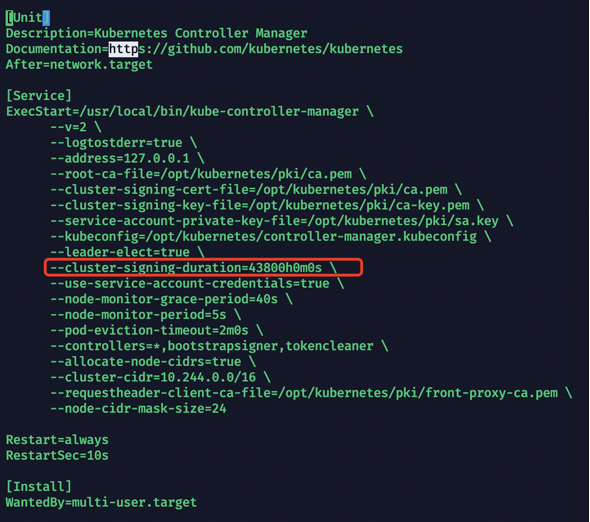

2.2 controller-manager配置参数优化

master节点配置

vim /usr/lib/systemd/system/kube-controller-manager.service

--cluster-signing-duration=43800h0m0s \

systemctl daemon-reload

systemctl restart kube-controller-manager

设置自动办法证书周期:

最大支持5年

--cluster-signing-duration

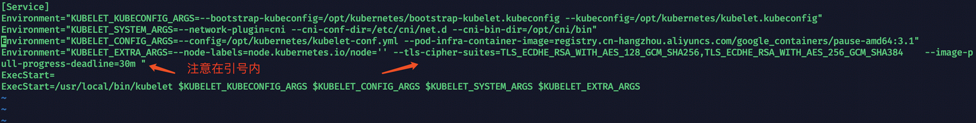

2.3 kubelet配置参数优化

每台机器执行

vim /etc/systemd/system/kubelet.service.d/10-kubelet.conf

Environment="KUBELET_EXTRA_ARGS=--node-labels=node.kubernetes.io/node='' --tls-cipher-suites=TLS_ECDHE_RSA_WITH_AES_128_GCM_SHA256,TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384 --image-pull-progress-deadline=30m "

解析

-tls-cipher-suites= 加密方式因为默认的加密方式不安全

--image-pull-progress-deadline 设置下载镜像的 deadline避免重复尝试

vim /opt/kubernetes/kubelet-conf.yml

rotateServerCertificates: true

allowedUnsafeSysctls:

- "net.core*"

- "net.ipv4.*"

kubeReserved:

cpu: "100m"

memory: 300Mi

ephemeral-storage: 10Gi

systemReserved:

cpu: "100m"

memory: 300Mi

ephemeral-storage: 10Gi

解析:

rotateServerCertificates 自动配置证书

allowedUnsafeSysctls 允许就该内核参数

kubeReserved 预留系统资源给k8s 根据机器资源分配

systemReserved

systemctl daemon-reload

systemctl restart kubelet

2.4 更改master节点的ROLES

设置所有master节点的角色

kubectl label node k8s1 node-role.kubernetes.io/master=""

三、设置coredns为自动扩容(可以不做)

1、资源配置文件

cat > dns-horizontal-autoscaler_v1.9.yaml << EOF

kind: ServiceAccount

apiVersion: v1

metadata:

name: kube-dns-autoscaler

namespace: kube-system

labels:

addonmanager.kubernetes.io/mode: Reconcile

---

kind: ClusterRole

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: system:kube-dns-autoscaler

labels:

addonmanager.kubernetes.io/mode: Reconcile

rules:

- apiGroups: [""]

resources: ["nodes"]

verbs: ["list", "watch"]

- apiGroups: [""]

resources: ["replicationcontrollers/scale"]

verbs: ["get", "update"]

- apiGroups: ["apps"]

resources: ["deployments/scale", "replicasets/scale"]

verbs: ["get", "update"]

# Remove the configmaps rule once below issue is fixed:

# kubernetes-incubator/cluster-proportional-autoscaler#16

- apiGroups: [""]

resources: ["configmaps"]

verbs: ["get", "create"]

---

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: system:kube-dns-autoscaler

labels:

addonmanager.kubernetes.io/mode: Reconcile

subjects:

- kind: ServiceAccount

name: kube-dns-autoscaler

namespace: kube-system

roleRef:

kind: ClusterRole

name: system:kube-dns-autoscaler

apiGroup: rbac.authorization.k8s.io

---

apiVersion: apps/v1

kind: Deployment

metadata:

name: kube-dns-autoscaler

namespace: kube-system

labels:

k8s-app: kube-dns-autoscaler

kubernetes.io/cluster-service: "true"

addonmanager.kubernetes.io/mode: Reconcile

spec:

selector:

matchLabels:

k8s-app: kube-dns-autoscaler

template:

metadata:

labels:

k8s-app: kube-dns-autoscaler

annotations:

seccomp.security.alpha.kubernetes.io/pod: 'docker/default'

spec:

priorityClassName: system-cluster-critical

securityContext:

supplementalGroups: [ 65534 ]

fsGroup: 65534

nodeSelector:

kubernetes.io/os: linux

containers:

- name: autoscaler

image: registry.cn-beijing.aliyuncs.com/yuan-k8s/cluster-proportional-autoscaler-amd64:1.8.1

resources:

requests:

cpu: "20m"

memory: "10Mi"

command:

- /cluster-proportional-autoscaler

- --namespace=kube-system

- --configmap=kube-dns-autoscaler

- --target=deployment/coredns

- --default-params={"linear":{"coresPerReplica":16,"nodesPerReplica":4,"min":2,"max":4,"preventSinglePointFailure":true,"includeUnschedulableNodes":true}}

- --logtostderr=true

- --v=2

tolerations:

- key: "CriticalAddonsOnly"

operator: "Exists"

serviceAccountName: kube-dns-autoscaler

EOF

2、解析

-default-params中的参数

min:coredns最小数

max:coredns最打数

coresPerReplica:集群CPU核心数

nodesPerReplica:集群节点数

preventSinglePointFailure:设置为 时true,如果有多个节点,控制器确保至少有 2 个副本

includeUnschedulableNodes被设定为true,副本将刻度基于节点的总数。否则副本将仅根据可调度节点的数量进行扩展

注意:

- --target= 这里与kube-dns.yaml中定义的name一致

如果报错没有ConfigMap则创建下面的资源

cat > dns-autoscaler-ConfigMap.yaml << EOF

kind: ConfigMap

apiVersion: v1

metadata:

name: dns-autoscaler

namespace: kube-system

data:

linear: |-

{

"coresPerReplica": 16,

"nodesPerReplica": 4,

"min": 2,

"preventSinglePointFailure": true

}

EOF

3、创建

dns-horizontal-autoscaler_v1.9.yaml

4、查看

kubectl get po -n kube-system

三、k8s集群可用性验证与调参(第一章、k8s高可用集群安装)的更多相关文章

- kubernetes教程第一章-kubeadm高可用安装k8s集群

目录 Kubeadm高可用安装k8s集群 kubeadm高可用安装1.18基本说明 k8s高可用架构解析 kubeadm基本环境配置 kubeadm基本组件安装 kubeadm集群初始化 高可用Mas ...

- Linux centosVMware 集群介绍、keepalived介绍、用keepalived配置高可用集群

一.集群介绍 根据功能划分为两大类:高可用和负载均衡 高可用集群通常为两台服务器,一台工作,另外一台作为冗余,当提供服务的机器宕机,冗余将接替继续提供服务 实现高可用的开源软件有:heartbeat. ...

- Corosync+Pacemaker+crmsh构建Web高可用集群

一.概述: 1.1 AIS和OpenAIS简介 AIS应用接口规范,是用来定义应用程序接口(API)的开放性规范的集合,这些应用程序作为中间件为应用服务提供一种开放.高移植性的程序接口.是在实现高可用 ...

- 配置drbd高可用集群

前期准备: 同步时间 (两个节点) 节点一(172.16.21.6) [root@stu21 heartbeat2]# ntpdate 172.16.0.1 31 Dec 20:59:25 ntpda ...

- spark高可用集群搭建及运行测试

文中的所有操作都是在之前的文章spark集群的搭建基础上建立的,重复操作已经简写: 之前的配置中使用了master01.slave01.slave02.slave03: 本篇文章还要添加master0 ...

- rancher1.6高可用集群搭建

rancher高可用集群搭建 一.搭建环境 1.安装系统 下载centos最新版, http://mirrors.sohu.com/centos/7/isos/x86_64/CentOS-7-x86_ ...

- Redis总结(五)缓存雪崩和缓存穿透等问题 Web API系列(三)统一异常处理 C#总结(一)AutoResetEvent的使用介绍(用AutoResetEvent实现同步) C#总结(二)事件Event 介绍总结 C#总结(三)DataGridView增加全选列 Web API系列(二)接口安全和参数校验 RabbitMQ学习系列(六): RabbitMQ 高可用集群

Redis总结(五)缓存雪崩和缓存穿透等问题 前面讲过一些redis 缓存的使用和数据持久化.感兴趣的朋友可以看看之前的文章,http://www.cnblogs.com/zhangweizhon ...

- .Net Core2.1 秒杀项目一步步实现CI/CD(Centos7.2)系列一:k8s高可用集群搭建总结以及部署API到k8s

前言:本系列博客又更新了,是博主研究很长时间,亲自动手实践过后的心得,k8s集群是购买了5台阿里云服务器部署的,这个集群差不多搞了一周时间,关于k8s的知识点,我也是刚入门,这方面的知识建议参考博客园 ...

- Kubeadm 1.9 HA 高可用集群本地离线镜像部署【已验证】

k8s介绍 k8s 发展速度很快,目前很多大的公司容器集群都基于该项目,如京东,腾讯,滴滴,瓜子二手车,易宝支付,北森等等. kubernetes1.9版本发布2017年12月15日,每三个月一个迭代 ...

随机推荐

- CMOS图像传感器同时感知和处理光学图像

CMOS图像传感器同时感知和处理光学图像 概述 近年来,机器视觉技术有了巨大的飞跃,现在已经成为各种智能系统的一个组成部分,包括自主车辆和机器人.通常,视觉信息由基于帧的摄像机捕获,转换成数字格式,然 ...

- TensorFlow反向传播算法实现

TensorFlow反向传播算法实现 反向传播(BPN)算法是神经网络中研究最多.使用最多的算法之一,用于将输出层中的误差传播到隐藏层的神经元,然后用于更新权重. 学习 BPN 算法可以分成以下两个过 ...

- TensorRT 7.2.1 开发概要(下)

TensorRT 7.2.1 开发概要(下) 1.2. Where Does TensorRT Fit? 一般来说,开发和部署深度学习模型的工作流要经过三个阶段. Phase 1 is trainin ...

- 77GHz 和24GHz Radar性能解析

77GHz 和24GHz Radar性能解析 一.77GHz MRR 77GHz MRR Automotive Collision Warning Radar Application MRR – Fo ...

- C++标准模板库(STL)——set常见用法详解

set的定义 set<typename> name; typename可以是任何基本类型,如int.double.char.结构体等,也可以是STL标准容器,如vector.set.que ...

- JVM中的堆的新生代、老年代、永久代详解

JVM中的堆一般分为三大部分:新生代.老年代.永久代,其大致的占比如下: 一.新生代 新生代主要用来存放新生的对象.一般占据堆空间的1/3.在新生代中,保存着大量的刚刚创建的对象,但是大部分的对象都 ...

- fiddler选项卡-AutoResponder(自动响应)

AutoResponder 它可以把本来服务器响应的内容,使用本地内容来响应.这个对网站开发人员来说很有用. 1.AutoResponder界面 2.界面功能解析,根据上图标注位置 1.Enable ...

- P1045 [NOIP2003 普及组] 麦森数

题目描述 形如2^P−1的素数称为麦森数,这时P一定也是个素数.但反过来不一定,即如果P是个素数,2^P−1不一定也是素数. 到1998年底,人们已找到了37个麦森数.最大的一个是P=3021377, ...

- Centos acme.sh 申请 LetsEncrypt 通配证书

1. 安装 acme.sh 注意:如果需要使用 Standalone Mode请先安装socat# yum intall socat It is recommended to install soca ...

- 03:CSS(01)

内容概要 分组与嵌套 伪类选择器 伪元素选择器 选择器优先级 css属性相关(操作标签样式) 浮动 定位 模态框 透明度 内容详细 分组与嵌套 div,p,span { /*逗号表示并列关系*/ co ...