Hadoop----hdfs dfs常用命令的使用

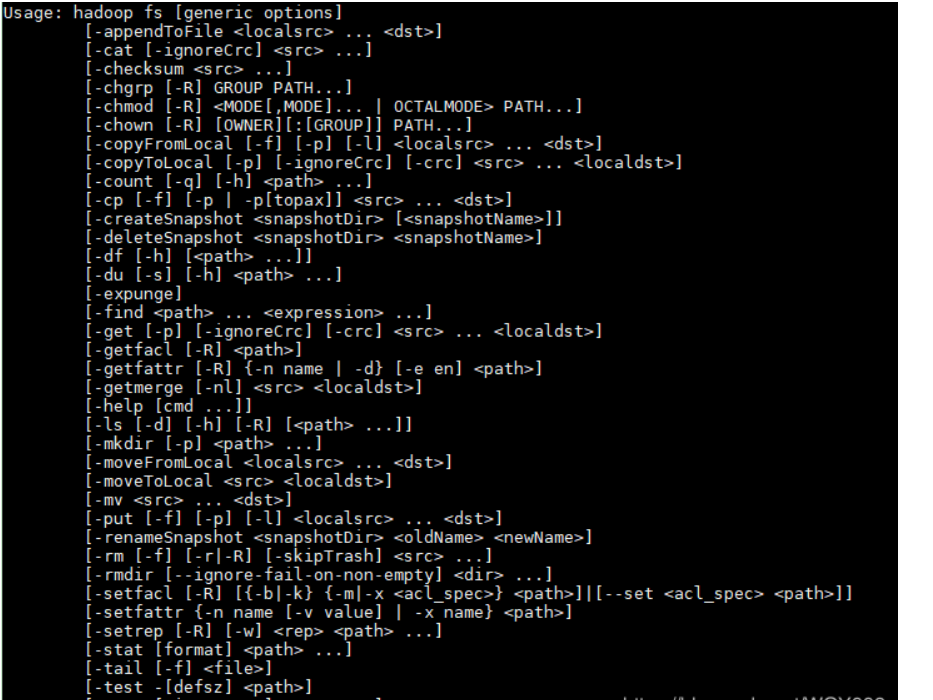

用法

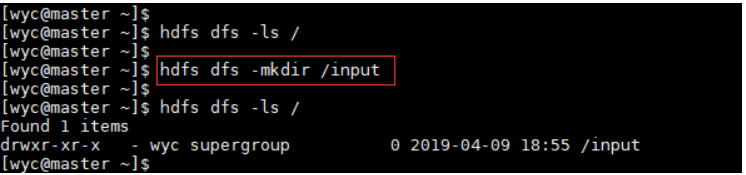

-mkdir

创建目录

Usage:hdfs dfs -mkdir [-p] < paths>

选项:-p

很像Unix mkdir -p,沿路径创建父目录。

-ls

查看目录下内容,包括文件名,权限,所有者,大小和修改时间

Usage:hdfs dfs -ls [-R] < args>

选项:-R

递归地显示子目录下的内容

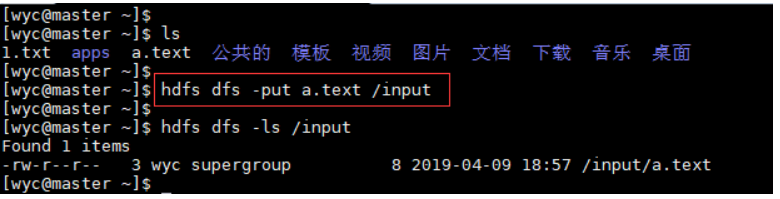

-put

将本地文件或目录上传到HDFS中的路径

Usage:hdfs dfs -put < localsrc> … < dst>

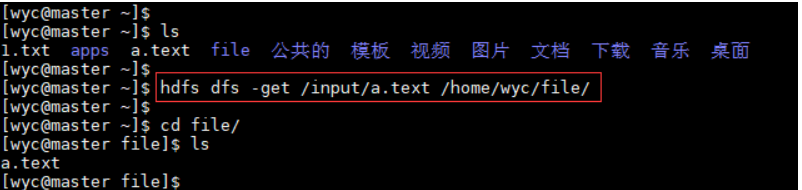

-get

将文件或目录从HDFS中的路径拷贝到本地文件路径

Usage:hdfs dfs -get [-ignoreCrc] [-crc] < src> < localdst>

选项:

-ignorecrc选项复制CRC校验失败的文件。

-crc选项复制文件和CRC。

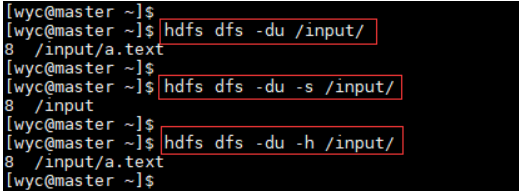

-du

显示给定目录中包含的文件和目录的大小或文件的长度,用字节大小表示,文件名用完整的HDFS协议前缀表示,以防它只是一个文件。

Usage:hdfs dfs -du [-s] [-h] URI [URI …]

选项:

-s选项将显示文件长度的汇总摘要,而不是单个文件。

-h选项将以“人类可读”的方式格式化文件大小(例如64.0m而不是67108864)

-dus

显示文件长度的摘要。

Usage:hdfs dfs -dus < args>

注意:不推荐使用此命令。而是使用hdfs dfs -du -s。

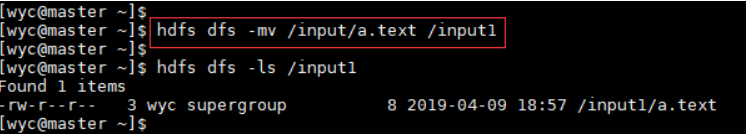

-mv

在HDFS文件系统中,将文件或目录从HDFS的源路径移动到目标路径。不允许跨文件系统移动文件。

Usage: hdfs dfs -mv URI [URI …] < dest>

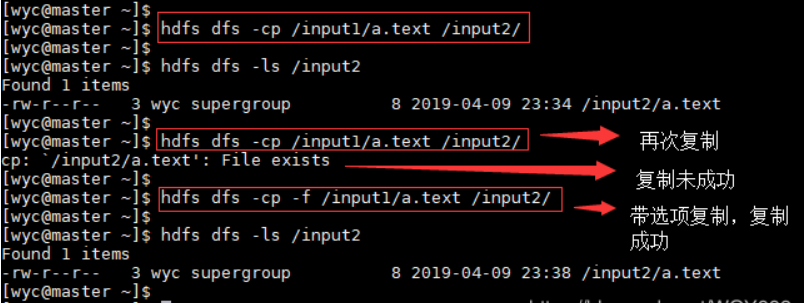

-cp

在HDFS文件系统中,将文件或目录复制到目标路径下

Usage:hdfs dfs -cp [-f] [-p | -p [topax] ] URI [ URI …] < dest>

选项:

-f选项覆盖已经存在的目标。

-p选项将保留文件属性[topx](时间戳,所有权,权限,ACL,XAttr)。如果指定了-p且没有arg,则保留时间戳,所有权和权限。如果指定了-pa,则还保留权限,因为ACL是一组超级权限。确定是否保留原始命名空间扩展属性与-p标志无关。

-copyFromLocal

从本地复制文件到hdfs文件系统(与-put命令相似)

Usage: hdfs dfs -copyFromLocal < localsrc> URI

选项:

如果目标已存在,则-f选项将覆盖目标。

-copyToLocal

复制hdfs文件系统中的文件到本地 (与-get命令相似)

Usage: hdfs dfs -copyToLocal [-ignorecrc] [-crc] URI < localdst>

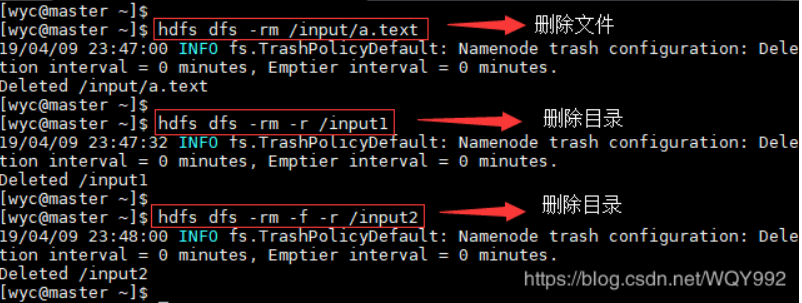

-rm

删除一个文件或目录

Usage:hdfs dfs -rm [-f] [-r|-R] [-skipTrash] URI [URI …]

选项:

如果文件不存在,-f选项将不显示诊断消息或修改退出状态以反映错误。

-R选项以递归方式删除目录及其下的任何内容。

-r选项等效于-R。

-skipTrash选项将绕过垃圾桶(如果已启用),并立即删除指定的文件。当需要从超配额目录中删除文件时,这非常有用。

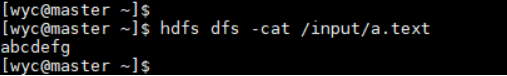

-cat

显示文件内容到标准输出上。

Usage:hdfs dfs -cat URI [URI …]

-text

Usage: hdfs dfs -text

获取源文件并以文本格式输出文件。允许的格式为zip和TextRecordInputStream。

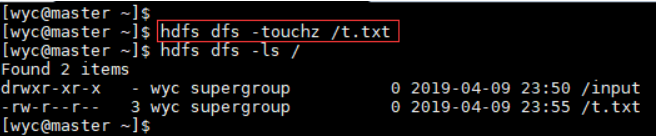

-touchz

创建一个零长度的文件。

Usage:hdfs dfs -touchz URI [URI …]

-stat

显示文件所占块数(%b),文件名(%n),块大小(%n),复制数(%r),修改时间(%y%Y)。

Usage:hdfs dfs -stat URI [URI …]

-tail

显示文件的最后1kb内容到标准输出

Usage:hdfs dfs -tail [-f] URI

选项:

-f选项将在文件增长时输出附加数据,如在Unix中一样。

-count

统计与指定文件模式匹配的路径下的目录,文件和字节数

Usage: hdfs dfs -count [-q] [-h] < paths>

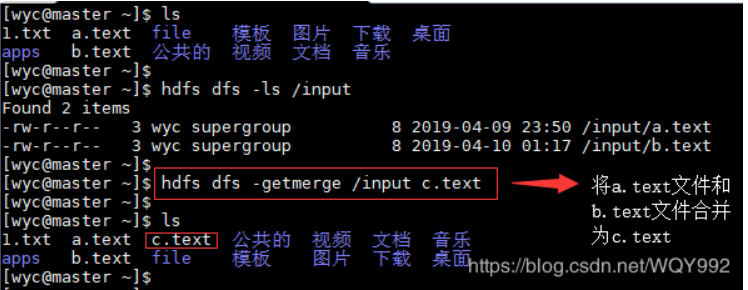

-getmerge

将源目录和目标文件作为输入,并将src中的文件连接到目标本地文件(把两个文件的内容合并起来)

Usage:hdfs dfs -getmerge < src> < localdst> [addnl]

注:合并后的文件位于当前目录,不在hdfs中,是本地文件

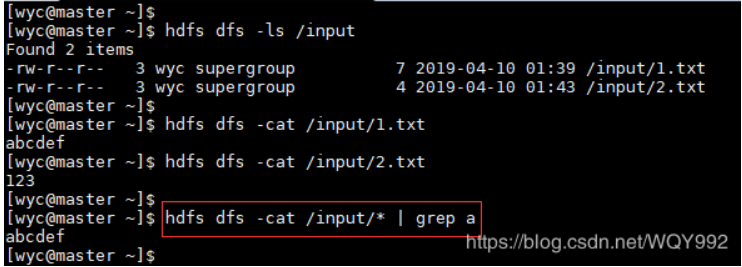

-grep

从hdfs上过滤包含某个字符的行内容

Usage:hdfs dfs -cat < srcpath> | grep 过滤字段

原文链接:https://blog.csdn.net/WQY992/article/details/89002269

Hadoop----hdfs dfs常用命令的使用的更多相关文章

- [b0002] Hadoop HDFS cmd常用命令练手

目的: 学会HDFS CLI 常用操作 环境: Hadoop 2.6.4 伪分布式版 环境搭建参考本博客前篇文章: 伪分布式 hadoop 2.6.4 帮助: hadoop@ssmaster:~$ h ...

- Hadoop HDFS的常用命令

1.将目录/root/data/下的item.txt复制到HDFS下的/user/root下: hadoop fs -copyFromLocal /root/data/item.txt itemdat ...

- Hadoop HDFS文件常用操作及注意事项

Hadoop HDFS文件常用操作及注意事项 1.Copy a file from the local file system to HDFS The srcFile variable needs t ...

- Hadoop生态圈-hbase常用命令

Hadoop生态圈-hbase常用命令 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任.

- Hadoop HDFS的shell(命令行客户端)操作实例

HDFS的shell(命令行客户端)操作实例 3.2 常用命令参数介绍 -help 功能:输出这个命令参数手册 -ls 功能:显示目录信息 示例: hadoop fs ...

- hadoop/hdfs/yarn 详细命令搬运

转载自文章 http://www.cnblogs.com/davidwang456/p/5074108.html 安装完hadoop后,在hadoop的bin目录下有一系列命令: container- ...

- Hadoop文件操作常用命令

1.创建目录 #hdfs dfs -mkidr /test 2.查询目录结构 #hdfs dfs -ls / 子命令 -R递归查看//查看具体的某个目录:例如#hdfs dfs -ls /test 3 ...

- Hadoop HDFS文件常用操作及注意事项(更新)

1.Copy a file from the local file system to HDFS The srcFile variable needs to contain the full name ...

- Hadoop生态圈-Kafka常用命令总结

Hadoop生态圈-Kafka常用命令总结 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.管理Kafka服务的命令 1>.开启kafka服务 [yinzhengjie@s ...

随机推荐

- 初识vue-简单的自定义标签页面

vue3.0比vue2.0简化了许多. 在这里呢就做了一个简单的标签页面.在这当中难免会有些错误,请勿见怪. 1.vue的页面编写,也就是app.vue这个文件作为主入口文件,当然这个主入口文件也可以 ...

- Docker haproxy应用构建 (五)

编写dockerfile from centos-base:v1 MAINTAINER 57674891@qq.com RUN mkdir -p /data/{soft,src,logs,script ...

- 2019 Java开发利器Intellij IDEA安装、配置和使用

进入Intellij IDEA的官网,选择电脑对应的合适版本进行下载,这儿我选择的是Intellij IDEA的社区版,安装旗舰版可去网上找相应的教程. Intellij IDEA的官网:https: ...

- 【MySQL】centos6中/etc/init.d/下没有mysqld启动文件,怎么办

如果/etc/init.d/下面没有mysqld的话,service mysqld start也是不好使的,同样,chkconfig mysqld on也是不能用 解决办法: 将mysql的mysql ...

- 【EXP】Oracle多表导出问题

有些时候,需要导入某个用户的一些相关表.但是不知道用户的用户名和密码.这样就很尴尬 但是如果手上有dba权限的用户的话,就很方便的能导出了 先要知道多表导出的语句 exp system/123456 ...

- 【Oracle】归档日志的删除操作

[root@sha3 oracle]# rman target / Recovery Manager: Release 10.2.0.4.0 - Production on Tue Jan 20 01 ...

- SQL -去重Group by 和Distinct的效率

经实际测试,同等条件下,5千万条数据,Distinct比Group by效率高,但是,这是有条件的,这五千万条数据中不重复的仅仅有三十多万条,这意味着,五千万条中基本都是重复数据. 为了验证,重复数据 ...

- 干货 | 质量保障新手段,携程回归测试平台实践 原创 Sedro 携程技术 2021-01-21

干货 | 质量保障新手段,携程回归测试平台实践 原创 Sedro 携程技术 2021-01-21

- 将ffmpeg编译为wasm版本且在浏览器中运行

2020年大前端技术趋势解读 原创 IMWeb团队 腾讯IMWeb前端团队 5天前

- 苹果 M1 芯片 OpenSSL 性能测试

Apple M1(MacBook Air 2020) type 16 bytes 64 bytes 256 bytes 1024 bytes 8192 bytes md2 0.00 0.00 0.00 ...