论文选读二:Multi-Passage Machine Reading Comprehension with Cross-Passage Answer Verification

论文选读二:Multi-Passage Machine Reading Comprehension with Cross-Passage Answer Verification

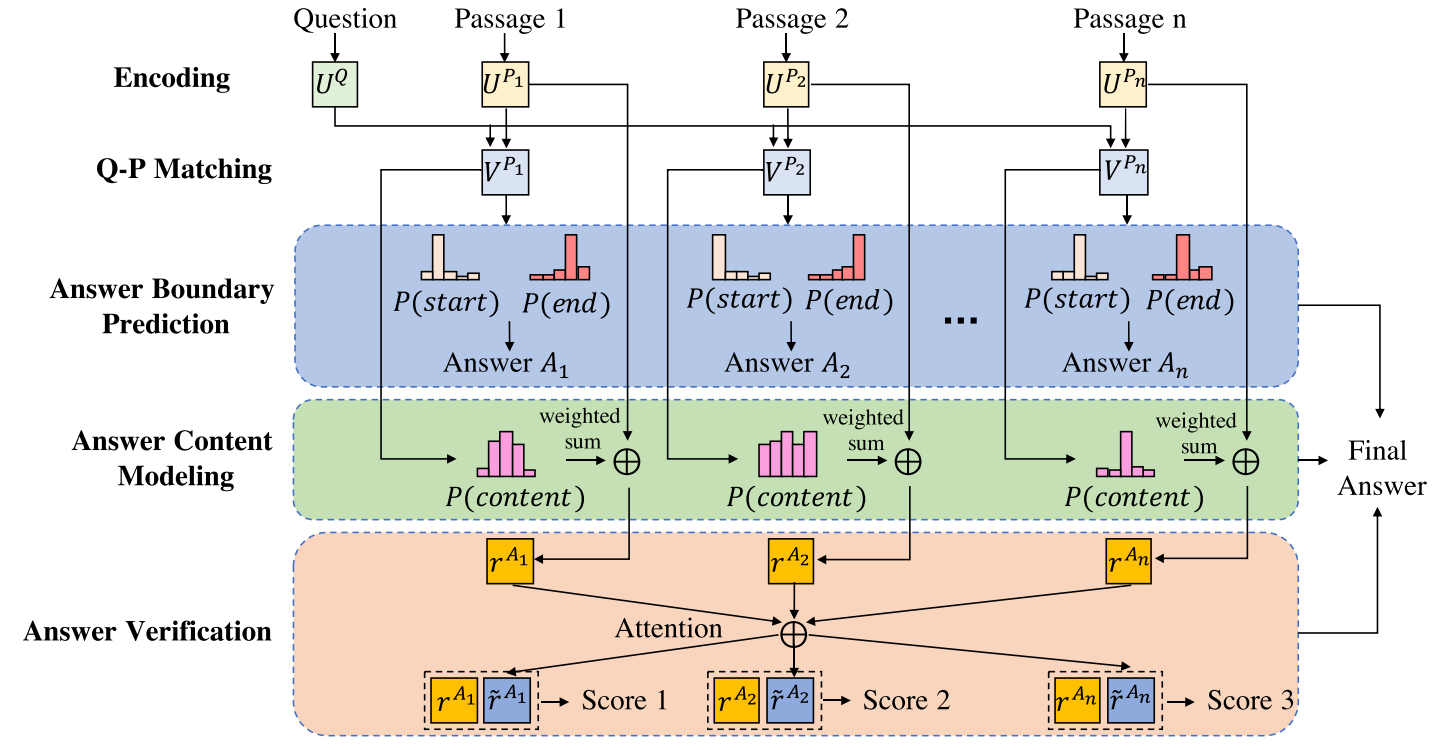

目前,阅读理解通常会给出一段背景资料,据此提出问题,而问题的答案也往往在背景资料里。不过背景资料一般是一篇文章,或者是文章的一个段落。而对于多篇文章,特别是多篇相近文章时,当前的模型效果就不那么明显了。本文即针对此问题提出的解决方案。此文提出的模型包含三个部分:答案提取模块,答案评价模块,与答案交叉验证模块。

本文提出一个假设:问题的正确答案往往会出现在多篇文章中,且有通性,而不正确的答案则通常会与众不同。

(这个场景正对应我们平常在搜索引擎中的搜索。当键入我们想要找的内容,会命中很多内容,而通常其中只有一项是我们真正需要的,因此我们会多个答案对比,从而找到最终想要的。)

本文提出的模型即基于这个假设。当提出一个问题后,有多篇文章命中,或者说针对多篇文章提出一个问题,首先分别在每篇文章中提取回答,即确定候选回答在文章中的位置;其次, 用打分函数对每个答案进行打分,即对每个候选回答的内容进行评价,最后,再对比每个回答,让每个回答相互验证。这三步会共同决定最终的答案。

对于给定的问题Q与对应的文章集\(\{P_i\}\),我们希望找到Q最恰当的答案。

第一个模块:

编码:将所有单词向量化(主要是字符向量和与词向量拼接),然后,用biLSTM处理问题与文章集:

\[

u_t^Q = BiLSTM_Q(u_{t-1}^Q, [e_t^Q, c_t^Q])\\

u_t^{P_i} = BiLSTM_P(u_{t-1}^{P_i},[e_t^{P_i},c_t^{P_i}])

\]

其中\(e_t, c_t\)分别是第t个词的词向量与字符向量,可以看出,每篇文章是单独训练的。

Q-P Matching: 接下来将Q 与Ps联系起来,目前来说,就一定是context-to-question attention layer了。 这里使用的是attention flow layer产生一个混淆矩阵:

\[

S_{t,k} = u_t^{Q^T}\cdot u_k^{P_i}

\]

接下来按 Seo et al的方法得到 c2q attention:

\[

a_t = softmax(S_{t:})\\

\tilde{U}_{:t}^{P_i} = \sum_j a_{tj}\cdot U_{:j}^{P_i}

\]

然后,再经过一biLSTM得到新的内部表示:

\[

v^{P_i}_t = BiLSTM_M(v_{t-1}^{P_i}, \tilde{u}_t^{P_i})

\]

Answer Boundary Prediction: 有了上述的内部表示,第一个模块终于可以给出答案在文章中位置的预测了:

\[

g_k^t = w_1^{aT}\tanh (W_2^a [v_k^P, h_{t-1}^a])\\

\alpha_k^t = \exp(g_k^t)/\sum_{j =1 }^{|P|}\exp(g_j^t)\\

c_t = \sum_{k = 1}^{|P|} a_k^t\cdot v_k^P\\

h_t^a = LSTM(h_{t-1}^a,c_t)

\]

则第一部分的loss:

\[

L_{boundary} =- \frac{1}{N}\sum_{i = 1}^N (\log\alpha_{y_i^1}^1 +\log\alpha_{y_i^2}^2)

\]

其中$y_i^1,y_i^2为第i篇文章的起点与终点。

第二模块:

此模块对上一模块得到的候选答案进行评分,对每个候选答案的每个词判断其是否在应该出现在答案中:

\[

p_k^c = sigmoid(w_1^c ReLU(W_2^2v_k^{P_i}))

\]

此为第k个词出现在答案中的概率。

那损失为:

\[

L_{content} = - \frac{1}{N}\frac{1}{|P|}\sum_{i=1}^N\sum_{j = 1}^{|P|}[y_k^c \log p_k^c + (1 - y_k^c)\log(1 - p_k^c)]

\]

第三模块:

这一模块对所有候选答案进行attention,从而找到最佳答案. 每篇文章的候选答案可以这样表示:

\[

r^{A_i} = \frac{1}{|P_i|} \sum_{k = 1}^{|P_i|}p_k^c[e_k^{P_i},c_k^{P_i}]

\]

应用attention:

\[

\begin{equation}

s_{i,j} = \left\{

\begin{array}{lr}

0, \ \ \ \ if\ \ i = j, & \\

r^{A_i^T}\cdot r^{A_j}, \ \ \ \ otherwise, &

\end{array}

\right.

\end{equation}

\\

\alpha_{i,j} = \exp(s_{i,j})/\sum_{k = 1}^n \exp(s_{i,k})\\

\tilde{r}^{A_i} = \sum_{j = 1}^n \alpha_{i,j}^{A_j}\\

p_i^v = \exp(g_i^v)/ \sum_{j = 1}^n \exp(g_j^v)\\

L_{verify} = -\frac{1}{N}\sum_{i = 1}^N\log p_{y_i^v}^v

\]

最后,整个模型的损失:

\[

L = L_{boundary} + \beta_1 L_{content} + \beta_2 L_{verify}

\]

其中\(\beta_1, \beta_2\)为超参。

评:

本文对多篇文章的阅读理解,使用attention的方式选择是最优答案,是一个不错的思路。

论文选读二:Multi-Passage Machine Reading Comprehension with Cross-Passage Answer Verification的更多相关文章

- 机器阅读理解综述Neural Machine Reading Comprehension Methods and Trends(略读笔记)

标题:Neural Machine Reading Comprehension: Methods and Trends 作者:Shanshan Liu, Xin Zhang, Sheng Zhang, ...

- Attention-over-Attention Neural Networks for Reading Comprehension论文总结

Attention-over-Attention Neural Networks for Reading Comprehension 论文地址:https://arxiv.org/pdf/1607.0 ...

- Cognitive Graph for Multi-Hop Reading Comprehension at Scale(ACL2019) 阅读笔记与源码解析

论文地址为:Cognitive Graph for Multi-Hop Reading Comprehension at Scale github地址:CogQA 背景 假设你手边有一个维基百科的搜索 ...

- HDU4990 Reading comprehension —— 递推、矩阵快速幂

题目链接:https://vjudge.net/problem/HDU-4990 Reading comprehension Time Limit: 2000/1000 MS (Java/Others ...

- hdu-4990 Reading comprehension(快速幂+乘法逆元)

题目链接: Reading comprehension Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 32768/32768 K ( ...

- 【LaTeX排版】LaTeX论文排版<二>

1.目录的生成 直接使用命令\tableofcontents即可.其默认格式如下: 我们会发现,这样的格式不一定是我们所期望的.比如说,我们也希望章标题与页码之间也有点连线,并且也希望将致谢. ...

- 机器学习---逻辑回归(二)(Machine Learning Logistic Regression II)

在<机器学习---逻辑回归(一)(Machine Learning Logistic Regression I)>一文中,我们讨论了如何用逻辑回归解决二分类问题以及逻辑回归算法的本质.现在 ...

- hdu 4990 Reading comprehension 二分 + 快速幂

Description Read the program below carefully then answer the question. #pragma comment(linker, " ...

- 转:Google论文之二----Google文件系统(GFS)翻译学习

文章来自于:http://www.cnblogs.com/geekma/archive/2013/06/09/3128372.html 摘要 我们设计并实现了Google文件系统,它是一个可扩展的分布 ...

随机推荐

- layer —— 一个简单的jQuery弹出层插件

layer的使用 4.24更新:注意:layer现在有旧版1.8.5版本和新版本3.0版本的,对应引入的JQ也要不同,相对应的JQ引入1.1和3.1,否则JQ会出问题 4.21更新: 解答4-19的问 ...

- cookie和sission的原理及异同

Cookie Cookie是存储在客户机的文本文件,它们保存了大量轨迹信息.在servlet技术基础上,JSP显然能够提供对HTTP cookie的支持. 通常有三个步骤来识别回头客: 服务器脚本发送 ...

- Linux基础命令---sar显示系统活动信息

sar sar指令用来收集.报告.保存系统的活动信息.sar命令将操作系统中选定的累积活动计数器的内容写入标准输出.会计系统根据参数“interval”.“count”中的值,写入以秒为单位的指定间隔 ...

- rabbitMq及安装、fanout交换机-分发(发布/订阅)

<dependency> <groupId>com.rabbitmq</groupId> <artifactId& ...

- Jmeter上传附件EXCEL

1.通过对上传附件接口进行抓包,获取的信息如下: 2.在jmeter脚本中添加http请求,并添加http请求头信息如下: 3.在http请求中添加上传附件的内容如下,由于我上传的是excel,所以M ...

- POI兴趣点搜索 - 地理信息系统(6)

(2017-08-13 银河统计) POI(Point of Interest),中文可以翻译为"兴趣点",兴趣点(POI)是地理信息系统中的一个术语,泛指一切可以抽象为点的地理对 ...

- php伪造ip头

<? $fp = fsockopen ("passport.baidu.com", 80, $errno, $errstr, 30); if (!$fp) { echo &q ...

- 16: vue + crypto-js + python前后端加密解密

1.1 vue中使用crypto-js进行AES加密解密 参考博客:https://www.cnblogs.com/qixidi/p/10137935.html 1.初始化vue项目 vue i ...

- 字符和字符串在Java中的旅程

以下是个人对java中字符和字符串的见解,如有疏漏之处,还请不吝赐教. 下面通过一个简单的程序来说明字符和字符串在Java中的旅程. 以字符 ' 中 '为例, 它的GBK编码是2个字节:0xd6d0, ...

- day11函数的参数,函数对象 - 函数名,函数的嵌套调用

复习 # 什么是函数:具体特定功能的代码块 - 特定功能代码块作为一个整体,并给该整体命名,就是函数 # 函数的优点: # 1.减少代码的冗余 # 2.结构清晰,可读性强 # 3.具有复用性,开发效率 ...