007 爬虫(Scrapy库的使用)

推荐网址:

http://scrapy-chs.readthedocs.io/zh_CN/0.24/topics/architecture.html

1.简介

python开发的一个快速,高层次的屏幕抓去和web抓取框架,用于抓取web站点并从网页中提取结构化的数据。

是一个框架,可以根据需要进行修改。

提供了多种类型爬虫的基类,如BaseSpider,sitemap爬虫等。

2.框架

3.Scrapy的运行流程

引擎从调度器中取出一个链接用于接下来的抓取

引擎把url封装成一个请求传给下载器

下载器把资源下载下来,并封装成应答包

爬虫解析response

解析出实体Item,则交给实体管道进行进一步的处理

解析出的是链接,则把url交给调度器等待抓取。

二:安装

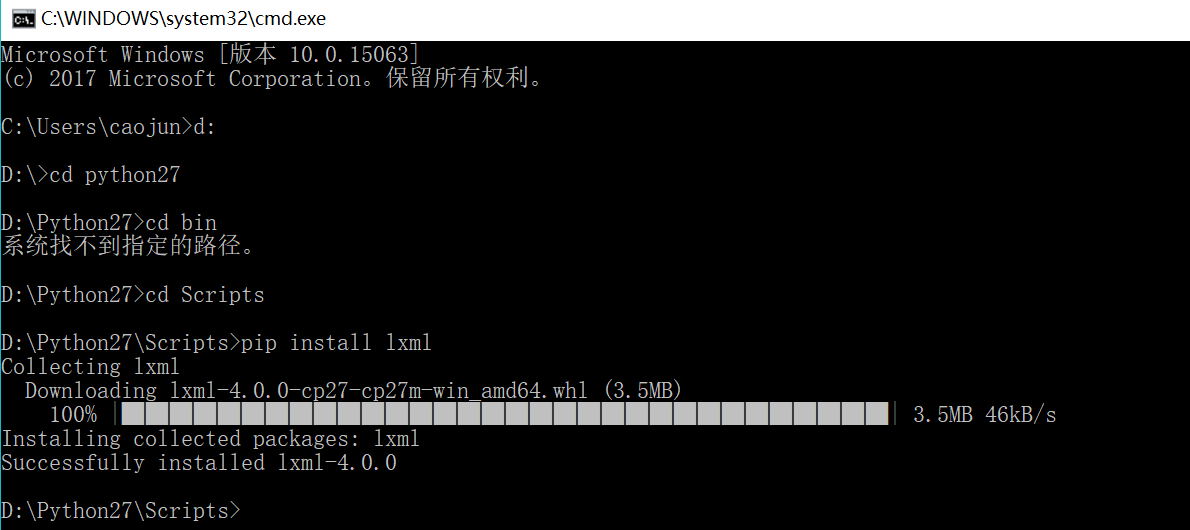

1.第一步安装lxml

lxml是一个非常有用的python库,可以灵活高校的解析xml,与bs,requests相结合,是编写爬虫的标准姿势。

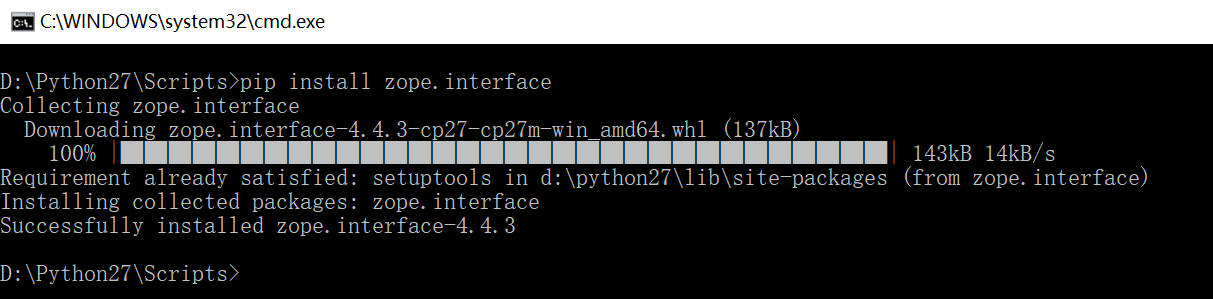

2.第二步安装zope.interface

python支持多继承,但是不支持接口,zope.interface是其三方的接口实现库,在twisted中有大量的使用

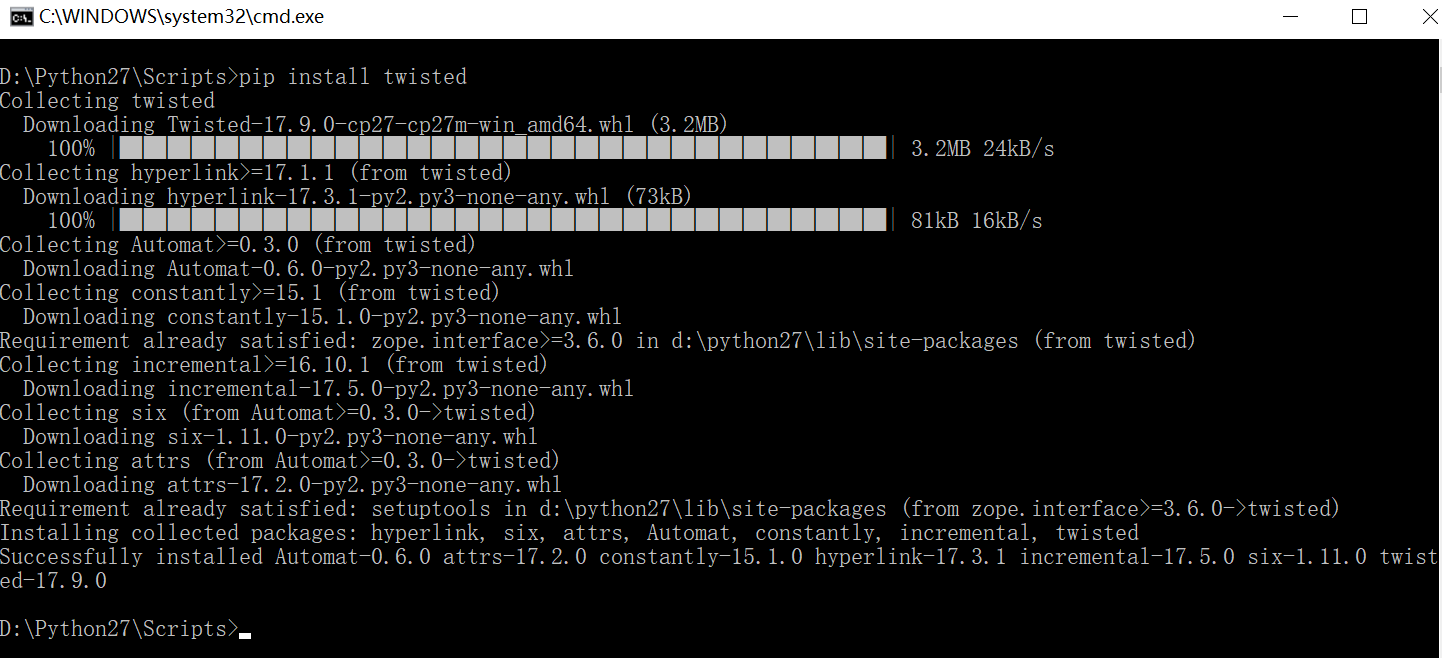

3.第三步安装twisted

twisted是python实现的基于事件驱动的网络引擎框架。

支持很多框架,包括UDP,TCP,TLS和其他应用层协议(http,smtp,nntm,irc,xmpp等)

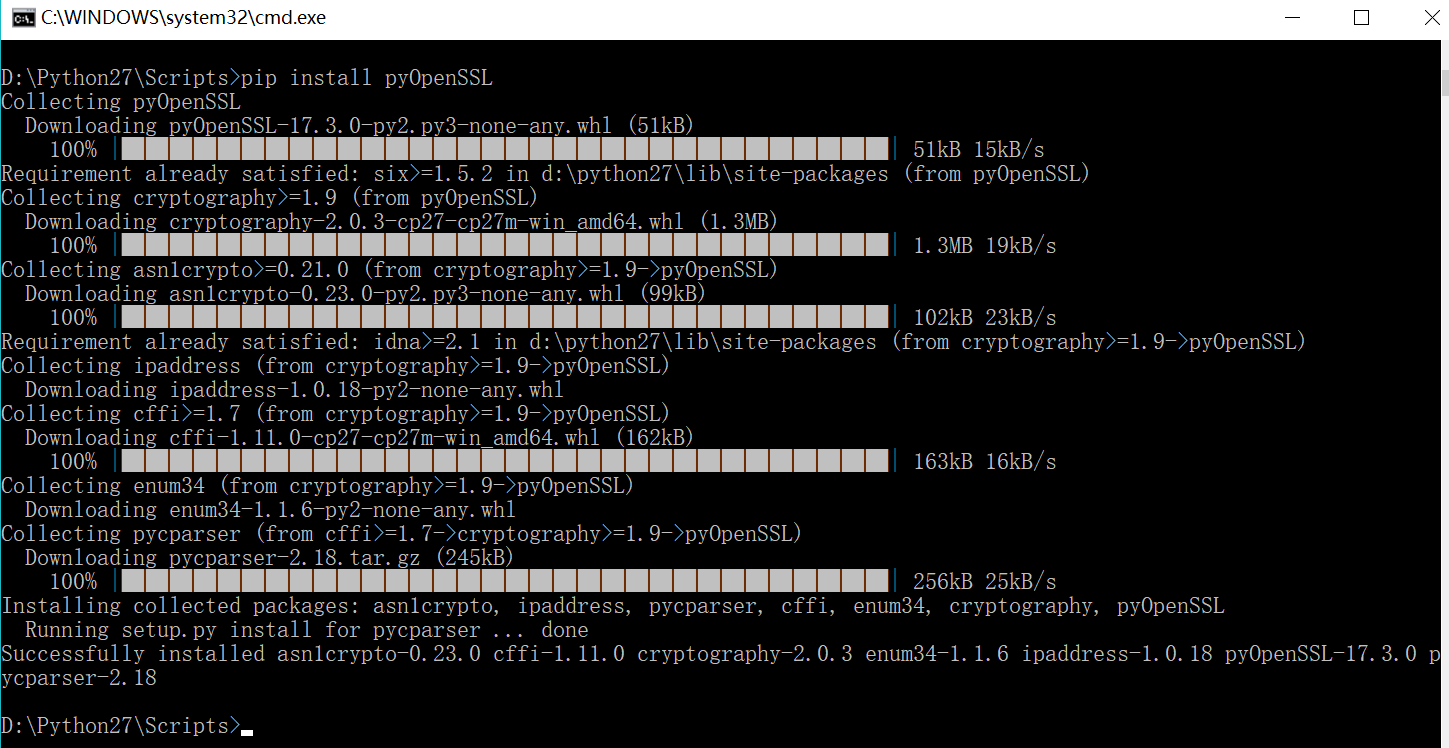

4.第四步安装pyOpenSSL

生成网络安全需要的CA和证书

5.第五步pywin32

pywin32是一个python库,为python访问windows API的扩展,提供了齐全的windows常量,接口,线程以及com机制等

下载地址:

https://sourceforge.net/projects/pywin32/files/pywin32/

双击安装

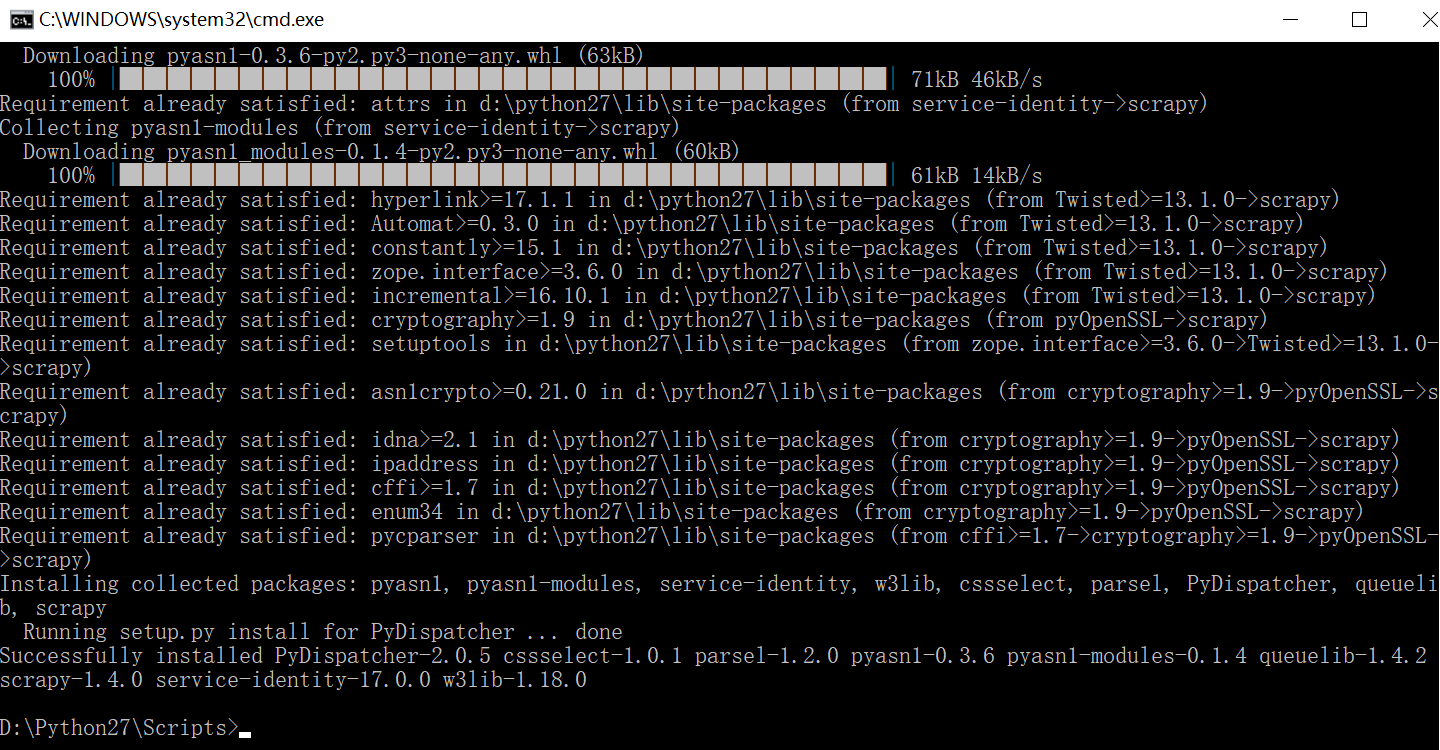

6.安装Scrapy

scrapy不同简单的单线爬虫,采用scrapy框架写python会生成许多的文件,这一件类似java里的web框架,许多工作可以通过配置文件来生成。

pip install scrapy

三:生成项目

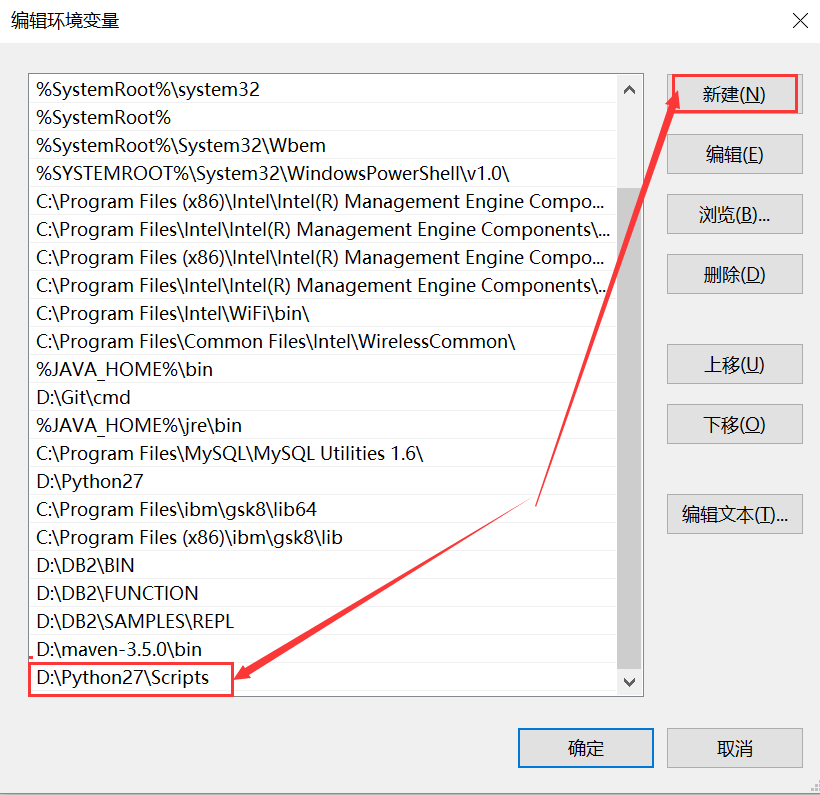

1.添加系统变量

使得scrapy.exe可以被访问到。

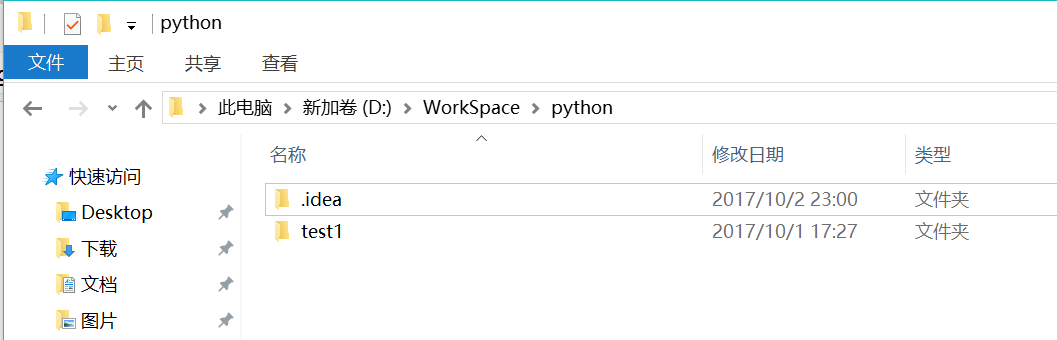

2.找到要生成项目的目录

3.从cmd中进入这个目录

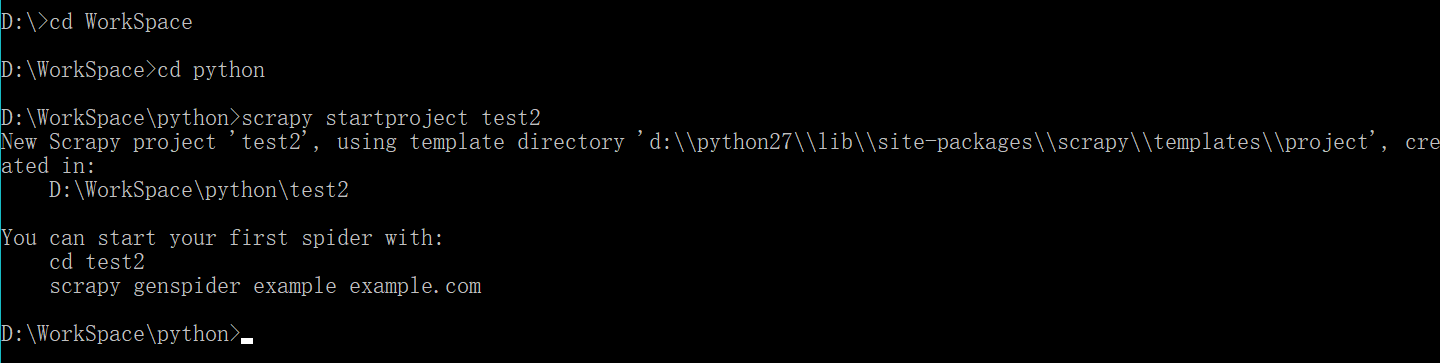

4.在这里执行语句

scrapy startproject test2

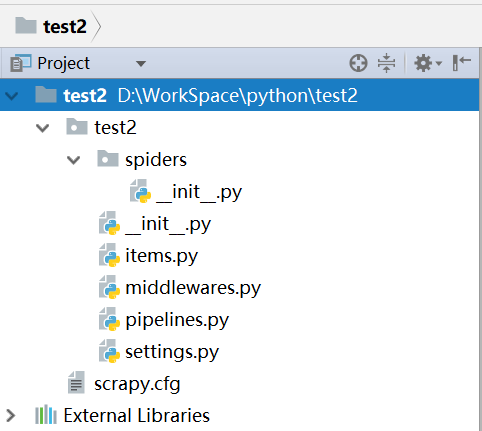

5.如图

四:制作爬虫

1.完成爬虫的流程

新建项目

明确目标

制作爬虫

存储内容

2.新建项目的目录结构

3.解释文件的作用

scrapy.cfg:项目的配置文件

test2/:项目中的python模块,将会从这里引用代码

items.py:项目中items文件用来存放抓取内容容器的文件

pipelines.py:负责处理爬虫从网页中抽取的实体,持久化实体,验证实体的有效性,清除不需要的信息

settings.py:项目的设置文件

spiders:爬虫的目录

4.定义Item

是用来保存爬取到的数据的容器,

创建一个scrapy.Item类,并定义类型为scrapy.Field类属性来定义一个Item。

将爬取的内容与Field()定义的属性对应。

程序:

# -*- coding: utf-8 -*-

from scrapy import Item,Field class Test2Item(Item):

#电影名

title=Field()

#评分

start=Field()

#评分人数

critical=Field()

#短评

quote=Field()

5.编写Spiders

创建继承了scrapy.Spider的子类,并定义以下三个属性:

name:用于区别spider

start_urls:包含了spider在启动时进行爬取的url列表

parse():是spider的一个方法,每个初始url完成下载后生成的response对象将会作为唯一的参数传递给该函数,该方法负责解析返回的数据,提取数据以及需要进一步处理的url的request对象。

程序:

# -*- coding: utf-8 -*-

#下面三行解决的是编码问题。python3不会出现

import sys

reload(sys)

sys.setdefaultencoding('utf-8') from scrapy.spiders import CrawlSpider

from scrapy.http import Request

from scrapy.selector import Selector

from test2.items import Test2Item

import re #继承scrapy.spiders

class Doban(CrawlSpider):

name = "douban"

start_urls=['http://movie.douban.com/top250']

url='http://movie.douban.com/top250'

def parse(self, response):

item=Test2Item()

selector=Selector(response)

Movies=selector.xpath('//div[@class="info"]')

for eachMovie in Movies:

#获取各个字段

fullTitle=eachMovie.xpath('div[@class="hd"]/a/span[@class="title"][1]/text()').extract() start=eachMovie.xpath('div[@class="bd"]/div/span[@class="rating_num"]/text()').extract() criticalStr=eachMovie.xpath('div[@class="bd"]/div/span[4]/text()').extract()[0]

critical= filter(str.isdigit,str(criticalStr)) quote=eachMovie.xpath('div[@class="bd"]/p[@class="quote"]/span/text()').extract() if quote:

quote=quote[0]

else:

quote='' #赋值

item['title']=fullTitle

item['start']=start

item['critical']=critical

item['quote']=quote #提交

yield item

nextLink=selector.xpath('//span[@class="next"]/link/@href').extract()

if nextLink:

nextLink=nextLink[0]

print nextLink

yield Request(self.url+nextLink,callback=self.parse)

return

6.修改settings.py

USER_AGENT ='Mozilla/5.0 (Macintosh:Intel Mac OS X 10_8_3)' \

'AppleWebKit/536.5 (KHTML, like Gecko) Chrome/19.0.1084.54 Safari/536.5' FEED_URI=u'file:///D:/WorkSpace/python/test2/doban.csv'

FEED_FORMAT='CSV'

7.添加主函数运行

# -*- coding: utf-8 -*-

from scrapy import cmdline

cmdline.execute("scrapy crawl douban".split())

8.运行结果

007 爬虫(Scrapy库的使用)的更多相关文章

- python3 爬虫 Scrapy库学习1

1生成项目:生成项目文件夹 scrapy startproject 项目名 2生成爬虫文件 scrapy genspider 爬虫名 指定域名 3进入items文件可以输入自己想要爬取的内容比如 te ...

- python爬虫scrapy框架——人工识别登录知乎倒立文字验证码和数字英文验证码(2)

操作环境:python3 在上一文中python爬虫scrapy框架--人工识别知乎登录知乎倒立文字验证码和数字英文验证码(1)我们已经介绍了用Requests库来登录知乎,本文如果看不懂可以先看之前 ...

- [python爬虫]Requests-BeautifulSoup-Re库方案--robots协议与Requests库实战

[根据北京理工大学嵩天老师“Python网络爬虫与信息提取”慕课课程编写 慕课链接:https://www.icourse163.org/learn/BIT-1001870001?tid=100223 ...

- Python 爬虫-Scrapy爬虫框架

2017-07-29 17:50:29 Scrapy是一个快速功能强大的网络爬虫框架. Scrapy不是一个函数功能库,而是一个爬虫框架.爬虫框架是实现爬虫功能的一个软件结构和功能组件集合.爬虫框架是 ...

- Scrapy库安装和项目创建

Scrapy是一个流行的网络爬虫框架,从现在起将陆续记录Python3.6下Scrapy整个学习过程,方便后续补充和学习.本文主要介绍scrapy安装.项目创建和测试基本命令操作 scrapy库安装 ...

- Python网咯爬虫 — Scrapy框架应用

Scrapy框架 Scrapy是一个高级的爬虫框架,它不仅包括了爬虫的特征,还可以方便地将爬虫数据保存到CSV.Json等文件中. Scrapy用途广泛,可以用于数据挖掘.监测 ...

- [爬虫] requests库

requests库的7个常用方法 requests.request() 构造一个请求,支撑以下各种方法的基础方法 requests.get() 获取HTML网页的主要方法,对应于HTTP的GET re ...

- <scrapy爬虫>scrapy命令行操作

1.mysql数据库 2.mongoDB数据库 3.redis数据库 1.创建项目 scrapy startproject myproject cd myproject 2.创建爬虫 scrapy g ...

- 安装python爬虫scrapy踩过的那些坑和编程外的思考

这些天应朋友的要求抓取某个论坛帖子的信息,网上搜索了一下开源的爬虫资料,看了许多对于开源爬虫的比较发现开源爬虫scrapy比较好用.但是以前一直用的java和php,对python不熟悉,于是花一天时 ...

- 网页爬虫--scrapy入门

本篇从实际出发,展示如何用网页爬虫.并介绍一个流行的爬虫框架~ 1. 网页爬虫的过程 所谓网页爬虫,就是模拟浏览器的行为访问网站,从而获得网页信息的程序.正因为是程序,所以获得网页的速度可以轻易超过单 ...

随机推荐

- java.lang.NoClassDefFoundError: org/hibernate/service/ServiceRegistry] 类似问题

使用Hibernate时出现以上错误,在Java Project中运行无误,但是来到Dynamic Web Project中却出现了如下错误: hibernate 报错:java.lang.NoCla ...

- NOIP2016 组合数问题

https://www.luogu.org/problem/show?pid=2822 题目描述 组合数表示的是从n个物品中选出m个物品的方案数.举个例子,从(1,2,3) 三个物品中选择两个物品可以 ...

- Linux装机利器Cobbler安装配置

Linux装机利器Cobbler安装配置 2011-05-27 15:31:05 分类: LINUX 一.安装环境 centos 5.4 关掉iptables 关掉 selinux selinux ...

- springcloud入门系列(二):注册中心Eureka

搭建注册中心Eureka 1.pom中依赖 <dependencies> <dependency> <groupId>org.springframework.clo ...

- kafka入门(3)- SpringBoot集成Kafka

1.引入依赖 <dependency> <groupId>org.springframework.kafka</groupId> <artifactId> ...

- ASP.NET 前台Javascript调用后台代码 / 后台调用前台Javascript

1:ASP.NET 前台Javascript调用后台代码 1.1:前台Javascript <script> function CallCs() { var str = "< ...

- 关于Java的“找不到或无法加载主类”

Java编程思想4th第六章的关于访问权限和包的笔记总结时遇到了一个关于package命名及导入的问题. 环境:Ubuntu 16.04.3 LTS x86_64 首先,我要安装部署Java的开发环境 ...

- UNIX环境高级编程 第5章 标准I/O库

本章是关于C语言标准I/O库的,之所以在UNIX类系统的编程中会介绍C语言标准库,主要是因为UNIX和C之间具有密不可分的关系.由于UNIX系统存在很多实现,而每个实现都有自己的标准I/O库,为了统一 ...

- 20155303 《Java程序设计》实验一(Java开发环境的熟悉)实验报告

20155303 <Java程序设计>实验一(Java开发环境的熟悉)实验报告 一.实验内容及步骤 (一)使用JDK编译.运行简单的java程序 命令行下的程序开发 步骤一(新建文件夹): ...

- http、https 等 常用默认端口号

⑴. HTTP协议代理服务器常用端口号:80/8080/3128/8081/9080⑵. SOCKS代理协议服务器常用端口号:1080⑶. FTP(文件传输)协议代理服务器常用端口号:21⑷. Tel ...