Hadoop概念学习系列之Java调用Shell命令和脚本,致力于hadoop/spark集群(三十六)

前言

说明的是,本博文,是在以下的博文基础上,立足于它们,致力于我的大数据领域!

http://kongcodecenter.iteye.com/blog/1231177

http://blog.csdn.net/u010376788/article/details/51337312

http://blog.csdn.net/arkblue/article/details/7897396

第一种:普通做法

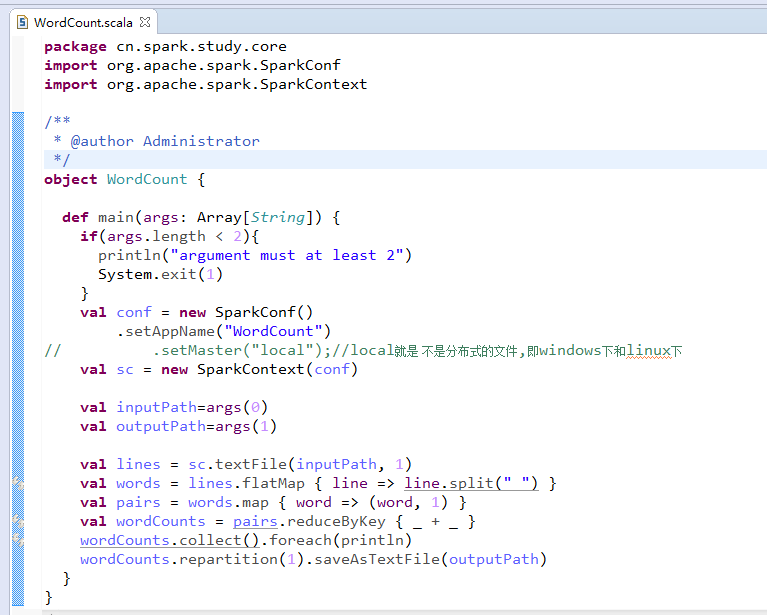

首先,编号写WordCount.scala程序。

然后,打成jar包,命名为WC.jar。比如,我这里,是导出到windows桌面。

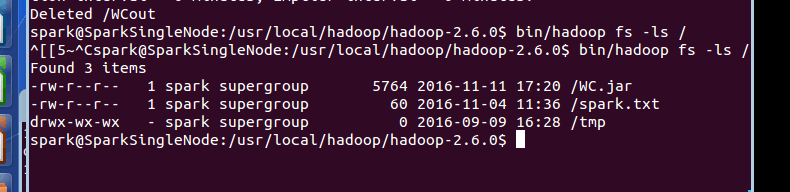

其次,上传到linux的桌面,再移动到hdfs的/目录。

最后,在spark安装目录的bin下,执行

spark-submit \

> --class cn.spark.study.core.WordCount \

> --master local[1] \

> /home/spark/Desktop/WC.jar \

> hdfs://SparkSingleNode:9000/spark.txt \

> hdfs://SparkSingleNode:9000/WCout

第二种:高级做法

有时候我们在Linux中运行Java程序时,需要调用一些Shell命令和脚本。而Runtime.getRuntime().exec()方法给我们提供了这个功能,而且Runtime.getRuntime()给我们提供了以下几种exec()方法:

不多说,直接进入。

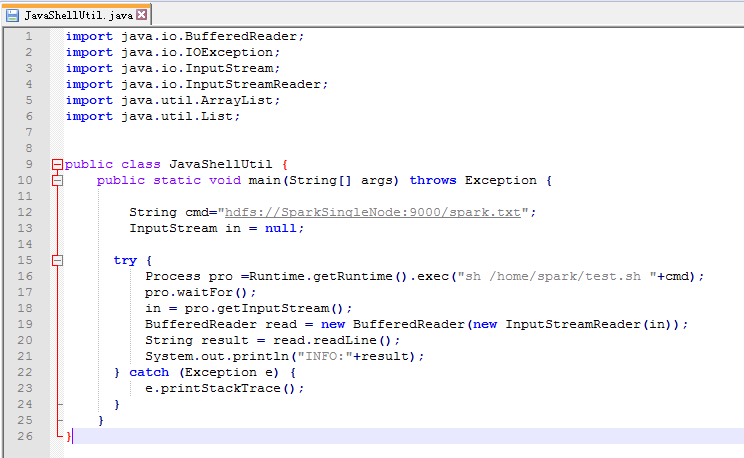

步骤一: 为了规范起见,命名为JavaShellUtil.java。在本地里写好

import java.io.BufferedReader;

import java.io.IOException;

import java.io.InputStream;

import java.io.InputStreamReader;

import java.util.ArrayList;

import java.util.List;

public class JavaShellUtil {

public static void main(String[] args) throws Exception {

String cmd="hdfs://SparkSingleNode:9000/spark.txt";

InputStream in = null;

try {

Process pro =Runtime.getRuntime().exec("sh /home/spark/test.sh "+cmd);

pro.waitFor();

in = pro.getInputStream();

BufferedReader read = new BufferedReader(new InputStreamReader(in));

String result = read.readLine();

System.out.println("INFO:"+result);

} catch (Exception e) {

e.printStackTrace();

}

}

}

package cn.spark.study.core

import org.apache.spark.SparkConf

import org.apache.spark.SparkContext

/**

* @author Administrator

*/

object WordCount {

def main(args: Array[String]) {

if(args.length < 2){

println("argument must at least 2")

System.exit(1)

}

val conf = new SparkConf()

.setAppName("WordCount")

// .setMaster("local");//local就是 不是分布式的文件,即windows下和linux下

val sc = new SparkContext(conf)

val inputPath=args(0)

val outputPath=args(1)

val lines = sc.textFile(inputPath, 1)

val words = lines.flatMap { line => line.split(" ") }

val pairs = words.map { word => (word, 1) }

val wordCounts = pairs.reduceByKey { _ + _ }

wordCounts.collect().foreach(println)

wordCounts.repartition(1).saveAsTextFile(outputPath)

}

}

步骤二:编写好test.sh脚本

spark@SparkSingleNode:~$ cat test.sh

#!/bin/sh

/usr/local/spark/spark-1.5.2-bin-hadoop2.6/bin/spark-submit \

--class cn.spark.study.core.WordCount \

--master local[1] \

/home/spark/Desktop/WC.jar \

$1 hdfs://SparkSingleNode:9000/WCout

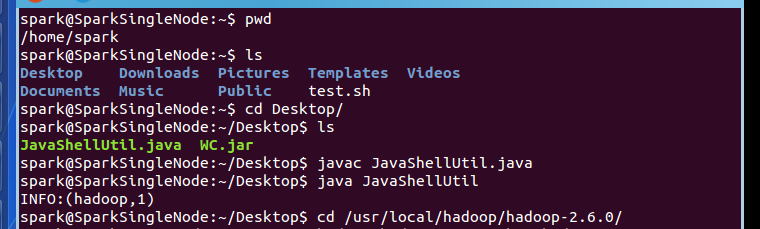

步骤三:上传JavaShellUtil.java,和打包好的WC.jar

spark@SparkSingleNode:~$ pwd

/home/spark

spark@SparkSingleNode:~$ ls

Desktop Downloads Pictures Templates Videos

Documents Music Public test.sh

spark@SparkSingleNode:~$ cd Desktop/

spark@SparkSingleNode:~/Desktop$ ls

JavaShellUtil.java WC.jar

spark@SparkSingleNode:~/Desktop$ javac JavaShellUtil.java

spark@SparkSingleNode:~/Desktop$ java JavaShellUtil

INFO:(hadoop,1)

spark@SparkSingleNode:~/Desktop$ cd /usr/local/hadoop/hadoop-2.6.0/

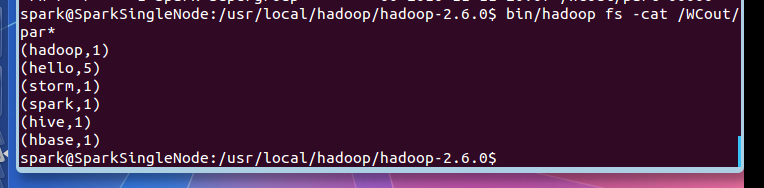

步骤四:查看输出结果

spark@SparkSingleNode:/usr/local/hadoop/hadoop-2.6.0$ bin/hadoop fs -cat /WCout/par*

(hadoop,1)

(hello,5)

(storm,1)

(spark,1)

(hive,1)

(hbase,1)

spark@SparkSingleNode:/usr/local/hadoop/hadoop-2.6.0$

成功!

关于

Shell 传递参数

见

http://www.runoob.com/linux/linux-shell-passing-arguments.html

最后说的是,不局限于此,可以穿插在以后我们生产业务里的。作为调用它即可,非常实用!

Hadoop概念学习系列之Java调用Shell命令和脚本,致力于hadoop/spark集群(三十六)的更多相关文章

- java基础/java调用shell命令和脚本

一.项目需求: 从某一机构获取证书,证书机构提供小工具,执行.sh脚本即可启动服务,本地调用该服务即可获取证书. 问题:linux服务器启动该服务,不能关闭.一旦关闭,服务即停止. 解决方案:java ...

- java调用shell命令及脚本

shell脚本在处理文本及管理操作系统时强大且简单,将shell脚本结合到应用程序中则是一种快速实现的不错途径本文介绍使用java代码调用并执行shell 我在 -/bin/ 目录下写了jbossLo ...

- shell 脚本实战笔记(10)--spark集群脚本片段念念碎

前言: 通过对spark集群脚本的研读, 对一些重要的shell脚本技巧, 做下笔记. *). 取当前脚本的目录 sbin=`dirname "$0"` sbin=`cd &quo ...

- Java 调用 Shell 命令

近日项目中有这样一个需求:系统中的外币资金调度完成以后,要将调度信息生成一个Txt文件,然后将这个Txt文件发送到另外一个系统(Kondor)中.生成文件自然使用OutputStreamWirter了 ...

- Hadoop Hive概念学习系列之hive里的扩展接口(CLI、Beeline、JDBC)(十六)

<Spark最佳实战 陈欢>写的这本书,关于此知识点,非常好,在94页. hive里的扩展接口,主要包括CLI(控制命令行接口).Beeline和JDBC等方式访问Hive. CLI和B ...

- java 调用shell命令

原文:http://kongcodecenter.iteye.com/blog/1231177 Java通过SSH2协议执行远程Shell脚本(ganymed-ssh2-build210.jar) ...

- java 执行shell命令遇到的坑

正常来说java调用shell命令就是用 String[] cmdAry = new String[]{"/bin/bash","-c",cmd} Runtim ...

- Hadoop概念学习系列之Hadoop新手学习指导之入门需知(二十)

不多说,直接上干货! 零基础学习hadoop,没有想象的那么困难,也没有想象的那么容易.从一开始什么都不懂,到能够搭建集群,开发.整个过程,只要有Linux基础,虚拟机化和java基础,其实hadoo ...

- [转载]JAVA调用Shell脚本

FROM:http://blog.csdn.net/jj12345jj198999/article/details/11891701 在实际项目中,JAVA有时候需要调用C写出来的东西,除了JNI以外 ...

随机推荐

- windows server 2008 R2 部署NFS,实现多台服务器间、客户端间的共享目录。

如何通过Windows Server 2008 R2建立NFS存储服务? 通过Windows Server 2008 R2,我们可以很容易地将其作为一台NFS存储服务器,得到一个NFS软存储,轻松解决 ...

- SpringMvc和Mybatis整合总结

1.先配置mybatis,测试读取数据库 2.自己测试数据 3.配置spring和springmvc, PS:配置web.xml,这样就不用getBean了 4.配置Controller 5.前后台交 ...

- C++编译器报错汇总

1.error: ‘Person’ was not declared in this scope(1)若是一个类或函数的命名空间对使用者不可见(2)成员(静态)函数没有通过对象名或类名进行调用(3)虽 ...

- Linux期末复习题

版权声明: https://blog.csdn.net/u014483914/article/details/36622451 1.More和less命令的差别 More命令通经常使用 ...

- Spring事务管理机制的实现原理-动态代理

之前在做项目中遇到spring无法进行事务代理问题,最后发现是因为没有写接口,原因当时明白了,看到这篇文章写的清楚些,转过来 我们先来分析一下Spring事务管理机制的实现原理.由于Spring内置A ...

- MySQL管理实务处理

事物处理可以用来维护数据库的完整性,它保证成批的MySQL操作要么完全执行,要么全不执行. 事务:指一组sql语句 回退:指撤销指定的sql语句过程 提交:将未存储的sql语句结果写入数据库表 保留点 ...

- mongodb之 非正常关闭启动报错处理

Mongodb如果非正常关闭,直接启动会报错.查看日志文件. 处理: 需要做的是删除mongod.lock和WiredTiger.lock这两个lock文件,然后执行--repair,这里的mongo ...

- oauth 2.0 授权流程图

1.授权码模式(authorization code) 7 步 后面 拿到授权码以后,就是向 资源服务器请求资源了. 2.简化模式(implicit): 在上面的第4 步的返回中,已经包含了 acc ...

- dockerfile创建php容器(安装memcached、redis、gd、xdebug扩展)

dockerfile创建php容器(含有memcached.redis.gd.xdebug扩展) 代码如下: FROM php:7.2-fpm COPY redis-3.1.6.tgz /home/r ...

- Qt中的主窗口之菜单栏

1.Qt中的主窗口 主窗口为建立应用程序用户界面提供了一个框架 Qt开发平台中直接支持主窗口的概念 QMainWindow是Qt中主窗口的基类 QMainWindow继承于QWidget是一种容器类型 ...