deep_learning_Function_softmax_cross_entropy_with_logits

【TensorFlow】tf.nn.softmax_cross_entropy_with_logits的用法

在计算loss的时候,最常见的一句话就是tf.nn.softmax_cross_entropy_with_logits,那么它到底是怎么做的呢?

首先明确一点,loss是代价值,也就是我们要最小化的值

tf.nn.softmax_cross_entropy_with_logits(logits, labels, name=None)

除去name参数用以指定该操作的name,与方法有关的一共两个参数:

第一个参数logits:就是神经网络最后一层的输出,如果有batch的话,它的大小就是[batchsize,num_classes],单样本的话,大小就是num_classes

第二个参数labels:实际的标签,大小同上

具体的执行流程大概分为两步:

第一步是先对网络最后一层的输出做一个softmax,这一步通常是求取输出属于某一类的概率,对于单样本而言,输出就是一个num_classes

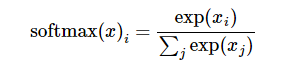

softmax的公式是:

至于为什么是用的这个公式?这里不介绍了,涉及到比较多的理论证明

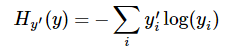

第二步是softmax的输出向量[Y1,Y2,Y3...]和样本的实际标签做一个交叉熵,公式如下:

其中 指代实际的标签中第i个的值(用mnist数据举例,如果是3,那么标签是[0,0,0,1,0,0,0,0,0,0],除了第4个值为1,其他全为0)

指代实际的标签中第i个的值(用mnist数据举例,如果是3,那么标签是[0,0,0,1,0,0,0,0,0,0],除了第4个值为1,其他全为0)

就是

就是softmax的输出向量[Y1,Y2,Y3...]

显而易见,预测

越准确,结果的值越小(别忘了前面还有负号),最后求一个平均,得到我们想要的loss

注意!!!这个函数的返回值并不是一个数,而是一个向量,如果要求交叉熵,我们要再做一步tf.reduce_sum操作,就是对向量里面所有元素求和,最后才得到 ,如果求loss,则要做一步

,如果求loss,则要做一步tf.reduce_mean操作,对向量求均值!

理论讲完了,上代码

- import tensorflow as tf

- #our NN's output

- logits=tf.constant([[1.0,2.0,3.0],[1.0,2.0,3.0],[1.0,2.0,3.0]])

- #step1:do softmax

- y=tf.nn.softmax(logits)

- #true label

- y_=tf.constant([[0.0,0.0,1.0],[0.0,0.0,1.0],[0.0,0.0,1.0]])

- #step2:do cross_entropy

- cross_entropy = -tf.reduce_sum(y_*tf.log(y))

- #do cross_entropy just one step

- cross_entropy2=tf.reduce_sum(tf.nn.softmax_cross_entropy_with_logits(logits, y_))#dont forget tf.reduce_sum()!!

- with tf.Session() as sess:

- softmax=sess.run(y)

- c_e = sess.run(cross_entropy)

- c_e2 = sess.run(cross_entropy2)

- print("step1:softmax result=")

- print(softmax)

- print("step2:cross_entropy result=")

- print(c_e)

- print("Function(softmax_cross_entropy_with_logits) result=")

- print(c_e2)

输出结果是:

- step1:softmax result=

- [[ 0.09003057 0.24472848 0.66524094]

- [ 0.09003057 0.24472848 0.66524094]

- [ 0.09003057 0.24472848 0.66524094]]

- step2:cross_entropy result=

- 1.22282

- Function(softmax_cross_entropy_with_logits) result=

- 1.2228

最后大家可以试试e^1/(e^1+e^2+e^3)是不是0.09003057,发现确实一样!!这也证明了我们的输出是符合公式逻辑的

deep_learning_Function_softmax_cross_entropy_with_logits的更多相关文章

随机推荐

- Unity和Mef的比较

1:Mef和Untiy都支持依赖注入 2:Mef支持插件的机制 3:Mef在写法上更简单灵活 4:Mef在宏观上比Unity更加庞大 5:Mef不支持Aop的切入拦截,Unity支持

- git备份代码

仓库备份位置: /huawei-bak vim /huawei-bak/huawei-bak.sh #!/bin/bash#项目克隆下来后将其注释即可PROJECT="git@codehub ...

- Eclipse常用快捷方式

Suggestions (Ctrl+1) 建议,比如创建局部变量 File Search (Ctrl+H) 在所有文件中查找关键字 Open Resource (Ctrl+Shift+R) 打开资源 ...

- 如何在WIN7下安装虚拟机linux系统

需要支持多个平台的IT管理员经常会遇到如何在Windows 7计算机上安装Linux的问题.幸运的是有多种方法可供选择:双系统.Linux虚拟机和U盘引导. 当需要用到Windows 7和Linux时 ...

- 解决 nw 报错 net::ERR_UNSAFE_PORT

今天 nw 应用里面的前端请求突然不发送了,也没有异常的信息,后来换上开发版 nw 立刻就发现了报错: net::ERR_UNSAFE_PORT 这个错误的意思很明显,就是请求的 http 端 ...

- C++类中的一些细节(重载、重写、覆盖、隐藏,构造函数、析构函数、拷贝构造函数、赋值函数在继承时的一些问题)

1 函数的重载.重写(重定义).函数覆盖及隐藏 其实函数重载与函数重写.函数覆盖和函数隐藏不是一个层面上的概念.前者是同一个类内,或者同一个函数作用域内,同名不同参数列表的函数之间的关系.而后三者是基 ...

- python-Web-django-短信登陆

until: import json, urllib from urllib.parse import urlencode # 发送短信 def request2(mobile,num, m=&quo ...

- Spring MVC 源码 分析

spring web 源码 @HandlesTypes(WebApplicationInitializer.class) public class SpringServletContainerInit ...

- Autofac依赖注入容器

依赖注入容器-- Autofac https://github.com/danielpalme/IocPerformance Unity 更新频率高,微软的项目Grace 综合性能更高 目录: 一.简 ...

- Serialize and Deserialize N-ary Tree

Serialization is the process of converting a data structure or object into a sequence of bits so tha ...