Hadoop —— 单机环境搭建

一、前置条件

Hadoop的运行依赖JDK,需要预先安装,安装步骤见:

二、配置免密登录

Hadoop组件之间需要基于SSH进行通讯。

2.1 配置映射

配置ip地址和主机名映射:

vim /etc/hosts

# 文件末尾增加

192.168.43.202 hadoop001

2.2 生成公私钥

执行下面命令行生成公匙和私匙:

ssh-keygen -t rsa

3.3 授权

进入~/.ssh目录下,查看生成的公匙和私匙,并将公匙写入到授权文件:

[root@@hadoop001 sbin]# cd ~/.ssh

[root@@hadoop001 .ssh]# ll

-rw-------. 1 root root 1675 3月 15 09:48 id_rsa

-rw-r--r--. 1 root root 388 3月 15 09:48 id_rsa.pub

# 写入公匙到授权文件

[root@hadoop001 .ssh]# cat id_rsa.pub >> authorized_keys

[root@hadoop001 .ssh]# chmod 600 authorized_keys

三、Hadoop(HDFS)环境搭建

3.1 下载并解压

下载Hadoop安装包,这里我下载的是CDH版本的,下载地址为:http://archive.cloudera.com/cdh5/cdh/5/

# 解压

tar -zvxf hadoop-2.6.0-cdh5.15.2.tar.gz

3.2 配置环境变量

# vi /etc/profile

配置环境变量:

export HADOOP_HOME=/usr/app/hadoop-2.6.0-cdh5.15.2

export PATH=${HADOOP_HOME}/bin:$PATH

执行source命令,使得配置的环境变量立即生效:

# source /etc/profile

3.3 修改Hadoop配置

进入${HADOOP_HOME}/etc/hadoop/目录下,修改以下配置:

1. hadoop-env.sh

# JDK安装路径

export JAVA_HOME=/usr/java/jdk1.8.0_201/

2. core-site.xml

<configuration>

<property>

<!--指定namenode的hdfs协议文件系统的通信地址-->

<name>fs.defaultFS</name>

<value>hdfs://hadoop001:8020</value>

</property>

<property>

<!--指定hadoop存储临时文件的目录-->

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/tmp</value>

</property>

</configuration>

3. hdfs-site.xml

指定副本系数和临时文件存储位置:

<configuration>

<property>

<!--由于我们这里搭建是单机版本,所以指定dfs的副本系数为1-->

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

4. slaves

配置所有从属节点的主机名或IP地址,由于是单机版本,所以指定本机即可:

hadoop001

3.4 关闭防火墙

不关闭防火墙可能导致无法访问Hadoop的Web UI界面:

# 查看防火墙状态

sudo firewall-cmd --state

# 关闭防火墙:

sudo systemctl stop firewalld.service

3.5 初始化

第一次启动Hadoop时需要进行初始化,进入${HADOOP_HOME}/bin/目录下,执行以下命令:

[root@hadoop001 bin]# ./hdfs namenode -format

3.6 启动HDFS

进入${HADOOP_HOME}/sbin/目录下,启动HDFS:

[root@hadoop001 sbin]# ./start-dfs.sh

3.7 验证是否启动成功

方式一:执行jps查看NameNode和DataNode服务是否已经启动:

[root@hadoop001 hadoop-2.6.0-cdh5.15.2]# jps

9137 DataNode

9026 NameNode

9390 SecondaryNameNode

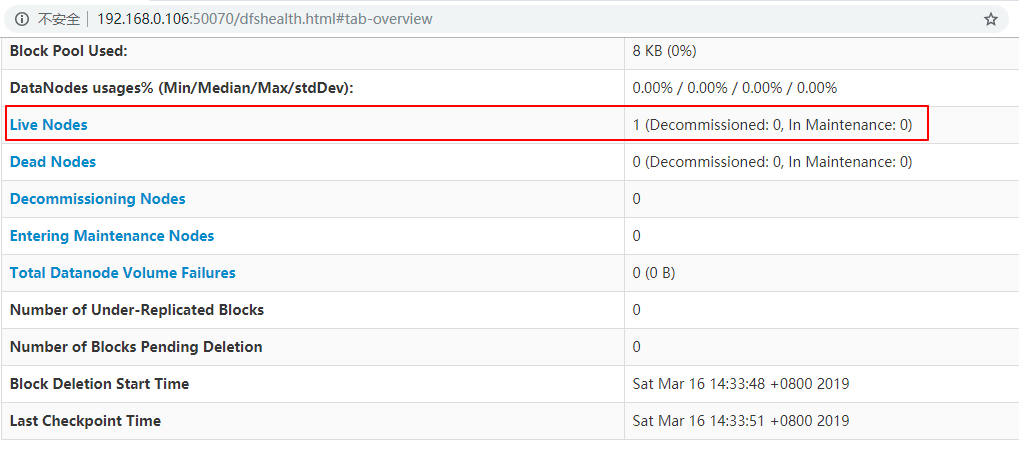

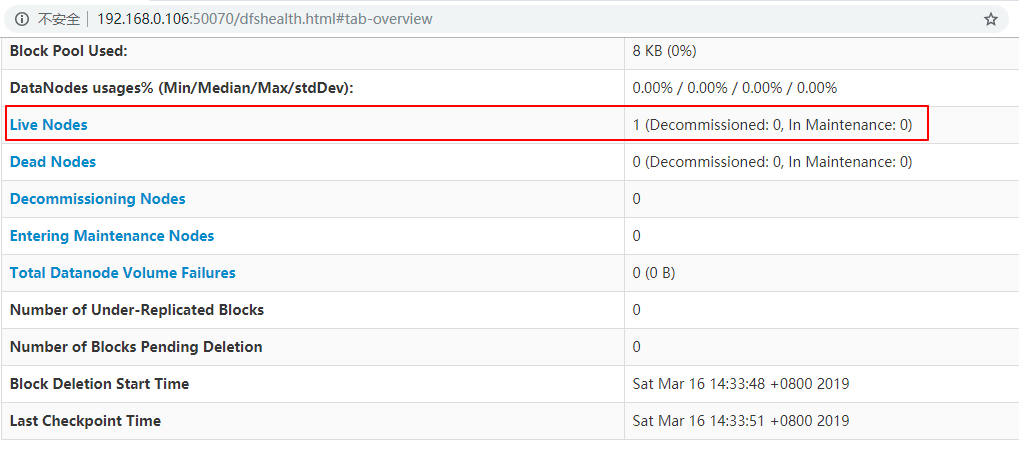

方式二:查看Web UI界面,端口为50070:

四、Hadoop(YARN)环境搭建

4.1 修改配置

进入${HADOOP_HOME}/etc/hadoop/目录下,修改以下配置:

1. mapred-site.xml

# 如果没有mapred-site.xml,则拷贝一份样例文件后再修改

cp mapred-site.xml.template mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

2. yarn-site.xml

<configuration>

<property>

<!--配置NodeManager上运行的附属服务。需要配置成mapreduce_shuffle后才可以在Yarn上运行MapReduce程序。-->

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

4.2 启动服务

进入${HADOOP_HOME}/sbin/目录下,启动YARN:

./start-yarn.sh

4.3 验证是否启动成功

方式一:执行jps命令查看NodeManager和ResourceManager服务是否已经启动:

[root@hadoop001 hadoop-2.6.0-cdh5.15.2]# jps

9137 DataNode

9026 NameNode

12294 NodeManager

12185 ResourceManager

9390 SecondaryNameNode

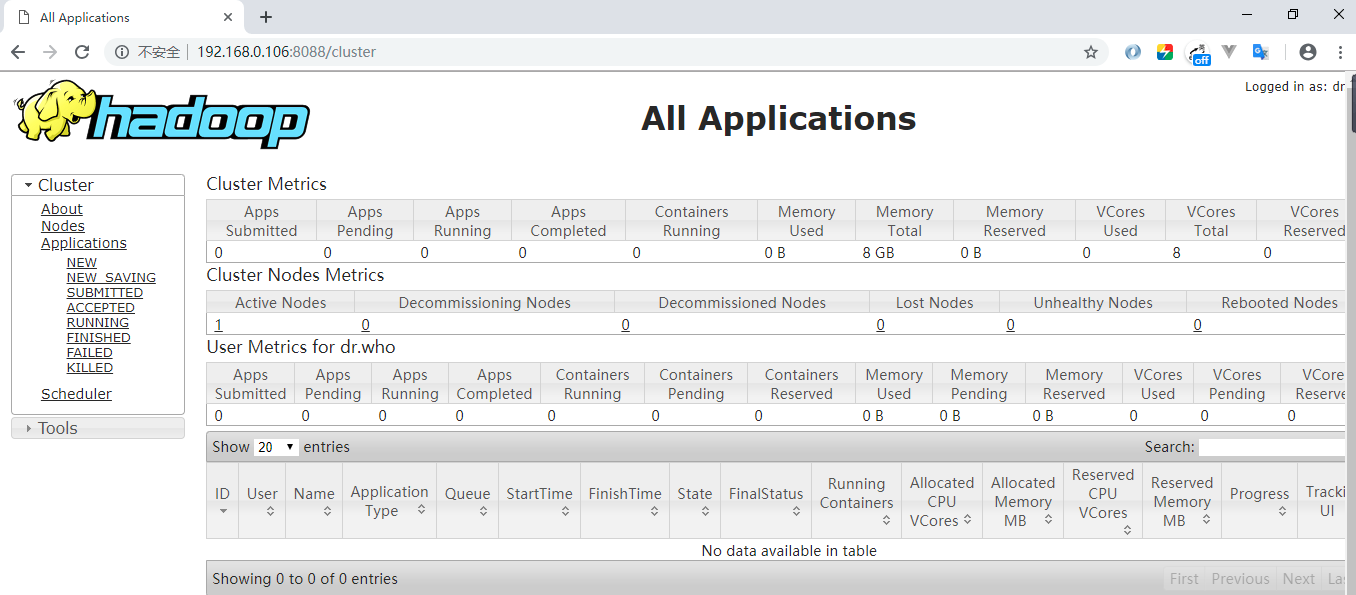

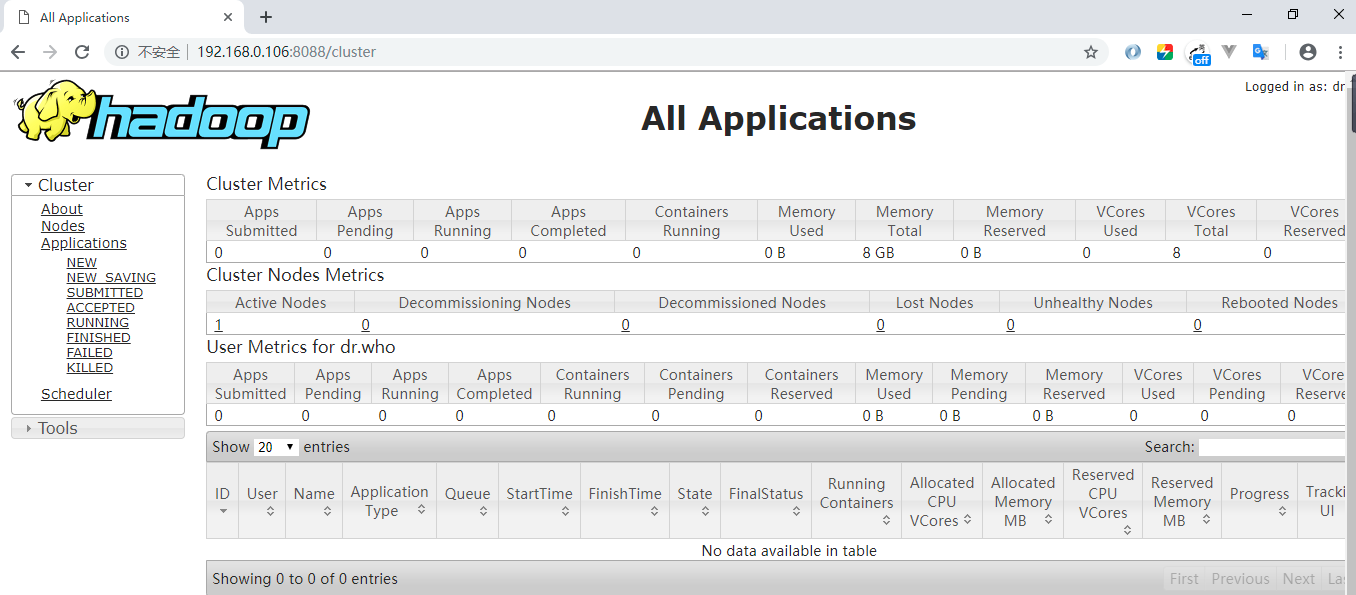

方式二:查看Web UI界面,端口号为8088:

更多大数据系列文章可以参见个人 GitHub 开源项目: 程序员大数据入门指南

一、前置条件

Hadoop的运行依赖JDK,需要预先安装,安装步骤见:

二、配置免密登录

Hadoop组件之间需要基于SSH进行通讯。

2.1 配置映射

配置ip地址和主机名映射:

vim /etc/hosts

# 文件末尾增加

192.168.43.202 hadoop001

2.2 生成公私钥

执行下面命令行生成公匙和私匙:

ssh-keygen -t rsa

3.3 授权

进入~/.ssh目录下,查看生成的公匙和私匙,并将公匙写入到授权文件:

[root@@hadoop001 sbin]# cd ~/.ssh

[root@@hadoop001 .ssh]# ll

-rw-------. 1 root root 1675 3月 15 09:48 id_rsa

-rw-r--r--. 1 root root 388 3月 15 09:48 id_rsa.pub

# 写入公匙到授权文件

[root@hadoop001 .ssh]# cat id_rsa.pub >> authorized_keys

[root@hadoop001 .ssh]# chmod 600 authorized_keys

三、Hadoop(HDFS)环境搭建

3.1 下载并解压

下载Hadoop安装包,这里我下载的是CDH版本的,下载地址为:http://archive.cloudera.com/cdh5/cdh/5/

# 解压

tar -zvxf hadoop-2.6.0-cdh5.15.2.tar.gz

3.2 配置环境变量

# vi /etc/profile

配置环境变量:

export HADOOP_HOME=/usr/app/hadoop-2.6.0-cdh5.15.2

export PATH=${HADOOP_HOME}/bin:$PATH

执行source命令,使得配置的环境变量立即生效:

# source /etc/profile

3.3 修改Hadoop配置

进入${HADOOP_HOME}/etc/hadoop/目录下,修改以下配置:

1. hadoop-env.sh

# JDK安装路径

export JAVA_HOME=/usr/java/jdk1.8.0_201/

2. core-site.xml

<configuration>

<property>

<!--指定namenode的hdfs协议文件系统的通信地址-->

<name>fs.defaultFS</name>

<value>hdfs://hadoop001:8020</value>

</property>

<property>

<!--指定hadoop存储临时文件的目录-->

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/tmp</value>

</property>

</configuration>

3. hdfs-site.xml

指定副本系数和临时文件存储位置:

<configuration>

<property>

<!--由于我们这里搭建是单机版本,所以指定dfs的副本系数为1-->

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

4. slaves

配置所有从属节点的主机名或IP地址,由于是单机版本,所以指定本机即可:

hadoop001

3.4 关闭防火墙

不关闭防火墙可能导致无法访问Hadoop的Web UI界面:

# 查看防火墙状态

sudo firewall-cmd --state

# 关闭防火墙:

sudo systemctl stop firewalld.service

3.5 初始化

第一次启动Hadoop时需要进行初始化,进入${HADOOP_HOME}/bin/目录下,执行以下命令:

[root@hadoop001 bin]# ./hdfs namenode -format

3.6 启动HDFS

进入${HADOOP_HOME}/sbin/目录下,启动HDFS:

[root@hadoop001 sbin]# ./start-dfs.sh

3.7 验证是否启动成功

方式一:执行jps查看NameNode和DataNode服务是否已经启动:

[root@hadoop001 hadoop-2.6.0-cdh5.15.2]# jps

9137 DataNode

9026 NameNode

9390 SecondaryNameNode

方式二:查看Web UI界面,端口为50070:

四、Hadoop(YARN)环境搭建

4.1 修改配置

进入${HADOOP_HOME}/etc/hadoop/目录下,修改以下配置:

1. mapred-site.xml

# 如果没有mapred-site.xml,则拷贝一份样例文件后再修改

cp mapred-site.xml.template mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

2. yarn-site.xml

<configuration>

<property>

<!--配置NodeManager上运行的附属服务。需要配置成mapreduce_shuffle后才可以在Yarn上运行MapReduce程序。-->

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

4.2 启动服务

进入${HADOOP_HOME}/sbin/目录下,启动YARN:

./start-yarn.sh

4.3 验证是否启动成功

方式一:执行jps命令查看NodeManager和ResourceManager服务是否已经启动:

[root@hadoop001 hadoop-2.6.0-cdh5.15.2]# jps

9137 DataNode

9026 NameNode

12294 NodeManager

12185 ResourceManager

9390 SecondaryNameNode

方式二:查看Web UI界面,端口号为8088:

更多大数据系列文章可以参见个人 GitHub 开源项目: 程序员大数据入门指南

Hadoop —— 单机环境搭建的更多相关文章

- hadoop单机环境搭建

[在此处输入文章标题] Hadoop单机搭建 1. 工具准备 1) Hadoop Linux安装包 2) VMware虚拟机 3) Java Linux安装包 4) Window 电脑一台 2. 开始 ...

- 攻城狮在路上(陆)-- hadoop单机环境搭建(一)

一.环境说明: 操作系统:Centos6.5 Linux node1 2.6.32-431.el6.x86_64 #1 SMP Fri Nov 22 03:15:09 UTC 2013 x86 ...

- Hadoop单机环境搭建整体流程

1. Ubuntu环境安装和基本配置 本例程中在MAC上安装使用的虚拟机Ubuntu系统(64位,desktop): 基本配置 考虑到以后涉及到hadoop的应用便于权限的管理,特别地创建一个ha ...

- [转载] Hadoop和Hive单机环境搭建

转载自http://blog.csdn.net/yfkiss/article/details/7715476和http://blog.csdn.net/yfkiss/article/details/7 ...

- 【HADOOP】| 环境搭建:从零开始搭建hadoop大数据平台(单机/伪分布式)-下

因篇幅过长,故分为两节,上节主要说明hadoop运行环境和必须的基础软件,包括VMware虚拟机软件的说明安装.Xmanager5管理软件以及CentOS操作系统的安装和基本网络配置.具体请参看: [ ...

- Hadoop单机Hadoop测试环境搭建

Hadoop单机Hadoop测试环境搭建: 1. 安装jdk,并配置环境变量,配置ssh免密码登录 2. 下载安装包hadoop-2.7.3.tar.gz 3. 配置/etc/hosts 127.0. ...

- Hadoop之环境搭建

初学Hadoop之环境搭建 阅读目录 1.安装CentOS7 2.安装JDK1.7.0 3.安装Hadoop2.6.0 4.SSH无密码登陆 本文仅作为学习笔记,供大家初学Hadoop时学习参考. ...

- Hadoop生产环境搭建(含HA、Federation)

Hadoop生产环境搭建 1. 将安装包hadoop-2.x.x.tar.gz存放到某一目录下,并解压. 2. 修改解压后的目录中的文件夹etc/hadoop下的配置文件(若文件不存在,自己创建.) ...

- Hadoop 系列(四)—— Hadoop 开发环境搭建

一.前置条件 Hadoop 的运行依赖 JDK,需要预先安装,安装步骤见: Linux 下 JDK 的安装 二.配置免密登录 Hadoop 组件之间需要基于 SSH 进行通讯. 2.1 配置映射 配置 ...

随机推荐

- 各种工具的使用 tricks

1. 搜狗搜索引擎 因为搜狗与腾讯的合作关系,搜狗搜索引擎提供了"微信"的搜索选项,可直接定位到相关文章,或者公众号. weixin.sougou.com 2. PyCharm P ...

- Scala基本语法学习笔记

Scala语法与JAVA有很多相似的地方,两者也可以相互调用.但是整体感觉Scala语法等简洁.灵活.这里记录下Scala有特点的地方,以备以后查找方便. 参考: 使用 import: htt ...

- Android中WebView的相关使用

近期做的项目中,遇到个非常棘手的问题: 客户给我的数据是有限制的,因此,在返回某条详细页面内容的时候,他仅仅能给我一个html片段,里面包括 文字,图片以及附件的下载地址.假设网页模版规范的爱比較好说 ...

- Linux性能测试 sar命令

sar命令包含在sysstat工具包中,提供系统的众多统计数据.其在不同的系统上命令有些差异 sar 命令行的常用格式: [root@C44 ~]# sar sysstat version (C) S ...

- Android获取百度音乐下载音乐和歌词下载链接

首先,你必须通过以下连接下载歌曲: http://box.zhangmen.baidu.com/x?op=12&count=1&title={title}$${author}$$$$ ...

- 介绍MFC参与设计模式框架(一个)

最近我读了一些相关MFC参与设计的花纹纸架,为了帮助您了解MFC在此框架总结,我们希望对大家有帮助. 简介设计模式 设计模式是一套被重复使用.多数人知晓的.经过分类编目的.代码设计经验的总结.使用设计 ...

- Cocos2d-x 脚本语言Lua介绍

Cocos2d-x 脚本语言Lua介绍 本篇博客记录Lua学习.学习来自eoe论坛,Lua语言开发Cocos2d-x游戏入门视频教程,猛戳下面地址: http://www.eoeandroid.com ...

- WPF利用VisualTreeHelper遍历寻找对象的子级对象或者父级对象

原文:WPF利用VisualTreeHelper遍历寻找对象的子级对象或者父级对象 简介 本文将完整叙述我利用VisualTreeHelper实现题述功能的全部过程,想直接看函数实现的朋友可以跳到函数 ...

- NSLocalizedDescription=Request failed: unacceptable content-type: text/html 解决方法

使用AFNetworking请求一个网站出现了以下错误 Error Domain=com.alamofire.error.serialization.response Code=- "Req ...

- Winform入门见解

winform算是C#比较快速的入门的一个了,简单的控件拖拽然后写上每个控件对应的事件.然后就可以了.需要美观的点 可以用Skin皮肤就完成了.我们先不说复杂的,就来个普通的三层架构来增删改查 分页和 ...