shell脚本----周期压缩备份日志文件

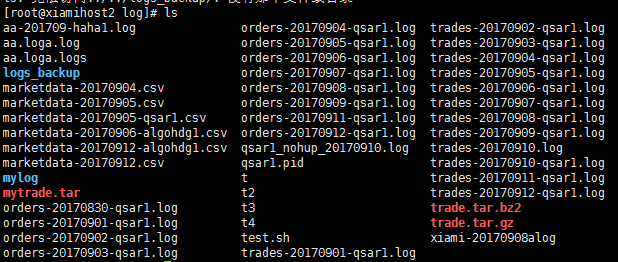

一、日志文件样式

二、目标

1、备份压缩.log结尾&&时间样式为“date +%Y%m%d”的日志文件(如:20170912、20160311等)

2、可指定压缩范围(N天前至当天):如:今天、昨天(date -d "-1 day" +%Y%m%d)至今天、前天至今天

压缩命名格式为:日期.tar.gz(或:日期.tar.bz2),压缩N天范围内文件后将会生成N个压缩包

3、可指定压缩模式(二选一):tar czf 或 tar cjf

4、可指定删除范围:删除N天前的日志文件,如:今天为20170912,删除3天前日志,即删除20170908及其以前的日志文件

5、每周五(不一定周五,可在脚本中指定周几打包)将压缩文件打包(打包成功后删除压缩文件),并上传到日志服务器,上传成功后删除打包文件

6、默认备份当天日志文件,压缩模式为“czf”,删除三天前日志文件

三、脚本内容

#!/bin/bash

#author:xiami

#date:

#description: compress files of a specified mode and delete logs before a particular date

#version:v0. strategy_logs_path="/root/apps/myapp/log"

date=$(date +%Y%m%d) #------------初始化函数默认参数----------

init_argv(){ #example:init_argv -d -m cjf -r 打包压缩近四天及当天日志,压缩模式cjf,删除五天前日志

compress_date=$(date +%Y%m%d)

backup_mode="czf"

del_days_num=

backup_path="/root/apps/logs_backup"

line=$(ps -ef |grep "ssh-agent"|awk '{if($0!~/grep ssh-agent/)print $0}'|wc -l)

while getopts d:m:r: opt

do

case $opt in

d) compress_days="$OPTARG" ;;

m) backup_mode="$OPTARG" ;;

r) del_days_num="$OPTARG" ;;

\?) echo "Usage: `basename $0` [d|m|r]"

echo "-d 'Integer' (tar & compress Integer day logfile)"

echo "-m 'czf|cjf' (mode)"

echo "-r 'Interger' (remove files Integer days ago)"

exit ;;

esac

done

if [ ! -d "$backup_path" ];then

mkdir -p $backup_path

fi

# if [ line -lt ];then

# echo "Not running ssh-agent"

# exit

# fi

}

#------------打包并压缩日志文件操作函数--------------------

tar_compress_log(){ #参数1:压缩日期 参数2:压缩备份模式

local compress_date="$1"

local backup_mode="$2"

cd "$strategy_logs_path"

# ls . -name "*$date*.log"|xargs tar $backup_mode "$date.tar.gz" #压缩当天日志

if [ "$backup_mode" == 'czf' ];then

ls | grep ".*[0-9]\{8\}.*\.log$"|grep ".*"$compress_date".*"|xargs tar $backup_mode "$backup_path/"$".tar.gz"

elif [ "$backup_mode" == 'cjf' ];then

ls | grep ".*[0-9]\{8\}.*\.log$"|grep ".*"$compress_date".*"|xargs tar $backup_mode "$backup_path/"$".tar.bz2"

else

echo "tar mode error";exit

fi

}

#------------打包并压缩N天前到当前日期范围的日志文件----------

compress_range_date(){ #参数1:压缩备份天数 参数2:压缩备份模式

local dates="$date"

local compress_days="$1"

local backup_mode="$2"

if [[ ! -z "$compress_days" && "$compress_days" -ne ]];then

for i in `seq "$compress_days"`;do

dates=$(date -d "-$i day" +%Y%m%d)

# n=$(echo $dates|awk '{print NF}')

tar_compress_log "$dates" "$backup_mode"

done

else

tar_compress_log "$dates" "$backup_mode"

fi

}

#------------每周五打包当周压缩文件并在打包成功后删除单个压缩文件------------

tar_file(){

weekday=$(date +%u)

if [ "$weekday" -eq ];then

cd "$backup_path"

ls|xargs tar cf "$date-Fri-logs.tar" && rm *.tar.?z*

fi

}

#-----------删除(del_log_days)天前日志文件(根据mtime)---------

delete_days_log1(){ #参数1:del_days_num

local del_days_num="$1"

cd "$strategy_logs_path"

find . -type f -mtime +$del_days_num |grep ".*[0-9]\{8\}.*\.log"|xargs rm aa -rf #删除操作,请谨慎

}

#----------删除(del_log_days)天前日志文件(根据log文件名)----

delete_days_log2(){ #参数1:del_days_num

local del_days_num="$1"

cd "$strategy_logs_path"

local num=$(ls |grep ".*[0-9]\{8\}.*\.log$" |grep -o "[0-9]\{8\}"|awk '!day[$0]++'|wc -l)

local files=$(ls |grep ".*[0-9]\{8\}.*\.log$" |grep -o "[0-9]\{8\}"|awk '!day[$0]++')

if [ ! -z "$num" ];then

local field=""

for i in `seq "$num"`

do

field=$(echo $files|awk '{print $v}' v=$i)

if [ "$field" -lt $(date -d "-$del_days_num day" +%Y%m%d) ];then

ls *$field* |grep '.*[0-9]\{8\}.*\.log$'|xargs rm aa -rf

fi

done

fi

}

#-----------上传到日志服务器-------------

upload_tgz(){

scp $backup_path/$date.tar.gz 192.168.119.133:/opt/ && rm $backup_path/$date.tar.gz

#scp $backup_path/$date*-logs.tar 192.168.119.133:/opt/ && rm $backup_path/$date*-logs.tar

}

#-----------main-------------------------

main(){

init_argv $argv

compress_range_date "$compress_days" "$backup_mode"

delete_days_log2 $del_days_num

tar_file

# upload_tgz

}

#----------执行部分----------------------

argv=""

until [ "$#" -eq ];do

argv="$argv $1"

shift

done

main $argv

log_tar_clean.sh

四、运行脚本

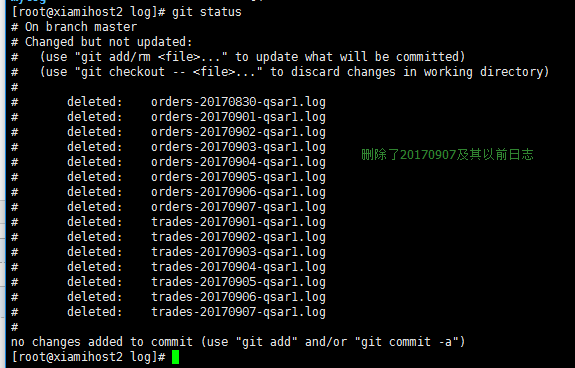

日志文件初始数量为图一所示

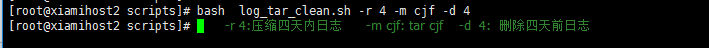

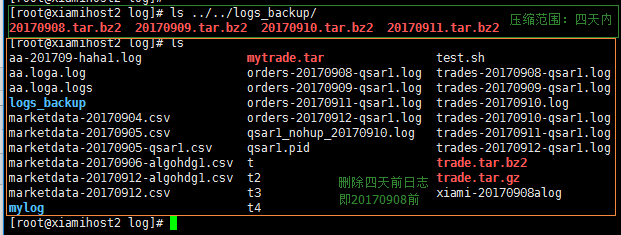

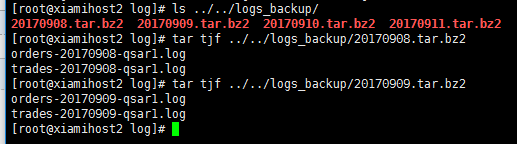

4.1 带参数运行后

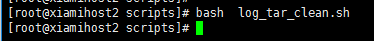

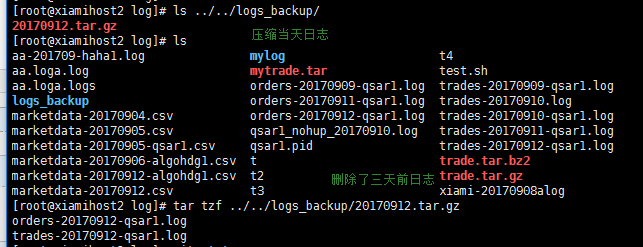

4.2 不带参数运行(默认情况,备份当天日志文件,压缩模式为“czf”,删除三天前日志文件)

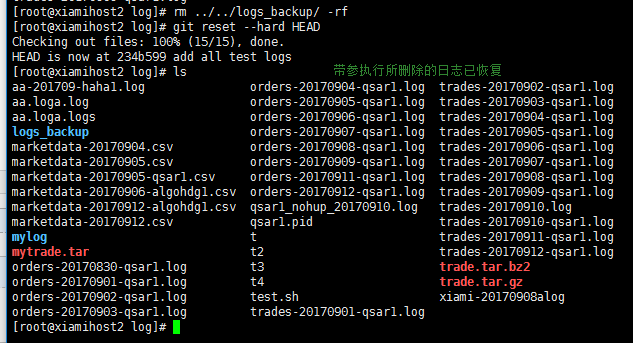

为了使测试环境一致,首先恢复被删除日志文件,删除压缩文件

不带参数运行脚本

五、计划任务

略

脚本完善:

1、删除每天的日志文件,机器中只保留近N天(默认14天)的压缩文件

2、考虑到安全性,文件上传改为:远端日志服务器从机器拉取每天对应的日志文件,而不是机器主动上传。

3、一次备份多个目录下日志,目录列表存放于scan_logdir.inc

完善后脚本:

#!/bin/bash

#author:xiami

#date:

#description: compress files of a specified mode and delete logs before a particular date, reference: http://www.cnblogs.com/xiami-xm/p/7511087.html

#version:v0. date=$(date +%Y%m%d)

scan_log_dir="$(dirname $0)/scan_logdir.inc" #------------初始化函数默认参数----------

init_argv(){ #example:init_argv -d -m cjf -r 打包压缩近四天及当天日志,压缩模式cjf,删除五天前日志

compress_date=$(date +%Y%m%d)

backup_mode="cjf"

del_days_num=

backup_path="/root/apps/logs_backup"

stay_days=

line=$(ps -ef |grep "ssh-agent"|awk '{if($0!~/grep ssh-agent/)print $0}'|wc -l)

while getopts d:m:r:s: opt

do

case $opt in

d) compress_days="$OPTARG" ;;

m) backup_mode="$OPTARG" ;;

r) del_days_num="$OPTARG" ;;

s) stay_days="$OPTARG" ;;

\?) echo "Usage: `basename $0` [d|m|r]"

echo "-d 'Integer' (tar & compress Integer day logfile)"

echo "-m 'czf|cjf' (mode)"

echo "-r 'Interger' (remove files Integer days ago)"

exit ;;

esac

done

if [ ! -d "$backup_path" ];then

mkdir -p $backup_path

fi

}

#------------(实际操作函数)打包并压缩日志文件,压缩成功后立即将文件删除--------------------

tar_compress_log(){ #参数1:压缩日期 参数2:压缩备份模式

local compress_date="$1"

local backup_mode="$2"

local logs_path="$3"

cd "$logs_path"

# cd "$strategy_logs_path"

# ls . -name "*$date*.log"|xargs tar $backup_mode "$date.tar.gz" #压缩当天日志

if [ "$backup_mode" == 'czf' ];then

ls | grep ".*[0-9]\{8\}.*\.\(log\|csv\)$"|grep ".*"$compress_date".*"|xargs tar $backup_mode $backup_path/dir$a.$compress_date.tar.gz >/dev/null >& && ls | grep ".*[0-9]\{8\}.*\.\(log\|csv\)$"|grep ".*"$compress_date".*"|xargs rm -rf

elif [ "$backup_mode" == 'cjf' ];then

ls | grep ".*[0-9]\{8\}.*\.\(log\|csv\)$"|grep ".*"$compress_date".*"|xargs tar $backup_mode $backup_path/dir$a.$compress_date.tar.bz2 >/dev/null >& && ls | grep ".*[0-9]\{8\}.*\.\(log\|csv\)$"|grep ".*"$compress_date".*"|xargs rm -rf

else

echo "tar mode error";exit

fi

}

#------------检查scan_logdir.inc是否有数据-------------------

check_scan(){

local line=$(cat "$scan_log_dir" | wc -l)

if [ "$line" -eq ];then

exit ;

fi

}

#------------需要备份的日志目录-------------------------------

backup_all_logs_dir(){

check_scan

local a=

while read line;do

local logs_path="$line"

compress_range_date "$compress_days" "$backup_mode" "$logs_path"

# delete_days_log1 "$del_days_num" "$logs_path"

delete_days_log2 "$del_days_num" "$logs_path"

let a++;echo "-----------------$a----------------------------------"

done < "$scan_log_dir"

}

#------------打包并压缩N天前到当前日期范围的日志文件----------

compress_range_date(){ #参数1:压缩备份天数 参数2:压缩备份模式

local dates="$date"

local compress_days="$1"

local backup_mode="$2"

local logs_path="$3"

# if [[ ! -z "$compress_days" && "$compress_days" -ne ]];then

if [ ! -z "$compress_days" ];then

for i in `seq "$compress_days"`;do

dates=$(date -d "-$i day" +%Y%m%d)

# n=$(echo $dates|awk '{print NF}')

tar_compress_log "$dates" "$backup_mode" "$logs_path"

done

else

tar_compress_log "$dates" "$backup_mode" "$logs_path"

fi

}

#------------每周五打包当周压缩文件并在打包成功后删除单个压缩文件------------

tar_file(){

weekday=$(date +%u)

if [ "$weekday" -eq ];then

cd "$backup_path"

ls|xargs tar cf "$date-Fri-logs.tar" && rm *.tar.?z*

fi

}

#-----------只保留14天内的压缩日志文件------------------------------------

stay_tgz_log(){

local stay_days="$stay_days"

local rm_date=$(date -d "-$stay_days day" +%Y%m%d)

cd $backup_path

ls |grep -o "[0-9]\{8\}"|awk '!aa[$0]++'|while read line;do

if [ "$line" -le $rm_date ];then

ls *$line* |xargs rm -rf

fi

done }

#-----------删除(del_log_days)天前日志文件(根据mtime)---------

delete_days_log1(){ #参数1:del_days_num

local del_days_num="$1"

local logs_path="$2"

# cd "$strategy_logs_path"

cd "$logs_path"

find . -type f -mtime +$del_days_num |grep ".*[0-9]\{8\}.*\.\(log\|csv\)$"|xargs rm -rf #删除操作,请谨慎

}

#----------删除(del_log_days)天前日志文件(根据log文件名)----

delete_days_log2(){ #参数1:del_days_num

local del_days_num="$1"

local logs_path="$2"

# cd "$strategy_logs_path"

cd "$logs_path"

local num=$(ls |grep ".*[0-9]\{8\}.*\.\(log\|csv\)$" |grep -o "[0-9]\{8\}"|awk '!day[$0]++'|wc -l)

local files=$(ls |grep ".*[0-9]\{8\}.*\.\(log\|csv\)$" |grep -o "[0-9]\{8\}"|awk '!day[$0]++')

if [ ! -z "$num" ];then

local field=""

for i in `seq "$num"`

do

field=$(echo $files|awk '{print $v}' v=$i)

if [ "$field" -le $(date -d "-$del_days_num day" +%Y%m%d) ];then

ls *$field* |grep '.*[0-9]\{8\}.*\.\(log\|csv\)$'|xargs rm -rf

fi

done

fi

}

#-----------上传到日志服务器-------------

upload_tgz(){

scp $backup_path/$date.tar.gz 192.168.119.133:/opt/ && rm $backup_path/$date.tar.gz

#scp $backup_path/$date*-logs.tar 192.168.119.133:/opt/ && rm $backup_path/$date*-logs.tar

}

#-----------main-------------------------

main(){

init_argv $argv

backup_all_logs_dir

# compress_range_date "$compress_days" "$backup_mode"

# delete_days_log2 $del_days_num

stay_tgz_log $stay_days

# tar_file

# upload_tgz

}

#----------执行部分----------------------

argv=""

until [ "$#" -eq ];do

argv="$argv $1"

shift

done

main $argv

clean_log.sh

日志服务器拉取脚本:

#!/bin/bash

date=$(date +%Y%m%d)

remote_logs_backup=/root/apps/logs_backup

local_logs_backup=/root/apps/local_logs_backup

hostsfile="$(dirname $0)/hosts.inc"

while read line;do

if [ ! -d "$local_logs_backup/$line" ];then

mkdir -p "$local_logs_backup/$line"

fi

scp root@$line:$remote_logs_backup/*$date* $local_logs_backup/$line >/dev/null 2>&1

#&& ssh -nl root $line "rm $remote_logs_backup/* -rf" >/dev/null 2>&1 #ssh登陆或拷贝操作时若文件不存在会报错,可忽略

done < $hostsfile

pull_logs.sh

[root@xiamihost3 script]# cat hosts.inc

192.168.119.131 #hosts.inc中是目标机器的ip地址

192.168.119.133

基本功能已实现,但脚本还有待改进,例如脚本中使用的grep可以换成egrep,可以少一层转义。

上传备份功能还未进行测试,可能会出现错误,当然,上传前肯定得先将本地公钥放入服务器的authorized_keys文件中,实现ssh无密登陆。

最后想感慨一句,还是python更强大

good good study,day day up

shell脚本----周期压缩备份日志文件的更多相关文章

- shell脚本切割tomcat的日志文件

鉴于在调试logback和log4j的文件切割一直无法成功,随性用shell写个脚本用来切割tomcat下的日志文件(大家如果有在logback或log4j使用文件切割成功的话,可以留下使用方式,先谢 ...

- zabbix3.0.4通过自定义shell脚本添加对关键日志文件的监控

zabbix添加对自定义无规则日志文件的监控 项目背景及思路: zabbix自带有针对日志文件的监控,自带的监控只能监控到指定文件或者正则匹配的固定日志文件,但当需要监控的文件名没有规律的时候自带监控 ...

- 【shell脚本】定时备份日志===logBackup.sh

定时备份日志 设置执行权限 [root@VM_0_10_centos shellScript]# chmod a+x logBackup,sh 脚本内容 [root@VM_0_10_centos sh ...

- shell脚本实现定时备份某文件

1:目标 实现在图像化界面输入需要备份的源文件路径.目标路径,定时的时间.然后通过输入的信息,把需要备份的源文件打包放到指定的目标路径下以执行定时任务的时间为子目录 把/she ...

- 使用shell脚本定时执行备份mysql数据库

使用shell脚本定时执行备份mysql数据库 #!/bin/bash ############### common file ################ #本机备份文件存放目录 MYSQLBA ...

- Shell脚本调用ftp上传文件

Shell脚本调用ftp上传文件 1.脚本如下 ftp -n<<! open x.x.x.x ###x.x.x.x为ftp地址 user username password ###user ...

- Centos上通过shell脚本实现数据库备份和还原

最近有个这样的需求,通过shell脚本实现数据库备份还原,最后通过网上查询自己测试实现,将脚本分享给大家 1.数据库备份脚本 #!/bin/bash ds=`` list=`date +%Y`/`da ...

- 用shell脚本实现定时备份数据库

1.备份数据库的方法 可以使用命令查看 ls /usr/local/mysql/bin 这个mysqldump就是系统内置的用来备份数据库的工具. 2.实现方法 ①先随便进入一个位置创建一个目录 ② ...

- shell脚本每天自动备份mysql数据库

一.mysql提供了一个mysqldump的工具可以方便的导出导入数据库信息: 二.使用命令行shell测试执行mysqldump,理解必备的参数,查看生成的sql备份文件是否符合需求: /usr/b ...

随机推荐

- Effective Java 第三版——75. 在详细信息中包含失败捕获信息

Tips 书中的源代码地址:https://github.com/jbloch/effective-java-3e-source-code 注意,书中的有些代码里方法是基于Java 9 API中的,所 ...

- python 模块学习

一.from django.contrib.auth.hashers import make_password 通过函数名即可发现,主要有两个函数,分别是创建密码和验证 用法 ps = " ...

- Canvas入门到高级详解(中)

三. canvas 进阶 3.1 Canvas 颜色样式和阴影 3.1.1 设置填充和描边的颜色(掌握) fillStyle : 设置或返回用于填充绘画的颜色 strokeStyle: 设置或返回用于 ...

- python实现类似于Matlab中的magic函数

参考这篇文章的代码封装了一个类似Matlab中的magic函数,用来生成魔方矩阵. #!/usr/bin/env python # -*- coding: utf-8 -*- import numpy ...

- dockerd启动配置_修改IP和systemd管理

docker采用CS架构,dockerd是管理后台进程,默认的配置文件为/etc/docker/daemon.json(--config-file可以指定非默认位置). 一个完整的daemon.jso ...

- JavaScript之JS的数据类型

前言 JavaScript一共有6中数据类型: 基本数据类型(5):字符串(String).数字(Number).布尔(Boolean).数组(Array).空(Null).未定义(Undefined ...

- sprintf的Bug

]; sprintf(buffer,,,); 这样一般不崩溃,但是10次,有那么一次会崩溃 我只能说后面改成 0.0就可以了...

- Ubuntu下安装Kafka Manager

参考 : kafka管理器kafka-manager部署安装 下载Kafka Manager,并进行打包,由于Kafka manager是由scala写的,所以需要由sbt的支持 git clone ...

- 美客分销商城-接力购源码系统,全开源代码可进行二次开发,微信小程序分销商城

1. 准备服务器.域名(SSL证书).认证的微信小程序.微信支付商户号 2. 系统功能简介 三.演示案例,微信扫码查看 四.后台管理系统 五. 全套开源源码,进行二次开发 六.本系统完美运营,全套代码 ...

- MySql 查询银行卡号打码

),")) end as card_number from das.staff_base; case 函数 CASE WHEN 条件1 THEN 结果1 WHEN 条件2 THE ...