【十大算法实现之KNN】KNN算法实例(含测试数据和源码)

KNN算法基本的思路是比较好理解的,今天根据它的特点写了一个实例,我会把所有的数据和代码都写在下面供大家参考,不足之处,请指正。谢谢!

update:工程代码全部在本页面中,测试数据已丢失,建议去UCI Dataset中找一个自行测试一下。

几点说明:

1.KNN中的K=5;

2.在计算权重时,采用的是减去函数{1,0.8,0.6,0.4,0.2},当然你也可以采用反函数或高斯函数;

3.5%作为测试集(decision.txt),95%作为训练集(training.txt);

4.在计算costfun之前,对所有的属性进行了归一化,由于这里不知道数据集每个属性代表的含义,所以就一视同仁,实际情况下,应该具体问题具体分析;

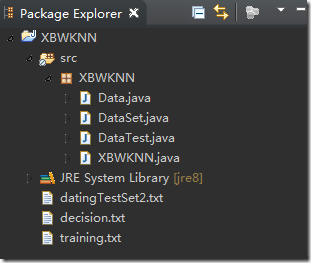

XBWKNN.java

package XBWKNN; import java.io.IOException;

import java.util.ArrayList;

import java.util.Collections;

import java.util.Comparator;

import java.util.List; /**

* KNN算法

* @author XBW

* @date 2014年8月16日

*/ public class XBWKNN{

public final static int KofKNN=5;

public final static double weight[]={1,0.9,0.7,0.4,0.1}; //减法函数y=1-0.2*x /**

* knn

* @param data

* @param ds

* @return ans

*/

public static int knn(Data data,DataSet ds){

int ans = 0;

List<Data> dis=calcDis(data,ds);

ans=calcKDis(data,dis);

return ans;

} /**

* 计算训练集中所有向量的距离,排序之后取前K个

* @param data

* @param ds

* @return

*/

@SuppressWarnings("null")

public static List<Data>calcDis(Data data,DataSet ds){

List<Data> anslist =new ArrayList<Data>();

double dx1=data.x1;

double dx2=data.x2;

double dx3=data.x3;

for(int i=0;i<ds.ds.size();i++){

double x1=ds.ds.get(i).x1;

double x2=ds.ds.get(i).x2;

double x3=ds.ds.get(i).x3;

ds.ds.get(i).costfun=Math.sqrt((dx1-x1)*(dx1-x1)+(dx2-x2)*(dx2-x2)+(dx3-x3)*(dx3-x3));

anslist.add(ds.ds.get(i));

}

Collections.sort(anslist,new Comparator<Data>(){

public int compare(Data o1, Data o2) {

Double s=o1.costfun-o2.costfun;

if(s<0)

return -1;

else

return 1;

}

});

return anslist;

} /**

* 按一定的权重计算出前K个

* @param data

* @param ds

* @return

*/

public static int calcKDis(Data data,List<Data> anslist){

Double[] anstype={0.0,0.0,0.0,0.0};

for(int i=0;i<KofKNN;i++){

if(anslist.get(i).type==1){

anstype[1]+=weight[i];

}

else if(anslist.get(i).type==2){

anstype[2]+=weight[i];

}

if(anslist.get(i).type==3){

anstype[3]+=weight[i];

}

}

Double maxt=-1.0;

int tag=1;

for(int i=1;i<=3;i++){

if(maxt<anstype[i]){

tag=i;

maxt=anstype[i];

}

}

return tag;

} public static void main(String[] args) throws IOException{

DataSet ds=new DataSet();

DataTest dt=new DataTest(); int correct=0;

for(int i=0;i<dt.dt.size();i++){

Data data=dt.dt.get(i);

int result=knn(data,ds);

if(result==data.type){

correct++;

}

}

System.out.println("total test num :"+dt.dt.size());

System.out.println("correct test num :"+correct);

System.out.println("ratio :"+correct/(double)dt.dt.size());

}

}

Datatest.java

package XBWKNN; import java.io.BufferedReader;

import java.io.File;

import java.io.FileReader;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List; /**

* 测试数据

* @author XBW

* @date 2014年8月16日

*/ public class DataTest{

String defaultpath="D:\\MachineLearning\\十大算法\\KNN\\knncode\\decision.txt";

List<Data> dt; @SuppressWarnings("null")

public DataTest() throws IOException{

List<Data> dset = new ArrayList<Data>();

File ds=new File(defaultpath);

@SuppressWarnings("resource")

BufferedReader br = new BufferedReader(new FileReader(ds));

String tsing;

double max1=-1;

double max2=-1;

double max3=-1;

while((tsing=br.readLine())!=null){

String[] dlist=tsing.split(" ");

Data data=new Data();

data.x1=Double.parseDouble(dlist[0]);

data.x2=Double.parseDouble(dlist[1]);

data.x3=Double.parseDouble(dlist[2]);

data.type=Integer.parseInt(dlist[3]);

dset.add(data); if(data.x1>max1){

max1=data.x1;

}

if(data.x2>max2){

max2=data.x2;

}

if(data.x3>max3){

max3=data.x3;

}

}

dset=normalization(dset,max1,max2,max3);

this.dt=dset;

} public List<Data> normalization(List<Data> dset,double m1,double m2,double m3){

for(int i=0;i<dset.size();i++){

dset.get(i).x1/=m1;

dset.get(i).x2/=m2;

dset.get(i).x3/=m3;

}

return dset;

}

}

DataSet.java

package XBWKNN; import java.io.BufferedReader;

import java.io.File;

import java.io.FileReader;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List; /**

* 训练数据

* @author XBW

* @date 2014年8月16日

*/ public class DataSet{

String defaultpath="D:\\MachineLearning\\十大算法\\KNN\\knncode\\training.txt";

List<Data> ds; @SuppressWarnings("null")

public DataSet() throws IOException{

List<Data> dset =new ArrayList<Data>();

File ds=new File(defaultpath);

@SuppressWarnings("resource")

BufferedReader br = new BufferedReader(new FileReader(ds));

String tsing;

double max1=-1;

double max2=-1;

double max3=-1;

while((tsing=br.readLine())!=null){

String[] dlist=tsing.split(" ");

Data data=new Data();

data.x1=Double.parseDouble(dlist[0]);

data.x2=Double.parseDouble(dlist[1]);

data.x3=Double.parseDouble(dlist[2]);

data.type=Integer.parseInt(dlist[3]);

dset.add(data); if(data.x1>max1){

max1=data.x1;

}

if(data.x2>max2){

max2=data.x2;

}

if(data.x3>max3){

max3=data.x3;

}

}

dset=normalization(dset,max1,max2,max3);

this.ds=dset;

} public List<Data> normalization(List<Data> dset,double m1,double m2,double m3){

for(int i=0;i<dset.size();i++){

dset.get(i).x1/=m1;

dset.get(i).x2/=m2;

dset.get(i).x3/=m3;

}

return dset;

}

}

Data.java

package XBWKNN; /**

* 一条数据

* @author XBW

* @date 2014年8月16日

*/ public class Data{

Double x1;

Double x2;

Double x3;

Double costfun;

int type;

}

output:

【十大算法实现之KNN】KNN算法实例(含测试数据和源码)的更多相关文章

- 机器学习——十大数据挖掘之一的决策树CART算法

本文始发于个人公众号:TechFlow,原创不易,求个关注 今天是机器学习专题的第23篇文章,我们今天分享的内容是十大数据挖掘算法之一的CART算法. CART算法全称是Classification ...

- 备战秋招之十大排序——O(nlogn)级排序算法

时间复杂度O(nlogn)级排序算法 五.希尔排序 首批将时间复杂度降到 O(n^2) 以下的算法之一.虽然原始的希尔排序最坏时间复杂度仍然是O(n^2),但经过优化的希尔排序可以达到 O(n^{1. ...

- 备战秋招之十大排序——O(n)级排序算法

时间复杂度O(n)级排序算法 九.计数排序 前文说到,19591959 年 77 月,希尔排序通过交换非相邻元素,打破了 O(n^2)的魔咒,使得排序算法的时间复杂度降到了 O(nlog n) 级,此 ...

- Redis系列(十二):数据结构SortedSet跳跃表中基本操作命令和源码解析

1.SkipList Redis的sortedSet数据结构是有序不重复的(索引为唯一的,数据(score)却可以重复), 跳表是redis的一个核心组件,也同时被广泛地运用到了各种缓存地实现当中,它 ...

- 视觉SLAM十四讲:从理论到实践 两版 PDF和源码

视觉SLAM十四讲:从理论到实践 第一版电子版PDF 链接:https://pan.baidu.com/s/1SuuSpavo_fj7xqTYtgHBfw提取码:lr4t 源码github链接:htt ...

- 十大经典排序算法(java实现、配图解,附源码)

前言: 本文章主要是讲解我个人在学习Java开发环境的排序算法时做的一些准备,以及个人的心得体会,汇集成本篇文章,作为自己对排序算法理解的总结与笔记. 内容主要是关于十大经典排序算法的简介.原理.动静 ...

- 【十大经典数据挖掘算法】kNN

[十大经典数据挖掘算法]系列 C4.5 K-Means SVM Apriori EM PageRank AdaBoost kNN Naïve Bayes CART 1. 引言 顶级数据挖掘会议ICDM ...

- 机器学习十大算法之KNN(K最近邻,k-NearestNeighbor)算法

机器学习十大算法之KNN算法 前段时间一直在搞tkinter,机器学习荒废了一阵子.如今想重新写一个,发现遇到不少问题,不过最终还是解决了.希望与大家共同进步. 闲话少说,进入正题. KNN算法也称最 ...

- 机器学习十大算法 之 kNN(一)

机器学习十大算法 之 kNN(一) 最近在学习机器学习领域的十大经典算法,先从kNN开始吧. 简介 kNN是一种有监督学习方法,它的思想很简单,对于一个未分类的样本来说,通过距离它最近的k个" ...

随机推荐

- JUnit注解

在本节中,我们将提到支持在JUnit4基本注释,下表列出了这些注释的概括: 注解 描述 @Testpublic void method() 测试注释指示该公共无效方法它所附着可以作为一个测试用例. @ ...

- QA:无法为具有固定名称“MySql.Data.MySqlClient”...

Question: 无法为具有固定名称“MySql.Data.MySqlClient”的 ADO.NET 提供程序加载在应用程序配置文件中注册的实体框架提供程序类型“MySql.Data.MySqlC ...

- (转)live555学习笔记-UsageEnvironment和TaskScheduler

2011-12-6阅读1264 评论1 一直想学习流媒体服务器的设计,这几天有点时间,看了一下live555的源代码.live555是一个开源的跨平台流媒体服务器,使用编程语言是C++.将现阶段学习笔 ...

- Linux及Windows系统配置JDK环境变量

1.Linux系统配置方法 记住,要下载JDK-8u121-linux-x64.tar.gz,而不是JRE-8u121-linux-x64.tar.gz,JDK中含很多开发者实用工具,比如javac. ...

- 【Java集合的详细研究1】Collections类常用方法总结

1.sort(Collection)方法的使用(含义:对集合进行排序). 例:对已知集合c进行排序? public class Practice { public static void main(S ...

- utf8 ucs4

这个问题不好回答,首先UTF-8编码只不过是一种Unicode的转换,兼容ASCII.所以,UTF-8编码支持的最大字符编码应该是Unicode支持的最大字符编码. 理论上,UTF-8编码可以支持最大 ...

- iptables filter表小案例

案例1:把80端口,22端口,21端口放行 22端口指定IP访问,其它IP拒绝. shell脚本实现: [root@centos7 ~]# vim /usr/local/sbin/iptables.s ...

- js(数组篇02)

原文:http://www.cnblogs.com/zaking/p/8686676.html 上一篇文章简单的介绍了一下js的类型,以及数组的增删方法.这一篇文章,我们一起来看看数组还有哪些用法,以 ...

- Spring Boot 处理 REST API 错误的正确姿势

摘要:如何正确的处理API的返回信息,让返回的错误信息提供更多的含义是一个非常值得做的功能.默认一般返回的都是难以理解的堆栈信息,然而这些信息也许对于API的客户端来说有可能并没有多大用途,并没有多大 ...

- 转载SQL容易产生的错误问题

概述 因为每天需要审核程序员发布的SQL语句,所以收集了一些程序员的一些常见问题,还有一些平时收集的其它一些问题,这也是很多人容易忽视的问题,在以后收集到的问题会补充在文章末尾,欢迎关注,由于收集的问 ...