通过livy向CDH集群的spark提交任务

场景

产品中需要通过前端界面选择执行某种任务(spark任务),然后通过livy 的restful api 提交集群的spark任务

简单介绍下livy,翻译自官网:

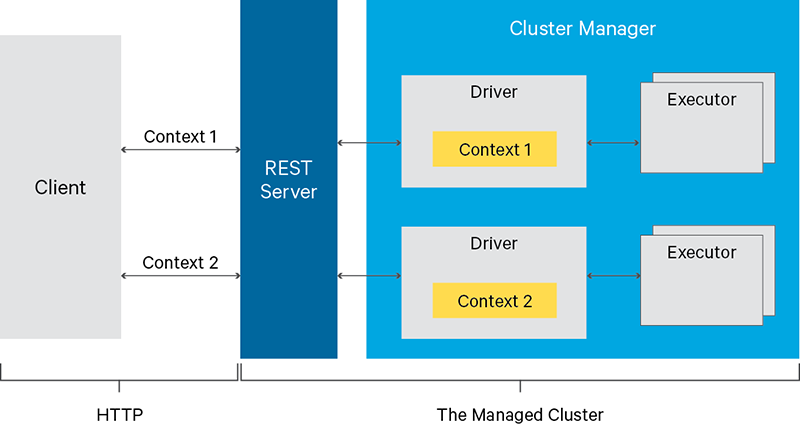

Livy是基于Apache许可的一个服务,它可以让远程应用通过REST API比较方便的与Spark集群交互。通过简单的REST接口或RPC客户端库,它可以让你轻松的提交Spark作业或者Spark代码片段,同步或者异步的结果检索,以及SparkContext管理。Livy还简化了Spark和应用程序服务器之间的交互,从而为web/mobile应用简化Spark架构。

主要功能有:

1.由多个客户端为多个Spark作业使用长时间运行的SparkContexts。

2.同时管理多个SparkContexts,让它们在集群中(YARN/Mesos)运行,从而实现很好的容错和并发,而不是在Livy服务上运行。

3.预编译的jars,代码片段或者Java/Scala客户端API都可以用来提交作业。

4.安全认证的通信。(比如kerberos)

livy的rest api比较多(参考链接),这里介绍其中一种

代码如下:

<dependency> <groupId>org.apache.httpcomponents</groupId> <artifactId>httpclient</artifactId> <version>4.5.4</version> </dependency> <!-- https://mvnrepository.com/artifact/com.alibaba/fastjson --> <dependency> <groupId>com.alibaba</groupId> <artifactId>fastjson</artifactId> <version>1.2.47</version> </dependency>

package cn.com.dtmobile.livy;

import java.io.BufferedReader;

import java.io.DataOutputStream;

import java.io.IOException;

import java.io.InputStreamReader;

import java.net.HttpURLConnection;

import java.net.URL;

import com.alibaba.fastjson.JSON;

import com.alibaba.fastjson.JSONObject;

public class HttpUtils {

public static HttpURLConnection init(HttpURLConnection conn){

conn.setDoInput(true);

conn.setDoOutput(true);

conn.setRequestProperty("charset","utf-8");

conn.setRequestProperty("Content-Type","application/json");

return conn;

}

/**

* HttpGET请求

*/

public static JSONObject getAccess(String urlStr) {

HttpURLConnection conn = null;

BufferedReader in = null;

StringBuilder builder = null;

JSONObject response = null;

try {

URL url = new URL(urlStr);

conn = init((HttpURLConnection) url.openConnection());

conn.setRequestMethod("GET");

conn.connect();

in = new BufferedReader(new InputStreamReader(conn.getInputStream(), "utf-8"));

String line = "";

builder = new StringBuilder();

while((line = in.readLine()) != null){

builder.append(line);

}

response = JSON.parseObject(builder.toString());

}catch (Exception e){

e.printStackTrace();

}finally {

if (conn!=null)

conn.disconnect();

try {

if (in != null)

in.close();

} catch (IOException e) {

e.printStackTrace();

}

}

return response;

}

/**

* HttpDelete请求

*/

public static Boolean deleteAccess(String urlStr) {

HttpURLConnection conn = null;

try {

URL url = new URL(urlStr);

conn = init((HttpURLConnection) url.openConnection());

conn.setRequestMethod("DELETE");

conn.connect();

conn.getInputStream().close();

conn.disconnect();

}catch (Exception e){

e.printStackTrace();

return false;

}

return true;

}

/**

* HttpPost请求

*/

public static String postAccess(String urlStr, JSONObject data) {

HttpURLConnection conn = null;

BufferedReader in = null;

StringBuilder builder = null;

DataOutputStream out = null;

try {

URL url = new URL(urlStr);

conn = init((HttpURLConnection) url.openConnection());

conn.setRequestMethod("POST");

conn.connect();

out = new DataOutputStream(conn.getOutputStream());

out.write(data.toString().getBytes("utf8"));

out.flush();

in = new BufferedReader(new InputStreamReader(conn.getInputStream(), "utf-8"));

String line = "";

builder = new StringBuilder();

while((line = in.readLine()) != null){

builder.append(line);

}

}catch (Exception e){

e.printStackTrace();

}finally {

if (conn!= null)

conn.disconnect();

try {

if (in!=null)

in.close();

if (out!=null)

out.close();

} catch (IOException e) {

e.printStackTrace();

}

}

if (builder != null)

return builder.toString();

return "";

}

}

package cn.com.dtmobile.livy;

import com.alibaba.fastjson.JSON;

import com.alibaba.fastjson.JSONException;

import com.alibaba.fastjson.JSONObject;

public class LivyApp {

static String host = "http://172.xx.x.xxx:8998";

public static int submitJob() throws JSONException {

JSONObject data = new JSONObject();

JSONObject conf = new JSONObject();

conf.put("spark.master","yarn-cluster");

data.put("conf",conf);

data.put("proxyUser","etluser");

data.put("file","/kong/data/jar/your_jar.jar");// 指定执行的spark jar (hdfs路径)

data.put("jars",new String[]{"/kong/data/jar/dbscan-on-spark_2.11-0.2.0-SNAPSHOT.jar"});//指定spark jar依赖的外部jars

data.put("className", "cn.com.dtmobile.spark.App");

data.put("name","jonitsiteplan");

data.put("executorCores",3);

data.put("executorMemory","2g");

data.put("driverCores",1);

data.put("driverMemory","4g");

data.put("numExecutors",6);

data.put("queue","default");

data.put("args",new String[]{"杭州","yj_hangzhou","2019041719"});//传递参数

String res = HttpUtils.postAccess(host + "/batches", data);

JSONObject resjson = JSON.parseObject(res);

System.out.println("id:"+resjson.getIntValue("id"));

return resjson.getIntValue("id");

}

public static void getJobInfo(int id){

// JSONObject response = HttpUtils.getAccess(host + "/batches/3");

// System.out.print(response.toString(1));

// JSONObject log = HttpUtils.getAccess(host + "/batches/3/log");

// System.out.print(log.toString(1));

JSONObject state = HttpUtils.getAccess(host + "/batches/"+id+"/state");

System.out.println(state.getString("state"));

}

public static void killJob(int id){

// 可以直接kill掉spark任务

if(HttpUtils.deleteAccess(host+"/batches/"+id)) {

System.out.println("kill spark job success");

}

}

public static void main(String[] args) {

int id = submitJob();

while(true) {

try {

getJobInfo(id);

Thread.sleep(10000);

} catch (InterruptedException e) {

}

}

// killJob(9);

}

}

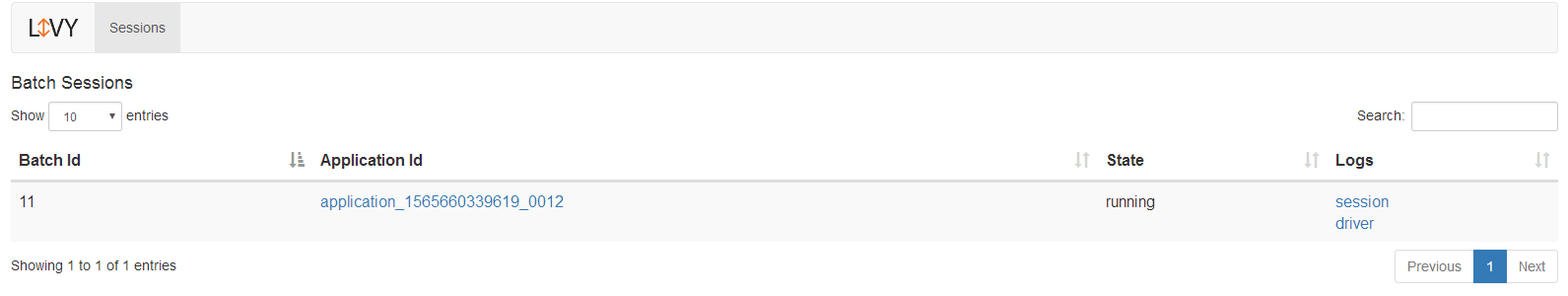

执行提交以后,可以在livy的UI界面上任务的状态,也可以通过api轮询的获取任务状态,以及任务的输出日志

yarn界面

通过livy向CDH集群的spark提交任务的更多相关文章

- CDH集群安装&测试总结

0.绪论 之前完全没有接触过大数据相关的东西,都是书上啊,媒体上各种吹嘘啊,我对大数据,集群啊,分布式计算等等概念真是高山仰止,充满了仰望之情,觉得这些东西是这样的: 当我搭建的过程中,发现这些东西是 ...

- CDH集群中YARN的参数配置

CDH集群中YARN的参数配置 前言:Hadoop 2.0之后,原先的MapReduce不在是简单的离线批处理MR任务的框架,升级为MapReduceV2(Yarn)版本,也就是把资源调度和任务分发两 ...

- CentOS7安装CDH 第七章:CDH集群Hadoop的HA配置

相关文章链接 CentOS7安装CDH 第一章:CentOS7系统安装 CentOS7安装CDH 第二章:CentOS7各个软件安装和启动 CentOS7安装CDH 第三章:CDH中的问题和解决方法 ...

- 相同版本的CDH集群间迁移hdfs以及hbase

前言 由于项目数据安全的需要,这段时间看了下hadoop的distcp的命令使用,不断的纠结的问度娘,度娘告诉我的结果也让我很纠结,都是抄来抄去, 还好在牺牲大量的时间的基础上还终于搞出来了,顺便写这 ...

- 朝花夕拾之--大数据平台CDH集群离线搭建

body { border: 1px solid #ddd; outline: 1300px solid #fff; margin: 16px auto; } body .markdown-body ...

- CDH集群频繁告警(host频繁swapping)

最近CDH集群频繁告警,原因是某些host频繁swapping,极大影响了集群的性能. 后来发现有个设置(/proc/sys/vm/swappiness)需要修改,默认值60 Setting the ...

- Cloudera Manager安装_搭建CDH集群

2017年2月22日, 星期三 Cloudera Manager安装_搭建CDH集群 cpu 内存16G 内存12G 内存8G 默认单核单线 CDH1_node9 Server || Agent ...

- CDH集群搭建部署

1. 硬件准备 使用了五台机器,其中两台8c16g,三台4c8g.一台4c8g用于搭建cmServer和NFS服务端,另外4台作为cloudera-manager agent部署CDH集群. ...

- Spark集群模式&Spark程序提交

Spark集群模式&Spark程序提交 1. 集群管理器 Spark当前支持三种集群管理方式 Standalone-Spark自带的一种集群管理方式,易于构建集群. Apache Mesos- ...

随机推荐

- 浅谈ActiveMQ与使用

一.什么是消息中间件 消息中间件顾名思义实现的就是在两个系统或两个客户端之间进行消息传送 二.什么是ActiveMQ ActiveMQ是一种开源的基于JMS(Java Message Servie)规 ...

- Java:前程似锦的 NIO 2.0

Java 之所以能够霸占编程语言的榜首,其强大.丰富的类库功不可没,几乎所有的编程问题都能在其中找到解决方案.但在早期的版本当中,输入输出(I/O)流并不那么令开发者感到愉快: 1)JDK 1.4 之 ...

- mysql8.0忘记密码如何操作?

很不幸,刚安装了MYSQL8,由于密码验证方式的不同,自己折腾了一小会,不小心退出来了,进不去了.从网上面查了一下资料,好多都不是特别好使,最后摸索出来可以进行如下操作: 1. 在配置文件中设置将密码 ...

- java读写文件小心缓存数组

一般我们读写文件的时候都是这么写的,看着没问题哈. public static void main(String[] args) throws Exception { FileInputStr ...

- rabbitMQ_topic(五)

主题转发器 发送到主题转发器的消息不能有任意的 routing_key - 它必须是由点分隔的单词列表.这些单词可以是任何东西,但通常它们指定与消息相关联的一些功能.几个有效的routeKey示例:“ ...

- Linux平台 Oracle 19c RAC安装Part1:准备工作

一.实施前期准备工作 1.1 服务器安装操作系统 1.2 Oracle安装介质 1.3 共享存储规划 1.4 网络规范分配 二.安装前期准备工作 2.1 各节点系统时间校对 2.2 各节点关闭防火墙和 ...

- 【iOS】安装 CocoaPods

1. 打开 terminal 2. 移除现有 Ruby 默认源 $ gem sources --remove https://rubygems.org/ 3. 使用新的源 $ gem sources ...

- 显示Mac隐藏文件的命令:

设置查看隐藏文件的方法如下:打开终端,输入命名 显示Mac隐藏文件的命令:defaults write com.apple.finder AppleShowAllFiles -bool true 隐藏 ...

- 利用dockerfile 安装一个nginx-1.14.1

FROM docker.io/centos MAINTAINER jim 107420988@qq.com ENV TZ "Asia/Shanghai" #ENV TERM xte ...

- Pyinstaller 打包工具的使用!!!

打包成一个文件夹: pyinstaller xxx.py 打包成单个文件: pyinstaller -F xxx.py 打包成不显示终端的单个文件: pyinstaller -F -w xxx.py ...