Spark学习之路 (十六)SparkCore的源码解读(二)spark-submit提交脚本

一、概述

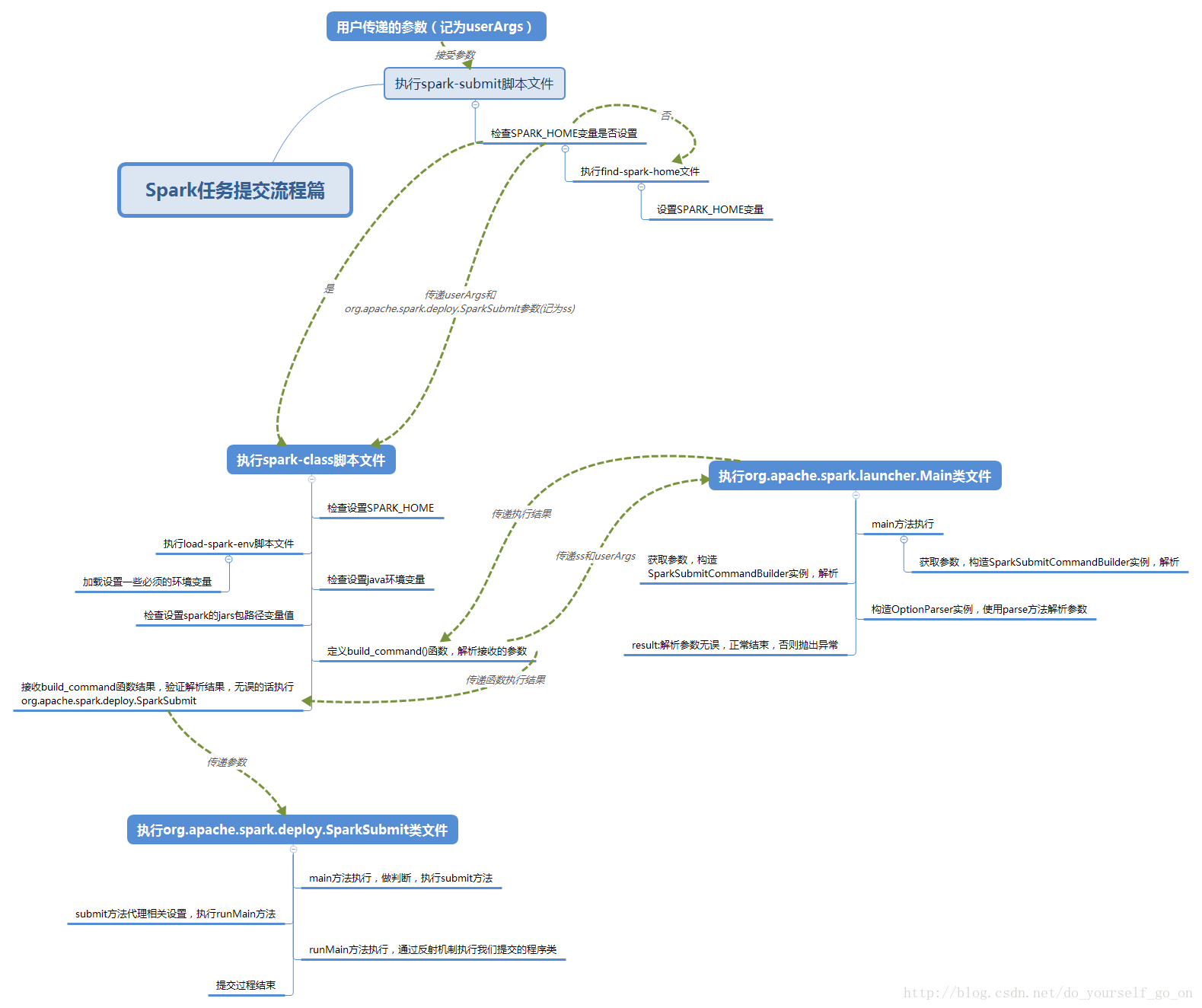

上一篇主要是介绍了spark启动的一些脚本,这篇主要分析一下Spark源码中提交任务脚本的处理逻辑,从spark-submit一步步深入进去看看任务提交的整体流程,首先看一下整体的流程概要图:

二、源码解读

2.1 spark-submit

# -z是检查后面变量是否为空(空则真) shell可以在双引号之内引用变量,单引号不可

#这一步作用是检查SPARK_HOME变量是否为空,为空则执行then后面程序

#source命令: source filename作用在当前bash环境下读取并执行filename中的命令

#$0代表shell脚本文件本身的文件名,这里即使spark-submit

#dirname用于取得脚本文件所在目录 dirname $0取得当前脚本文件所在目录

#$(命令)表示返回该命令的结果

#故整个if语句的含义是:如果SPARK_HOME变量没有设置值,则执行当前目录下的find-spark-home脚本文件,设置SPARK_HOME值

if [ -z "${SPARK_HOME}" ]; then

source "$(dirname "$")"/find-spark-home

fi # disable randomized hash for string in Python 3.3+

export PYTHONHASHSEED=

#执行spark-class脚本,传递参数org.apache.spark.deploy.SparkSubmit 和"$@"

#这里$@表示之前spark-submit接收到的全部参数

exec "${SPARK_HOME}"/bin/spark-class org.apache.spark.deploy.SparkSubmit "$@"

所以spark-submit脚本的整体逻辑就是:

首先 检查SPARK_HOME是否设置;if 已经设置 执行spark-class文件 否则加载执行find-spark-home文件

2.2 find-spark-home

#定义一个变量用于后续判断是否存在定义SPARK_HOME的python脚本文件

FIND_SPARK_HOME_PYTHON_SCRIPT="$(cd "$(dirname "$0")"; pwd)/find_spark_home.py" # Short cirtuit if the user already has this set.

##如果SPARK_HOME为不为空值,成功退出程序

if [ ! -z "${SPARK_HOME}" ]; then

exit

# -f用于判断这个文件是否存在并且是否为常规文件,是的话为真,这里不存在为假,执行下面语句,给SPARK_HOME变量赋值

elif [ ! -f "$FIND_SPARK_HOME_PYTHON_SCRIPT" ]; then

# If we are not in the same directory as find_spark_home.py we are not pip installed so we don't

# need to search the different Python directories for a Spark installation.

# Note only that, if the user has pip installed PySpark but is directly calling pyspark-shell or

# spark-submit in another directory we want to use that version of PySpark rather than the

# pip installed version of PySpark.

export SPARK_HOME="$(cd "$(dirname "$0")"/..; pwd)"

else

# We are pip installed, use the Python script to resolve a reasonable SPARK_HOME

# Default to standard python interpreter unless told otherwise

if [[ -z "$PYSPARK_DRIVER_PYTHON" ]]; then

PYSPARK_DRIVER_PYTHON="${PYSPARK_PYTHON:-"python"}"

fi

export SPARK_HOME=$($PYSPARK_DRIVER_PYTHON "$FIND_SPARK_HOME_PYTHON_SCRIPT")

fi

可以看到,如果事先用户没有设定SPARK_HOME的值,这里程序也会自动设置并且将其注册为环境变量,供后面程序使用

当SPARK_HOME的值设定完成之后,就会执行Spark-class文件,这也是我们分析的重要部分,源码如下:

2.3 spark-class

#!/usr/bin/env bash

#依旧是检查设置SPARK_HOME的值

if [ -z "${SPARK_HOME}" ]; then

source "$(dirname "$")"/find-spark-home

fi

#执行load-spark-env.sh脚本文件,主要目的在于加载设定一些变量值

#设定spark-env.sh中的变量值到环境变量中,供后续使用

#设定scala版本变量值

. "${SPARK_HOME}"/bin/load-spark-env.sh # Find the java binary

#检查设定java环境值

#-n代表检测变量长度是否为0,不为0时候为真

#如果已经安装Java没有设置JAVA_HOME,command -v java返回的值为${JAVA_HOME}/bin/java

if [ -n "${JAVA_HOME}" ]; then

RUNNER="${JAVA_HOME}/bin/java"

else

if [ "$(command -v java)" ]; then

RUNNER="java"

else

echo "JAVA_HOME is not set" >&

exit

fi

fi # Find Spark jars.

#-d检测文件是否为目录,若为目录则为真

#设置一些关联Class文件

if [ -d "${SPARK_HOME}/jars" ]; then

SPARK_JARS_DIR="${SPARK_HOME}/jars"

else

SPARK_JARS_DIR="${SPARK_HOME}/assembly/target/scala-$SPARK_SCALA_VERSION/jars"

fi if [ ! -d "$SPARK_JARS_DIR" ] && [ -z "$SPARK_TESTING$SPARK_SQL_TESTING" ]; then

echo "Failed to find Spark jars directory ($SPARK_JARS_DIR)." >&

echo "You need to build Spark with the target \"package\" before running this program." >&

exit

else

LAUNCH_CLASSPATH="$SPARK_JARS_DIR/*"

fi # Add the launcher build dir to the classpath if requested.

if [ -n "$SPARK_PREPEND_CLASSES" ]; then

LAUNCH_CLASSPATH="${SPARK_HOME}/launcher/target/scala-$SPARK_SCALA_VERSION/classes:$LAUNCH_CLASSPATH"

fi # For tests

if [[ -n "$SPARK_TESTING" ]]; then

unset YARN_CONF_DIR

unset HADOOP_CONF_DIR

fi # The launcher library will print arguments separated by a NULL character, to allow arguments with

# characters that would be otherwise interpreted by the shell. Read that in a while loop, populating

# an array that will be used to exec the final command.

#

# The exit code of the launcher is appended to the output, so the parent shell removes it from the

# command array and checks the value to see if the launcher succeeded.

#执行类文件org.apache.spark.launcher.Main,返回解析后的参数

build_command() {

"$RUNNER" -Xmx128m -cp "$LAUNCH_CLASSPATH" org.apache.spark.launcher.Main "$@"

printf "%d\0" $?

} # Turn off posix mode since it does not allow process substitution

#将build_command方法解析后的参数赋给CMD

set +o posix

CMD=()

while IFS= read -d '' -r ARG; do

CMD+=("$ARG")

done < <(build_command "$@") COUNT=${#CMD[@]}

LAST=$((COUNT - ))

LAUNCHER_EXIT_CODE=${CMD[$LAST]} # Certain JVM failures result in errors being printed to stdout (instead of stderr), which causes

# the code that parses the output of the launcher to get confused. In those cases, check if the

# exit code is an integer, and if it's not, handle it as a special error case.

if ! [[ $LAUNCHER_EXIT_CODE =~ ^[-]+$ ]]; then

echo "${CMD[@]}" | head -n- >&

exit

fi if [ $LAUNCHER_EXIT_CODE != ]; then

exit $LAUNCHER_EXIT_CODE

fi CMD=("${CMD[@]:0:$LAST}")

#执行CMD中的某个参数类org.apache.spark.deploy.SparkSubmit

exec "${CMD[@]}"

spark-class文件的执行逻辑稍显复杂,总体上应该是这样的:

检查SPARK_HOME的值----》执行load-spark-env.sh文件,设定一些需要用到的环境变量,如scala环境值,这其中也加载了spark-env.sh文件-------》检查设定java的执行路径变量值-------》寻找spark jars,设定一些引用相关类的位置变量------》执行类文件org.apache.spark.launcher.Main,返回解析后的参数给CMD-------》判断解析参数是否正确(代表了用户设置的参数是否正确)--------》正确的话执行org.apache.spark.deploy.SparkSubmit这个类

2.4 SparkSubmit

2.1最后提交语句,D:\src\spark-2.3.0\core\src\main\scala\org\apache\spark\deploy\SparkSubmit.scala

exec "${SPARK_HOME}"/bin/spark-class org.apache.spark.deploy.SparkSubmit "$@"

override def main(args: Array[String]): Unit = {

// Initialize logging if it hasn't been done yet. Keep track of whether logging needs to

// be reset before the application starts.

val uninitLog = initializeLogIfNecessary(true, silent = true)

//拿到submit脚本传入的参数

val appArgs = new SparkSubmitArguments(args)

if (appArgs.verbose) {

// scalastyle:off println

printStream.println(appArgs)

// scalastyle:on println

}

//根据传入的参数匹配对应的执行方法

appArgs.action match {

//根据传入的参数提交命令

case SparkSubmitAction.SUBMIT => submit(appArgs, uninitLog)

//只有standalone和mesos集群模式才触发

case SparkSubmitAction.KILL => kill(appArgs)

//只有standalone和mesos集群模式才触发

case SparkSubmitAction.REQUEST_STATUS => requestStatus(appArgs)

}

}

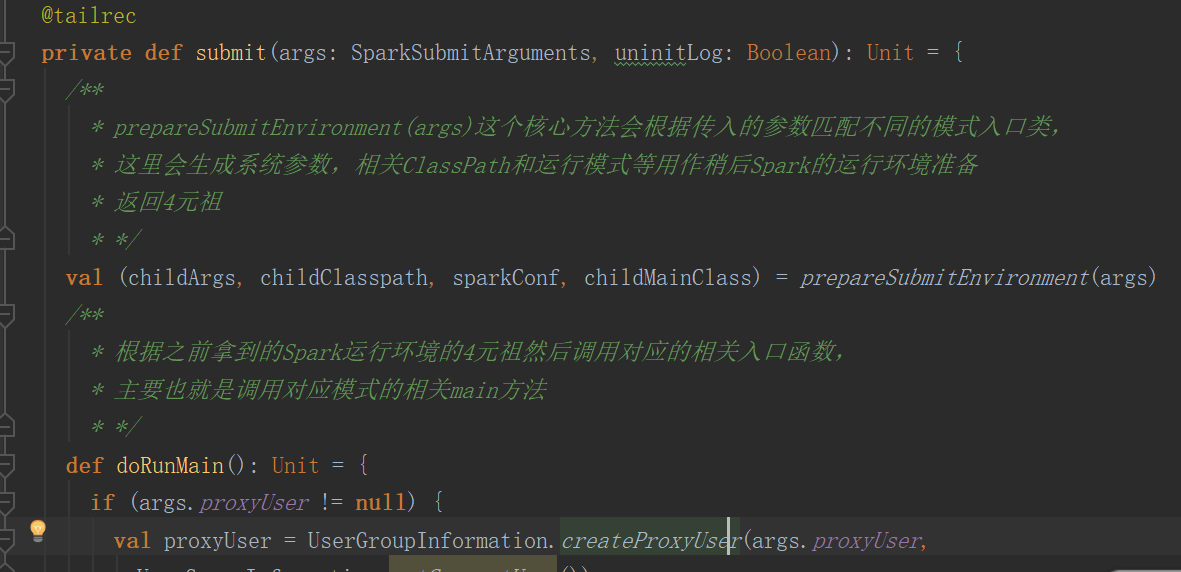

2.4.1 submit十分关键,主要分为两步骤

(1)调用prepareSubmitEnvironment

(2)调用doRunMain

Spark学习之路 (十六)SparkCore的源码解读(二)spark-submit提交脚本的更多相关文章

- Spark学习之路 (十五)SparkCore的源码解读(一)启动脚本

一.启动脚本分析 独立部署模式下,主要由master和slaves组成,master可以利用zk实现高可用性,其driver,work,app等信息可以持久化到zk上:slaves由一台至多台主机构成 ...

- Alink漫谈(十六) :Word2Vec源码分析 之 建立霍夫曼树

Alink漫谈(十六) :Word2Vec源码分析 之 建立霍夫曼树 目录 Alink漫谈(十六) :Word2Vec源码分析 之 建立霍夫曼树 0x00 摘要 0x01 背景概念 1.1 词向量基础 ...

- Spark(十五)SparkCore的源码解读

一.启动脚本分析 独立部署模式下,主要由master和slaves组成,master可以利用zk实现高可用性,其driver,work,app等信息可以持久化到zk上:slaves由一台至多台主机构成 ...

- Spark学习之路 (六)Spark Transformation和Action

Transformation算子 基本的初始化 java static SparkConf conf = null; static JavaSparkContext sc = null; static ...

- Spark学习之路(六)—— 累加器与广播变量

一.简介 在Spark中,提供了两种类型的共享变量:累加器(accumulator)与广播变量(broadcast variable): 累加器:用来对信息进行聚合,主要用于累计计数等场景: 广播变量 ...

- Spark学习之路 (六)Spark Transformation和Action[转]

Transformation算子 基本的初始化 (1)java static SparkConf conf = null; static JavaSparkContext sc = null; sta ...

- 嵌入式Linux驱动学习之路(十六)输入子系统

以前写的一些输入设备的驱动都是采用字符设备处理的.问题由此而来,Linux开源社区的大神们看到了这大量输入设备如此分散不堪,有木有可以实现一种机制,可以对分散的.不同类别的输入设备进行统一的驱动,所以 ...

- IOS学习之路十六(UItableView 通过Prepare for segue 页面传值)

当你点击一个UITableView 的section 或者cell的时候希望把值传到另一个页面(页面是通过segue跳转的),可以通过prepareforsegure 方法传值 (我的UITableV ...

- JAVA学习第四十六课 — 其它对象API(二)Date类 & Calendar类(重点掌握)

Date类(重点) 开发时,会时常遇见时间显示的情况,所以必须熟练Date的应用 <span style="font-family:KaiTi_GB2312;font-size:18p ...

随机推荐

- Qt5线程错误:QThread: Destroyed while thread is still running(执行runThread->exit(0))

背景: 当前类,编写接收子线程类信号的槽函数和触发子线程类执行的信号: 新建一个子线程类,编写槽函数和信号,MyClass *m_MyClass=new MyClass(): 新建一个线程对象QThr ...

- 根据后台加载数据,添加loading动画

<script> var current = 0; var hit = @hits; $(this).scroll(function(){ var viewHeight =$(this). ...

- swift 相机、相册、定位的权限判断

//是否开启相机权限 func IsOpenCamera() -> Bool{ let authStatus = AVCaptureDevice.authorizationStatus(for: ...

- mysql 设置 innodb_print_all_deadlocks=ON, 保存死锁日志

Introduced 5.6.2 Command-Line Format --innodb-print-all-deadlocks=# System Variable Name innodb_prin ...

- dispatch_queue_set_specific可重入的gcd

有时候我们很希望知道当前执行的queue是谁,比如UI操作需要放在main queue中执行.如果可以知道当前工作的queue是谁,就可以很方便的指定一段代码操作在特定的queue中执行.这种做法让G ...

- 【SQL】如何使用SQL like 方法和SQL [charlist] 通配符(SQL like的拓展)

1.like 相关用法 '%a' //以a结尾的数据 'a%' //以a开头的数据 '%a%' //含有a的数据 ‘_a_’ //三位且中间字母是a的 '_a' //两位 ...

- du 查看文件大小

[root@localhost ~]# du -sh /etc # 查看目录下所有文件大小 [root@localhost ~]# du -sh * # 查看所有文件大小

- 20181223 Oracle中while

最近尝试了一次while跑数, declare sysdataend date:=system-1; startdata date:=to_date('20181214','YYYYMMDD'); ...

- darknet的安装及报错解决

darknet 是YOLO网络的一个框架,安装见官网:https://pjreddie.com/darknet/ 跟着步骤就可以安装好了. 由于官网是全英文的,所以本文根据官网进行中文释义. 本人在按 ...

- dll相关总结

1.动态链接库的使用有两种方式,一种是显式调用.一种是隐式调用. (1) 显式调用:使用LoadLibrary载入动态链接库.使用GetProcAddress获取某函数地址. (2) 隐式调用:可以使 ...