Solr6 +mmseg4j+IK-Analyzer + SQLserver +DIH 完全配置

如今做任何一个系统都有搜索,而搜索界有著名的三剑客: solr/elasticsearch/sphinx

solr/elasticsearch 为同一类的,都是基于lucene开发的产品,本人也早在几年前用过solr做过类似中关村的产品搜索,faceting功能非常好用.

近期手头上又有个项目要搭建搜索,由于几年没摸过Solr,如今再次打开官网已觉得很陌生,不仅主页换漂亮了,版本更是到了6.1 ,还有了 solr cloud的概念!!

废话不多说,首先来介绍下环境配置:

1. 去 http://www.apache.org/dyn/closer.lua/lucene/solr/6.1.0 下载zip,解压放到你想放的位置, 我放到了E盘根目录

2. 设置环境变量PATH: E:\solr-6.1.0\bin , 这是为了方便在命令行里面可以直接找到 solr 命令

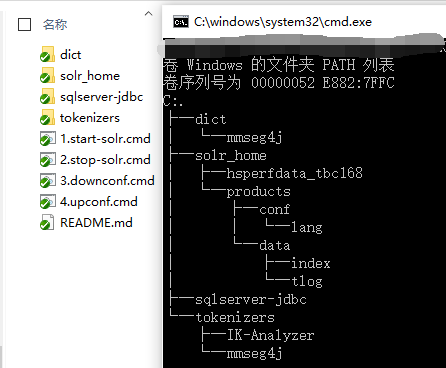

3. 任意位置创建一个目录,该目录包含以下内容

1). IK+mmseg4j的字典

2).sqlserver jdbc 驱动

3).最新版的 ik+mmseg4j 的 jar包

然后在目录下创建一个 1.start-solr.cmd (你喜欢的名字),内容如下:

solr start -h localhost -p 58983 -m 1g -s "%~dp0solr_home" -noprompt -V

双击运行(如果目录是需要管理员权限的, 有可能需要管理方式运行)

下面来说说具体配置

solrconfig.xml (\solr_home\products\conf\solrconfig.xml)

该配置文件是放到core里面的,我新建一个products的core

把所有依赖的jar包配置进去

<lib dir="${solr.install.dir:../../../..}/dist/" regex="solr-dataimporthandler-.*\.jar" />

<!--同时兼容mmseg4j+ik中文分词器-->

<lib dir="${solr.solr.home}/../tokenizers/mmseg4j" regex=".*\.jar" />

<lib dir="${solr.solr.home}/../tokenizers/IK-Analyzer" regex=".*\.jar" />

<lib dir="${solr.solr.home}/../sqlserver-jdbc" regex=".*\.jar" />

启用DIH,这里要注意这个功能依赖上面的 solr-dataimporthandler-xx.jar 配置

<!--启用DIH数据导入-->

<requestHandler name="/dataimport" class="solr.DataImportHandler">

<lst name="defaults">

<str name="config">db-data-config.xml</str>

</lst>

</requestHandler>

以下是solr6里面,如果要手动修改schame.xml配置时要替换的,详见注释链接

<!-- 这里需要配置这个,https://cwiki.apache.org/confluence/display/solr/Schema+Factory+Definition+in+SolrConfig -->

<schemaFactory class="ClassicIndexSchemaFactory"/>

schema.xml 配置

<!--以下定义中文分词器及各自的词典配置-->

<fieldtype name="mmseg4jComplex" class="solr.TextField" positionIncrementGap="100">

<analyzer>

<tokenizer class="com.chenlb.mmseg4j.solr.MMSegTokenizerFactory" mode="complex" dicPath="${solr.solr.home:}/../dict/mmseg4j" />

</analyzer>

</fieldtype>

<fieldtype name="mmseg4jMaxWord" class="solr.TextField" positionIncrementGap="100">

<analyzer>

<tokenizer class="com.chenlb.mmseg4j.solr.MMSegTokenizerFactory" mode="max-word" dicPath="${solr.solr.home:}/../dict/mmseg4j" />

</analyzer>

</fieldtype>

<fieldtype name="mmseg4jSimple" class="solr.TextField" positionIncrementGap="100">

<analyzer>

<tokenizer class="com.chenlb.mmseg4j.solr.MMSegTokenizerFactory" mode="simple" dicPath="${solr.solr.home:}/../dict/mmseg4j" />

</analyzer>

</fieldtype> <fieldType name="text_ik" class="solr.TextField">

<!--索引时候的分词器-->

<analyzer type="index">

<tokenizer class="org.wltea.analyzer.util.IKTokenizerFactory" useSmart="true"/>

</analyzer>

<!--查询时候的分词器-->

<analyzer type="query">

<tokenizer class="org.wltea.analyzer.util.IKTokenizerFactory" useSmart="false"/>

</analyzer>

</fieldType>

db-data-config.xml

<dataConfig>

<dataSource type="JdbcDataSource"

driver="com.microsoft.sqlserver.jdbc.SQLServerDriver"

url="jdbc:sqlserver://127.0.0.1:1433;databaseName=xxdb;"

user="dev"

password="111111"

batchSize="100" />

<document>

<entity name="product" query="select [id],[name],[brief],[description] from [products]"

deltaQuery="select id from [products] where [lastmodificationtime] > '${dataimporter.last_index_time}'">

<field column="name" name="name" />

<field column="brief" name="brief" />

<field column="description" name="description" />

</entity>

</document>

</dataConfig>

以上配置内包含的路径均没有写死, 使用的占位符, 可用的占位符可以在 solr admin ui 的 dashboard JVM 栏看到

!!!!!!!!!!!!!!!!!前方高能!!!!!!附件说明!!!!!!!!!!

(一定要先配置PATH环境变量后再双击)

Solr6 +mmseg4j+IK-Analyzer + SQLserver +DIH 完全配置的更多相关文章

- 转:solr6.0配置中文分词器IK Analyzer

solr6.0中进行中文分词器IK Analyzer的配置和solr低版本中最大不同点在于IK Analyzer中jar包的引用.一般的IK分词jar包都是不能用的,因为IK分词中传统的jar不支持s ...

- 我与solr(六)--solr6.0配置中文分词器IK Analyzer

转自:http://blog.csdn.net/linzhiqiang0316/article/details/51554217,表示感谢. 由于前面没有设置分词器,以至于查询的结果出入比较大,并且无 ...

- 安装elasticsearch及中文IK和近义词配置

安装elasticsearch及中文IK和近义词配置 安装java环境 java环境是elasticsearch安装必须的 yum install java-1.8.0-openjdk 安装elast ...

- Solr学习(2) Solr4.2.0+IK Analyzer 2012

Solr学习(二) Solr4.2.0+IK Analyzer 2012 开场白: 本章简单讲述如何在solr中配置著名的 IK Analyzer 分词器. 本章建立在 Solr学习(一) 基础上进 ...

- Lucene全文搜索之分词器:使用IK Analyzer中文分词器(修改IK Analyzer源码使其支持lucene5.5.x)

注意:基于lucene5.5.x版本 一.简单介绍下IK Analyzer IK Analyzer是linliangyi2007的作品,再此表示感谢,他的博客地址:http://linliangyi2 ...

- 安装elasticsearch-1.7.1及中文IK和近义词配置

安装elasticsearch及中文IK和近义词配置 https://www.cnblogs.com/yjf512/p/4789239.html 安装elasticsearch及中文IK和近义词配置 ...

- ElasticSearch7.3学习(十五)----中文分词器(IK Analyzer)及自定义词库

1. 中文分词器 1.1 默认分词器 先来看看ElasticSearch中默认的standard 分词器,对英文比较友好,但是对于中文来说就是按照字符拆分,不是那么友好. GET /_analyze ...

- SharePoint 2013+ Sqlserver 2014 Kerberos 配置传奇, 最终的解决方案 验证。

SharePoint 2013+ Sqlserver 2014 Kerberos 配置传奇. 1,安装数据库,我就不多说安装,客户一定要注意. 我将参照以下实施例和账户. 2,建立DNS,假设没有DN ...

- Win7下Solr4.10.1和IK Analyzer中文分词

1.下载IK中文分词压缩包IK Analyzer 2012FF_hf1,并解压到D:\IK Analyzer 2012FF_hf1: 2.将D:\IK Analyzer 2012FF_hf1\IKAn ...

随机推荐

- 【NOIP1999】邮票面值设计 dfs+dp

题目传送门 这道题其实就是找一波上界比较麻烦 用一波 背包可以推出上界mx 所以新加入的物品价值一旦大于mx+1,显然就会出现断层,所以可以以maxm+1为枚举上界,然后这样进行下一层的dfs. 这样 ...

- [BZOJ1005]Prufer数列+排列组合

一棵树的Prufer数列 每次在剩下的树中找到标号最小的叶子节点(对于无根树而言即是度数为1的节点),删去. 同时将其父节点(即与其相连的唯一点)加入Prufer数列当中. 一个Prufer数列所对应 ...

- linux基础之nginx和nfs服务

第一部分: 一.nginx服务安装nginx包(源码安装)1.先cd /etc/yum.repos.d目录下2.yum install epel-release -y(安装扩展包)3.yum in ...

- swift关于is和as的解释

http://tieba.baidu.com/p/3155277323 在Swift中,类型检查使用is和as操作符来实现. is操作符用来检查一个实例是否是某种特定类型,如果是返回true,否则返回 ...

- linux 中解析命令行参数(getopt_long用法)

linux 中解析命令行参数(getopt_long用法) http://www.educity.cn/linux/518242.html 详细解析命令行的getopt_long()函数 http:/ ...

- Jenkins安装配置过程及问题详解

1:去官网下载jenkins.war包. 官网地址:http://Jenkins-ci.org/ 下载win版 官网镜像地址:http://mirrors.jenkins-ci.org/war-sta ...

- DECODE 与CASE WHEN 的比较以及用法

1.DECODE 只有Oracle 才有,其它数据库不支持; 2.CASE WHEN的用法, Oracle.SQL Server. MySQL 都支持; 3.DECODE 只能用做相等判断,但是可以配 ...

- iptables 用法及常用模块总结

iptables传输数据包的过程: 1. 当一个数据包进入网卡时,它首先进入PREROUTING链,内核根据数据包目的IP判断是否需要转送出去. 2. 如果数据包就是进入本机的,它就会沿着图向下移动, ...

- 【 总结 】linux中test命令详解

test命令在bash shell脚本中经常以中括号([])的形式出现,而且在脚本中使用字母来表示比符号表示更专业,出错率更低. 测试标志 代表意义 文件名.文件类型 -e 该文件名是否存在 -f 该 ...

- 基于tinkphp3.2获取openid

<?php namespace Home\Controller; use Think\Controller; /** * 基础 */ class BaseController extends C ...