spark数据清洗

spark数据清洗

1.Scala常用语法

运用maven创建项目,需要导入如下依赖:

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.11</artifactId>

<version>2.1.1</version>

</dependency>

main方法:

def main(args:Array[String]):Unit={ }

变量

var i:Int=1 //在类中自带get和set功能

val a:Int=2 //常量,在类中只有get功能

var arr:Array[String]=Array("abc","bcd","cde")

类型转换

var num:Int=20

var str:String=num.toString

var num2:Int=str.toInt

条件判断

var score:Int=88

if(score==100){

println("优秀")

}else if (score>=90){

println("良好")

}else{

println("继续加油")

}

循环:

//遍历arr

var arr=Array("java","python","scala")

//方式1

for(a<-arr){

println(a)

}

//方式2

arr.foreach(println) //循环1到1(包括1和10)

for(a<-1 to 10){

println(a)

}

元组

//声明赋值:

var t=(4.13,"hello",44)

//取值:

println(t._1) //4.13

println(t._2) //hello

函数:

def test(x:Int,y:Int):Int={

x+y //返回值时不需要加return

}

RDD的创建

//使用集合、数组创建RDD

val arr = Array(1,2,3,4,5)

val rdd = sc.parallelize(arr) 或者 val rdd = sc.makeRDD(arr)

rdd.collect() 转为数组

//通过外部存储创建RDD

//Hdfs上:

sc.textFile(“hdfs://master:9000/wordcount.txt”)

//本地测试

sc.textFile(“data/xxx.csv”)

//通过其他RDD得到新的RDD

val rdd = sc.parallielize(Array(1,2,3,4,5))

arl rdd2 = rdd.map(_*2)

2.常用方法

计数器:

//定义累加器:

val longAccum=sc.longAccumulator("count")

//累加器增加:

longAccum.add(1)//每次增加1

//获取累加器数据

print("累加器结果是:"+longAccum.value)

去重:distinct()

文本行数:count()

package com.xyz import org.apache.spark.{SparkConf, SparkContext} /**

* @author 小勇子start

* @create 2021-10-12 14:03

*/

object DistinctDemo {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local").setAppName("test1")

val sc=new SparkContext(sparkConf)

val rdd=sc.textFile("data/distinct.txt")

val count1:Long=rdd.count();

val rdd2=rdd.distinct()

val count2:Long=rdd2.count()

println("清除的数据条数有:"+(count1-count2)) //

rdd2.saveAsTextFile("data/out1")

sc.stop()

}

}

过滤:filter :false删除,true保留

package com.xyz import org.apache.spark.{SparkConf, SparkContext} /**

* @author 小勇子start

* @create 2021-10-12 14:03

*/

object FilterDemo {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local").setAppName("test1")

val sc = new SparkContext(sparkConf)

val longAccum=sc.longAccumulator("count")

val rdd = sc.textFile("data/test.txt")

val rdd2 = rdd.filter(!_.startsWith("id")) //过滤表头

//val rdd2=rdd.filter(!_.endsWith("e")) //过滤以“e”结尾的数据

val rdd3 = rdd2.filter(x => {//过滤分数小于50的科目

val str = x.split(",")

val score = str(2).toInt

if (score > 50)

true

else{

longAccum.add(1)

false

} })

rdd3.saveAsTextFile("data/out3")

print("分数小于50的数据条数是:"+longAccum.value)

sc.stop()

}

}

map() :适合用来格式化输出格式

package com.xyz import org.apache.spark.{SparkConf, SparkContext} /**

* @author 小勇子start

* @create 2021-10-12 14:03

*/

object MapDemo {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local").setAppName("test1")

val sc = new SparkContext(sparkConf)

val rdd = sc.textFile("data/test.txt")

val rdd2 = rdd.filter(!_.startsWith("id")) //过滤表头

val rdd3=rdd2.map(x=>{

val str=x.split(",")

val name=str(3)

val score=str(2)

val kc=str(1)

val newStr=name+","+score+","+kc

newStr

})

rdd3.saveAsTextFile("data/out4")

sc.stop()

}

}

排序:sortBy() ,填两个值,前一个填根据排序的字段,后一个填升降序,默认升序

package com.xyz import org.apache.spark.{SparkConf, SparkContext} /**

* @author 小勇子start

* @create 2021-10-12 14:03

*/

object sortByDemo {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local").setAppName("test1")

val sc = new SparkContext(sparkConf)

val rdd = sc.textFile("data/test.txt")

val rdd2 = rdd.filter(!_.startsWith("id"))

val rdd3=rdd2.map(x=>{

val str=x.split(",")

val name=str(3)

val score=str(2)

val kc=str(1)

val newStr=name+","+score+","+kc

newStr

}).sortBy(x=>x.split(",")(1),ascending = false)//降序,默认为true

rdd3.saveAsTextFile("data/out5")

sc.stop()

}

}

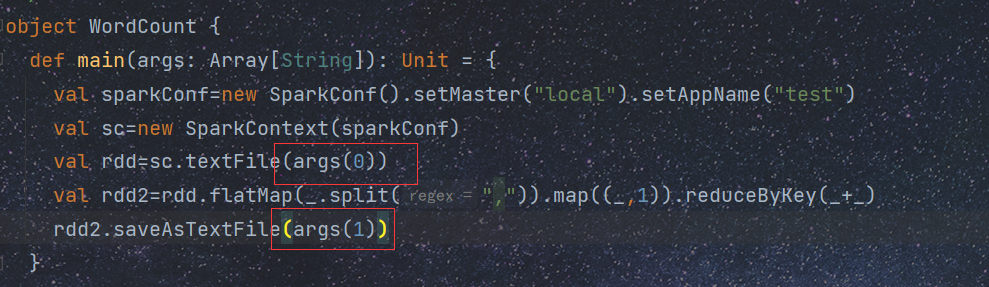

3.单词计数案例

package com.xyz

import org.apache.spark.{SparkConf, SparkContext}

/**

* @author 小勇子start

* @create 2021-10-12 21:22

*/

object WordCount {

def main(args: Array[String]): Unit = {

val sparkConf=new SparkConf().setMaster("local").setAppName("test")

val sc=new SparkContext(sparkConf)

val rdd=sc.textFile("data/test2.txt")

val rdd2=rdd.flatMap(_.split(",")).map((_,1)).reduceByKey(_+_)

//flatMap能把数据一次性读取出来,并按"," 分成若干个数据

//reduceByKey(_+_)表示每一个相同的key的value相加 _:代表key,1 :是value

//格式必须是:(k,v)才能使用该方法

rdd2.saveAsTextFile("data/out1")

}

}

4.求科目平均值案例

package com.xyz

import org.apache.spark.{SparkConf, SparkContext}

/**

* @author 小勇子start

* @create 2021-10-13 17:16

*/

object GroupByKeyDemo {

def main(args: Array[String]): Unit = {

val sparkConf=new SparkConf().setMaster("local").setAppName("test2")

val sc= new SparkContext(sparkConf)

val rdd=sc.textFile("data/test.txt")

val rdd2=rdd.map(x=>{

val str=x.split(",")

val km=str(1)

val score=str(2).toFloat

(km,score)

}).groupByKey().map(x=>{

val km=x._1

var allScore:Float=0;

for(i<-x._2){

allScore+=i

}

km+"的平均分为:"+allScore/x._2.size

})

rdd2.saveAsTextFile("data/out2")

}

}

//groupByKey 根据(k,v)中的k分组,将所有k相同的v都放入同一个iterate中保存起来,返回一个(k,iterate(v1,v2,v3))

5.join案例

package com.xyz

import org.apache.spark.{SparkConf, SparkContext}

/**

* @author 小勇子start

* @create 2021-10-13 18:41

*/

object JoinDemo{

def main(args: Array[String]): Unit = {

val sparkConf=new SparkConf().setMaster("local").setAppName("test4")

val sc= new SparkContext(sparkConf)

val rdd1=sc.textFile("data/test.txt")

val rdd2=sc.textFile("data/test_2.txt")

val rdd1_2=rdd1.map(x=>{

val str=x.split(",")

val id=str(5).toInt

(id,x)

})

val rdd2_2=rdd2.map(x=>{

val str=x.split(",")

val id=str(0).toInt

(id,x)

})

rdd2_2.join(rdd1_2).map(x=>{

val str=x._2._2.replace(","+x._1,"")

x._2._1+","+str

}).saveAsTextFile("data/out4")

}

}

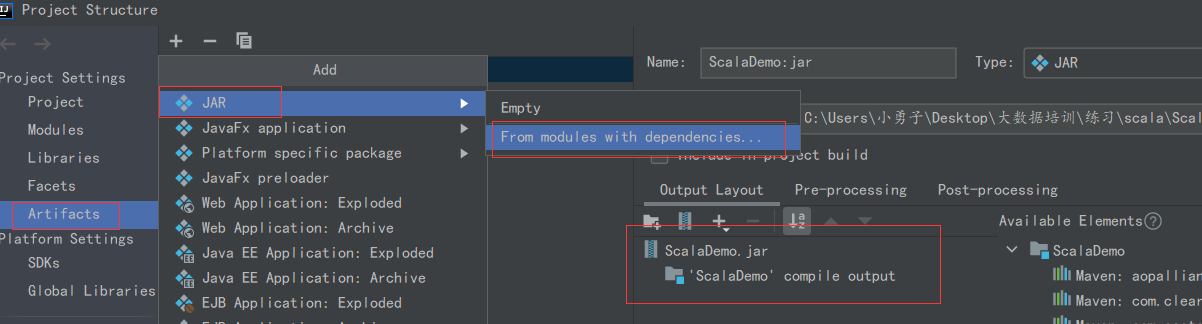

6.spark项目打jar包

7.运行jar包

以单词计数为例

[root@master bin]# pwd

/usr/local/src/spark/bin

[root@master bin]#spark-submit --master spark:master:7707 --class com.xyz.WordCount /opt/test/ScalaDemo.jar hdfs://master:9000/test/test2.txt hdfs://master:9000/test/out1

--master 后面可以填 local 、spark等等

--class 后面填要运行的主类

/opt/test/ScalaDemo.jar 表示jar包位置

hdfs://master:9000/test/test2.txt 文件输入位置 不能写成 http://master:50070

hdfs://master:9000/test/out1 文件存储位置

输入输出位置与下面对应

spark数据清洗的更多相关文章

- ETL实践--Spark做数据清洗

ETL实践--Spark做数据清洗 上篇博客,说的是用hive代替kettle的表关联.是为了提高效率. 本文要说的spark就不光是为了效率的问题. 1.用spark的原因 (如果是一个sql能搞定 ...

- 2-Spark高级数据分析-第二章 用Scala和Spark进行数据分析

数据清洗时数据科学项目的第一步,往往也是最重要的一步. 本章主要做数据统计(总数.最大值.最小值.平均值.标准偏差)和判断记录匹配程度. Spark编程模型 编写Spark程序通常包括一系列相关步骤: ...

- [spark案例学习] WEB日志分析

数据准备 数据下载:美国宇航局肯尼迪航天中心WEB日志 我们先来看看数据:首先将日志加载到RDD,并显示出前20行(默认). import sys import os log_file_path =' ...

- Spark Streaming揭秘 Day29 深入理解Spark2.x中的Structured Streaming

Spark Streaming揭秘 Day29 深入理解Spark2.x中的Structured Streaming 在Spark2.x中,Spark Streaming获得了比较全面的升级,称为St ...

- zhihu spark集群,书籍,论文

spark集群中的节点可以只处理自身独立数据库里的数据,然后汇总吗? 修改 我将spark搭建在两台机器上,其中一台既是master又是slave,另一台是slave,两台机器上均装有独立的mongo ...

- 使用 Spark MLlib 做 K-means 聚类分析[转]

原文地址:https://www.ibm.com/developerworks/cn/opensource/os-cn-spark-practice4/ 引言 提起机器学习 (Machine Lear ...

- [Big Data]从Hadoop到Spark的架构实践

摘要:本文则主要介绍TalkingData在大数据平台建设过程中,逐渐引入Spark,并且以Hadoop YARN和Spark为基础来构建移动大数据平台的过程. 当下,Spark已经在国内得到了广泛的 ...

- Spark ML下实现的多分类adaboost+naivebayes算法在文本分类上的应用

1. Naive Bayes算法 朴素贝叶斯算法算是生成模型中一个最经典的分类算法之一了,常用的有Bernoulli和Multinomial两种.在文本分类上经常会用到这两种方法.在词袋模型中,对于一 ...

- [转载] 从Hadoop到Spark的架构实践

转载自http://www.csdn.net/article/2015-06-08/2824889 http://www.zhihu.com/question/26568496 当下,Spark已经在 ...

- 以慕课网日志分析为例-进入大数据Spark SQL的世界

下载地址.请联系群主 第1章 初探大数据 本章将介绍为什么要学习大数据.如何学好大数据.如何快速转型大数据岗位.本项目实战课程的内容安排.本项目实战课程的前置内容介绍.开发环境介绍.同时为大家介绍项目 ...

随机推荐

- 数据结构(二):括号匹配(C++,栈)

好家伙,写题,题目代码在最后 来吧, 1.栈 栈(stack)又名堆栈,它是一种运算受限的线性表.限定仅在表尾进行插入和删除操作的线性表. 这一端被称为栈顶,相对地,把另一端称为栈底. 向一个栈插入新 ...

- C温故补缺(八):结构体与共用体

结构体与共用体 结构体 是一个可以存储多个不同类型的变量的结构,类似于面对对象中的类(只有成员变量的类). struct tag { member-list member-list member-li ...

- 【数据库】PostgreSQL/PgSql-根据模式名和字段名查询有该字段的所有表信息【通过表元数据信息和函数实现】

一.利用表数据信息查询表和字段信息 (一)从pg_tables中查询表信息 select tablename from pg_tables where schemaname='ap' and tabl ...

- Mysql安装失败-GPG验证不通过或Failed to start mariadb.service: Unit not fou

1.报错原因 报错原文 Key imported successfully Import of key(s) didn't help, wrong key(s)? Public key for mys ...

- 前端HTML不使用flash兼容IE浏览器播放视频

前言:最近公司项目上有个需求就是在IE8上不使用flash技术来去实现视频播放 分析:IE8不支持HTML5,所以不能使用video标签,在非IE的浏览器可以使用video标签 目录 我的解决 DEM ...

- Go语言Golang DevOps运维开发实战

Go语言Golang DevOps运维开发实战 提高运维意识.从下到上,从上到下的工作都要做好,对上运维工作的价值和含金量可以得到认可,对下我们的工作能够提高效率解放运维.运维意识是很重要,并不是你技 ...

- 痞子衡嵌入式:低功耗&高性能边缘人工智能应用的新答案 - MCXN947

大家好,我是痞子衡,是正经搞技术的痞子.今天痞子衡给大家介绍的是恩智浦MCX系列MCU的新品MCXN947. 自 2015 年恩智浦和飞思卡尔合并成新恩智浦之后,关于它们各自的 Arm Cortex- ...

- formly-form 动态表单

动态表单库 https://github.com/ngx-formly/ngx-formly 安装 ng add @ngx-formly/schematics --ui-theme=ng-zorro- ...

- Python全栈工程师之从网页搭建入门到Flask全栈项目实战(7) - 在线问答系统

1.项目源码/业务逻辑 百度网盘链接:链接:https://pan.baidu.com/s/13VNfrSJE6vcL3HP1J5T8ew 提取码:00s0,项目业务逻辑自行阅读 2.项目搭建 点击新 ...

- JavaScript:变量:声明和赋值变量时,内存结构是什么样的?

这里只是大概画出内存结构的模型图,方便理解当我们声明变量和赋值变量时,到底在干嘛. 如上图所示,a赋值一个对象{},b赋值字符串hello: 于是内存里划了三个区域给我们,一个存储我们声明的变量表,即 ...