变分贝叶斯学习(variational bayesian learning)及重参数技巧(reparameterization trick)

摘要:常规的神经网络权重是一个确定的值,贝叶斯神经网络(BNN)中,将权重视为一个概率分布。BNN的优化常常依赖于重参数技巧(reparameterization trick),本文对该优化方法进行概要介绍。

论文地址:http://proceedings.mlr.press/v37/blundell15.pdf

网络权重的点估计

常规神经网络可以基于MLE或MAP对权重作点估计。

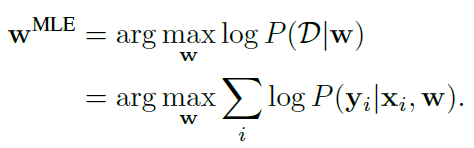

基于MLE(maximum likelihood estimation):

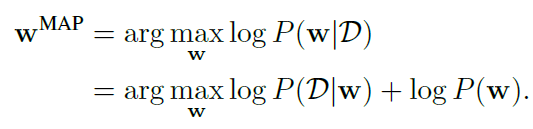

基于MAP(maximum a posteriori):

对权重施加先验,等价于进行正则化。如果施加的是高斯先验,相当于进行L2正则,如果是一个laplace先验,相当于L1正则。

贝叶斯方法

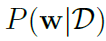

贝叶斯推断在给定训练数据的情况下,计算网络参数的后验概率 ,理论上可以通过以下方式对样本标签所服从的分布进行预测:

,理论上可以通过以下方式对样本标签所服从的分布进行预测:

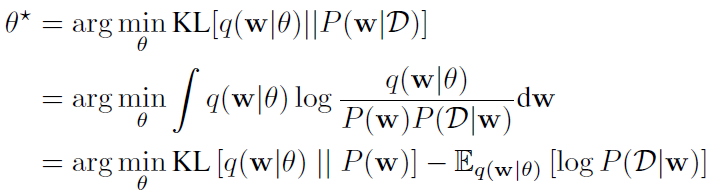

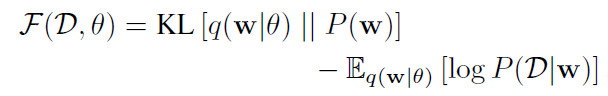

Hinton等人提出对网络权重的贝叶斯后验分布进行变分估计,变分学习寻找参数θ,来最小化分布q(w|θ)和权重真实后验分布之间的KL距离,这里的参数θ可理解为w所服从分布的参数,比如高斯的μ和σ:

这个loss函数就是变分自由能(variational free energy),也称为期望下界(expected lower bound, ELBO)。

可以将loss函数简记为:

损失函数的后半部分代表与数据相关,称之为似然损失,前半部分与先验有关,称为先验损失。该损失也被称为最小描述长度(minimum description length, MDL)

损失函数的后半部分代表与数据相关,称之为似然损失,前半部分与先验有关,称为先验损失。该损失也被称为最小描述长度(minimum description length, MDL)

无偏蒙特卡洛梯度

我们使用梯度下降的方式对上述损失进行优化。

在特定的条件下,期望的微分等于微分的期望。

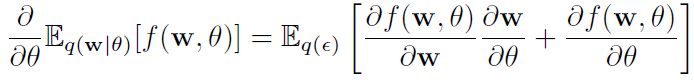

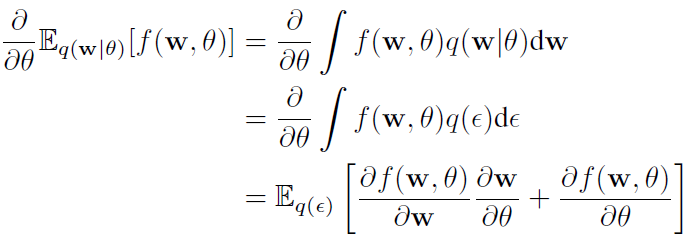

命题1:假设ε服从分布q(ε),令w = t(θ, ε),其中t(θ, ε)是一个确定性函数,假如w的边缘密度q(w|θ)满足q(ε) dε = q(w|θ) dw,那么:

证明:

确定性函数 t(θ, ε)将一个随机噪声和变分后验参数转换为一个变分后验。

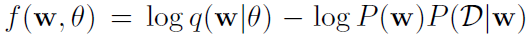

令 ,我们可以将命题1用于优化。通过蒙特卡洛采样,可以通过反向传播算法对网络进行优化。

,我们可以将命题1用于优化。通过蒙特卡洛采样,可以通过反向传播算法对网络进行优化。

命题1就是所谓的重参数技巧(reparameterization trick)。

变分高斯后验

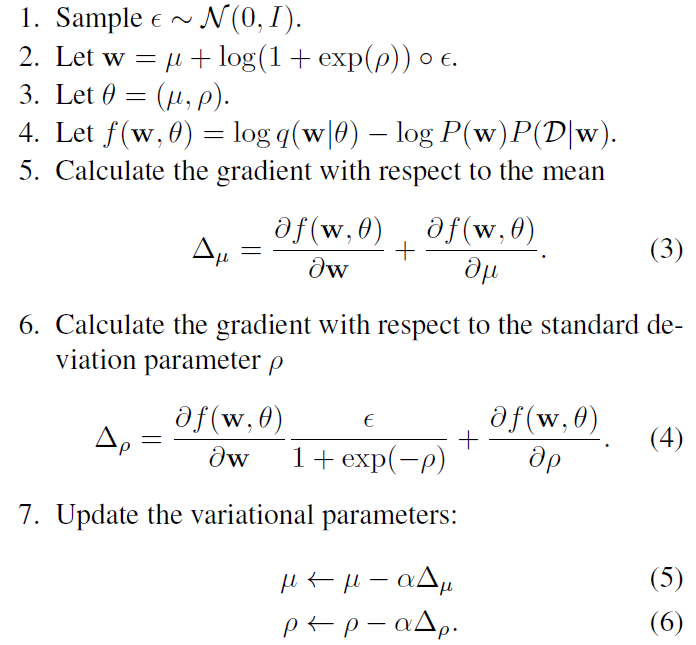

基于高斯后验的变分学习训练过程如下:

这里 就是常规反向传播算法得到的梯度。

就是常规反向传播算法得到的梯度。

基于tensorflow probability的贝叶斯全连接网络示例

import tensorflow as tf

import tensorflow_probability as tfp model = tf.keras.Sequential([

tfp.layers.DenseReparameterization(512, activation=tf.nn.relu),

tfp.layers.DenseReparameterization(10),

]) logits = model(features)

neg_log_likelihood = tf.nn.softmax_cross_entropy_with_logits(

labels=labels, logits=logits)

kl = sum(model.losses)

# loss由两部分构成:(1)负对数似然(2)参数分布与其先验分布(regularizer)之间的KL距离

loss = neg_log_likelihood + kl

train_op = tf.train.AdamOptimizer().minimize(loss)变分贝叶斯学习(variational bayesian learning)及重参数技巧(reparameterization trick)的更多相关文章

- PGM学习之六 从有向无环图(DAG)到贝叶斯网络(Bayesian Networks)

本文的目的是记录一些在学习贝叶斯网络(Bayesian Networks)过程中遇到的基本问题.主要包括有向无环图(DAG),I-Maps,分解(Factorization),有向分割(d-Separ ...

- 变分贝叶斯VBEM 由浅入深

变分贝叶斯EM指的是变分贝叶斯期望最大化(VBEM, variational Bayes expectation maximization),这种算法基于变分推理,通过迭代寻找最小化KL(Kullba ...

- 贝叶斯线性回归(Bayesian Linear Regression)

贝叶斯线性回归(Bayesian Linear Regression) 2016年06月21日 09:50:40 Duanxx 阅读数 54254更多 分类专栏: 监督学习 版权声明:本文为博主原 ...

- lecture10-模型的结合与全贝叶斯学习

这是Hinton的第10课 这节课有两篇论文可以作为背景或者课外读物<Adaptive mixtures of local experts>和<Improving neural ne ...

- 【原】对频率论(Frequentist)方法和贝叶斯方法(Bayesian Methods)的一个总结

注: 本文是对<IPython Interactive Computing and Visualization Cookbook>一书中第七章[Introduction to statis ...

- 概率图模型(PGM):贝叶斯网(Bayesian network)初探

1. 从贝叶斯方法(思想)说起 - 我对世界的看法随世界变化而随时变化 用一句话概括贝叶斯方法创始人Thomas Bayes的观点就是:任何时候,我对世界总有一个主观的先验判断,但是这个判断会随着世界 ...

- 概率图模型(PGM) —— 贝叶斯网络(Bayesian Network)

概率图模型是图论与概率方法的结合产物.Probabilistic graphical models are a joint probability distribution defined over ...

- 机器学习---用python实现朴素贝叶斯算法(Machine Learning Naive Bayes Algorithm Application)

在<机器学习---朴素贝叶斯分类器(Machine Learning Naive Bayes Classifier)>一文中,我们介绍了朴素贝叶斯分类器的原理.现在,让我们来实践一下. 在 ...

- 贝叶斯方法(Bayesian approach) —— 一种概率解释(probabilistic interpretation)

1. Bayesian approach 对于多项式拟合问题,我们可通过最小二乘(least squares)的方式计算得到模型的参数,最小二乘法又可视为最大似然(maximum likelihood ...

随机推荐

- Redis之数据类型和持久化及高可用

数据类型 Redis支持五种数据类型:string(字符串),hash(哈希),list(列表),set(集合)及zset(sorted set:有序集合). String(字符串) String是r ...

- MySQL二进制安装脚本

MySQL二进制包自行百度,晚上很多查找办法 #!/bin/bash #二进制安装mysql并初始化密码为123456 mysql_name=mysql-5.7.31-linux-glibc2.12- ...

- IntelliJ IDEA热部署配置总结

Intellij IDEA 4种配置热部署的方法: 热部署可以使的修改代码后,无须重启服务器,就可以加载更改的代码. 第1种:修改服务器配置,使得IDEA窗口失去焦点时,更新类和资源 菜单Run -& ...

- HDFS设置配额的命令

1 文件个数限额 #查看配额信息 hdfs dfs -count -q -h /user/root/dir1 #设置N个限额数量,只能存放N-1个文件 hdfs dfsadmin -setQuota ...

- 京东数科面试真题:常见的 IO 模型有哪些?Java 中的 BIO、NIO、AIO 有啥区别?

本文节选自<Java面试进阶指北 打造个人的技术竞争力> 面试中经常喜欢问的一个问题,因为通过这个问题,面试官可以顺便了解一下你的操作系统的水平. IO 模型这块确实挺难理解的,需要太多计 ...

- Linux 用户登陆提示This account is currently not available

使用 su 切换到用户 hdfs 时提示:This account is currently not available,使用 hdfs 用户登陆会直接退出 ssh 窗口. 此时可以尝试检查文件 /e ...

- [SpringCloud教程]2. 版本选型和项目搭建

Spring Cloud Alibaba 版本选型 建议先选择Spring Cloud Alibaba的大版本,方便兼容 选择 Spring Cloud Alibaba 大版本 访问链接,找到标题&q ...

- 使用 shell 做 tcp 协议模拟

问题背景 公司有一套消息推送系统(简称GCM),由于人事变动接手了其中的客户端部分.看了一下文档,仅通讯协议部分有几页简单的说明,代码呢又多又乱,一时理不出一个头绪.由于消息是从后台推送到端的,所以使 ...

- 了解什么是Odoo,为二次开发做准备

什么是odoo odoo是由python语言开发,XML为模板的一体化业务解决方案系统,主要使用在企业资源规划(ERP)领域,还可以当做CMS系统,快速搭建自己博客.商城...系统 odoo前身是Op ...

- 蒙特卡洛——使用CDF反函数生成非均匀随机数

均匀随机数生成 先来说说均匀随机数生成,这是非均匀随机数的生成基础. 例如,我们现在有drand()函数,可以随机生成[0,1]范围内的均匀随机数. 要求一个drand2()函数,能够生成[0 ...